Artificial Intelligence (AI)

拡散するAIと不可視のリスク:OpenClawが描き出すエージェント型アシスタントの現在

OpenClaw(別名:Clawdbot、Moltbot)は、エージェント型AIの新たな局面を象徴する存在です。高い自律性と強力な機能を備えながら、驚くほど簡単に使えてしまう。今回の調査では、OpenClawの能力が従来のツールと比べてどのように進化しているのかを確認しつつ、エージェント型AIという枠組みそのものに内在するセキュリティリスクを明らかにします。

- OpenClawは非常に強力で自律性の高いAIツールです。永続的なメモリ、広範な権限、ユーザが細かく制御できる設定といった設計要素が組み合わさることで、エージェント型AIがもともと抱えているリスクを一段と増幅させています。

- こうしたリスクはOpenClaw固有のものではなく、エージェント型AIそのものに内在しています。意図しない行動、データの持ち出し、検証されていないコンポーネントへの依存といった問題は、すべてのエージェント型システムに共通します。OpenClawは新しいリスクの種類を生み出したわけではなく、既存のリスクをより現実的で顕在化しやすい形にしたにすぎません。

- 急速な普及は、現実世界での影響をすでに露わにしています。設定ミスによる機密データの漏洩など、OpenClawのバイラルな広がりは、理論上のリスクがいかに早く現実の事故へと転じ得るかを示しています。そして多くの場合、対策や是正はAIの導入スピードに追いつきません。

- ゼロトラストの原則と継続的な監視が不可欠です。ユーザが管理する環境であっても、どのコンポーネント、どのスキル、どのシステムも無条件に信頼すべきではありません。

はじめに

OpenClawという名前は、すぐにピンと来ないかもしれません。それも無理はなく、このツールはClawdbot、Moltbotを経て、最終的にOpenClawへと何度も名称を変えてきました。ただ、一つ確かなことがあります。この新しいデジタルアシスタントは、確かに「何かが変わった」と感じさせる存在だということです。過去のやり取りを記憶し、データをユーザのデバイス上に保持し、個々の好みに合わせて振る舞いを変えていく。その体験は、最初のChatGPTが登場したときの感覚を思い起こさせるほど、能力の飛躍を感じさせます。一方で、その開発は手放しで称賛できるものではありません。セキュリティ上の悪夢になり得るという警告を発するメディア報道もすでに現れています。

こうした期待と不安の間でユーザが立ち尽くすことにならないよう、ここではOpenClawをもう一歩踏み込んで見ていきます。まず、他のエージェント型アシスタントと比べて、その能力がどこに位置づけられるのかを確認します。次に、OpenClawならではの特徴を整理し、TrendAI™デジタルアシスタント・フレームワークを用いて、その機能を俯瞰します。そして最後に、意図しない動作、データの盗難、検証されていないスキルへの露出といった、これらの機能がもたらすリスクを評価していきます。

最初に明確にしておきたい点があります。ここで扱うリスクは、OpenClaw固有の問題ではなく、エージェント型AIというパラダイムそのものに内在するものです。ただし、OpenClawを際立たせているのは、その制限のない設定自由度にあります。ユーザが任意の権限を付与できる一方で、それを制御する強制的なセキュリティチェックが存在しない。この柔軟さは、既存のリスクを大きく増幅させ、OpenClawを気軽に使えるツールとは言い難いものにしています。むしろ、求められるのは、安全かつ責任ある形で運用する方法を理解し、自身や組織のデジタル環境を損なわずに扱えるユーザです。

OpenClaw:真の自律性を求めるユーザのためのエージェント

OpenClawは、一般的に想像されるAIアシスタントとは性格を異にします。これは指示に反応する道具ではなく、目標と行動を中心に設計されたエージェントであり、最小限の監督だけで複数段階にわたるタスクを実行できます。「受信箱を整理する」「この会議を要約して、明日リマインドする」「予定に合うフライトを予約する」といった目的を理解し、それを具体的な実行ステップへと分解していきます。

各目的の解釈には、ユーザが選択した大規模言語モデル(ChatGPT、Claude、Geminiなど)が用いられます。そのうえでOpenClawは、どのように目的を達成するかを自ら判断し、ブラウザの自動操作、シェルコマンドの実行、ファイル操作、スキルの呼び出しといった適切なツールを使い分けます。どの目標に取り組むかの指示を待っている間も、高い自律性は維持されたままです。ユーザは単にコマンドを投げる存在ではなくなり、目標を定義し、その達成に必要な複雑なタスクの連なりを、最小限の介入でアシスタントに委ねるようになります。

OpenClawは、ユーザ自身のマシン上にインスタンスとして導入でき、WhatsAppやTelegram、Slackといったメッセージングアプリを通じて対話できます。各ジョブの進捗や状態は、テキストでも音声でも随時共有されます。会話の文脈を追い続けることで、OpenClawは状況に即した判断を行い、時間とともにそうした文脈的な理解が蓄積され、永続的なメモリへと変わっていきます。その結果、やり取りのたびに初期化されるのではなく、ユーザの好みや行動パターンに適応しながら、複数のセッションをまたいで目標を追い続けることが可能になります。

その能力は、個人の生産性向上にとどまりません。プログラマーにとってはデバッグの自動化やDevOpsワークフローの効率化を支援し、同時に、健康データのモニタリング、スマートホーム機器の制御、さらには自動車ディーラーとの購入調整といった多様なタスクも実行できます。とりわけ際立っているのは、ユーザとの関わり方です。日常的な作業だけでなく、金銭的な判断を含むような高リスクの行動まで、OpenClawに委ねられるようになっています。このレベルの高度な運用を可能にするため、OpenClawはデータ保存や銀行アプリなど、ユーザのデジタルエコシステム全体にわたるリソースへのアクセスを必要とします。

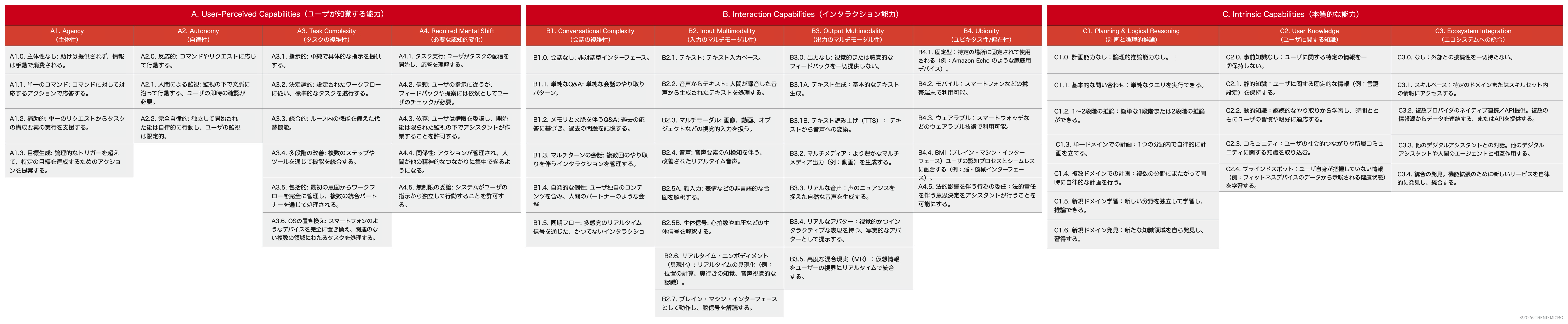

OpenClawの能力をより明確に捉えるため、ここではTrendAI™デジタルアシスタント・フレームワークという視点を用います。このフレームワークは、2024年12月に提示されたもので、デジタルアシスタントが抱える複雑なセキュリティ要素との関係性を整理するための枠組みです。図1は、その中で定義されている機能と進化段階の全体像を示しています。

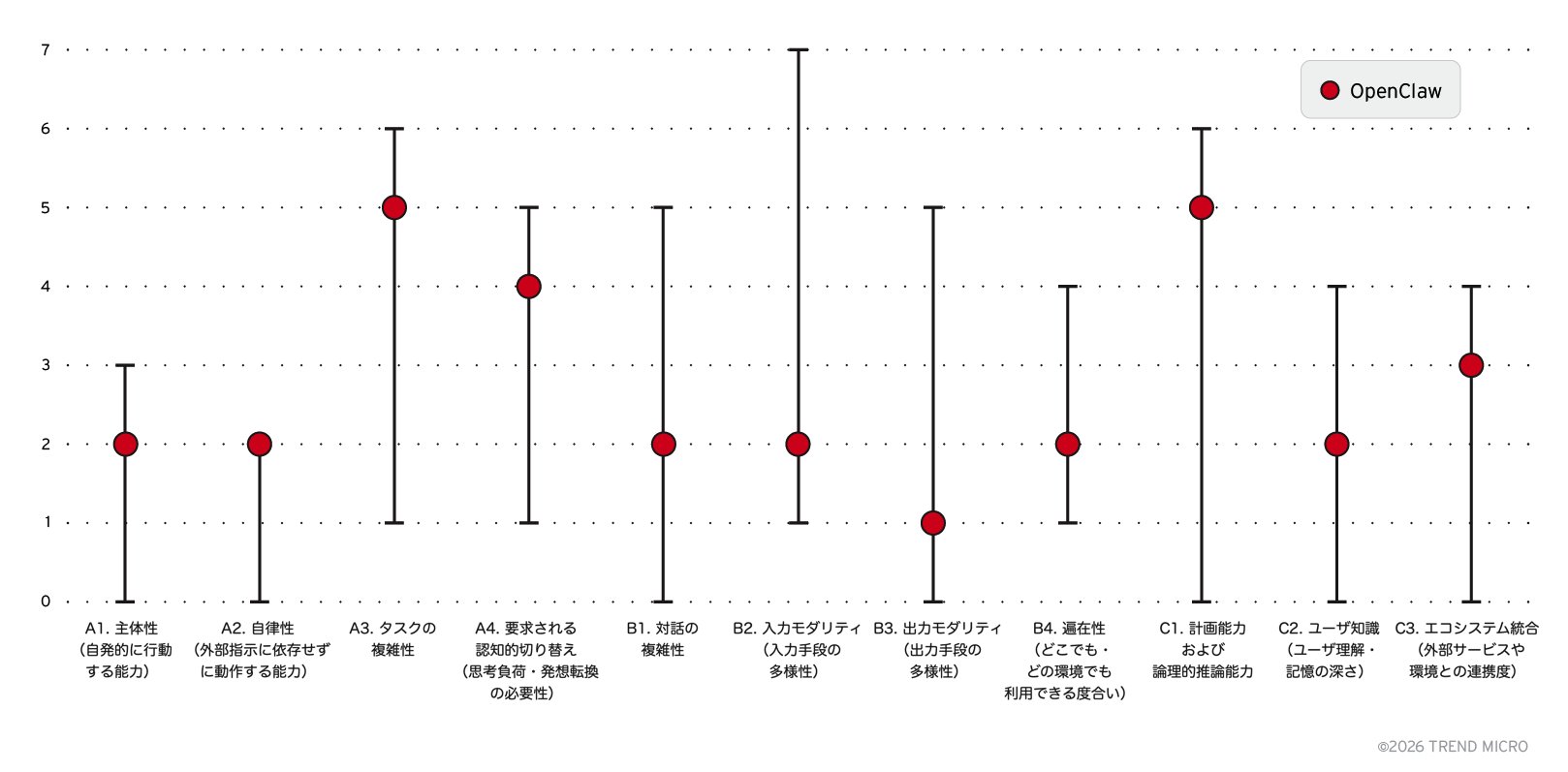

続く図2では、このフレームワーク上にOpenClawを位置づけ、その主要な機能と進展レベルを可視化しています。

機能とリスク:OpenClawは何が違うのか

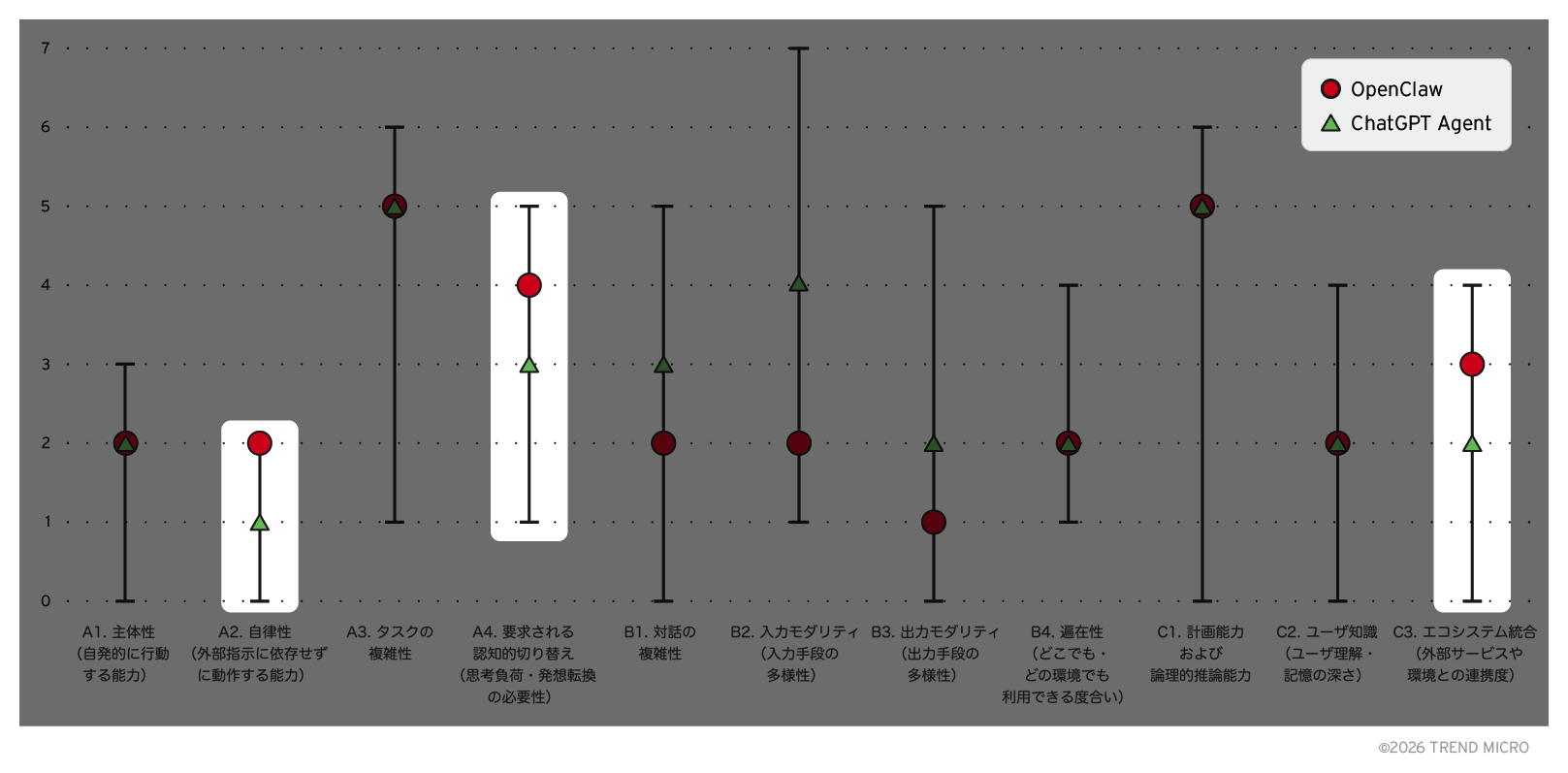

OpenClawは、市場に登場した最初の主流エージェント型デジタルアシスタントではありません。それにもかかわらず、ChatGPT Agentを含む先行するツールよりも、はるかに強い警戒感を呼び起こしています。その理由を理解するため、ここでは独自のフレームワークを用いて、両者を並べて検討します。なお、OpenAIのエージェントについては、以前の記事ですでに詳しく取り上げています。

図3は、二つのアシスタントを比較したものです。この図では、ChatGPT Agentに比べてOpenClawのスコアが高い機能領域が強調されています。この比較は、両者の違いから生じるセキュリティリスク、そしてより広いエージェント型AIというパラダイムそのものに由来するリスクを考えるための出発点になります。

図3が示すとおり、OpenClawは多くのカテゴリにおいて、ChatGPT Agentと大きく異なるわけではありません。いくつかの機能については、両者は事実上同等の水準にあります。たとえば、与えられた目的をどのように追求するかを自律的に判断する能力(エージェンシー、A1)や、モバイル環境から利用できる点(ユビキタス性、B4)は、どちらも備えています。

ユーザ知識(C2)についても、両者は同じレベルに位置づけられていますが、その扱い方には違いがあります。OpenClawは永続的なメモリを保持するのに対し、ChatGPT Agentは通常、セッションに限定された文脈の中で動作します。また、一部のカテゴリでは、OpenClawのスコアがOpenAIのエージェントを下回る場合もあります。特に、会話の複雑さや対応メディアに関わる領域では、より高度なマルチメディア入出力を活用できるChatGPT Agentのほうが優位に立っています。

リスクという観点から見ると、両者の類似性はむしろ重要です。つまり、OpenClawは、これまでChatGPT Agentについて指摘してきたのと同じ種類のリスクに、多くの部分でさらされているということです。これらのリスクについても、上述の記事ですでに詳しく議論しています。

計画立案と論理的推論(C1)―プロンプトインジェクション

OpenClawは、未知の領域にまたがって計画を立て、推論を行う能力(C1)を備えているため、プロンプトインジェクションをはじめとする、エージェントの振る舞いに影響を与える巧妙な操作に対して脆弱です。このリスクはOpenClaw固有のものではなく、推論やオーケストレーションをLLMに依存するあらゆるエージェントに当てはまります。攻撃者は、Webページの中に悪意あるプロンプトを埋め込んだり、文書の本文やメタデータにそれを忍ばせたりすることで、エージェントを意図しない、あるいは有害な行動へと誘導し、結果的に攻撃者の代わりに行動させることができます。

エコシステム統合(C3)―データ流出と外部システムへのアクセス

他のエージェントと通信できる点は、OpenClawを特徴づける中核的な能力です。この特性が、AIエージェント専用のソーシャルネットワークであるMoltbookの登場につながりました。こうしたエージェント間のやり取りこそが、エコシステム統合(C3)において、OpenClawがChatGPT Agentよりわずかに高く評価される主な理由です。ただし、この一点を除けば、両者はいずれも、メール送信、カレンダーの変更、ファイル削除、コマンド実行といった操作を行うために、ユーザのデジタルエコシステム全体にわたる広範なリソースへのアクセスを必要とします。

こうした能力は、行動志向のエージェントとして不可欠である一方で、共通のリスクも引き込みます。ひとたび侵害されれば、これまでに学習したユーザの機密情報が露出する可能性があるという点です。とりわけOpenClawでは、このリスクが際立っています。永続的なメモリが長期的な文脈、ユーザの嗜好、やり取りの履歴を保持しており、そこに他のエージェントと通信できる能力が重なることで、その情報が、悪意あるものを含む別のエージェントへ共有されてしまう余地が生まれます。さらに、両者とも複数のサービスと直接接続しているため、たった一度の操作や操作誘導が、外部システム全体に波及する可能性すらあります。

このように広がったエコシステムは、サプライチェーン攻撃への露出も高めます。エージェントは、十分な検証が行われていない外部スキルやツールに依存することがあります。これについては、過去の複数の調査でも取り上げてきました。もし、こうした依存関係のいずれかが悪意あるものであったり、侵害されていたりすれば、外部に委ねたコンポーネントを通じて、攻撃者はエージェントの振る舞いに気づかれない形で影響を与えたり、データを持ち出したり、エージェントが持つ権限の範囲内で任意の操作を実行したりすることが可能になります。

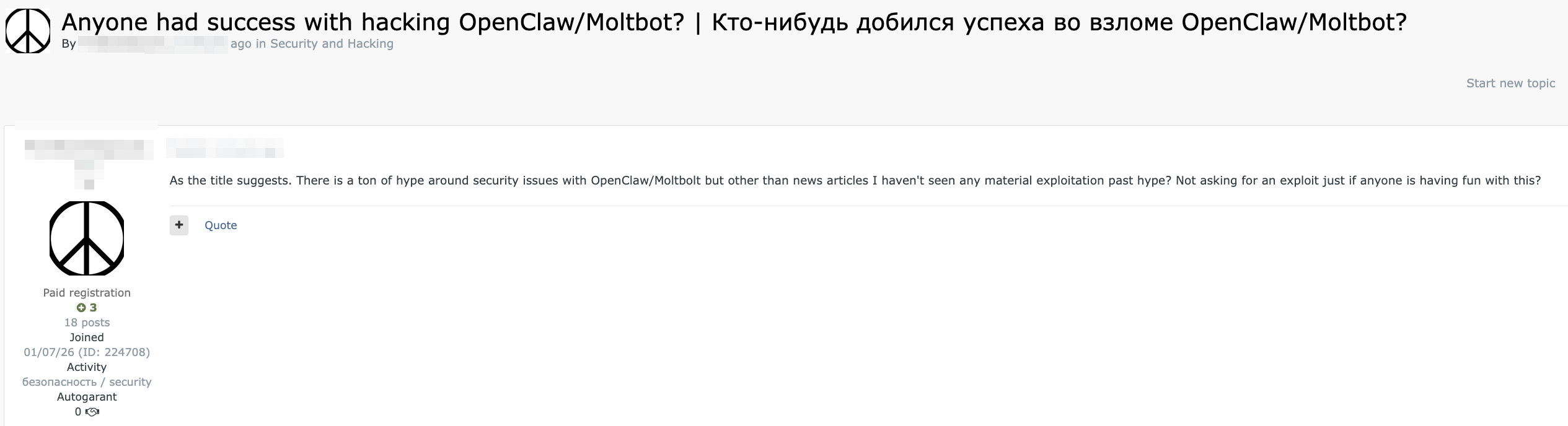

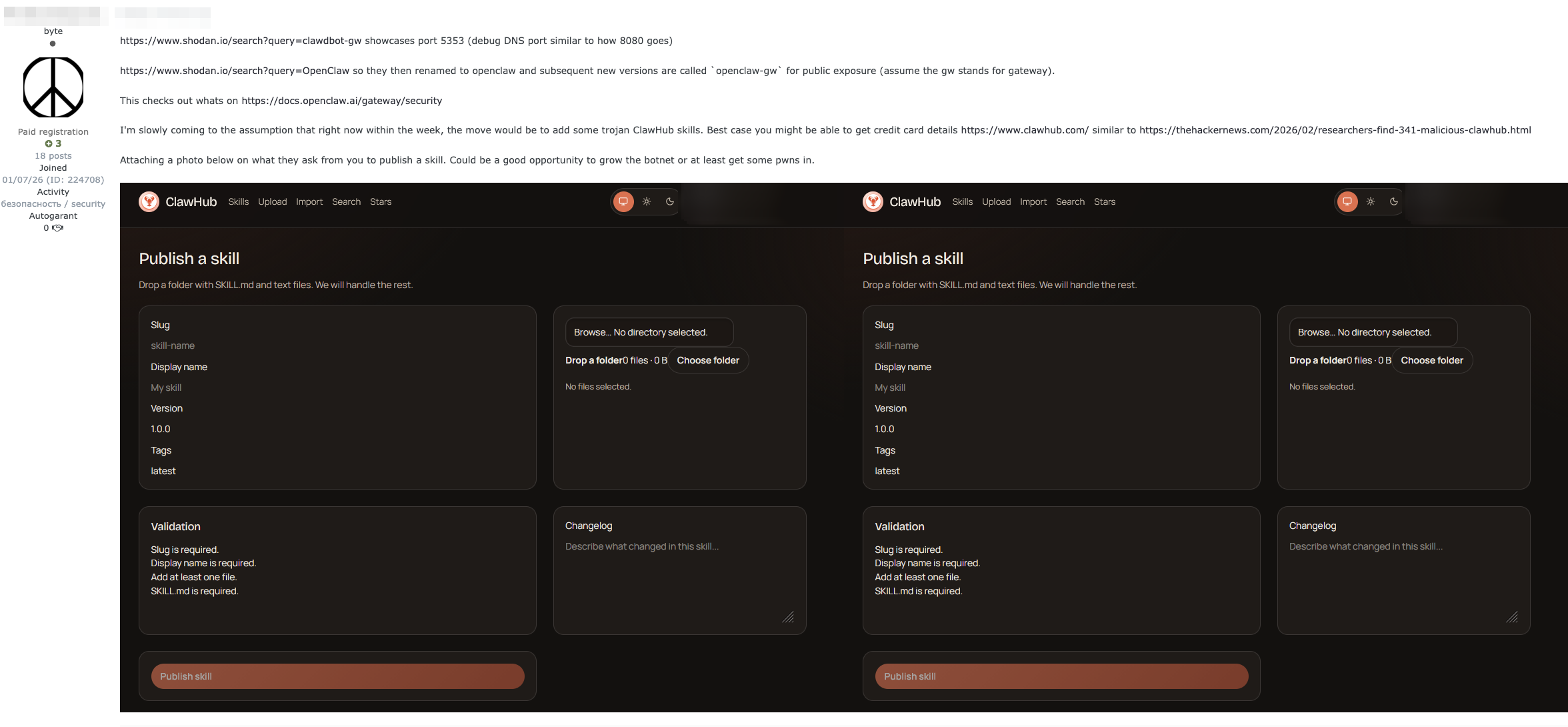

これは決して仮定の話ではありません。OpenClawのハブ上に、悪意あるスキルがすでに公開され始めていることを示す報告も出ており、こうした動きは犯罪アンダーグラウンドでの活動とも符合しています。最近の調査では、Exploit.inフォーラム上で、ボットネット運用などを支援する目的でOpenClawのスキルを展開することが、攻撃者の間で活発に議論されている実態も明らかになりました。その様子は図4に示されています。

自律性(A2)と求められる認知の転換(A4)―エージェント操作

フレームワークに基づく比較では、いくつかの機能においてOpenClawはChatGPT Agentよりも高い評価を得ています。ただし、これらの差は一見すると小さく見えるものの、実際にはリスクを確実に増幅させます。たとえば、ChatGPT Agentも技術的には高い自律性で動作できますが、現実世界に影響を及ぼす重要な操作については、通常、明示的なユーザ確認が求められます。メール送信のような特定のセンシティブな作業にはユーザの承認が必要であり、銀行送金のような高リスクな操作は、そもそも実行できないよう制限されています。

これに対してOpenClawは、異なる設計思想を採っています。人間を必ず介在させる仕組みを強制していません。いったん目標と権限が設定されると、アシスタントは個々の行動ごとに承認を求めることなく、完全な自律性(A2)で動作します。この強制的な監視が欠けていること自体が、リスクを高めます。監督がないままでは、アシスタントが本来想定されていた運用範囲を超えてしまったり、誤りや操作が発生しても、実害が出るまで気づかれない可能性があります。さらに、OpenClawでは、ユーザがアシスタントに金融取引を実行する権限(A4)を与えることも可能です。その場合、侵害が起きれば、接続されている決済アプリにまで影響が及ぶおそれがあり、その結果はとりわけ深刻なものになりかねません。

エンタープライズ環境における無監督な導入が孕むリスク

ユーザの視点に立つと、OpenClawは確かに革新的に感じられます。日常的に使われているメッセージングアプリと統合され、すぐに手の届く存在でありながら、永続的なメモリによって深いパーソナライズが可能になります。さらに、データをローカルで扱う設計は、安心感とコントロール感を強く与え、デジタルアシスタント体験そのものを大きく塗り替えるものです。

しかし、セキュリティの観点から見ると、こうした特徴が他のエージェント型システムと比べて、リスクの性質を根本的に変えているわけではありません。意図しない行動、データ流出、エージェント操作、検証されていないコンポーネントへの露出といった、TrendAI™デジタルアシスタント・フレームワークが示してきたリスクは、実装方法にかかわらず、エージェント型AIというパラダイムそのものに内在しています。それでは、なぜOpenClawは、これほど多くの注目と、時に過激とも言える見出しを集めているのでしょうか。

答えは、そのバイラルな広がり方と、高度なカスタマイズ性の組み合わせにあります。OpenClawは、ユーザが自分の用途に合わせて深く作り込める、非常に複雑なツールです。この柔軟性はユーザを力づける一方で、OpenAIのような主要プロバイダーが通常は設けているリスク低減のためのガードレールを、意図せず、あるいは意図的に回避できてしまう余地も生み出します。認証設定の誤り、システム全体へのフルアクセスの付与、アカウントや外部サービスへの過剰な権限設定、十分に検証されていないスキルの導入などが、その具体例です。

こうした選択が新たなリスクを生み出すわけではありません。しかし、エージェント型AIに本来備わっている危うさを大きく増幅させ、完全に自律したシステムに、ユーザのデジタルエコシステム全体に及ぶ実効的な権限を与えてしまいます。しかも、OpenClawのようなエージェント型システムが驚くべき速度で導入されている現状では、セキュリティ対策の整備、インシデント対応、コンプライアンスの枠組みが、そのスピードに追いつくこと自体が難しくなっています。

調査結果や実際に起きたインシデントは、この点を明確に示しています。OpenClawのインスタンスにおける設定ミスや未検証のスキルが、APIトークン、メールアドレス、プライベートメッセージ、外部サービスの認証情報といった、数百万件規模のデータを露出させた事例も確認されています。これらのケースは、ユーザの判断一つで、データ流出や意図しない行動が、接続されたシステム全体にどれほど大きな影響を及ぼし得るかを示しています。

仮に、これらのOpenClawインスタンスが完璧に設定され、既知の脆弱性がすべて修正されていたとしても、根本的なリスクが消えるわけではありません。悪用のハードルは上がるかもしれませんが、自律性、広範な権限、非決定的な意思決定といった特性は、エージェント型システムの中核を成すものであり、パッチや設定だけで完全に排除することはできないからです。

ここで重要になるのが、資産管理とゼロトラストの原則です。ユーザの管理下にあるシステムであっても、どのコンポーネント、モデル、スキルも、暗黙のうちに信頼してはなりません。ゼロトラストは、エージェント型AIのリスクそのものを消し去るものではありませんが、問題が起きた際の影響を抑える力を持ちます。必要最小限に権限を絞り、高い影響を持つ操作には監督を課し、エージェント、モデル、スキル、ツールを徹底的に検証する。その積み重ねが求められます。同時に、目を背けたくなる現実も受け入れなければなりません。中には、そもそも委ねるにはリスクが高すぎるタスクも存在するということです。金融取引のような重要な領域を、エージェント型システムに本当に任せてよいのか。その問いが、今あらためて突きつけられています。

まとめ

本稿では、OpenClawがどこに独自性を持つのか、TrendAI™デジタルアシスタント・フレームワークを用いて他のエージェント型アシスタントとどのように比較できるのか、そしてその能力が伴うリスクについて検討してきました。また、プロンプトインジェクション、データ流出、検証されていないコンポーネントへの露出といったリスクは、OpenClaw固有のものではなく、エージェント型AIというパラダイムそのものに内在していることも示しました。広範な権限を与えたり、外部スキルを統合したりといったユーザの選択は、こうしたリスクをさらに増幅させるにすぎません。

OpenClawの急速な普及は、警鐘と言えるものです。その突然の人気は、エージェント型AIのリスクがいかに早く現実のものとなり得るかを浮き彫りにし、AIの時代においては、単なるセキュリティ対処だけでは不十分であることを示しています。監督のない導入、過剰な権限付与、高い自律性が重なると、理論上のリスクは、個人だけでなく組織全体に影響を及ぼす具体的な脅威へと変わっていきます。

最近の報告では、5社に1社がIT部門の承認を得ないままOpenClawを導入していたことが明らかになりました。これは、問題が個別の事例にとどまらず、構造的な広がりを持つものであることを示しています。核心にある緊張関係は明確です。エージェントが高機能で、カスタマイズ性が高くなるほど、誤りや操作、悪用がもたらす影響は大きくなり、無監督な導入はそのリスクをさらに増幅させます。

OpenClawのようなオープンソースのエージェント型ツールは、マネージドなプラットフォームよりも高い水準のセキュリティ理解をユーザに求めます。これらは、アシスタントの内部構造を十分に理解し、それを安全かつ責任ある形で使うことの意味を把握している個人や組織のためのものです。

エージェント型AIには、能力とリスクの間に避けがたいトレードオフがあります。本当の課題は、その両方を明確に理解し、どこまでをエージェント型システムに委ねるのかについて、意図的で、十分に情報に基づいた判断を下せるかどうかにあります。

TrendAI™はどのように役立つのか

前述のとおり、ここで整理してきたリスクは、特定のツールだけで解消できる問題ではありません。エージェント型というパラダイムそのものに内在するものです。ただし、私たちが提唱するゼロトラストの原則は、TrendAI Vision One™を通じて具体的な運用に落とし込むことができ、インシデントが発生した際の影響を組織として抑え込む助けになります。

エージェントに届く前にプロンプトインジェクションを検知する

OpenClawや類似のアシスタントは、Webページやドキュメント、さらにはメタデータの中に隠された悪意あるプロンプトに対して脆弱です。TrendAI Vision One™ AI Application Securityは、AIトラフィックをリアルタイムで検査し、エージェントの挙動を誘導してしまう前に、こうしたインジェクションの試みを検知・遮断します。また、自社でエージェント型システムを構築している組織にとっては、TrendAI Vision One™のAI Scannerコンポーネントが、自動化されたレッドチームのように機能し、本番展開前にプロンプトインジェクションの脆弱性を積極的にテストします。

エコシステム全体にわたるデータ流出を防ぐ

OpenClawを有用な存在にしている永続的なメモリは、同時に魅力的な攻撃対象にもなります。長期的な文脈、ユーザの嗜好、やり取りの履歴は、ひとたび侵害されれば一挙に露出しかねません。AI Application Securityは、プロンプトと応答の双方にデータ損失防止(DLP)を適用し、ユーザ環境の外に出る前に機密情報をフィルタリングします。これは、情報がエージェント間の通信経路を通過する場合でも同様に機能します。

シャドーAIを可視化し、リスクに優先順位を付ける

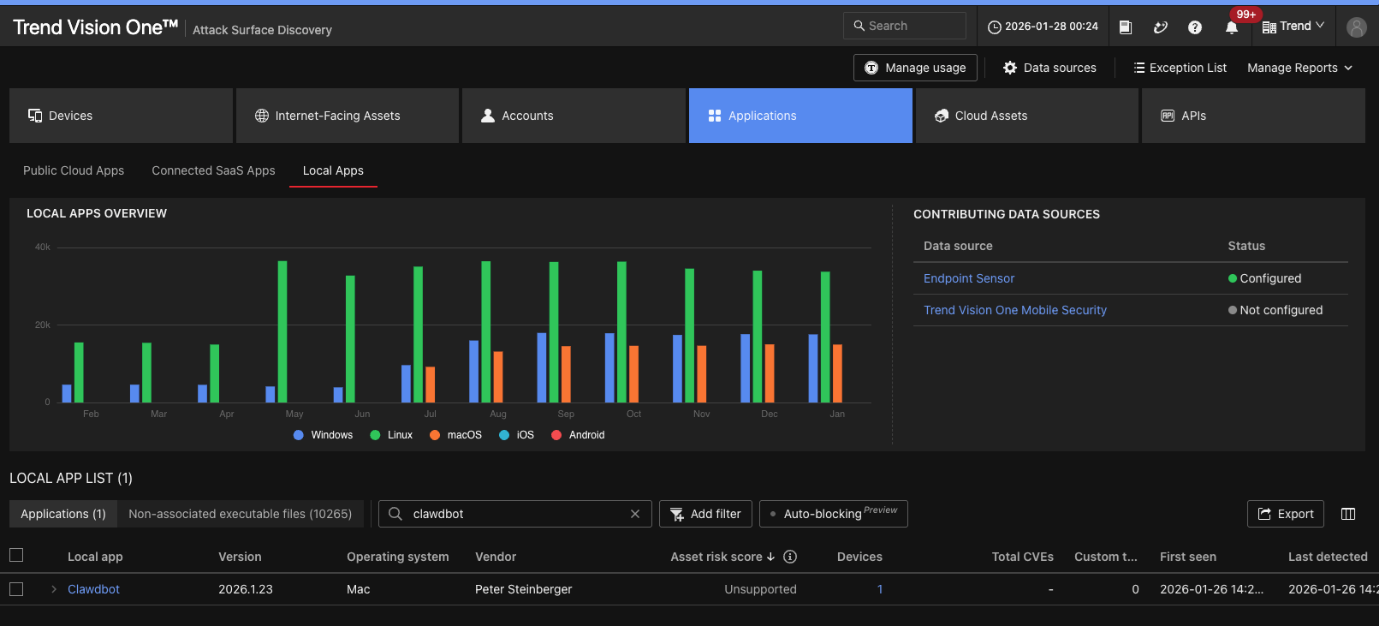

多くの組織で、IT部門の承認を得ないままOpenClawが導入されている現状では、最初の課題は「何が動いているのかを把握すること」に尽きます。TrendAI Vision One™ Cyber Risk Exposure Management(CREM)は、エンタープライズ全体にわたるAI資産を継続的に発見・可視化し、エンドポイント上で稼働している未承認のOpenClawインスタンスも、Attack Surface Discovery機能を通じて把握できるようにします。その様子は図5に示されています。

ただし、可視化だけでは十分ではありません。CREMはさらに、脆弱性、設定ミス、異常な挙動を相関させてリスクを評価・優先付けすることで、セキュリティチームがアラートを追い回すのではなく、最も効果の高い箇所に的確な対策を講じられるよう支援します。

リスクに基づくアクセス制御を強制する

権限は必要最小限に絞るべきですが、ユーザがガードレールなしに任意のアクセス権を付与できる環境では、それは容易ではありません。TrendAI Vision One™ Zero Trust Secure Access(ZTSA)は、固定的な権限ベースやルールベースの制御を超え、アイデンティティ、エンドポイント、AIサービスのリスク状態を継続的に評価し、リアルタイムの状況に応じて動的にアクセスを許可または遮断します。

特に重要なのは、OpenClawや類似のエージェントが、ユーザのアイデンティティを代表してZTSAゲートウェイ経由で公開AIサービスにアクセスする場合です。これにより、本来は組織のセキュリティ境界の外で行われがちなやり取りに対しても、組織側が再びコントロールを取り戻すことができます。

これらの機能が、エージェント型AIを完全に安全なものにするわけではありません。そんなことは不可能です。しかし、責任ある導入に不可欠な、熟慮された、十分に情報に基づくアプローチを支える技術的な基盤を提供することはできます。

著者について

TrendAI™ ResearchのForward-Looking Threat Research Teamは、1年から3年先の将来を見据えて技術動向を探索することを専門とするチームです。その関心は、技術そのものの進化だけでなく、それが社会に及ぼす影響、そして犯罪への応用という三つの側面にまたがっています。そのため、このチームは2020年以降、AIとその悪用の可能性を継続的に注視してきました。同年には、欧州刑事警察機構(Europol)および国連地域間犯罪司法研究所(UNICRI)と協力し、このテーマを正面から扱った研究論文を発表しています。

参考記事:

Viral AI, Invisible Risks: What OpenClaw Reveals About Agentic Assistants

By: Salvatore Gariuolo, Vincenzo Ciancaglini, Fernando Tucci

翻訳:与那城 務(Platform Marketing, Trend Micro™ Research)