生成AIのビジネス活用と考慮すべきリスク

一見華やかに見えるニュースが飛び交う生成AIのビジネス活用ですが、実際の導入にあたってどのようなリスクを考慮しておくべきでしょうか?トレンドマイクロのIT・セキュリティ担当者が自社で活用するうえで考慮したリスクと対応内容を解説します。

公開日:2024年5月31日

更新日:2024年9月17日

生成AIの直近の動向

2024年4月、OpenAIはアジア初の拠点として、日本法人「OpenAI Japan」を東京都で設立したと発表しました(米、英、アイルランドに続き4拠点目)。OpenAI Japanの社長には元AWS Japan社長の長崎氏が就任し、人材確保を本格化していることが各報道でも言及されています。生成AI開発の巨人であるOpenAIが日本に本格進出を果たしたことで、AI事業を展開する国内企業との連携強化も期待され、今後ますます日本でも導入が進むと予想されます。

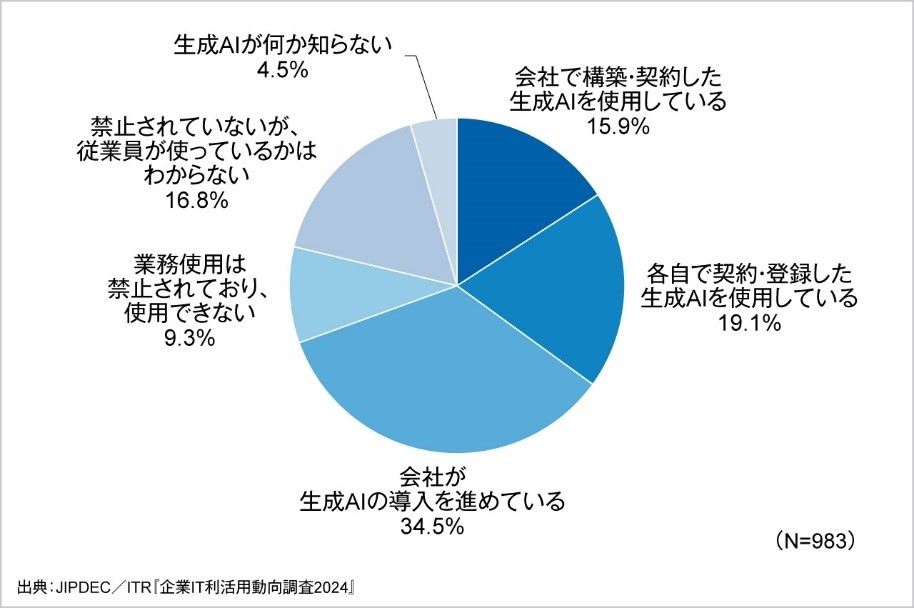

実際に、一般財団法人日本情報経済社会推進協会(JIPDEC)が2024年3月に発表した国内企業の調査(IT戦略策定または情報セキュリティ施策の従事者を対象)では、生成AIの利用企業は35%に上っています※。「会社が生成AIの導入を進めている(34.5%)」という今後の導入予定がある回答まで含めると、7割近い国内企業が何らかの形で生成AIを活用しようとしています。

※「会社で構築・契約した生成AIを使用している(15.9%)」と「各自で契約・登録した生成AIを使用している(19.1%)」を合算した数値。

グラフ:業務における生成AIの使用状況(JIPDEC/ITR「企業IT利活用動向調査2024」より)

一方で、活用が進む生成AIに対して、導入リスクなどを踏まえた規制の議論も進んでいます。下記は、直近の生成AIの規制に関する動きをまとめた表です。現在は米国・欧州を中心に議論が進んでいますが、日本国内でも、国内外の大規模事業者を対象に法規制の検討が進んでいます。2024年5月にEUで成立した「AI規制法」は、罰則を伴う法令として日本企業も注視していく必要があります。

| 時期 | 地域 | 主な出来事 |

|---|---|---|

| 2023年4月 | アメリカ | OpenAI、ChatGPTの対話履歴の管理機能を発表(プライバシーの懸念に対応) |

| 2023年4月 | イタリア | イタリアのデータ保護当局、3月末に発表したChatGPTの一時使用禁止を解除 |

| 2023年5月 | 日本 | G7サミット。安心で信頼できる高度なAIシステムの普及を議論する 「広島AIプロセス」を立ち上げ |

| 2023年7月 | 中国 | 生成AIサービスの管理の暫定措置に関する文書を発表 |

| 2023年7月 | アメリカ | OpenAI、Microsoftなど米テック企業が安全なAI開発の取り組みを約束 |

| 2023年10月 | EU | 欧州委員会、経済安保上の重要技術としてAI技術をリスク評価対象に選定 |

| 2023年10月 | イギリス | イギリス政府、安全なAI開発・導入のためのプロセスを発表 |

| 2023年10月 | アメリカ | バイデン政権がAIの安全な開発・利用に関する大統領令発令 |

| 2023年12月 | 各国 | 広島AIプロセス、高度なAIシステムを開発する組織向けの国際行動規範を発表 |

| 2024年3月 | 全世界 | 国連総会で、安全性や信頼性を備えたAIシステムの開発・利用関する決議案採択 |

| 2024年3月 | アメリカ | バイデン政権、連邦政府機関内でのAI利用指針を発表 |

| 2024年5月 | 韓国 | AIサミットで安全、革新、包容の3大原則盛り込んだソウル宣言採択 |

| 2024年5月 | EU | EUでAI規制法(Artificial Intelligence Act)成立 |

| 2024年9月 | アメリカ | 米カリフォルニア州議会でAI開発企業に安全対策を義務付ける法案※が可決 |

| 2024年9月 | アメリカ | 米国商務省産業安全保障局(BIS)、AI開発者に対して サイバーセキュリティ報告義務を課す規則案を発表 |

表:生成AIの規制に関する動き(公開情報をもとにトレンドマイクロが整理)

※正式名称は「最先端人工知能(AI)システムのための安全で安心な技術革新法」。同州の司法長官が安全管理の不備を理由に、AI開発企業に差し止めを発動できる内容となっている。

生成AIのビジネス活用

生成AIの利用目的と入力するデータ範囲

生成AIの活用は多くの企業にとって、人材不足・業務効率化の観点から不可避と言えます。以下の記事にもあるように、人口減や法規制の強化により、労働力の低下が懸念される日本では特に顕著です。

参考記事:2024年の労働基準法改正とサイバーセキュリティの関連性

では生成AIのビジネス上の活用を考える際に、どのような点に留意すべきでしょうか?前述の法規制やガイドラインが示すように様々なリスクが存在しますが、個々の企業・組織にとっては生成AI導入に際して利用目的を最初に規定することが重要です。それにより、活用範囲が定まり考慮しなければならないリスクも変わるからです。

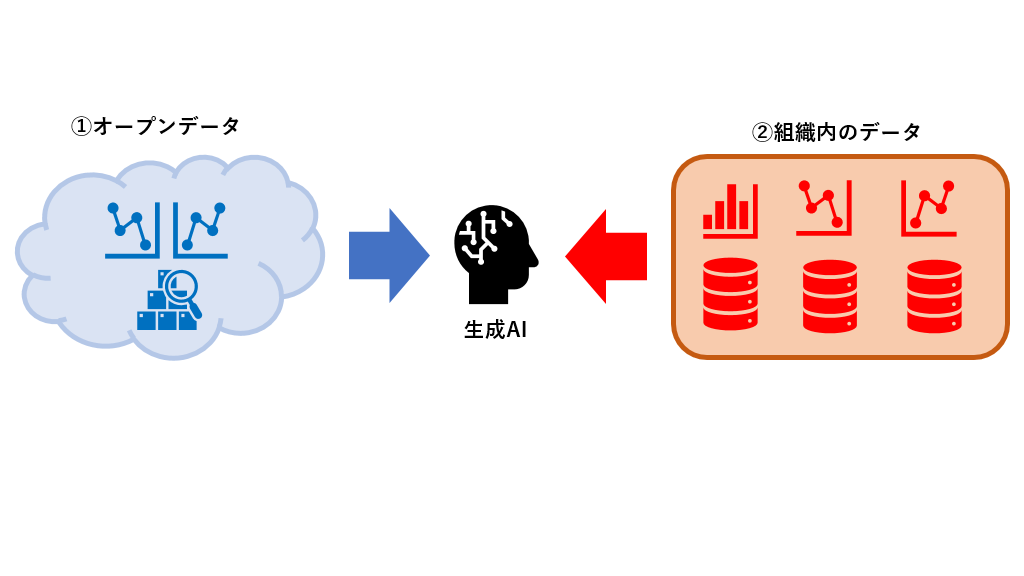

組織における生成AIの活用の段階を一定の尺度で定義づけることは難しいですが、実際に活用する際に生成AIに入力するデータ範囲(生成AIが処理のために参照するデータ※)という観点からは、おおむね以下の2つに分けられます。

※生成AIの思考モデルを開発している企業・組織が使用する学習データとは異なります。

①オープンデータ

②組織内のデータ

①と②の入力するデータをどこまで広げるか、という観点を活用目的により検討することが必要でしょう。例えば、一般的な社外向け文書や公開情報の要約レポートを作成する、画像や動画などのクリエイティブを作成する際にはオープンデータのみの入力で事足りるかもしれません(もちろん、著作権上問題のないデータ、という条件は必須です)。しかし、既存の組織内業務や製品・サービスの開発・運用プロセスの改善支援など、これまで組織で蓄積されたノウハウが前提となる生成AIの活用方法を検討する場合には、②の組織内に蓄積したデータを入力することは必須となるでしょう。

トレンドマイクロでの生成AIの活用例

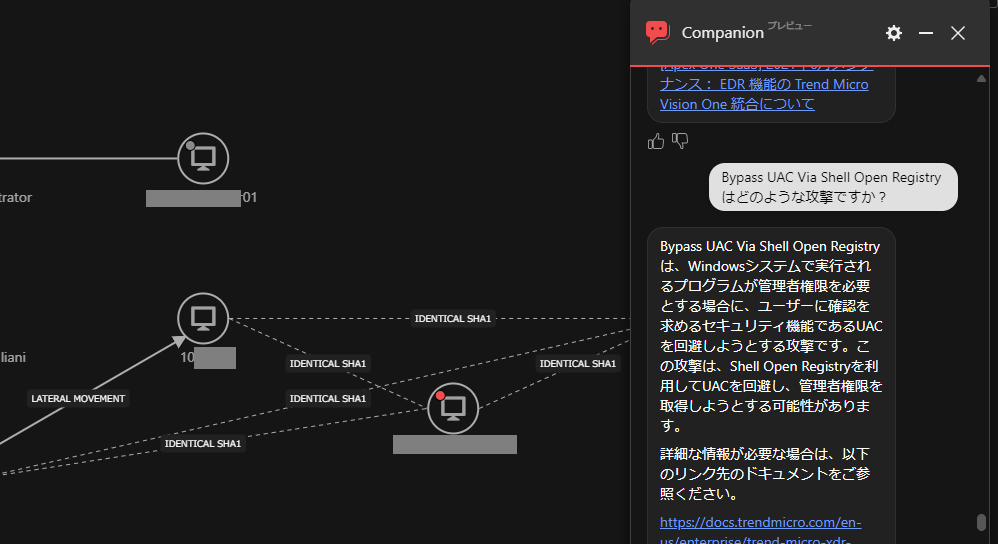

例えば、トレンドマイクロの生成AIの活用方法として、法人のお客様向けに提供しているサイバーセキュリティプラットフォーム「Trend Vision One」の運用支援機能として、生成AIを活用した「Trend Vision One Companion」があります。サイバー攻撃の侵入口や、悪用された脆弱性、マルウェアの動作や拡散の原因など、専門的なセキュリティアラートに関する、ユーザの質問に対して、Trend Vision One Companionがリアルタイムに詳細を解説し、SOCの運用を支援します。

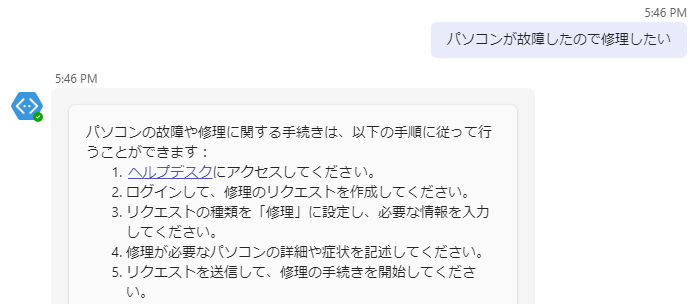

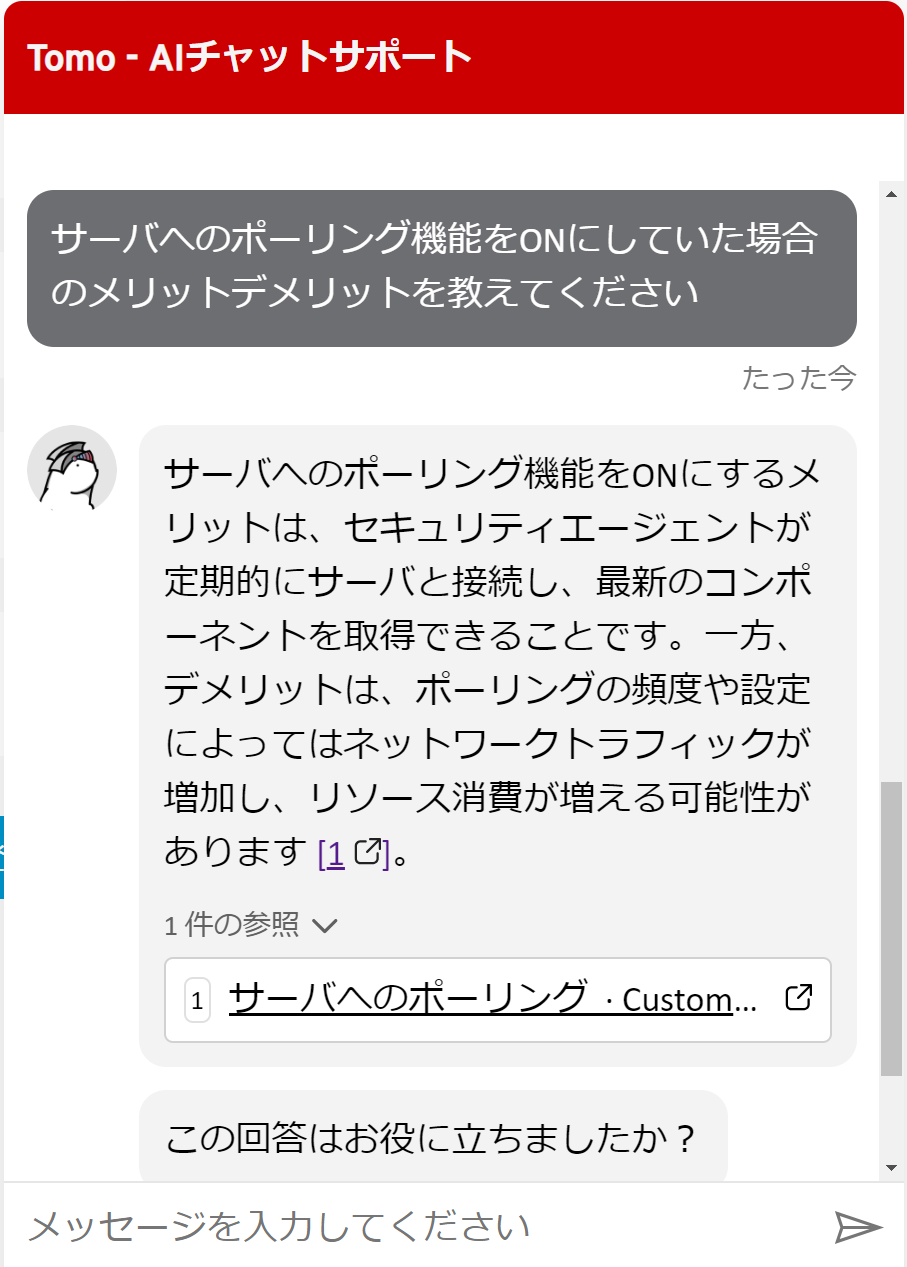

もう1つ活用例として、個人・法人向けのお客様サポート、社内のITのヘルプデスク業務に生成AIを活用している事例があります。どちらも、お客様や従業員の問い合わせにかかる時間短縮や対応人員の作業時間の効率化を目指して、テストや運用を重ねているものです。こうした活用方法の場合、これまで蓄積されたヘルプデスク業務のノウハウや製品・サービスに関わる情報がなければ精度の高い回答を出すことができないため、どのような組織内データを入力させるののかが重要となります。

画面:社内のITヘルプデスク業務の支援サービス。

これまでは社内イントラに掲載されている内容を従業員が探す必要があったが情報を整理・集約して提示する。

画面:生成AIを活用した法人のお客様向けのサポート支援機能「Tomo」の画面例。

ここで参照しているドキュメントには「メリット・デメリット」という言葉がないが、生成AIが質問を解釈して回答を生成している。

入力データの精査

生成AIの回答内容に、対象者に渡すべきでない情報(機密情報や個人情報)が含まれないよう、目的に即した適切な入力データの選定が必要です。そのためには、生成AIを活用する機能・サービスを利用する対象者、情報資産の棚卸(一般、機密情報、個人情報など)が重要となります。

プロンプトインジェクションのチェック

プロンプトインジェクション(prompt injection)とは、生成AI(特に対話型AI)に対して悪意のあるプロンプトを入力することにより、情報漏洩や悪意ある操作の実行など、サービス提供者側が意図しない動作をさせる行為です。プロンプトインジェクションの手法もある程度認知が広まってきたとこもあり、対策側のノウハウも蓄積されつつあります。事前にプロンプトインジェクションのチェックをした上で、製品・サービスに組み込むことが今後必須となるでしょう。利用する生成AIの基盤サービスにフィルタリング機能があるものもあるため、一度確認することをお勧めします。

政治や宗教的、差別的発言への対応

入力されたプロンプトにより、生成AIが政治や宗教的、差別的な内容を含む回答を行う可能性があります。生成AIを活用したビジネス上、こうした回答は適切でない場面であることがほとんどです。こうしたリスクには、設定上「公開情報以外は分からない」という設定にしたり(お客様サポートでは製品に関する質問(公開情報がある質問)以外には回答しないようにするなど)、上記のプロンプトインジェクションのチェックによってリスク回避を図ることが重要となります。

ハルシネ―ションへの対応

ハルシネーション(hallucination)は、生成AIが事実でない内容や存在しない事象について、もっともらしく回答する現象です。学習データの不足やバイアス、データの誤り、生成AI独自の推測などから起こると考えられます。当社のサポート機能の場合、その目的に即して公開情報をベースに回答する設計となっているため、存在しない回答を行うなどのリスクを低減させることができています。しかし、それでも公開情報のサマライズを間違えたりするなど、ハルシネーションをゼロにすることはできていないため、開発メンバーが日々「正答・誤答」を学習させて改善を図っています。

最後に

本稿では、生成AIのビジネス活用の実際と、それに伴って考慮すべきリスクと対策について解説しました。一見華やかに見えるニュースが飛び交う生成AIの活用ですが、従来のIT技術の活用と同じく「その目的」と「取り扱ってよいデータ」を規定・整理することが大前提となります。当たり前のような結論にはなりますが、基本はクラウド技術が登場した際と同じ考え方を転用することができます。組織内ガイドラインの整備などもすでにあるガイドラインを改定するなどで対応できる可能性があります。

昨今では、事業部門での活用が先行しがちな分野ではありますが、セキュリティ部門としての運用のリードをするため事業部門と積極的に会話するなど、ぜひご検討ください。