生成AIとセキュリティ

生成AIが注目を浴びる中、その影響は多岐にわたっています。サイバーセキュリティ会社が提供するセキュリティ製品に活用されるといった良い面がある一方で、サイバー犯罪にも悪用されています。この記事では生成AIがサイバーセキュリティに与える影響について考えていきます。

サイバー犯罪に悪用される生成AI技術

ChatGPTがリリースされて以来、生成AIは広く世間で注目される技術となりました。例えば、企業では生成AIを用いた様々なツールやアプリの開発などが行われています。一般ユーザにおいても画像や文章など様々なコンテンツを作成し、SNS上で共有するなど、その活用は多岐に渡っています。

世間で注目を浴びるということは、同様のことがサイバー犯罪上でも起こります。サイバー犯罪者はこれまでも世間が注目し活用するIT技術に目をつけてそれを悪用し、様々なサイバー犯罪を行ってきている経緯があります。多くの企業でDXが推進されクラウド移行が加速すると、このクラウドサービスを狙った攻撃が進みました。また、コロナ禍に在宅ワークが広がると、今度はVPNの脆弱性を狙った攻撃が盛んにみられるようになりました。生成AIも例外ではなく、サイバー犯罪者は世間が注目する以前から、すでに犯罪の手口の1つとして目をつけていました。

トレンドマイクロでも、サイバー犯罪のアンダーグラウンドマーケットで、「Dark AI」というAI専門のセクションが新たに設けられていることを確認しています。「Dark AI」ではこの革新的な技術のサイバー犯罪における可能性やどのように活用ができるのかが議論されています。実用的な犯罪ツールはまだそれほど確立はされていないようですが、これまでにもフィッシングやビジネスメール詐欺(BEC)を支援するサイバー犯罪用の生成AIツール「WormGPT」※の販売などがアンダーグラウンドマーケット上で確認されている事からも、サイバー犯罪へのAIの導入やそれに関わる犯罪は今後さらに加速すると考えられます。

※2023年8月8日にサービスの販売終了。

図1:WormGPT販売広告(2023年7月)

日本でもいたずら目的と思われる政治家や著名人の偽動画が世間を騒がせましたが、生成AIによるディープフェイク(合成動画や音声の作成技術)を悪用した犯罪が確認されています。これまでもなりすましで被害者をだます犯罪行為(ソーシャルエンジニアリング)は様々ありましたが、ディープフェイクを悪用することで、なりすましのレベルが格段に上がるために被害者もより信じやすくなる危険性があります。

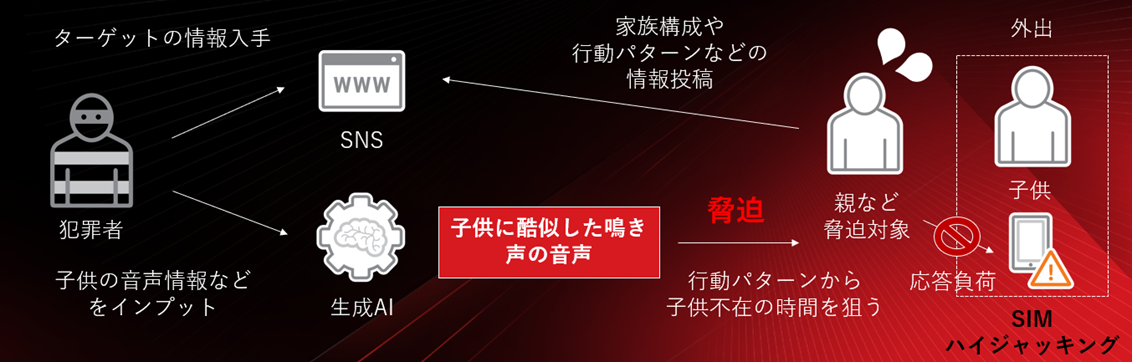

実際にディープフェイクを悪用したソーシャルエンジニアリングの一例として、昨年2023年4月に米国で起きた「バーチャル誘拐」が挙げられます。この事件では、AIで生成した娘本人に酷似した音声を親に聞かせることで、実際には娘は誘拐されていないにも関わらず、親の不安な感情を揺さぶり犯罪者が身代金を要求するという手口でした。突然の出来事に激しく動揺し冷静な判断が難しい中で、子の声に酷似した音声を聞くことで、親の動揺はさらに大きくなります。

そして更に親を動揺させる追加の手段として、「SIMハイジャッキング」が利用される可能性も考えられます。これは、犯罪者が被害者である子供の電話番号を乗っ取り、その番号への呼び出しやデータ送信を犯罪者の端末側に転送させるものです。それにより子供の電話機では、電話呼び出しへの応答や、メッセージの受信などが一切できなくなります。そのため、親から誘拐されたとする子供へ直接連絡し事実確認をすることが出来なくなり、事態は更に犯罪者へ有利な状況に繋がっていきます。このように、生成AIにより従来のサイバー犯罪がさらに洗練され巧になることで、真実と虚偽の境界線がぼやけ、正否判断が難しくなってきます。

図2:バーチャル誘拐の手法のイメージ

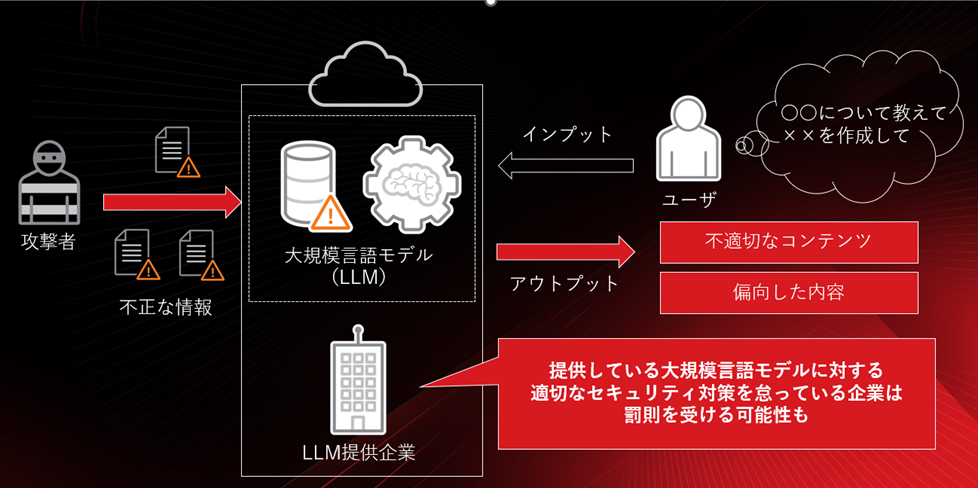

AIの一つである機械学習モデルでは、その基盤として大量のデータを読み込ませることで、パターンを作り出します。その大量のデータの中に意図的に誤ったデータを混入させることをデータポイズニングと呼びます。この行為により学習結果のアウトプットとして、誤った情報の提示や攻撃者が意図する方向へ操作されるリスクが生じます。誤ったデータが混入することで、機械学習モデルを活用したサービス自体の正確性・信頼性にも影響を与えると同時に、それによるビジネス上のリスクや損失も発生してきます。また、利用者側にも自身が利用しているAIを活用したサービスのデータがもしかすると誤ったものであるという可能性を意識する必要が生じます。

今後AIを活用するサービスを展開する企業においても、データの整合性の検証や定期的な監査・モニタリングなどセキュアな機械学習サービスの実装に向けた対策が必要となってきます。

図3:機械学習モデルを汚染するデータポイズニングのイメージ

参考記事:2024年のクラウドセキュリティ脅威予測

AI技術はセキュリティ製品でもその効果は大いに期待されています。トレンドマイクロでもAI-Powered エンタープライズ サイバーセキュリティプラットフォーム「Trend Vision One」に生成AI「Trend Vision One Companion」を2023年7月に搭載して活用しています。本記事の執筆時点では、その機能は主にセキュリティオペレーションの生産性や効率を向上させることにフォーカスされています。例えば、サイバー攻撃の侵入口や、悪用された脆弱性、マルウェアの動作や拡散の原因などを示すアラートの解説やそれぞれの関連付けをアシストしています。

インシデント対応は時間との闘いも重要なポイントとなってきますが、一方で複雑化・巧妙化するサイバー攻撃に関する様々なセキュリティアラートを迅速に読み解き対処するには専門的な知識や豊富な現場対応力が必要となってきます。セキュリティ人材不足が懸念されている中、法人組織ではこのような高度なスキルを持つ人材だけで固めることはなかなか難しく、異なるスキルレベルを持つ人材で現場対応するケースも多く見られます。そのような現場では、生成AIがアラートや攻撃に利用されたスクリプト、コマンドといった内容をわかりやすく説明してくれることで、セキュリティ運用者はその意味を検索し解読するための時間を短縮させることができ、インシデント対応の迅速化のみならず的確性の向上も図ることができるのです。更に生成AIは今後開発が進み、脅威の検知といった分野への新たな活用も期待されています。

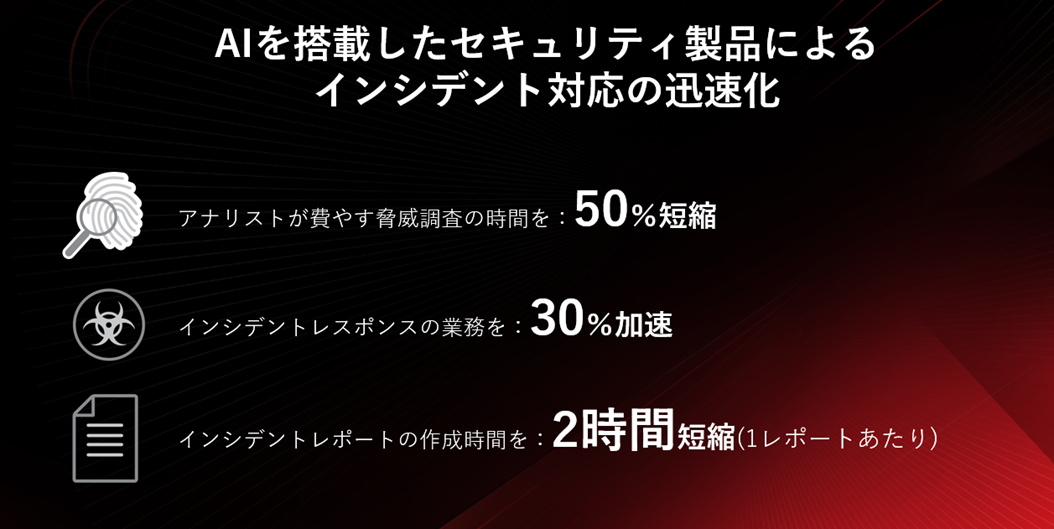

先述した「Trend Vision One Companion」を使用することで、ユーザにとってどのようなメリットが生じているのかを調べた興味深いデータ※があります。そのデータによると生成AIの活用により、脅威調査時間の50%短縮や、インシデントレスポンス業務の迅速化、レポート作成時間の短縮などの結果が出ています。人材不足や運用負荷が課題となっているセキュリティオペレーションにおいて、今後生成AIはますます注目されます。

※トレンドマイクロによる独自調査。

図4:セキュリティ製品におけるAI効果

Security GO新着記事

フィッシングメール訓練の進め方は何から?攻撃手口の把握と訓練の考え方

(2026年5月15日)

サプライチェーンを脅かす開発者・エンジニアに対するサイバー攻撃:手口と対策を徹底解説

(2026年4月24日)