AI犯罪の実態と将来の見通し:「銃」よりも「弾」の販売に走る犯罪グループ

2025年のAI犯罪を分析すると、不正なLLMやAIマルウェア、ディープフェイクを含め、AI技術が着実に悪用されています。その実態から、将来に向けた対策を見出すことが可能です。

- 2025年におけるAI犯罪の特徴として、「AI駆動のマルウェア」、「犯罪向けLLM(大規模言語モデル)」、「ディープフェイクの蔓延」が際立っており、攻撃能力の増大、アクセス経路の広範化、影響の拡大といった傾向が確認されています。本稿では、AI悪用に基づくサイバー犯罪の実態を横断的な視点から分析します。

- AIの悪用を試みる犯罪者は、自ら専用のLLMを構築するよりも、正規のLLMを悪用し、プロンプトエンジニアリングやファインチューニングを駆使した脱獄の手口を開拓し続けています。犯罪エコシステムが正規モデルの悪用に依存する一方、AIプロバイダ側では、巧妙化を繰り返す脱獄手段にいかに対処するかが、重要な課題になります。

- AIによって不正なコードをリアルタイム作成するマルウェアは、攻撃者にとって革新的なアプローチのように映ります。しかし、APIキーの取り消し措置や、結果を確実に予測できない性質が障壁となり、主流のパターンとして定着する可能性は低いと考えられます。注目を浴びる一方、運用観点でのハードルは高く、古典的な手法に比べて安定性に劣ります。

- ディープフェイクのコンテンツが蔓延し、個人に対する攻撃、企業相手の攻撃、金融関連詐欺などに広く悪用されており、「信頼の基準」について再検討する必要があります。

はじめに

2023年に「TrendAI™ Research」が「サイバー犯罪でのAI悪用」に関する初回レポートを発表した際には、「生成AIは本当に脅威になりうるのか?」という点を主な論点として挙げました。2024年初頭の第2レポートでは、乱立していたAI悪用の試みが徐々にパターン化され、まとまり始めている旨を述べました。そして2024年半ばの第3レポートでは、AIを悪用した攻撃の威力が強まり、定着しつつある実態を示しました。いまや、議論の中心は「AIが犯罪に利用されうるのか」といったことではなく、「実際にどれほどの悪影響をもたらすのか」という点にあります。

第4レポートにあたる本稿では、AI悪用が「実験段階」から「産業段階」へ本格的に移行している実態を分析します。つまり、「犯罪者はもはや銃(不正なツール一式)そのものを作るのではなく、弾(既存AIモデルを悪用する手段)を売る形でビジネスを展開している」という状況です。以前は、チャットボットの制約を回避(脱獄)してフィッシングメールを作らせたり、粗いディープフェイクを生成する程度でした。しかし現在では、そうした手口が成熟し、実世界に大きな被害をもたらす「アンダーグラウンドのエコシステム」を堅牢に築いています。

今や、犯罪者がAIを武器として使うのに、国家レベルのリソースは必要ありません。仮にAIモデル乗っ取りなどの行為に及ばずとも、レンタルサービスを利用し、単にプロンプトを投げるだけで十分な場合もあります。参入の障壁は取り除かれ、ツールは洗練され、攻撃対象領域(アタックサーフェス)が大幅に広がっています。TrendAI™ Researchの見解として、「2026年にAI犯罪が一気に爆発する」というわけではありませんが、「今より着実に洗練されていく」とみられます。

本稿では、2025年末時点で犯罪市場のエコシステムがどのような状態にあるのかを、アンダーグラウンドサービスの技術分析、発見されたマルウェア検体、攻撃事例をもとに解説します。TrendAI™ Researchの見解として、現在の脅威情勢には、下記に示す3つの動きがみられます。

- 「脱獄サービス」への集約:「無検閲モデル」と称される犯罪向けLLM(大規模言語モデル)の多くは、実態として、独立したモデルではありません。アンダーグラウンドの傾向として、完全に独立したモデルを作るよりも、正規のAI(ChatGPTやGeminiなど)に依存し、巧妙なプロンプト操作やAPI悪用で「脱獄」するサービスの方が、堅実なアプローチと見られています。

- その場でLLMに「問い合わせる」マルウェア:LLMを利用し、不正なコードをリアルタイムで生成するマルウェアが出現しています。その中には、LLM自体を内部に取り込んだものさえ見られます。現状ではまだ小規模で、運用上の制約も多いですが、これは、マルウェアの設計がAIの技術発展にあわせて進化していることを示します。

- ディープフェイクの急激な拡散:ディープフェイクはもはや新規で特殊な技術ではなく、無料のヌード化アプリからバーチャル誘拐詐欺、国家支援による企業侵入に至るまで、広く深く蔓延しています。こうした合成メディアの拡散により、本人確認や企業セキュリティ、個人の安全といった領域に深刻な懸念が生じています。

こうした動きを総合的に捉えると、現在はまさに転換期に位置していることがわかります。現状では、まだ防御側がAIによる高度なSIEM(Security Information and Event Management)やエージェント型ハンティングツールを駆使することで、優勢を保っています。しかし、攻撃者側によるAI革新の勢いは飛躍的に伸びており、やがて防御側を追い越す可能性も十分にあります。

本当の脅威は、「攻撃者が勝つかどうか」ではありません。問題なのは、AIを悪用した手口がひとたび広域的な犯罪市場に浸透すれば、それが消えることは決してなく、むしろ洗練されていくという点です。今のところは、防御側が優位にあります。しかし、AIを駆使した防衛技術への積極投資や、アンダーグラウンドと同等以上のスピードで進化しようとする姿勢がなければ、攻撃者に追いつかれるのも時間の問題と考えられます。

犯罪LLMの市場

犯罪向けのLLM市場は、「脱獄サービス」であれ「自前ホスティングを名乗るLLM」であれ、依然として活発で、衰える兆しはありません。犯罪フォーラムでは新たな名前のサービスが次々出現していますが、以前のように短命なサービスが乱立しているわけではありません。むしろ、実際に長く存続してきたいくつかのサービス提供者を中心に市場がまとまり、成熟する傾向にあります。

WormGPT:便乗業者に使い回されるブランド名

「WormGPT」という名前は、犯罪系AIの領域で繰り返し使い回されています。大元のサービス「WormGPT」は2023年3月に出現しましたが、その悪名に便乗したコピー品やサービスが生まれ続けています。しかし、こうした新たな「WormGPT」が本家本元と実質的な繋がりを持つ可能性は、極めて低いと考えられます。

トレンドマイクロの調査では、さまざまなTelegramチャネルやFlowGPTプラットフォーム上で、WormGPTを名乗るチャットボットが多数発見されました。これは、特に驚くことではありません。アンダーグラウンド界で一度ブランド力がつくと、その人気に乗じて儲けようとする業者が必ず現れるためです。

さらに大胆な例として、「wrmgpt[.]com」という専用のWebサイトまで立ち上げ、「次世代の無制限LLMを開発する」と称して投資を募っているケースも見られます。当該サイトでは「147名の投資家から300万ドル以上の資金を得た」と述べられていますが、その真偽は確認されていません。トレンドマイクロでは、詐欺的宣伝の可能性も含めて調査を進めています。

なお、サービス名の末尾に「GPT」が付いていても、そのすべてが「犯罪者向けLLMサービス」と言える機能を有しているわけではありません。例えば「DevilGPT」は、その刺激的な名前やTelegram上での活動を踏まえると、さも本格的な無検閲LLMのように思われますが、実態は、さまざまなAI関連ツールの寄せ集めでしかありません。この例が示すようにアンダーグラウンドでは、実質的な機能性よりもブランド名の派手さが先行しがちです。

2025年11月末には、複数のセキュリティ企業から「KawaiiGPT」と呼ばれる犯罪系LLMに関する報告があがりました。KawaiiGPTは、GitHubで無料公開されているAPIラッパーであり、WormGPTなどと同様の機能を持つとされています。その実態は、先述した例と同様にDeepSeekやGemini、Kimi-K2といった正規の一般AIモデルに依存したものとなっています。

Xanthorox:「ミスリード」の典型例

「検閲の一切ないLLM」を謳ったサービスの中でも、最近出現した「Xanthorox」は特に目を引く存在です。この新たなサービスは、「ローカルインフラ上で動く無検閲のLLM」と称し、月額300米ドルで販売されているように見受けられます。報告によると、その運用者は、WormGPTの人気に便乗しようとして失敗したグループの1メンバーとされています。

Xanthoroxは、主に2系統のサービスを提供しています。

- チャットボット型のインターフェース(以前の調査で分析済み)

- ユーザ自身のハードウェア環境で動くコーディング用エージェント

しかし、Xanthoroxの宣伝と、その実際の仕組みには、大きな乖離が見られます。Xanthoroxは「専用インフラで動く無検閲モデル」を謳っていますが、実際にはGoogleなどの大手プロバイダによるLLMを裏で利用し、そこへのアクセス経路を偽装チャネルによって隠蔽していることが、調査によって示されました。

AIプラットフォーム「Hugging Face」では、無検閲と称し、実際にローカルで実行可能なLLMがいくつか公開されています。こうした「アライメントなし(unaligned:倫理面などでの規制がない状態)」とされるモデルは、ダウンロードしてローカル環境で起動することが可能です。しかし、その性能となると、ファインチューニングされた主流のモデル(Xanthoroxが裏で利用するGeminiなど)に及びません。

「エージェント型(自律型)AI」の大規模悪用

Anthropicが公開したセキュリティ報告によると、最近に入って同社のLLM「Claude」が悪用され、多段階にわたるサイバー諜報攻撃が展開されていました。背後にいるAPT(Advanced Persistent Threat:標的型攻撃)グループは、中国との関係が疑われており、偵察やスピアフィッシング活動、政府機関や重要インフラを狙ったスクリプト作成に至るまで、Claudeをシステム的に悪用していたと見られています。

トレンドマイクロの記事でも取り上げた本攻撃事例は、「倫理的制約なしに複雑な攻撃チェーンをサポートする無検閲型AI」の需要が高まっていることを示します。なお、APTと一般的なサイバー犯罪の間には、明確な区別が存在することに注意する必要があります。APTグループは「国家支援」を受けて「潤沢なリソース」を有していることが多く、「長期的な戦略と目的」を有し、「高価値の標的に絞り込んだ」活動を行います。一方、一般的なサイバー犯罪グループは「比較的少ないリソース」を駆使しながら「幅広い標的」を見据え、「場当たり的な」活動を行います。

今回の事例は、「犯罪用LLM」が高度な攻撃グループ間で確かに求められていることを示しています。しかし、一般的なサイバー犯罪者が同じ技術レベルでAIを駆使できるわけではありません。AIツールへのアクセスは以前より開かれていますが、国家支援を受けたAPTグループと闇サイトを拠点とする一般犯罪グループでは、活動の質や規模、一貫性に大きな差異があります。

重要なポイント:犯罪向けAIサービスの進化

犯罪向けLLMの市場は、成熟化しつつあります。以前のように、週ごとに新サービスが出現しては消えていく、といった状況は見られなくなっています。しかし、「無検閲」の実現方法そのものは、ほとんど変わっていません。主流のサービスは依然として、「脱獄(Jailbreak-as-a-Service)」の手口に依存しています。

現在のアンダーグラウンドで欠けているのは、犯罪者自身の専門インフラ上で稼働する「自作のLLM」です。多くのサービス提供者は、「Google Gemini」や「OpenAI ChatGPT」といった正規プロバイダのモデルに依存し、そこに巧妙な脱獄のテクニックや独自のシステムプロンプト、用途向けの細かいファインチューニングを施すことで、検閲や制約を取り払おうとしているのです。先に述べたXanthoroxのケースも、これに該当します。

脱獄サービスが主流になる背景には、資金面や技術面での理由があります。一般的な正規サービスに匹敵するLLMをゼロから作るには、「莫大な計算資源」、「大規模な学習データ」、「高度な専門知識」のすべてが必要になります。そのため、犯罪者側の視点としては、企業が莫大な投資を通じて研究開発した既存モデルに上乗りし、巧妙なプロンプトエンジニアリングによって倫理制御を取り除く方が、圧倒的に安上がりで現実的な選択となります。

以上を踏まえると、今議論すべきことは、「本当の意味で独立したLLMが出現するかどうか」ではなく、「主流AIプロバイダが脱獄技術の進化にどこまで対抗できるか」という点になります。「イタチごっこ」が延々と続くように、犯罪向けAIのエコシステムは防御策による制約を受けながらも、存続できる形で進化を続けていくと考えられます。

すでに存在するAIマルウェア

高度なコード生成能力を持つAIチャットボットが登場したことに伴い、多くのプログラマがその能力を活用し、ソフトウェア開発の効率化を進めています。これは、マルウェアの開発者も同様です。そして次に出現するのは、「必要な機能をその場でAIに問い合わせてコードを作らせる」タイプの自動化マルウェア です。

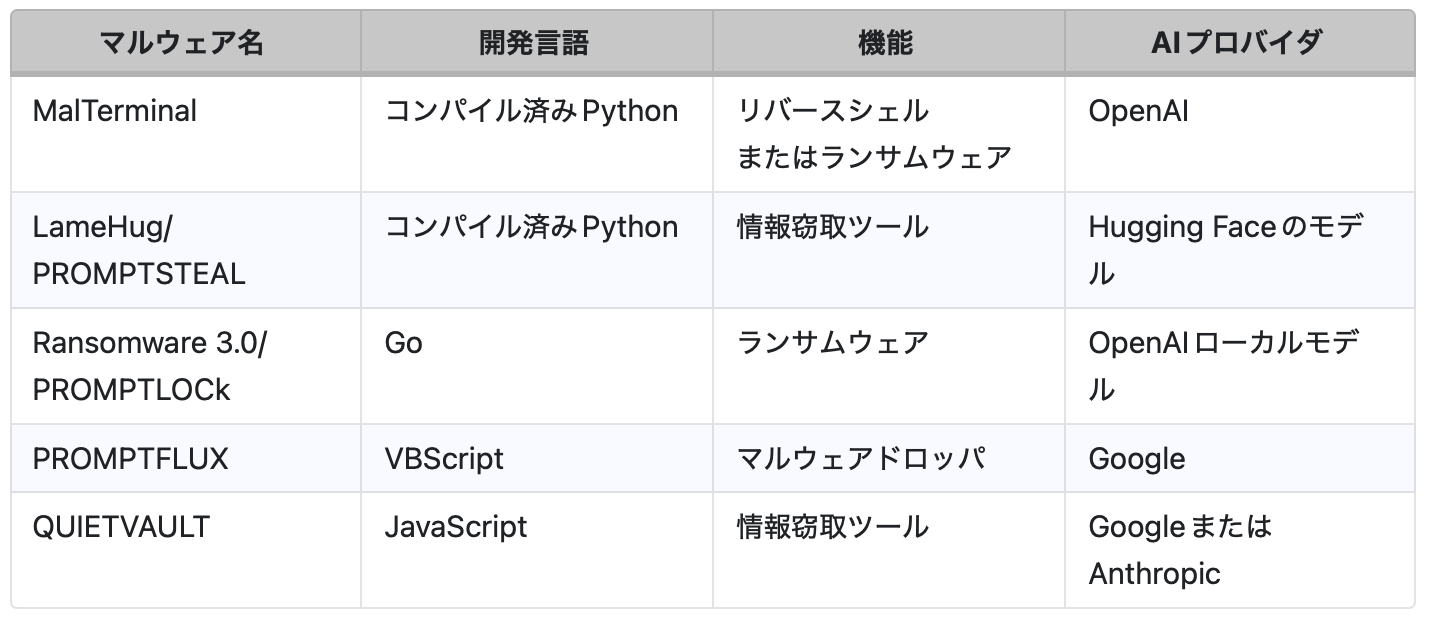

- その先駆けとなったマルウェアが「MalTerminal」であり、2025年9月にSentinelLabsの調査で発見されました。MalTerminalが用いたAIエンドポイントは2023年11月に廃止された古いものであるため、実際にはもっと以前から存在していた可能性があります。MalTerminalは、OpenAIのChatGPTに直接問い合わせて、ランサムウェアのコードやリバースシェルのコードを生成します。また、本マルウェアはコンパイル済みのPython実行ファイルとして拡散します。

- 2025年7月、ウクライナのセキュリティインシデント対応組織「CERT-UA(Computer Emergency Response Team of Ukraine)」は、ウクライナ政府を狙ったとみられるロシア発の新たな攻撃を報告しました。攻撃用のPython実行ファイルは、Hugging Face上のAIモデルにアクセスする仕組みを持ちます。マルウェア内部には固定プロンプトが記述されており、AIモデルに対して「感染端末内のファイルやデータを検索」、「収集したデータを外部に送信」するためのコード生成を要求します。CERT-UAは本マルウェアを「LameHug」と名付け、ロシア軍に関与すると見られるグループ「APT28」が背後で動いている可能性を示しました。なお、Googleは本マルウェアを「PROMPTSTEAL」と呼んでいます。

- 2025年8月、ESETの研究者は、Go言語で作られた新型ランサムウェアを発見しました。このランサムウェアは、AIモデルにプロンプトを送り、その回答に基づいて自身をビルドする特殊な仕組みを持ちます。具体的には、まず、初期ドロッパ(最初の実行ファイル)がHugging FaceからAIモデル本体を丸ごとダウンロードします。次に、そのモデルに対し、ランサムウェアの機能をLua言語のコードで作成するように要求します。続いて、得られたコードをその場でコンパイルします。結果、感染のたびに内容の異なるランサムウェアが生成されます。この手法は巧妙ながらも、感染のたびに約11GBものAIモデルをダウンロードしなければならず、効率面では問題のある作りと言えるでしょう。ESETの発表からわずか2日後、ニューヨーク大学タンドン工学部の研究者は、自動化ランサムウェアの脅威に関するPoC(概念実証)を検討し、「Ransomware 3.0」の名称で発表しました。そして、このPoCは、ESETが報告したランサムウェア「PROMPTLOCK」にちょうど一致していることが判明しました。ただし、PROMPTLOCKが当該PoCを参考に作られたのかどうかは、定かでありません。

- 2025年11月、AIプロンプトを通して不正なコードを生成するマルウェア2件に関する報告が、Googleから発表されました。その1件目は「PROMPTFLUX」であり、Geminiにプロンプトを送っていたことが、2025年6月に確認されました。PROMPTFLUXはVBScriptで作られており、起動すると、特定のVBScript難読化や回避技術の実装を要求し、その場で自身を修正します。Googleによると、本マルウェアはコードの完成度が低いため、まだ開発やテスト中の可能性もあります。例えば、一部の機能はコメントアウトされたままとなっています。

- Googleが報告した2件目のマルウェア「QUIETVAULT」は、1件目と同様にGoogle GeminiやClaude APIにリクエストを送ります。本マルウェアはJavaScriptで作られており、情報窃取を目的としているように見受けられます。実際に稼働すると、GeminiやClaudeに固定的なプロンプトを送り、感染システム内での重要ファイルの探索や、外部GitHubへの流出を行うためのコード作成を要求します。

重要なポイント:AIマルウェアはこれから猛威を振るうのか

AIモデルを通して不正なコードをリアルタイムに生成する手法は、革新性に富んでいますが、重大な欠点を抱えています。それは、もしAI企業に不正を検知され、マルウェア側で利用しているAPIキーを停止されれば、何もできなくなることです。そのため、外部企業が提供するAIに頼っている限り、長期にわたって攻勢を維持することは難しいでしょう。

攻撃者がこの問題を打開する策があるとすれば、それは、ニューヨーク大学の研究者が発表したPoC「Ransomware 3.0」のように、モデル自体を完全にローカル環境にダウンロードすることです。しかし、もちろん、感染後に10GB以上ものデータをダウンロードしていれば、その間に検知され、ブロックなどの措置を取られる可能性が高まります。必然的に、攻撃の成功率は下落するでしょう。

「AIマルウェア」という言葉はいかにもメディアに注目されそうなキーワードで、破壊的なインパクトを秘めています。しかし、これまでサイバー犯罪の問題に取り組んできたトレンドマイクロの見解として、「AIによってコードをその場で生成する」方式に多くの攻撃者が一挙に飛びつくようなことは、かなり稀であると考えています。目的や標的を相当に絞りこんだ小規模な活動には、有効かも知れません。しかし、より広域的な環境において、AIを用いたコード生成はひとつの選択肢でしかなく、すでに実績のある既存技術を容易に塗り替えるものではありません。

例として、マルウェア開発者が「AIによる動的なコード生成」の安定性を高めようと、APIキーの動的入れ替えを検討したとします。しかし、そうした操作はかえってAIプロバイダによるクエリ監視を呼び込み、結局は利用禁止の時期を早めるだけに終わる可能性があります。こうした課題が残る限り、AIによる動的なコード生成がマルウェアの主要な仕組みとして定着することは、ないものと予想されます。

現実的な落としどころのひとつは、一般的な情報窃取ツールやボットネットの上に、柔軟なワイルドカード型オプションとしてAI機能をつけ足すことです。例えば、攻撃者が各ボットに対して下記のメッセージを送り、それをトリガーに正規のチャットボットにアクセスさせるといった方式が挙げられます。

{一度きりの使い捨てAPIキー}:{コマンド}

上述の戦略を取った場合にも、AIによって作成したコードはボット毎に同一とはならず、その差異を予測できない点が、機能上の大きな制約になります。例として、ボットマスターが新たなDoS(サービス拒否攻撃)の機能を新規メソッドで実装したいケースを考えましょう。ここで、下記コマンドを送ると、それを受け取った各ボットがAIによってコードを作成し、コンパイルした上で、実行します。

{APIキー}:XXXとYYYの機能を持つDoS攻撃のコードを作ってください。

しかし、仮に100個のボットがそれを実行したとして、生成されたコードの全てが期待通りに動くとは限らず、挙動が微妙に異なる他、コンパイルエラーが発生することもあります。従ってボットマスター側では、攻撃が成功するという確証をまったく得られず、それを予想することもできません。こうした不確定性は、もちろん、望ましくない性質でしょう。

ディープフェイクの蔓延

ディープフェイクを取り巻く状況は、ここ数年で大きな変化を遂げました。かつては専門知識や高い計算リソースが必要でしたが、いまや参入の敷居は大幅に取り除かれ、完全無料で利用可能なサービスも出現しています。結果、インターネットにさえ繋がっていれば、誰でも非常に強力な合成メディアツールを作成できるようになりました。

トレンドマイクロの分析レポートでは、さまざまな経路からディープフェイクを悪用できるようになった結果、脅威の様相が著しく変化している点を述べました。特に、以下のような動きが確認されています。

- ダークウェブも一般インターネットも含め、ディープフェイクを手軽に作成できるプラットフォームが爆発的に増加

- 犯罪者向けにディープフェイクをサービス提供する組織が出現(Deepfake-as-a-Service)

- AI生成コンテンツによって従来型の本人確認やセキュリティチェックを突破される懸念が噴出

上記の他にも当該レポートでは、「音声クローニング」や「顔差し替え(Face Swapping)」、「テキスト生成」をはじめとする複数のAI技術を組み合わせることで、攻撃チェーンがさらに巧妙化していく可能性を指摘しています。

ヌード化技術の出現

ディープフェイクについて特に懸念される動向として、いわゆる「ヌード化アプリ」の爆発的蔓延が挙げられます。これは、ディープフェイク技術を利用し、写真に写った人物の衣類をデジタル的に取り除くことを目的とした悪質なツールです。ごく普通のソーシャルメディアに投稿された写真ひとつだけで、本人の同意を完全に無視して精巧な偽写真を作ることが可能になってしまいます。こうしたアプリケーションの蔓延は、画像処理技術の進化に伴って発生した負の財産と言えるでしょう。

いまやヌード化ツールは、プラットフォーム「DeepNude」やアプリ「Undress AI」、各種Telegramボットによって広く展開され、無料/低額サービスとして宣伝されています。そして、こうしたサービスの勃発により、画像を用いた性的ハラスメントによる脅威の構図が一変しました。犯罪者は、もはや脅迫に使う秘密写真や映像などを実際に入手することなく、AIによって偽画像を捏造し、それを材料に脅迫行為を行い始めています。

脅威の変遷により、これまで狙われにくかった層にも、被害のリスクが生じています。AI技術に関する警戒が必ずしも高くない高齢者層だけでなく、ソーシャルメディアを日常的に利用する若年層も、格好の標的として狙われます。こうした攻撃によって被害者が受ける心理的な傷は、画像の真偽によらず、深刻に残り続けます。社会や法による対策や迅速なサポート体制が望まれますが、技術変革のスピードに追いつけず、後手に回ってしまうのが実情です。

さらに、AIによるヌード化アプリやディープフェイク技術の蔓延は、「児童性的虐待コンテンツ(CSAM:Child Sexual Abuse Material)」を急増させます。このことが、児童保護の観点において、下記の問題点を引き起こします。

- ディープフェイク技術の進化により、今まで以上にCSAMが人々の手に届きやすくなっています。かつて特殊な技術を必要とされたことが、現在では簡単なアプリ操作で実行できてしまいます。

- AIによる偽画像が氾濫すると、人々はさらに刺激の強いコンテンツを求めるようになります。結果、「COPINE」をはじめとする「児童性的虐待コンテンツの深刻度基準」において、「どこから先を異常とみなすか」の基準自体が押し上げられてしまう可能性があります。

- さらに重大な懸念点として、CSAMの氾濫は、法執行機関による救出作戦(実際に物理的な虐待を受けている被害者を救出すること)を妨げます。捜査員が多くの証拠画像などをふるいにかける際、本当に児童が虐待を受けている画像と、AIによる偽画像を見分ける必要があるためです。国連刑事警察機構(INTERPOL)や国連犯罪司法研究所(UNICRI)が「法執行の枠組みにおけるAIの在り方」として報告したように、自動化システムによって有害なコンテンツ判定を効率的に行えるようになった一方、ディープフェイクにより、救出すべき被害者を発見、識別しにくくなる事態が生じています。

企業侵入:ディープフェイクが生み出す脆弱性

企業を狙った攻撃においては、ディープフェイクを駆使した高度な手口が急速に広がっています。ここ数年で実績のある手段をさらに発展させたものであり、攻撃のエコシステムを形成しつつあります。その代表例が、「CEO詐欺」 です。攻撃者が経営層(CEO、CFOなど)になりすまして銀行振込などを要求する詐欺活動は、以前から存在していました。しかし最近では、ディープフェイクによる音声や映像を組み合わせることで、なりすましの範囲や精度が格段に上がり、企業に対して重大な脅威をもたらしています。

最近の傾向で特に懸念されているのが、「求職者」になりすましてテクノロジー系企業の採用プロセスを突破してしまう行為です。これに成功した攻撃者は、企業内インフラへのアクセス手段を得ることになります。

こうした企業侵入を高度に体系化させた事例として、北朝鮮の国家支援による活動が挙げられます。実行者は、盗み出した資格情報や偽の経歴書を利用し、AIによって架空のプロフィール写真を精巧に作り上げ、求職者を装います。また、リモートワーク体制を逆手に取ることで実対面での身元確認を巧みに回避しつつ、VPNやプロキシを用いて実際の所在地を隠蔽します。こうして「採用プロセス」を通過して企業内部に入り込むと、機密情報の窃取、知的財産の盗用、不正な収益獲得などの活動を行い、得られた利益を最終的に北朝鮮政府に送り届けます。攻撃者が数ヶ月、数年にわたって正規社員として勤務を続けることもあり、その間の給与は、国家活動の資金源として回収されていきます。本事例は、綿密かつ長期的な攻撃計画や、大規模な運用体制を特徴づけるものです。

金融業界への脅威:KYCの無力化

金融業界に関しては、ディープフェイクの進歩により、リモートから口座開設を受け付ける際のKYCプロセス(Know Your Customer:オンラインで本人確認を行う手続き)が深刻な脅威に晒されています。攻撃者は、利用者の利便性と厳格な本人確認という相反する要求の狭間を突き、「顔の差し替え」や「ライブネス検知の回避」といった高度な手法を駆使しながら、「本人確認」の保護網をすり抜けようとします。

トレンドマイクロの調査に基づくと、犯罪者がビデオ通話による本人確認の場面でリアルタイムの顔操作や盗んだ身分証を組み合わせ、正規の申請者に成りすますケースが発生しています。さらにアンダーグラウンドフォーラムでは、「KYCの回避」を専門的に扱うサービスまで登場し、チュートリアルやカスタマーサポートも提供されています。こうした動きに対して金融機関などは、実際の人間とAI合成を区別するために、AIベースのライブネス検知システムを導入しています。しかし、それを回避することに特化した敵対的技術も開発されています。

以上のように、ディープフェイクを悪用する攻撃者と、AIシステムで対抗しようとする防御側の間で、「軍拡競争」が激化しています。結果、金融機関は次世代の生体認証技術に巨額の投資を続けざるを得なくなり、攻撃者もそれにあわせて巧妙に手口を進化させています。こうした「イタチごっこ」により、安全なデジタルバンキングを支える本人確認のプロセスそのものが、根底から揺さぶられています。

一般市民に及ぶ脅威:ロマンス詐欺とバーチャル誘拐

ディープフェイクの脅威は企業や組織だけでなく、一般市民にも及びます。そして、「ロマンス詐欺」や「暗号資産詐欺」のように、特に一般市民を狙った攻撃パターンも存在します。特に、以前取り上げた「バーチャル誘拐」は、ソーシャルエンジニアリング攻撃の著しい進化を裏付けるものであり、深刻な懸念事項となっています。

「バーチャル誘拐」は、被害者と関係の深い人物(主に家族など)の声をディープフェイクによって極めて精巧に偽造し、動揺や混乱の入り混じったトーンで「実際に誘拐されたかのように」喋らせます。犯罪者は、それを被害者に聞かせることで「誘拐が実際に起きたものと」信じ込ませ、脅迫によって金銭を引き出そうとします。

こうした攻撃手法は、効率と威力の両面で、大きな脅威となります。攻撃者は、ソーシャルメディアの投稿やボイスメール、公開コンテンツなどからわずか数秒程度の音声を拾うだけで、その精巧な音声クローンを自在に作り上げることが可能です。通話に応じた被害者は、紛れもなく家族や友人のそれと認識できる声を聞かされ、すぐに身代金を払うように、苦痛に満ちたトーンで嘆願されるのです。音声クローンは精巧に作られており、危機感を煽るように調整されています。「誘拐」という非日常的な事態に直面した被害者は、それが架空に作られたものなどとは疑う余地もなく、「犯人」の要求に従ってしまう可能性があります。

バーチャル誘拐は、典型的な「旅行先でトラブルに遭った」などと装う詐欺を技術面で進化させ、さらに心理的効果を大幅に増幅したものとみなせます。こうした詐欺の標的と言えば、以前なら高齢者層が狙われる傾向にありましたが、バーチャル誘拐では、その範囲にとどまりません。本攻撃の狡猾さは、人と人の間に生じる親近感を巧みに利用している点であり、日頃からセキュリティに注意を払っている人さえも、犠牲になる可能性があります。

Soraの台頭:ディープフェイク動画の未来

OpenAIによる高度な動画生成エンジン「Sora」が登場したことを契機に、ひとつの大きな疑問が浮上しました。それは、「動画ベースの新たなディープフェイク攻撃が到来しているのか」、ということです。

その答えは、まだ正確にはわかっていません。テキストから動画を生成する技術は革新的である一方、それを攻撃に活用する際には「計算コスト」、「ユーザ規制」、「主要プラットフォームが実装するウオーターマークシステム」など、実践的な課題が浮上します。しかし、歴史を振り返ると、こうした課題は時間とともに解決されていきます。

Soraのようなツールの台頭によって特に懸念されることは、テキストプロンプト一つだけで、元の映像を一切使うことなく、ストーリーに沿った動画を生成できる点にあります。結果、これまでにはなかった新たな部類の攻撃が発生する可能性があります。例えば、裁判における証拠映像の捏造、実際には起きていない出来事を裏付ける証拠動画の作成、リアルな詐欺シナリオの作成などが挙げられ、これらが、専門的なスキルがなくても実行可能になってしまいます。

Soraのような技術が流出AIモデルやオープンソースの代替品によって広くアクセス可能な状態になると、動画形式の証拠資料も、メールや電話と同様に、疑ってかかる必要があります。動画さえ容易に信用できなくなったという事態に対し、企業、組織、個人の全てが、備えを固めていく必要があります。「ディープフェイク動画が深刻な脅威になるかどうか」はもはや問題ではなく、「いつそれが起こるのか」に注視していくことが重要です。

重要なポイント:ディープフェイク時代における「信頼性の拠り所」

2025年におけるディープフェイクの脅威を踏まえると、現代のデジタル空間では、「何を信頼の拠り所にするか」、「どのように検証するか」という根本的な前提が大きく揺さぶられています。個人を狙うヌード化アプリから、企業内部に忍び込むなりすまし攻撃、金融関連詐欺に至るまで、AIによる合成メディアは、サイバー犯罪の万能な武器として蔓延しています。

動画生成ツールを含むAI技術が飛躍的に進歩する中で、防御側はさらに体制を強化していますが、攻撃者側の技術革新も激化しています。これから取り組むべき課題は、優れた検知技術の開発のみにとどまりません。従来から信頼できると見なされてきた動画メディアにも疑いを持ち、精巧なAI合成メディアの偽装にも対処できる検証プロセスを開発することが重要です。

まとめ

犯罪関連サイト「BreachForums」で「無検閲GPT(uncensored GPT)」の宣伝が出現してから3年ほど経過した現在、AI犯罪を取り巻く市場は、他の闇市場と同様に成熟化の道を進んでいます。初期に乱立していた荒削りな模倣サービスや短命な事業は姿を消し、より安定的で専門性の高い業者が幅を利かせるようになりました。そうした中で特に成功している攻撃者は、もはや「銃」にあたる不正なツール一式を自ら作るのではなく、「弾」の部分、つまり、一般AIプラットフォームを脱獄、悪用する形のサービスを販売しています。

WormGPTのクローン、リアルタイムで不正なコードを生成するマルウェア、5米ドルで販売されるヌード化ボットなども、背後にあるのは同一の経済原理であり、それが攻撃チェーンの異なる段階で現れているに過ぎません。結果として生まれたアンダーグラウンドの「AIスタック」は、従来の防御者が想定していたよりも安価で柔軟性が高く、人々の手に近づいてきます。犯罪者は、AIモデルの開発、学習、インフラのコストを負うことなく、正規AIプラットフォームから最大限の価値を搾り取る手法を把握しました。つまり、AI業界が巨額の研究開発費を投じて築いた産物そのものを、自らの武器として悪用しているのです。

2026年の見通しは決して破滅的なものではありませんが、脅威は着実に広まっていくでしょう。予測的見解として、AIを悪用した新手の攻撃が突如、爆発的に勃発するようなことはなく、既存の犯罪ツール類が継続的に刷新、強化されていきます。脱獄サービス(Jailbreak-as-a-Service)は安定的な地位を確保し、ディープフェイクは性能向上と価格低下の道を進みます。マルウェア開発者は、運用上の制約がある中でも正規LLMの悪用法を模索し続けるでしょう。アンダーグラウンドは、その本領である「利益、しぶとさ、大規模化」を最適化する形で、AI悪用の手口を進化させていくと見込まれます。

一連の傾向が防御側に対して示唆することは、明白です。もし仮に「APIキーの不正利用やTelegramヌード化アプリなどは重要リスクではなく、末端のレアケースでしかない」という認識があったのであれば、それが誤りであることは、2025年の動向から明らかです。AIプロバイダが投入している開発研究費は、数週間の間に犯罪組織によって回収され、「武器」として悪用されていきます。アンダーグラウンドの犯罪者は、正規事業の利用規約や管理対象のエンドポイント、責任ある開示スケジュールなどを全く意に介さず、莫大な投資の産物を隅から隅まで悪用しつくそうと考えます。

こうした動向を軽視し続ければ、四半期毎に「新たな不正利用の事例が発生した」と、後手対応を強いられることになります。それを避けるためにも、「AI攻撃はもはや例外ではなく、主要な攻撃パターンである」という前提に立ち、安全に配慮した対策を設計として取り入れることが重要です。

著者紹介

TrendAI™の「Forward-Looking Threat Researchチーム」は、数年先の将来を見据えたセキュリティを確立するために設立されたチームであり、主に技術革新やその社会的影響、犯罪悪用に焦点を当てた分析を行っています。この目標を主軸に2020年以来、AIの動向を入念に追跡し、悪用や誤用のリスクを調査してきました。2020年当初には、まさに本稿のトピックに合致するリサーチペーパーを、欧州刑事警察機構(Europol)や国連犯罪司法研究(UNICRI)との提携のもとで発表しました。

参考記事:

They Don’t Build the Gun, They Sell the Bullets - An Update on the State of Criminal AI

By: Vincenzo Ciancaglini and David Sancho (Forward-Looking Threat Research Team, TrendAI™ Research)

翻訳:清水 浩平(Platform Marketing, Trend Micro™ Research)