NIST AIリスクマネジメントフレームワーク(NIST AI 100-1 AI Risk Management Framework)の概要を理解する

サイバーセキュリティフレームワークを発行しているNISTは、AIのリスクを検討する際のガイドライン「AIリスクマネジメントフレームワーク」も公開しています。今回は、その概要を解説していきます。

NIST AIリスクマネジメントフレームワーク(AI RMF)とは

NIST AI Risk Management Framework(以下、AI RMF)※は、米国国立標準技術研究所(National Institute of Standards and Technology:NIST)が、2023年1月に策定・公表したガイドラインであり、AIシステムに伴うリスクをライフサイクル全体にわたって体系的に特定・評価・管理するための枠組みを、AIシステムの導入を進める組織に提供するものです。AI RMFはver1.0が最新版です(2026年3月27日現在)。

※正式名称は「NIST AI 100-1 AI Risk Management Framework (AI RMF 1.0)」。

公表の背景には、AIに関連するリスクがもはや将来の懸念ではなく、現実の経営課題となっているという共通認識の広がりがあります。実際、AIはすでに業務の安定性、規制対応上のリスク、データガバナンス、さらには企業に対する社会的信頼にも影響を及ぼしています。AI RMFは法人組織新たな規制や義務を課すものではありませんが、技術部門と非技術部門が共通の枠組みと言語でAIリスクを議論できる基盤を提供する点に意義があります。

本フレームワークの特徴の一つは、特定の業界や技術に依存しない設計になっていることです。従来型の機械学習モデル、生成AI、AIを活用した意思決定支援ツールなど、さまざまなAIシステムに適用可能であり、自社開発か外部ベンダー提供かも問いません。このため、ベンダーやシステムインテグレーター、海外のテクノロジーパートナーに依存するケースが多い組織にとっても、実務上きわめて有用な指針といえます。

AI RMFは、個々のモデルに対する技術的な管理策にとどまらず、AIリスクを企業全体のガバナンス課題として捉えています。すなわち、サイバーセキュリティやプライバシー、オペレーショナルリスクと同様に、経営レベルで体系的に管理すべき重要テーマとして位置づけています。

AI RMFは誰にとって有用か?

AI RMFは、AIに関する意思決定が、技術部門だけで完結するものではないという前提のもと、組織内の幅広い関係者を想定して策定されています。

主な対象者としては、次のような部門や役割が挙げられます。

・全社的リスク管理(ERM)や内部監査を担う部門

・情報セキュリティ、プライバシー、コンプライアンス部門

・法務、調達、ベンダー管理部門

・事業部門の責任者やプロダクトオーナー

・経営層および取締役会などの監督機能

多くの組織においては、このように対象範囲が広く設計されている点が特に重要です。AIの導入は各部門が個別に進めることが多い一方で、ガバナンスは本社や管理部門に集約されているケースが少なくありません。その結果、現場での活用と全社的な統制の間にギャップが生じがちです。AI RMFは、非技術系の関係者も含めて共通の枠組みと言語でAIリスクを議論できるようにし、この分断を埋める役割を果たします。

また、海外で事業を展開する企業にとっても、有効な参照基準となります。多くの日本企業は、米国や欧州のパートナー、規制当局、顧客の期待を踏まえた内部統制の整備を求められています。AI RMFは、EU AI法のような拘束力のある規制に直ちに適合することを求めるものではありませんが、国際的に認知されたベースラインとして、自社のガバナンス体制を説明する際の共通基盤となり得ます。

(関連記事)

・EU AI法(EU AI Act)の概要と特徴の解説~日本企業が備えるべきこととは?~

・AIガバナンスの動向は?各国のAI法規制を概観

AI RMFはどのようなリスクを対象としているのか

AI RMFは、AIに関する判断や責任がエンジニアリング部門だけで完結するものではないという前提に立ち、組織内の幅広い立場の関係者を想定して策定されています。

NISTは本フレームワークにおいて、AI RMFの対象を業種や分野を問わず、AIシステムを設計・開発・導入・評価・利用するすべての組織と説明しています。対象はモデル開発者や技術専門職に限られません。むしろ、AIのライフサイクルに関与するあらゆる主体、すなわちガバナンス、監督、調達、リスク管理を担う立場も含めて活用されることを想定しています。

主な関係者としては、前述した部門や役割が挙げられます。

・全社的リスク管理(ERM)や内部監査を担う部門

・情報セキュリティ、プライバシー、コンプライアンス部門

・法務、調達、ベンダー管理部門

・事業部門の責任者やプロダクトオーナー

・経営層および取締役会などの監督機能

さらに重要なのは、AI RMFがリスクの性質そのものについて踏み込んでいる点です。NISTは、AIリスクを社会的要素と技術的要素が複雑に絡み合う「社会技術的」なものと位置づけています。リスクはモデルの構造や学習データだけに起因するのではなく、次のような要因からも生じます。

・組織文化や評価制度、インセンティブ設計

・人による監督体制や意思決定のプロセス

・導入環境や実際の利用状況

・AIシステムと経済・社会システムとの相互作用

こうした認識に基づき、AI RMFは部門横断的な関与を前提とする構造になっています。技術部門がリスクを経営やガバナンスの言葉で説明できるようにすると同時に、非技術系の関係者にもAIリスクを体系的に評価するための枠組みを提供します。

多くの組織にとって、この視点は特に重要です。

AIの導入は各部門が個別に進めることが多い一方で、ガバナンスや統制は本社や管理部門に集約されている場合が少なくありません。その結果、AI搭載のSaaSがリスク部門の十分な関与を経ないまま調達・導入されることもあります。AI RMFは、このような状況に対して、次のような整理の軸を示します。

・AIリスクに関する共通の用語と理解の確立

・部門間の役割と責任の明確化

・既存の全社的リスク管理との整合

・IT、コンプライアンス、事業部門の分断の緩和

また、AI RMFは国際的に事業を展開する組織も視野に入れています。NISTは、本フレームワークの適用が任意であり、柔軟に適用できることを明記しています。そのため、他の規制やガバナンス枠組みと併用しやすい設計となっています。

米国企業や多国籍企業、グローバルなテクノロジーベンダーと取引を行う日本企業にとって、AI RMFは国際的に認知された共通基盤として機能します。EU AI法のような拘束力のある規制に直ちに全面適合することなく、体系的なAIリスク管理を実践していることを示す枠組みとして活用できます。

この意味で、AI RMFの想定利用主体は、職種や肩書きによってではなく、責任の所在によって定義されます。

・AIシステムを構築する責任

・その導入を承認する責任

・運用上およびコンプライアンス上のリスクを管理する責任

・組織に対する信頼を維持する責任

AI RMFは、これらの責任を担うすべての立場に向けた枠組みといえるでしょう。

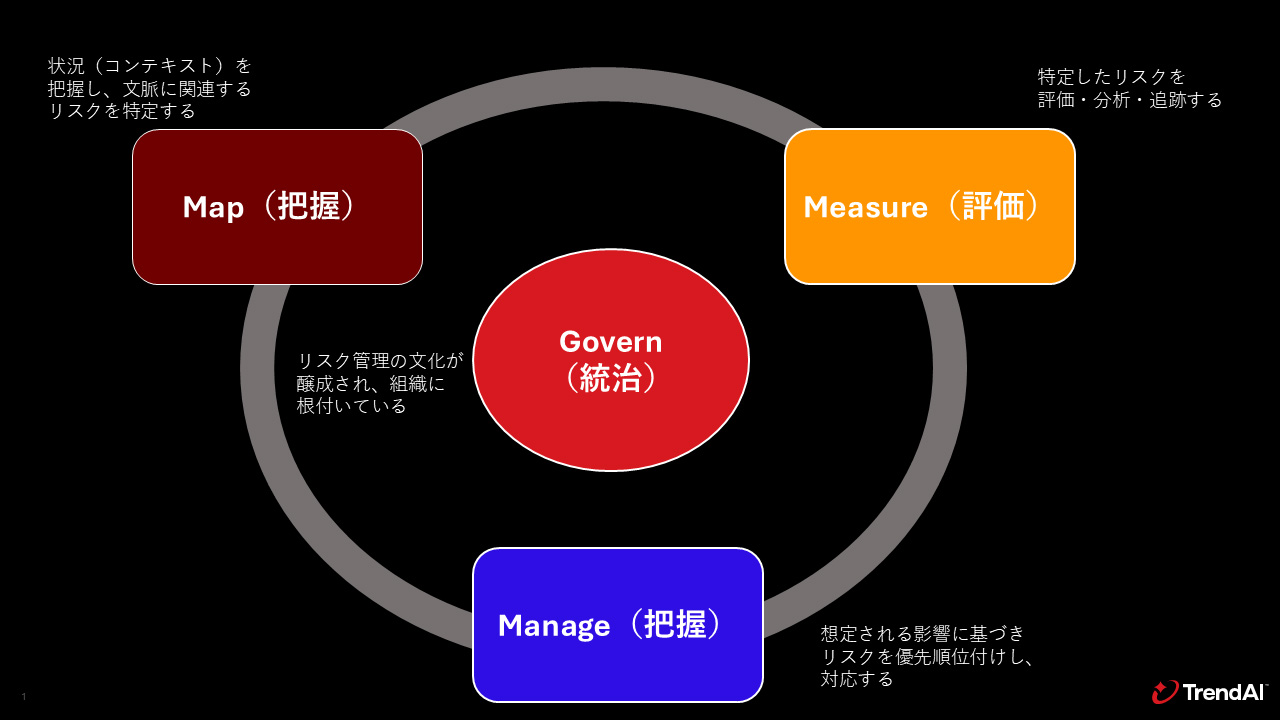

4つのコア機能

①Govern(統治):組織としての土台づくりに関わる領域です。AIに関する方針の整備、役割と責任の明確化、説明責任の確立、監督体制の構築などが含まれます。AIに関する判断が場当たり的に行われるのではなく、組織として意図的に検討され、記録され、責任の所在が明確なかたちで行われることを目指します。

②Map(把握):AIシステムを取り巻く文脈を整理し、その全体像を把握する段階です。想定される利用目的、影響を受けるステークホルダー、利用データの出所や性質、前提となる仮定などを明らかにします。このプロセスを通じて、見えにくかった依存関係や二次的な影響が浮かび上がることもあります。

③Measure(評価):特定されたリスクを、適切な手法で評価する領域です。AI RMFは、すべてのリスクが定量的に測定できるわけではないことを前提としています。不確実性そのものも管理すべき対象であり、数値化できないリスクについても、透明性を持って扱う姿勢が求められます。

④Manage(対応):把握・評価されたリスクにどのように対処するかを定める段階です。リスク低減策の実施、継続的なモニタリング、インシデント対応体制の整備に加え、必要に応じて利用制限、一時停止、あるいはシステムの廃止を判断することも含まれます。リスクが許容範囲を超える場合の意思決定も、ここに位置づけられます。

プロファイル(Profiles)

プロファイルは、組織が自らの状況を整理し、将来像を描くための実践的なツールです。具体的には、次の2点を明確にします。

・現在のAIリスク管理の水準や取り組み状況

・事業戦略やリスク許容度に照らした目標状態

特に大規模企業にとって、プロファイルは段階的な導入を進めるうえで有効です。最初から全社一律で包括的な実装を目指すのではなく、影響度や重要度の高いAIシステムから優先的に着手し、時間をかけてガバナンスの範囲と深度を広げていくことができます。

組織はAI RMFをどのように実務に活用できるか

実務においてAI RMFは、コンプライアンスのためのチェックリストとしてではなく、意思決定とガバナンスを支える枠組みとして活用することで、その真価を発揮します。特定の統制項目や技術基準を義務づけるものではありません。むしろ、既存の全社的リスク管理の仕組みの中で、AIに伴うリスクをどのように位置づけ、整理し、対応していくかを考えるための思考の土台を提供するものです。

この点は、日本の多くの組織にとって特に重要です。海外の規制モデルをそのまま取り入れることに慎重な企業も少なくありません。AI RMFは、特定の規制枠組みに直ちに適合することを前提とせずに、ガバナンスの水準を段階的に高めていくことを可能にします。

以下に、実務上すぐに活用できる代表的な場面を示します。

ベンダー評価・調達プロセスでの活用

現在、多くのAI機能は第三者のソフトウェアやクラウドサービス、業務プラットフォームに組み込まれた形で提供されています。しかし、モデルの設計や学習データの出所、監視体制、更新プロセスなどの詳細が十分に開示されているとは限りません。機能説明はあっても、リスク管理の実態が見えにくいケースもあります。

AI RMFは、こうした調達時の対話を構造化するための枠組みとして有効です。例えば、次のような観点で整理することができます。

・ベンダーはどのようなリスクを特定し、どのように評価しているのか

・導入後のモニタリングはどのように行われるのか

・モデルの更新はどのように統制・記録されているのか

・利用企業側に求められる人的監督は何か

これらを「Govern」「Map」「Measure」「Manage」の各コア機能に沿って確認することで、単なる機能比較ではなく、リスクを軸とした実質的な対話が可能になります。NISTの用語に馴染みのあるグローバルベンダーとの契約交渉においても、共通の枠組みとして活用できます。

部門間の認識をそろえるための活用

大企業では、AIの導入が部門ごとに進み、全体像が見えにくくなることがあります。事業部門が業務効率化を目的にAIツールを試験導入する一方で、リスク管理やコンプライアンス部門が十分に関与していないケースも見受けられます。

AI RMFは、部門横断で共有できる共通の言葉と構造を提供します。これにより、

・IT部門が技術的リスクを事業リスクの観点で説明する

・法務部門がAI活用と規制上の影響を結びつけて整理する

・コンプライアンス部門が既存の統制枠組みにAIを組み込む

・経営層が個別のシステムではなく、ポートフォリオ全体としてAIリスクを把握する

といった連携が可能になります。

このような部門横断的な整合は、組織内の分断を抑え、責任の所在が曖昧なままAIツールが導入される事態を防ぐうえでも重要です。AI RMFは、組織全体でリスクを可視化し、共有し、管理するための共通基盤として機能します。

ガバナンス成熟度の把握と向上

AI RMFにおける「プロファイル」の概念は、自社の現在のAIリスク管理の水準を整理し、リスク許容度や事業戦略に沿った将来像を描くための実践的な手段を提供します。

AIシステムが単に「あるガイドラインに準拠しているかどうか」を問うのではなく、企業は次のような観点から自らの体制を見直すことができます。

・AIの活用拡大に応じて、ガバナンス体制も適切に強化されているか

・モニタリングの内容や頻度が、システムの影響度に見合っているか

・責任の所在や意思決定プロセスが明確になっているか

・利用目的の変化に合わせて、リスク評価が継続的に更新されているか

このような整理は、段階的な導入を可能にします。影響の大きいシステムから優先的に体制を整備し、リスクの比較的小さい用途についてはそれに応じた水準で管理する、といった現実的な運用が可能になります。

規制動向を見据えた備え

AIを取り巻く規制環境は、各国・地域で急速に変化しています。日本では原則ベースのアプローチが採られていますが、EUのAI法や米国における政策動向は、国際的な期待水準を大きく左右しています。

AI RMFは、特定の規制枠組みに過度に依存することなく、将来的な規制強化に備えるための基盤となります。任意で柔軟に適用できる設計であるため、将来的には次のような枠組みとの整合にも活用できます。

・ EU AI法の要件

・米国の分野別AIガイダンス

・ 業界標準や各種認証制度

現段階からリスクの把握や文書化、ガバナンス体制の整備を進めておくことで、将来の規制対応を場当たり的に行うリスクを抑えることができます。

(関連記事)

・EU AI法(EU AI Act)の概要と特徴の解説~日本企業が備えるべきこととは?~

・NIS2指令:EUで事業を展開する日本企業が知っておくべきこと

・アメリカ「CIRCIA(サイバーインシデント報告に関する重要インフラ法)」の概要を理解する

慎重かつ持続的なAI導入を支える枠組み

日本企業は一般に、技術導入に際して慎重な姿勢をとり、長期的な信頼の維持を重視し、拙速な実験よりも安定性を優先する傾向があると言われています。AI RMFは、こうした姿勢と親和性の高い枠組みといえます。

本フレームワークは、組織に対して次のような視点で考えることを促します。

・AI導入を拡大する前に、その影響を丁寧に評価すること

・想定外の副次的影響や波及効果にも目を向けること

・意思決定における人の関与を維持すること

・AIリスクを固定的なものではなく、変化し続けるものとして捉えること

重要なのは、AI RMFがイノベーションを抑制するものではないという点です。むしろ、責任の所在を明確にし、構造化された監督体制を整えることで、安心して挑戦できる環境を整えます。その結果として、持続可能なかたちでのAI活用を後押しする枠組みとなります。

まとめ

NIST AIリスクマネジメントフレームワーク(AI RMF)は、技術仕様を示すマニュアルでも、法的義務を定める規制文書でもありません。AIに関する意思決定を組織としてどのように位置づけ、どのように責任を持って運用していくかを整理するためのガバナンスの枠組みととらえたほうが良いでしょう。

日本企業にとっての意義は、部門を越えて共有できる共通の言語を提供し、慎重で段階的なAI活用を支え、既存の全社的リスク管理の仕組みにAI監督を自然に組み込める点にあります。

AIが基幹業務や顧客接点に広く浸透していくなかで、もはや問うべきは「リスクがあるかどうか」ではありません。重要なのは、そのリスクを組織としてどれだけ体系的に把握し、継続的に管理できているかです。AI RMFは、そのための実務的な出発点となる枠組みといえるでしょう。

(参考文献)

・National Institute of Standards and Technology (NIST). (2023). Artificial Intelligence Risk Management Framework (AI RMF 1.0) (NIST AI 100-1). U.S. Department of Commerce.

・National Institute of Standards and Technology (NIST). (2023). AI Risk Management Framework Roadmap.

・National Institute of Standards and Technology (NIST). (2023). AI Risk Management Framework Overview.

(関連記事)

・「AI事業者ガイドライン」から読み解くAI利用時のセキュリティ対策

・EU AI法(EU AI Act)の概要と特徴の解説~日本企業が備えるべきこととは?~

・米カリフォルニア州のAI安全開示法(SB-53)を解説

・LLMとSLMは何が違う?AIの規模、制御、そしてリスク