Artificial Intelligence (AI)

TrendAIとNVIDIA OpenShellによる自律型AIエージェントのセキュリティ強化

TrendAIとNVIDIA OpenShellがどのように自律型AIエージェントのセキュリティを強化し、可視性と管理・統制力を高めた信頼性の高いエンタープライズAIシステムの構築を支援するのかをご紹介します。

エージェント型AIは、ソフトウェアシステムのあり方を急速に変えつつあります。従来のように単一のプロンプトに応答するのではなく、AIエージェントはタスクを計画し、ツールを呼び出し、自らの実行経路を変更しながら、継続的に動作できるようになりました。こうした変化は強力な新たなユースケースを生み出す一方で、企業にとってまったく新しいセキュリティおよびガバナンス上の課題をもたらします。エージェント型AIは実験段階から本番環境へと移行しつつあり、企業はこれまでにないスケールでの自律性に初めて直面しています。CISOやAIプラットフォームのリーダーにとって、これは新たなガバナンスの問題を意味します。

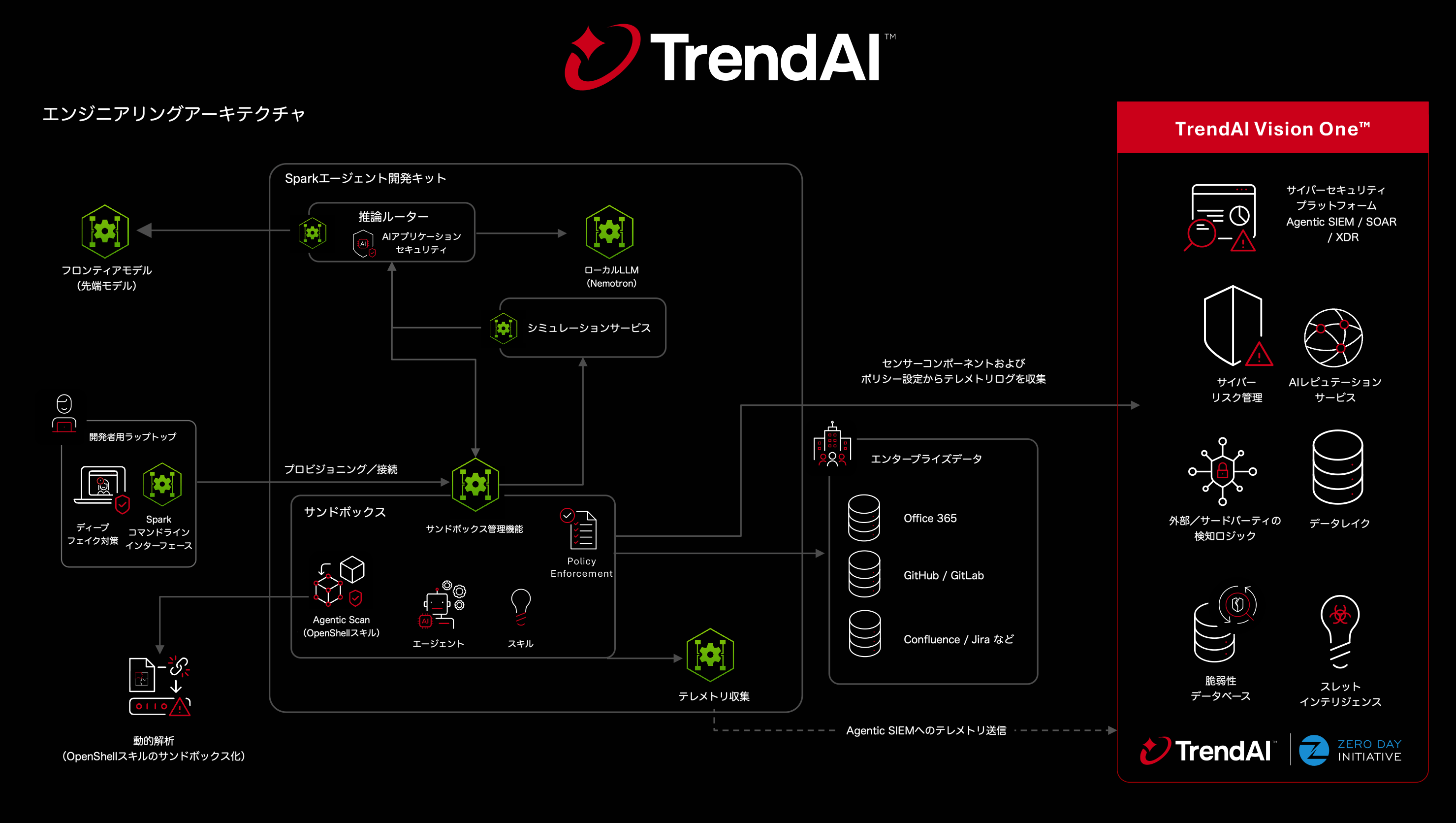

NVIDIA OpenShellは、計画機能、メモリ、ツール実行機能を備えたオープンソースのランタイムであり、自律的かつ自己進化型のエージェントをより安全に構築・展開することを可能にします。TrendAIはNVIDIAと連携し、OpenShellとの統合を通じて、エージェントのライフサイクル全体にガバナンス、リスクの可視化、ランタイムでの制御を組み込む取り組みを進めています。

両者は、現在エンタープライズAIのリーダーが直面している最も重要な問いの一つに取り組んでいます。すなわち、「管理・統制力、コンプライアンス、信頼性を損なうことなく、自律型AIエージェントをどのように安全に大規模展開するか」という課題です。

エージェント型AIがセキュリティモデルを変える理由

従来のAIセキュリティモデルは、ステートレスな相互作用を前提として構築されてきました。つまり、プロンプトが入力され、応答が出力されるという形です。エージェント型AIは、この前提を大きく覆します。

この新しい自己進化型エージェントは、次のような特性を持っています。

- 自律的なメモリとアイデンティティを持ち、長期間にわたって持続的に動作する

- ローカルおよび共有メモリを維持する

- ツールやスキルを動的に選択し、呼び出す

- 新たな機能を実現するためにコードを実行する

- ローカルおよび外部のさまざまなモデル間で推論をルーティングする

- サンドボックス化された実行環境

- ローカルメモリおよびファイルシステムの分離

- ツールやスキルの呼び出しにおける境界設定

- データプライバシーを考慮した、ローカルおよび外部推論間でのモデルルーティング

OpenShellは特定のセキュリティソリューションを提供するものではなく、エコシステムパートナーが企業向けユースケースに応じてセキュリティを拡張・強化するために設計されたオープンソースです。

この仕組みの中で重要な役割を果たすのがTrendAIです。

エージェントライフサイクル全体へのセキュリティの組み込み

TrendAIは、行動分析、サンドボックス技術、スレットインテリジェンス、ポリシー適用といった分野において長年にわたり培ってきた知見を、エージェント型AIに適用します。OpenShellにおいては、前述の各種専門知識が階層構造で実装され、実行前、実行中、そして実行後のすべての段階でエージェントを保護します。

1. エージェントが自律的に動作し始めると、ガバナンスは崩れやすい

企業の管理者は、TrendAI Vision One™を用いてAIのガバナンスおよびコンプライアンスポリシーを一元的に定義します。これらのポリシーはOpenShellランタイムに直接配布され、エージェントの動作がセキュリティ、コンプライアンス、データ取り扱いに関する組織の要件と整合するようにします。これにより、ガバナンスは単なる理論上のポリシー文書から、実行時に適用可能な制御へと移行します。

2. Agentic Scanによるスキルおよびツールのリスク可視化

エージェントの能力は、アクセス可能なスキルやツールの安全性に依存します。Agentic Scanは、以下を継続的にインベントリ化および分析します。

- エージェントのスキル

- Model Context Protocol(MCP)連携

- エージェント環境内で利用可能なツール定義

宣言されたスキルの挙動と実際の挙動を比較することで、欺瞞、危険、またはコンプライアンス非準拠の機能を、運用上のリスクとなる前に特定できます。

例えば、エージェントが未承認のMCPサービスを呼び出そうとしたり、定義された範囲外のツールにアクセスしようとした場合、静的なレビューでは見逃されがちな潜在的なリスクが発生します。

3. 動的な振る舞い分析

一部の脅威は、コードが実行されるまで明らかになりません。

TrendAIは、スキルやツールを隔離された環境で実行することで動的分析を行い、実行時の実際の挙動を観察します。具体的には、以下の観点で分析します。

- 潜在的な悪意ある動作

- 不正なシステムアクセス

- 異常なネットワークまたはファイルの活動

これにより、静的な検査を超えた高精度なリスクインテリジェンスを提供します。

4. 実行時のポリシー適用:セキュリティ制御は、エージェントが動作を試みるその瞬間に、インラインで適用されます。

ガバナンスポリシー、レピュテーションインテリジェンス、行動分析に基づき、OpenShell上のエージェントは以下のような動作を防止されます。

- 信頼されていないスキルの実行

- 制限されたツールの呼び出し

- コンプラインス非準拠の操作の実行

この制御は、承認されたワークフローを妨げることなく行われるため、イノベーションを維持しながら統制を確保できます。

5. AI特有の脅威への対策

エージェント型システムは、以下のようなAI特有の新たな攻撃をもたらします。

- プロンプトインジェクション

- 間接的なプロンプト操作

- 機密データの漏洩

TrendAI Vision One AI Application Security™プラグインは、プロンプト、応答、およびモデル間のやり取りを検査し、ローカルおよび外部推論の双方においてポリシーを適用します。

6. 継続的な監視と監査性

長期間稼働するエージェントには、継続的な監視が不可欠です。

エージェントの実行、ツールの使用状況、サンドボックス環境からのテレメトリはTrendAIのAgentic SIEMに集約され、以下を可能にします。

- リアルタイムの異常検知

- 実行後のフォレンジック分析

- コンプライアンスおよび監査レポート

これにより、企業は自律型システムを責任を持って運用するために必要な可視性を得ることができます。

7. 静的な信頼モデルは、進化し続けるエージェントエコシステムと脅威に対応できない

TrendAIのグローバルな脅威インテリジェンスは、以下を継続的にスコアリングします。

- スキル

- MCPサービス

- 関連する侵入の痕跡(Indicators of Compromise)

このインテリジェンスは、ガバナンスおよびポリシー適用の判断に直接反映され、脅威の進化に応じてセキュリティ態勢を適応させることを可能にします。

NVIDIA Agent Toolkitとの連携

OpenShellは単独で存在するものではありません。これはNVIDIAのより広範なエージェント型エコシステムの一部であり、NVIDIA AI-QやNVIDIA NeMo Agent Toolkitを含む**NVIDIA Agent Toolkitソフトウェア**とともに、大規模環境でのエージェントのオーケストレーション、オブザーバビリティ (可観測性) 、再利用を支援します。

TrendAIのセキュリティ統合はこれらのフレームワーク全体にわたって拡張されており、エージェント型アプリケーションが開発環境からエンタープライズ環境、さらにはAIファクトリーの展開へと移行する中で、一貫したガバナンスとリスク管理を実現します。

実験から本番運用へ

NVIDIAとTrendAIの連携は、企業がエージェント型AIを大規模に展開するための指針を示し、実験的な自律性からエンタープライズレベルのシステムへの移行を可能にします。

以下を組み合わせることで、

- NVIDIAソフトウェア(自律的かつ自己進化型エージェントのためのOpenShellランタイムを含む)

- TrendAIのガバナンス、行動分析、およびポリシー適用機能

企業は、制御性、信頼性、説明責任を損なうことなく自律型AIエージェントを導入するための、実践的かつスケーラブルな道筋を得ることができます。

エージェント型AIは、イノベーションかセキュリティかという二者択一である必要はありません。OpenShellとTrendAIを組み合わせることで、それはガバナンスされ、可視化され、実行時に制御可能な、エンタープライズ対応のプラットフォームへと進化します。

詳細はこちら

参考記事

Securing Autonomous AI Agents with TrendAI & NVIDIA OpenShell

By: Fernando Cardoso, King Cao, Truman Coburn, Bestin Koruthu

翻訳:与那城 務(Platform Marketing, Trend Micro™ Research)