AIセキュリティとは、組織がAIスタック(AIモデル、AIシステム、AIアプリケーション、AIインフラなど)を保護するために活用するセキュリティ対策、ツール、技術の総称です。また、AIを活用してサイバーセキュリティ体制を強化し、脆弱性の検出、相関分析、対応の迅速化を図ることで、セキュリティ運用を従来の「リアクティブ」から「プロアクティブ」へと進化させる取り組みも含まれます。

目次

「人工知能」(AI)とは、1950年代に登場し、人間の脳の構造や機能を模倣することで、複雑なタスクの実行、問題解決、将来予測、学習などを可能にするコンピュータや機械を指します。

AIセキュリティ(「人工知能セキュリティ」または「AIのためのセキュリティ」とも呼ばれる)は、AIシステムや関連するデータ、アプリケーションをサイバー攻撃から守るためのプロセスや技術的対策の総称を指します。AIセキュリティに含まれる主な取り組みは以下の通りです。

- エンドポイントからAIモデルまで、AIネットワーク全体を包括的に保護する

- AIモデルやAIを活用したアプリケーションを、サイバー攻撃や不正アクセスから守る

- セキュリティ上のギャップや脆弱性を早期に特定し、悪用される前に対策を講じる

- AIインフラやトレーニングデータを保護し、モデルの破損やデータ漏洩を防止する

- LLM(大規模言語モデル)や生成AI、機械学習パイプラインにおけるデータ品質と整合性を確保する

- AIの偏見(バイアス)、透明性、プライバシー、説明責任といった倫理的課題に対処する

- すべてのAI活用が、国内外の法令、企業ポリシー、業界規制に準拠していることを確認する

「AIセキュリティ」と「AIサイバーセキュリティ」の違いとは?

AIセキュリティとAIサイバーセキュリティは、似たような言葉に見えますが、目的や対象が異なる明確な違いがあります。

AIセキュリティ:AIそのものを守ることが目的。AIスタック全体(モデル、システム、ネットワークなど)の保護。

AIサイバーセキュリティ(「セキュリティのためのAI」とも):AI技術を活用して、ITインフラをサイバー攻撃から守ることが目的です。たとえば、AIを使って脅威を検出・分析・対応するなどが該当します。

- 大量のデータを分析し、パターンを抽出することで異常を検知し、潜在的なセキュリティリスクを可視化します。

- 組織のセキュリティに体制における脆弱性や抜け漏れをスキャンし、事前に対策を講じます。

- データ侵害やその他のサイバー攻撃をリアルタイムで検出・防御します。

- 脅威検出や対応ツールの自動化により、セキュリティチームの負担を軽減し、対応スピードと精度を向上させます。

- 最新の脅威インテリジェンスを活用し、攻撃者の一歩先を行く防御体制を構築。未知の攻撃にも迅速に対応します。

- 組織の脅威管理戦略を継続的に評価、改善し、セキュリティレベルを常に最新の状態に保ちます。

AIシステムのセキュリティ確保の重要性

人工知能(AI)という概念は数十年前から存在していますが、近年の技術革新により、運輸、医療、製造業、そしてサイバーセキュリティなど、さまざまな分野でAIが活用され、社会に大きな変革がもたらしています。一方で、AIの急速な普及は、悪意ある攻撃者によるAIの悪用の可能性を高め、サイバー攻撃の件数、対象範囲、そして攻撃手法の高度化が急速に進行しています。

こうした背景から、組織はAIに関連するデータの整合性、機密性、可用性を維持することが求められます。さらに、AIツールやアプリケーションを新たなサイバーリスクや攻撃から守るとともに、AIモデルやシステム、アルゴリズムを、日々進化する多様な脅威から継続的に保護するための対策を講じる必要があります。

もし、これらの脅威のいずれかからAIシステムを十分に守ることができなければ、組織は深刻なサイバー攻撃にさらされる可能性があり、顧客やパートナーの信頼を損なうだけでなく、修復費用の増加、身代金の要求、売上の損失や業務停止による生産性の低下など、最終的には数億円規模の損害につながる恐れがあります。

AIセキュリティにおけるリスク

人工知能(AI)はサイバーセキュリティの分野に革新をもたらす可能性があり、今後の活用が大いに期待されています。しかし、AIセキュリティ戦略を導入する際には、組織が注意すべき新たなリスクや課題も増えています。主なリスクは以下の通りです。

- アタックサーフェス(攻撃対象領域)の拡大

自社開発や外部提供のAIモデルをITインフラに統合することで、アタックサーフェス(攻撃対象領域)が広がり、脆弱性が増加。結果として、AIシステムがより高度かつ頻繁なサイバー攻撃にさらされる可能性があります。 - AIデータやアルゴリズムへの攻撃

攻撃者がAIツールやデータに不正アクセスし、アルゴリズムにバイアスや欠陥を意図的に挿入することで、予測精度や防御力が低下。操作・悪用・盗難のリスクが高まります。 - データの改ざん・汚染・操作

入力データを改ざんや偽のデータの挿入により、機械学習(ML)パイプラインが破壊され、AIモデルが汚染されることで、システム全体の安全性を損なわれる恐れがあります。 - AIトレーニングモデルへの攻撃

AIモデルの盗難、改ざん、リバースエンジニアリングに加え、トレーニングデータの破損・改ざんにより、モデルの精度や整合性が低下するリスクがあります。 - 偏見・差別・プライバシー・透明性の欠如

人為的ミスや攻撃によってAIモデルに偏りが生じたり、プライバシーが侵害されることで、透明性・公平性・説明責任といった倫理的原則が損なわれる可能性があります。 - 法令違反のリスクク

個人情報や機密データの保護が不十分な場合、GDPRなどの法規制に違反し、政府や業界の規制当局から罰則や制裁を受ける可能性があります。 - サードパーティへの攻撃

サプライチェーン上のAIシステムが標的となり、外部パートナーのネットワークやソフトウェアの脆弱性を悪用して、他のAIモデルにも攻撃が波及する恐れがあります。 - AIモデルのドリフトと劣化

時間の経過とともにモデルの精度や挙動が変化し、攻撃者がその変化を利用して信頼性や性能を低下させる可能性があります。 - チャットボットの認証情報の盗難

ChatGPTなどのAIサービスの認証情報が盗まれ、ダークウェブで売買されることで、攻撃者が不正アクセスするリスクがあります。 - ディープフェイクによる詐欺・恐喝

AIで生成された偽の画像や動画、音声が悪用され、従業員が騙されて機密情報を漏洩したり、重要なシステムへのアクセスを許してしまう危険性があります。 - プロンプトインジェクション攻撃

悪意あるコードにより、大規模言語モデル(LLM)などのAIツールが騙され、機密情報の漏洩や不正アクセス、データ削除などが発生する可能性があります。 - AIの「ハルシネーション」現象の悪用

AIが誤った情報を生成する「ハルシネーション」現象を攻撃者が利用し、AIモデルの判断データを意図的に操作されるリスクがあります。 - クラウド資産・インフラへの攻撃

クラウドベースのAIモデルがハッキングされ、データや資産が破壊・盗難される可能性があります。

組織がAIセキュリティやサイバーセキュリティ対策を、常に堅牢で包括的、かつ最新の状態に保っていない場合、悪意のある第三者によってこれらの脆弱性が突かれ、AIモデルの信頼性や有効性が損なわれる恐れがあります。その結果、機密情報や個人データが盗まれ、深刻な経済的損失や企業の評判に大きなダメージを与える可能性があります。

AIセキュリティのメリット

AIスタックの安全性を確保するためにAIセキュリティ対策を導入することで、組織は以下のような重要なメリットを得られます。

- AIデータの漏えい、破損、改ざん、侵害、盗難からの保護

- リアルタイムでの脅威検知・対応、脅威ハンティング、脆弱性スキャンなどのツールや技術を活用し、AIモデルをハッキングやサイバー攻撃から防御

- サイバー防御のギャップや脆弱性を排除し、リスクを管理・軽減することで、AI資産およびインフラの保護を実現

- 悪意のあるコード攻撃、不正アクセス、詐欺やフィッシング、マルウェアやランサムウェアなどから、AIユーザやローカルアプリケーションを保護

- 大規模言語モデル(LLM)を含む、AIサービスへのアクセスを適切に制御

- 未知のソフトウェアやハードウェアの脆弱性を狙ったゼロデイ攻撃への防御を強化し、データの窃取や機密情報の漏えい、マルウェアのインストール、ITインフラへの侵入を防止

AIセキュリティのベストプラクティス

効果的なAIセキュリティ対策は、以下のような業界標準のベストプラクティスを数多く取り入れることで、AIツールやリソースを保護し、セキュリティ体制を強化しています。これらのベストプラクティスには、以下のような取り組みが含まれます。

- 高度な脅威モデリングや脅威ハンティングを、AI主導のリスク評価機能、包括的な制御、詳細なインシデント対応計画・手順と組み合わせて、組織のAIシステムとデータを保護

- AIトレーニングデータの品質、整合性、信頼性を確保し、透明性、バイアス、説明可能性に関する課題に対応することで、AIモデルの精度と有効性を維持。

- 業界標準のAIセキュリティフレームワークを導入し、AIシステムの安全性を確保するための明確な基準とガイドラインを整備。AI防御におけるギャップや脆弱性を排除し、関連するすべてのAIセキュリティ規制への準拠を維持

例:米国国立標準技術研究所(NIST)のAIリスク管理フレームワーク、MITER ATLAS、OWASPのLLMベストプラクティス、GoogleのSecure AI Framework(SAIF)、ISO/IEC 27001など。 - AIセキュリティを既存のセキュリティおよびサイバーセキュリティ対策と統合し、すべてのAIおよびITアプリケーション、ツール、システム、ネットワークに対するサイバー攻撃からのシームレスなエンドツーエンドの保護を実現

- 定期的な従業員研修や意識向上プログラムを実施し、セキュリティチームおよび全社員の脅威認識と対策意識を高め、継続的な改善を促す企業文化を育成

- AIモデルを継続的に監視、評価、更新し、脆弱性の軽減、新たな脅威の特定、モデルとアプリケーションの改良を通じて、精度・パフォーマンス・信頼性向上を実現

AIサイバーセキュリティの活用例

AIツールの進化に伴い、サイバーセキュリティ分野におけるAI活用は急速に広がっています。

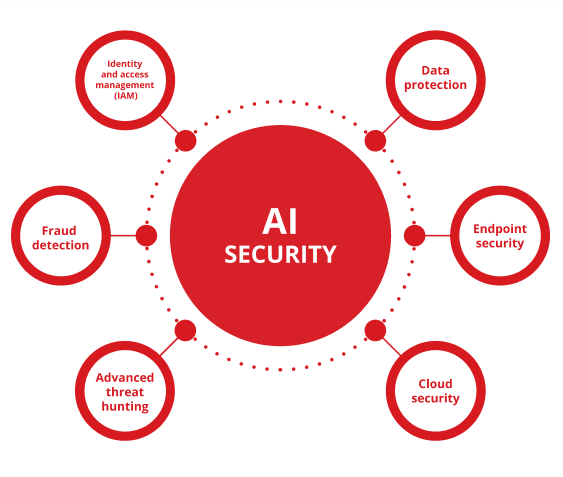

AIを活用したサイバーセキュリティアプリケーションは、脅威検知やインシデント対応の自動化、脆弱性スキャンなどのプロアクティブな対策の定期的・継続的な実施、最新の脅威インテリジェンスとセキュリティ分析による予測・予防を通じて、新たな脅威や進行中の攻撃から組織を守り、サイバーセキュリティ防御の範囲と有効性を大幅に向上させることが可能です。

特に効果的で広く採用されているAIサイバーセキュリティの用途としては、データ保護、エンドポイントセキュリティ、クラウドセキュリティ、高度な脅威ハンティング、不正行為の検出、アイデンティティ・アクセス管理(IAM)などが挙げられます。

- データ保護

AIを活用することで、機密情報やセンシティブなデータを分類・暗号化し、アクセス状況を常時監視することが可能になります。これにより、データ侵害を迅速かつ正確に検知できるほか、情報の紛失や破損を防ぎ、AIスタック全体を不正アクセス・不正使用・不正開示から守ることができます。ただし、AI環境におけるセンシティブ情報の見落としは、重大なデータ漏洩やコンプライアンス違反につながる恐れがあるため、脆弱性の事前把握と対策が不可欠です。

- エンドポイントセキュリティ

AI対応のEDR(Endpoint Detection and Response)ソリューションは、マルウェアやランサムウェアなどの脅威を事前に検知・遮断し、ノートPC、デスクトップ、サーバ、モバイルデバイスなど、あらゆるエンドポイントををリアルタイムで保護します。

- クラウドセキュリティ

AIを活用したクラウドセキュリティ技術は、クラウド環境へのアクセスを24時間体制で監視・制御し、異常な挙動や不審なアクティビティを即座に検知します。脅威が発生した際にはセキュリティチームにアラートを発信し、クラウド上のデータやアプリケーションを不正アクセスや情報漏洩から守ります。

- 高度な脅威ハンティング

AIによる脅威ハンティングツールは、ログデータやネットワークトラフィック、ユーザの行動パターンを高速かつ効率的に分析し、悪意ある攻撃を早期に発見します。これにより、APT(高度な持続的脅威)などの深刻な攻撃からAIシステムやインフラを保護できます。

- 不正検出

金融業界では、機械学習やニューラルネットワークを活用して、不正の可能性がある取引やアクティビティを検知し、オンラインアカウントへの不正アクセスを防止しています。これにより、個人情報の盗難や詐欺行為のリスクを大幅に軽減できます。

- アイデンティティおよびアクセス管理(IAM)

AI対応のIAMソリューションは、認証・承認・アクセス管理の各プロセスを監視・保護し、組織のポリシーや業界規制に準拠した運用を支援します。これにより、機密データへの不正アクセスを防ぎ、外部からの侵入を阻止します。

AIセキュリティに関するサポートはどこで受けられるか?

Trend Vision One™ は、AIを活用しサイバーセキュリティに特化した、オールインワンの統合プラットフォームです。

これまで人の手で行っていたセキュリティ運用に比べて、AIによって脅威の検知・予測・防御をより速く、より正確に行うことができます。

このプラットフォームでは、AIの活用が進む中で生じる新たなリスクにも対応できるよう、AI環境全体を守るためのさまざまな機能が備わっています。たとえば、社内で使われているシャドーAI(非公式に導入されたAIツール)の状況を可視化したり、コンプライアンスを守るための厳格なアクセス制御を行ったり、AI APIの不正利用やモデルの改ざん(モデルポイズニング)を防ぐための仕組みも整っています。

さらに、Trend Vision Oneには「Trend Cybertron」という革新的なAIセキュリティエンジンが搭載されています。これは、トレンドマイクロが20年以上にわたって蓄積してきた知見をもとに開発されたもので、独自の大規模言語モデル(LLM)やデータセット、高度なAIエージェントを活用し、過去の攻撃パターンを分析。組織ごとのリスクに応じて、今後起こり得る脅威を予測します。

このような予測型のアプローチにより、従来のインシデント対応と比べて最大99%も早く復旧できるようになり、セキュリティ運用は「リアクティブ」から「プロアクティブ」へと大きく進化します。

Trend Cybertronは、組織のニーズの変化に対応し、サイバー犯罪者が用いる最新の戦術、手法、手順(TTP)を把握するために、継続的に進化し、適応するように設計されています。これにより、組織のAIセキュリティ体制を常に強固で最新の状態に保ちます。