AIの新たな潮流~1,000億パラメータの巨大モデルは「足かせ」になりつつある

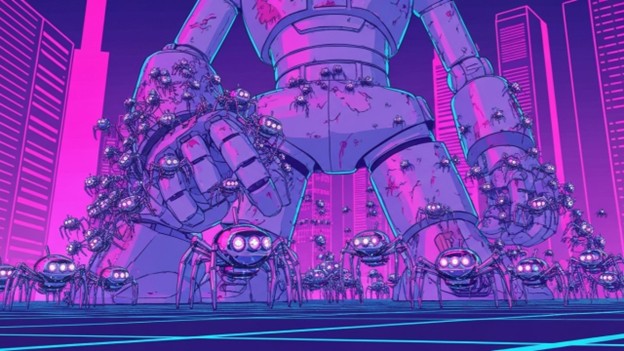

AIにおける「swarm」という言葉をご存じでしょうか?「小さきもの」が「巨人」を倒す、新たなAIの潮流を専門家が解説します。

AIにおける「大きければ大きいほど良い」という時代は、いま明確に壁に突き当たっています。私たちはLLMバブルの只中にいます。推論コストは破壊的な水準まで膨らみ、得られる性能向上は次第に見合わなくなっています。

これが現実です。これから主役になるのは、特化した小規模言語モデル(SLM)を中核に据えたエージェント型AIです。発想としては、ひとりの高給取りの天才を雇うのではなく、きわめて効率的に設計されたデジタル工場を回すようなものだと考えると分かりやすいでしょう。コストは下がり、処理は速くなり、そして率直に言えば、エージェントを本当にスケールさせるためには、これ以外の道はほとんど残されていないのです。

(関連記事)

・LLMとSLMは何が違う?AIの規模、制御、そしてリスク

・Agentic AIとは?汎用人工知能(Artificial General Intelligence)へのマイルストーン

この5年間、テック業界はひとつの仮説に酔い続けてきました。スケールこそがすべてだ、という仮説です。私たちは、まるで小さな国のGDPに匹敵するかのようなパラメータ数を持つ巨大な大規模言語モデル(LLM)を作り上げ、GPUを追加しさえすれば神が生まれると、本気で信じていました。

しかし、そうはなりませんでした。生まれたのは、非常に高価で、非常に見栄えのするテキスト生成器です。そしてそれは、実際のビジネスワークフローに当てはめると、経済的にはほとんど破綻している代物でもありました。

2025年後半に差しかかり、その酔いはようやく醒め始めていました。Hugging FaceのCEOであるクレマン・ドゥランゲは、これを「LLMバブル」と呼んでいます。それはAIそのものへの懐疑ではありません。問題にされているのは、巨大で汎用的なモデルに、安易になされてきた浅薄な評価の仕方です。市場は近く自己修正に入り、「ラッパー」に過ぎないスタートアップをふるい落とし、地味ではあるものの、きちんと利益を生む方向、つまり効率へと軸足を移すことになるでしょう。

「現実的に見れば、これから数か月、数年のうちに、よりカスタマイズされ、より特化したモデルが数多く現れてきて、それぞれが異なる課題を解決するようになると思います」

未来は、ひとつの全知全能モデルに集約されるものではありません。数え切れないほどの、小さく、目的に特化したモデルが並び立つ世界へと向かっているのです。

いまのパラダイムが抱える中核的な非効率性は、ここにあります。あらゆるタスクにGPT-5※クラスのモデルを使うというのは、ノーベル賞を受賞した物理学者を雇って、データ入力をさせるようなものです。

※GPT-5:OpenAIが2025年8月に公開したAIモデル。

確かに、それはできるかもしれません。しかも、どこか洗練されたやり方でやってくれるかもしれない。けれども実際に支払っているのは、年収50万ドルの給料で、Excelの行をコピー&ペーストしてもらう、という構図なのです。

私は、開発者やセキュリティチームにも、いつもそのまま伝えています。

「最先端モデルに『申し訳ありませんが、そのご要望にはお応えできません』という定型文を返させるために、そしてアプリを探ってくるサイバー攻撃者相手に、いったいいくらのお金を溶かしているのですか」と。

これがいわゆる「モノリシックの誤謬※」です。ひとつのモデルが、詩を書き、Pythonコードを書き、病気を診断し、JSONを解析すべきだと、私たちは思い込んできました。しかし現実の世界では、汎用性よりも専門性が勝ちます。しかも今では、それが正しいことを示す決定的な証拠まで揃っているのです。

※モノリシックの誤謬:システム開発におけるモノリシック(単一の)システムのデメリットを指す言葉。巨大なシステムほど開発・改修に時間がかかる、デプロイ時に全体に及ぼす影響が大きい、新技術の導入が手軽にできない、などが挙げられることが多い。

(関連記事)

セキュリティ運用におけるAI活用のポイント

モントリオールにあるSamsung AI Labによる最新の研究は、「スケールさえ大きければ十分だ」というドグマを根底から打ち砕きました。彼らが開発したTiny Recursive Model(TRM)は、わずか700万パラメータ※という小ささにもかかわらず、機械を出し抜くために設計されたベンチマークであるAbstract and Reasoning Corpus(ARC-AGI)において、世界最高峰のLLMのいくつかを上回る性能を示したのです。

※代表的なLLMのパラメータ数では、GPT-3.5Turbo(1,750億)、GPT4(1.76兆)、LLaMA3405B(4,050億)などがある。

この比率を少し考えてみてください。最先端LLMより1万分の1の規模しかないモデルが、純粋な論理の課題でそれを打ち負かしている。

研究者のアレクシア・ジョリクール=マルティノーは、難しい問題を解けるのは数百万ドル規模のモデルだけだという考え方を「罠」だと呼びます。彼女のモデルは暗記しません。結果を一度で出すのではなく、最大16回にわたって自分の答えを再帰的に見直し、修正しながら最終的な出力にたどり着きます。ここで示されているのは、推論とは兆単位のパラメータから偶然生まれる魔法ではなく、力任せではなくアーキテクチャによって解ける、れっきとしたエンジニアリングの問題だという事実です。

この違いは、エージェント型AIにとって決定的に重要です。入力を待つだけのチャットボットとは異なり、エージェントは実際に動きます。ワークフローを実行します。ひとつのエージェントループの中で、データベースへの問い合わせ、スキーマの解析、コードの記述、テスト、出力の整形といった内部ステップが100回走ることも珍しくありません。

もしその100ステップのひとつひとつに、推論コストとして0.03ドルかかるとしたら、そのエージェントは生産性向上ツールではなく、ベンチャーキャピタルを燃やし続ける炉です。エージェントを本当に実用的なものにするには、ノーベル賞受賞者を一人雇う発想を捨て、効率的に働く千人のインターンに置き換える必要があるのです。

NVIDIAのリサーチャーたちは、最近この転換を実に的確に言語化しました。彼らが描くのは、知能が巨大なスケールから切り離された「デジタル・ファクトリー」という構想です。

このアーキテクチャにおいて、SLMは労働者です。特定の作業に特化し、容赦がなく、そして安価です。あるモデルはSQLを書くことしかやりません。別のモデルはJSONを整形するだけです。さらに別のモデルは、法律文書を要約することだけに集中します。こうしたモデル群が、全体の90%を占める仕事、つまりデジタル経済におけるブルーカラー的な作業を黙々と処理していきます。

では巨大なLLMはどうなるのか。彼らはコンサルタントになります。現場の労働者が行き詰まったときや、高度で俯瞰的な戦略立案が必要なときにだけ呼び出される存在です。そして入口には「ルーター」が座り、すべてのリクエストを分析して、こう判断します。

「これは時給100ドルの天才が必要か、それとも時給0.01ドルの専門家で十分か」。

これは机上の空論ではありません。オーストラリアのコモンウェルス銀行(CBA)は、すでにこれを実践しています。彼らは「Bank-GPT」を作ろうとはしませんでした。その代わりに、給与明細の読み取りや不正検知といった個別タスクのために、1,000を超える特化型モデルを展開したのです。その結果はどうだったか。詐欺による損失を70%削減しました。最先端LLMを背後に置いた汎用チャットボットで、同じROI(費用対効果)を叩き出すことができるでしょうか。

この専門化へのシフトは、新しい市場構造を生み出しつつあります。それがエージェント交換市場(Agent Exchange)です。

ガートナーは、2028年までにB2B支出のうち15兆ドル分が、AIエージェントを介して仲介されるようになると予測しています。これは、ひとつの巨大で一枚岩のモデルによって実現するものではありません。特定の能力が並ぶ市場、つまり「知能のためのApp Store」を通じて起こります。そこでは「AIそのもの」を買うのではなく、必要な機能だけを借りる、という形になります。

これを現実のものにしている技術は、すでに二つあります。

1.接続の標準(MCP):

Anthropicをはじめとする企業が推進するModel Context Protocol(MCP)は、エージェントの世界における事実上の「USB-C」です。エージェントがGoogle DriveやSlackのようなデータやツールにどう接続するかを標準化します。これによって、統合作業そのものがコモディティ化されます。もはや「Outlookにつながる法務エージェント」を個別に作る必要はありません。「法務エージェント」を作り、既存の「Outlook用MCPサーバ」に差し込めば済むのです。

2.モジュール化されたスキル(LoRA Hubs: Low-Rank Adaptation Hubs):

これは理論の話ではありません。AI企業のPredibaseは、単一のGPU上で数千の微調整アダプタを同時に提供できるフレームワーク、LoRAX(LoRA: Low-Rank Adaptation Exchange)をオープンソース化しました。同様に、AI企業のTogether AIも、特定のアダプタで使ったトークン分だけを支払えばよい、サーバレスのマルチLoRAエンドポイントを立ち上げています。この基盤があれば、エージェントは「Pythonコーディング」用のアダプタを読み込んでスクリプトを書き、次の瞬間には「セキュリティ監査」用のアダプタに切り替えてチェックを行う、といったことが可能になります。それも、専用インスタンスを立てる場合と比べて、わずかなコストで済むのです。

こうして、スキルそのものが流動性を持つ市場が生まれます。たとえば物流会社が、通関処理のために自前でモデルを訓練することはありません。法律事務所が提供する「通関用LoRA」を1回0.001ドルで借り、サプライチェーンのエージェント群に組み込んで処理を実行するだけです。市場は、巨大なモデルを売る世界から、特化され、相互運用可能な「労働者」を売る世界へと、確実に移行しつつあります。

ここには、ほとんど倫理の領域に踏み込んでいると言っていい、哲学的な議論があります。NVIDIAの論文「Small Language Models are the Future of Agentic AI」は、いわゆる「ヒューム的な道徳的要請(Humean moral ought)」を提示しています。要するに、より少ないエネルギーと計算資源でタスクを遂行できるのであれば、そうすべきである、という考え方です。

「最終的に、LLM中心のパラダイムからSLMファーストのアーキテクチャへと移行することは、多くの人にとって単なる技術的な洗練にとどまらず、ヒューム的な意味での道徳的要請をも意味する」

1,750億パラメータのモデルを回して、100語程度のメールを要約する。これは計算資源の暴食と言って良いかもしれません。今後、エネルギーを浪費し、電力網に負荷をかけ、そしてそのインフラを維持できるごく少数のハイパースケーラーに、権力をさらに集中させる行為と見なされるかもしれません。

SLMは、この力の集中を解きほぐします。Llama 3.2(1B)のようなモデルは、スマートフォン上で動かすことができます。知能はクラウドからエッジへと移り、プライバシーの問題は一夜にして解消されます。たとえば「ヘルスコーチ」エージェントが、利用者の生体データを腕時計の上で解析し、その機微な情報が一切、手首の外に出ることはありません。これは単なる効率化ではありません、主権の回復です。

この分散的なアプローチに対して、よくある批判が「セキュリティ」に関するものです。「モデルが増えれば、攻撃ベクトルも増えるではないか」というわけです。

それは違います。

モノリシックなモデルは、単一障害点そのものです。「全知全能のモデル」を一度でもジェイルブレイクされれば、システム全体を掌握されたも同然です。一方で、異種混在のシステムでは「区画化(コンパートメント化)」が成立します。「公開チャット」エージェントは、「取引実行」エージェントから物理的に分離できます。さらに、セキュリティを集約したいのであれば、制御が収束する場所はすでに明らかです。KongやLiteLLMのようなAPIゲートウェイが、その検問所になります。

加えて、SalesforceのxLAMのような特化型のアクションモデル(LAM)は、意図的に「退屈」に訓練されています。出力は厳格なJSON構造に限定される。攻撃者がマルウェアを生成させようとプロンプトを注入しても、スキーマ検証に合わなければ、その時点で弾かれます。これは構文レベルのファイアウォールであり、饒舌で親切なLLMよりも、はるかに突破しにくい防御なのです。

ガートナーは、2027年までにエージェント型AIプロジェクトの40%が、コストの重さと価値の不明確さによって失敗に終わると予測しています。その見立ては正しいでしょう。失敗するのは、過去の延長線上にある力任せのスケーリングに依存したプロジェクトです。

一方で、成功するのは、スウォーム(swarm)※を構築したプロジェクトでしょう。

私たちはいま、スーパーエージェンシーの時代に入りつつあります。特化したSLM群が生み出す集合知が、どんな巨大な単一モデルよりも高い力を発揮する世界です。汎用主義の終わりであり、専門性の台頭です。

だから、神を作ろうとするのはもうやめましょう。工場を作るのです。ロマンは薄いかもしれませんが、実際に利益を生むのはこちらです。

※swarm:「群れ」や「集団」のこと。AIの世界では、軽量なエージェント同士が連携して動く仕組みのことを言う。OpenAIは、「Swarm」という名称でマルチエージェント連携のための教育フレームワークを公開している。

(参考資料)

・Hugging Face CEO says we're in an 'LLM bubble,' not an AI bubble | TechCrunch

・‘Tiny’ AI model beats massive LLMs at logic test

・How Small Language Models Are Key to Scalable Agentic AI | NVIDIA Technical Blog

・Small Language Models are the Future of Agentic AI

・CBA Use Case | H2O.ai

・Introducing the Model Context Protocol | Anthropic

・Strategic Predictions for 2026: How AI’s Underestimated Influence Is Reshaping Business

・TGI Multi-LoRA: Deploy Once, Serve 30 Models

・Autonomous agents are the future of AI at work – here’s why

・Gartner Predicts Over 40% of Agentic AI Projects Will Be Canceled by End of 2027

・AI in the workplace: A report for 2025 | McKinsey

本記事は2025年1月16日にUSで公開された記事「Your 100 Billion Parameter Behemoth is a Liability」を抄訳・編集したものです。

Fernando Tucci

Trend Micro

Senior Product Manager, AI Security

Trend Micro のシニアプロダクトマネージャーおよび AI セキュリティエバンジェリスト。入社以来、従来のサイバーセキュリティ分野と AI 時代のサイバーリスクの認識の隙間を埋めることに尽力。アプリケーション開発、ネットワーク、仮想化の分野での経験を活かし、ランタイム環境とサプライチェーンのセキュア化を専門とし、特にエージェント型システムが持つ固有の脆弱性の研究に注力してきた。現在、特に、次世代のインテリジェントアプリケーションを守るための堅牢で信頼性の高いゼロトラストフレームワークについて、継続的に研究・推進を行っている。