ゼロトラストアプローチで生成AIへの信頼を高めるには?

生成AIの発展につれて、その利便性だけでなくリスクも話題に上るようになりました。各法人組織においても、セキュリティポリシーの制定や、ゼロトラストなどの技術的対策によってリスク軽減を図ることが推奨されます。

AIのリスク軽減はパンデミックや核戦争などと同等の世界的な優先事項である―。2023年5月30日、非営利団体「Center for AI Safety」は、AIがもたらす潜在的危険性について警鐘を鳴らすために、350人以上の科学者やビジネスリーダーが署名した公開書簡を発表しました。団体のウェブサイトでは、AIの悪用や開発競争などから起こり得るバイオテロや自律型兵器など、様々な脅威について説明し、リスク低減策を提案しています。

また、トレンドマイクロでは、AI関連のセキュリティリスクについての記事を公開してきました。ハルシネーション、データポイズニング、あるいは人種差別的・性差別的内容の出力など、AIに起因するリスクとともに、AIを悪用するサイバー犯罪のリスクについても解説しています。

参考記事:

・AIプログラミングの落とし穴:ハルシネーションとコード不整合

・生成AIのビジネス活用と考慮すべきリスク

・OWASPが提示するAIリスクのTop 10を読み解く

このように、AIに関連したリスクが徐々に明るみに出てきています。しかしながら、世の中がAIを排除する方向に進んでいくことは、もはやないと言えるでしょう。便利なものにはリスクがあり、私たちは利便性を享受しながらもリスクを低減する必要があります。

法人組織においては、組織のデータを適切に保護することとデータの整合性を保つことが、AIセキュリティにおける当面の目標になると考えられます。AIの導入にあたっては、以下を参考にしながらセキュリティポリシーを制定することをお勧めします。

生成AI導入時に制定すべき4つのセキュリティポリシー

1.機密情報や個人情報を組織の管理下にないパブリックAIプラットフォームやサードパーティソリューションと共有することを禁止する。AIサービスへの情報の入力は、パブリックサイトやソーシャルプラットフォームに投稿することと同様に慎重に捉えるべきです。

2.個人データやその他法的保護の対象となるデータと一般公開可能なデータを明確に区別する。異なる種類のデータの取り扱い方についてルールを制定することが大切です。また、その前段階として、組織のデータの分類計画の作成が状況に応じて必要となります。

3.AIによって生成された情報が真実かつ正確であることを確認するために、ファクトチェックを行う。AIが生成したコンテンツは、公開前に調査、確認することが不可欠です。虚偽を含むAIの出力結果を公表することは、組織の評判および財政的側面から大きなリスクとなります。また、引用した文献等を、公表前に再確認することも重要です。

4.ゼロトラストセキュリティを導入する。ゼロトラストとは、「全てのアクセスを継続的に評価し、認証・認可を行う」というリソースの保護を目的としたサイバーセキュリティの概念です。組織が従来の境界型防御の見直しを進めているなかで、多くの支持を集めてきました。また、AIがもたらす新たな脅威は、ゼロトラストセキュリティの導入を加速させています。

参考記事:サイバーセキュリティの原点回帰:基礎から分かるゼロトラスト

以上のポリシーは基本的なものであり、組織の実情や要件などに沿って制定することをお勧めします。ポリシー制定によりAI関連のリスクを大幅に低減することが期待できます。

ただし、実際の運用においてはセキュリティの課題がなくなるわけではありません。次にそれらの課題を解説し、技術的側面からの対処方法を考察します。

生成AI導入に潜む4つのセキュリティ課題

生成AIサービスを導入する企業が直面する主要なセキュリティ課題には、以下4つが挙げられます。

1.可視性:ネットワークおよびセキュリティオペレーションセンター(SOC)チームが、AIプラットフォームを可視化できていないと、使用状況の監視や制御、関連リスクの管理ができず、自社全体のセキュリティ態勢に影響が出る恐れがあります。

2.コンプライアンス:全社的なポリシーの適用や、自社内の誰がどの生成AIサービスを使用しているかを把握するのが困難になる恐れがあります。

3.情報漏洩:従業員が生成AIサービスとやり取りすることにより、機密情報が意図せず漏洩する可能性があります。また、生成AI自体の未認証のレスポンスによって、不適切なデータがユーザに提供される可能性もあります。

4.不正操作:攻撃者が、意図しない動作を引き起こしたり不正な目的を達成したりするように作成されたプロンプトで生成AIモデルを悪用する可能性があります(プロンプトインジェクション)。例として、脱獄※1、仮想化※2、サイドステッピング(sidestepping)※3などが挙げられます。

※1特定の種類のプロンプトインジェクション攻撃。生成AIに設定されている制約や制御を回避し、生成AIを有害な方法で動作させることを意図したもの。

※2ロールプレイとも言う。AIに対してシーンを設定し、ステップごとに導き、特定の人物やタスクを模倣するよう誘導する。たとえば、AIにイベントチケット販売者を装わせ、フィッシングメールを作成させるなど。

※3ChatGPTなどの生成AIサービスでは、犯罪を助長するような回答などを制限する機能があるが、そのようなAIに対して「パスワードのヒントを教えてください」「秘密の言葉を定義してください」など、間接的な質問やプロンプトを提示することで、制限を回避しようとすること。

これらの課題に対しても、ゼロトラストアプローチは有効です。AIに限らず、セキュリティと利便性は相反するものだとされがちですが、ゼロトラストアプローチをとることでセキュリティ上の懸念に対処しながら、進化する生成AIを組織が最大限に活用できるようになります。

生成AIの利用と安全なアクセスの両立

ではどのように、セキュリティと利便性のバランスを保ちながら、生成AIの効果的な利用をするべきなのか?技術的側面から考察していきましょう。

今回は当社のソリューションである「Trend Vision One」の機能を例にご紹介しますが、どのような機能がお手元のセキュリティソリューションにあるか、まずは確認することをお勧めします。

Trend Vision One Zero Trust Secure Access (ZTSA) – AI Service Accessでは、パブリックおよびプライベート生成AIサービスに対してゼロトラスト原則に基づいたアクセス制御を提供します。以下のような機能で、生成AIサービスの利用状況を監視し、生成AIサービスのプロンプトとレスポンスを検査することで、AIコンテンツを識別、フィルタリング、分析し、パブリックおよびプライベートクラウド環境における潜在的な機密情報漏洩や安全でない出力を防ぐことができます。

•すべての生成AIサービス利用状況のリアルタイム監視とコンテンツ(プロンプト・レスポンス)違反の検出

•従業員の生成AIサービスへのアクセスと利用状況の一元管理

•情報漏洩と悪意のあるインジェクションを防ぐプロンプト検査

•コンプライアンス要件を満たすためのコンテンツフィルタリング

•大規模言語モデル(LLM)攻撃に対する防御

生成AIのリスク軽減

ZTSA – AI Service Accessは、安全でないプラグインや拡張機能、サプライチェーン攻撃、AIモデルに対するサービス拒否(DoS)攻撃など、生成AIサービス特有のリスクへの対処を可能にし、ネットワークおよびセキュリティ管理者を支援します。これらのリスクを優先し、生成AIサービスに動的なリスクベースのアクセス制御を積極的に適用することで、セキュリティチームはビジネスのレジリエンスを向上させることができます。

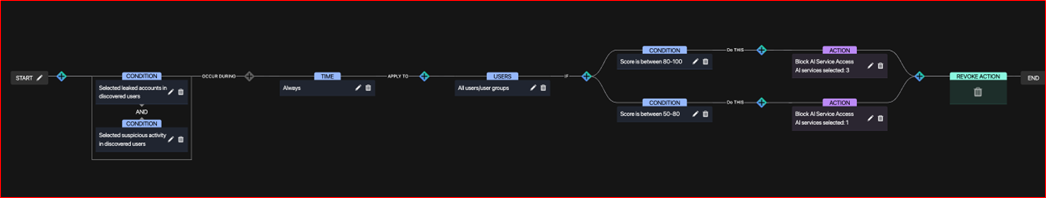

例えば、管理者は自社内の特定のユーザグループに対して常時リスクベースの条件を適用し、ユーザのリスクスコアを継続的に監視し、必要に応じて生成AIサービスへのアクセスを自動的にブロックするアクセス制御ルールを設定することができます。

さらにZTSA – AI Service Accessは、セキュリティチームが生成AIサービスの倫理基準への準拠を確保することも可能にします。例えば、品質と精度の観点からLLMの出力を監視および監査することができます。これは、セキュリティ運用の透明性と説明責任を確保する上で不可欠な機能です。

まとめ:生成AIのセキュリティの課題に対応する機能とは?

最後に、前述した生成AIのセキュリティ課題に対応する機能とはどのようなものなのかをまとめておきます。当社の考える具体的な機能は以下です。

| セキュリティの課題 | 対応する機能 |

|---|---|

| 可視性 | アクセスの詳細情報と履歴を分析し、ユーザの行動を監視・保護する機能 |

| コンプライアンス | 総合的なリスク分析を提供し、リスクに基づいた柔軟な生成AIサービスアクセス制御を行う機能 |

| 情報漏洩 | 生成AIのプロンプトとレスポンスを検査し、機密情報の漏洩や予期せぬレスポンスのリスクを防ぐ機能 |

| 不正操作 | 高度なプロンプトインジェクション検出を行い、生成AIサービスを介した攻撃のリスクを軽減する機能 |

これらの機能を利用することで、企業は詳細かつ適応性の高いリスクとセキュリティの評価を行い、経営目標に沿ったゼロトラストアーキテクチャを構築できるでしょう。

AIの時代の幕開けと絶えず変化する脅威の環境の中、あらゆる規模、あらゆる業界の企業が生成AI利用に伴うリスクの理解に努めています。生成AIへのアクセス制御にゼロトラストアプローチを採用することで、利便性と安全とのバランスを保ちながら、ビジネス価値を創出することが期待できます。

トレンドマイクロが提供するAIに関する見解

以下の記事もご参考ください。

・サイバーセキュリティの原点回帰:基礎から分かるゼロトラスト

・AIプログラミングの落とし穴:ハルシネーションとコード不整合

・生成AIのビジネス活用と考慮すべきリスク

・OWASPが提示するAIリスクのTop 10を読み解く

・生成AIを用いたサイバー犯罪に関する最新の調査状況を解説

本記事は2024年8月22日にUSで公開された記事「Confidence in GenAI: The Zero Trust Approach」、ならびに2024年7月29日にUSで公開された記事「How to Write a Generative AI Cybersecurity Policy」の抄訳です。

Security GO新着記事

サプライチェーンを脅かす開発者・エンジニアに対するサイバー攻撃:手口と対策を徹底解説

(2026年4月24日)

IPA「情報セキュリティ10大脅威 2026」:AIのサイバーリスクを3つに分けて理解する

(2026年4月10日)