Cyberbezpieczeństwo oparte na sztucznej inteligencji to proaktywne podejście, które wykorzystuje sztuczną inteligencję (AI) do eliminowania martwych punktów w zabezpieczeniach, prewencyjnego przewidywania i zapobiegania atakom oraz przekształcania wydajności operacji bezpieczeństwa w całym cyfrowym majątku organizacji.

Spis treści

AI i Cyberbezpieczeństwo

Sztuczna inteligencja (AI) to szeroki termin używany do opisania maszyn lub komputerów, które wykorzystują algorytmy uczenia maszynowego (ML), sieci neuronowe i inne zaawansowane technologie do symulacji działania ludzkiego mózgu. Maszyny te naśladują ludzkie zdolności poznawcze do planowania, rozumowania, rozwiązywania problemów, wykonywania skomplikowanych zadań i uczenia się na podstawie doświadczeń.

Pomysł wykorzystania sztucznej inteligencji do wzmocnienia cyberbezpieczeństwa istnieje co najmniej od późnych lat 80-tych. W ciągu kilku lat od jej wprowadzenia, cyberbezpieczeństwo AI zmieniło sposób, w jaki organizacje identyfikują, łagodzą i minimalizują swoją ekspozycję na cyberzagrożenia. Obejmuje to korzystanie z narzędzi i technologii opartych na sztucznej inteligencji:

- Identyfikować, przewidywać i bronić się przed włamaniami, naruszeniami danych i cyberatakami.

- Znajdowanie i eliminowanie luk i słabych punktów w zabezpieczeniach cybernetycznych

- Automatyzacja narzędzi i rozwiązań do wykrywania i reagowania na zagrożenia

- Zwiększenie zasięgu i skuteczności analizy zagrożeń

- Usprawnianie i wspieranie zarządzania zagrożeniami cybernetycznymi

Kluczowe elementy cyberbezpieczeństwa opartego na AI

Większość rozwiązań cyberbezpieczeństwa AI łączy różne narzędzia, technologie i aplikacje AI, aby zapewnić najlepszą możliwą ochronę.

Algorytmy uczenia maszynowego mogą być wykorzystywane do analizowania danych, odkrywania wzorców, uczenia się na podstawie wcześniejszych doświadczeń i przewidywania przyszłych zagrożeń.

Modele sztucznej inteligencji wykorzystują algorytmy głębokiego uczenia i sieci neuronowe do monitorowania, oceny i analizy ogromnych ilości danych znacznie szybciej niż ludzkie zespoły ds. bezpieczeństwa lub tradycyjne narzędzia cyberbezpieczeństwa.

Generatywna sztuczna inteligencja (GenAI) i narzędzia do przetwarzania języka naturalnego mogą być wykorzystywane do badania i reagowania na potencjalne zagrożenia, oferowania zaleceń dotyczących różnych strategii reagowania na incydenty i tworzenia uproszczonych raportów z wyników.

Zautomatyzowani agenci AI mogą przejąć wiele z bardziej przyziemnych lub wymagających dużej ilości pracy zadań wykonywanych wcześniej przez pracowników ochrony. Pozwala to zespołom ds. bezpieczeństwa skupić się na bardziej krytycznych zadaniach i umożliwia organizacjom szybsze i skuteczniejsze reagowanie na cyberzagrożenia.

Cyberbezpieczeństwo tradycyjne a AI

Tradycyjne środki cyberbezpieczeństwa są zgodne z jasnym zestawem wstępnie zdefiniowanych zasad, polityk i podręczników w celu identyfikacji i reagowania na znane zagrożenia. Z kolei cyberbezpieczeństwo oparte na sztucznej inteligencji może stale się uczyć, ewoluować i dostosowywać sposób działania. Umożliwia to dotrzymywanie kroku nowym i pojawiającym się zagrożeniom, reagowanie na nowe wektory ataku w miarę ich pojawiania się i wyprzedzanie złych aktorów.

Zdolność do uczenia się na podstawie wcześniejszych doświadczeń i przewidywania nieznanych wcześniej wyników umożliwia narzędziom cyberbezpieczeństwa AI identyfikowanie potencjalnych cyberzagrożeń w czasie rzeczywistym i reagowanie na cyberataki szybciej, dokładniej i skuteczniej niż tradycyjne środki bezpieczeństwa. Umożliwia również organizacjom proaktywną ochronę infrastruktury IT poprzez zapobieganie większości cyberataków, zanim do nich dojdzie.

Tradycyjne cyberbezpieczeństwo

Cyberbezpieczeństwo oparte na AI

Predefiniowane reguły, zasady i playbooki

Ciągłe uczenie się, ewolucja i adaptacja

Zmagania z atakami zero-day i nieznanymi zagrożeniami

Wykrywanie nowych i ewoluujących zagrożeń

Czasochłonne i wymagające dużych zasobów

Skraca czas reakcji i zmniejsza obciążenie analityków

Cyberbezpieczeństwo AI a bezpieczeństwo AI

Podczas gdy terminy „cyberbezpieczeństwo AI” i „bezpieczeństwo AI” są często używane razem, oba odnoszą się do bardzo różnych części procesu bezpieczeństwa.

Cyberbezpieczeństwo oparte na sztucznej inteligencji polega na wykorzystaniu narzędzi i technologii opartych na sztucznej inteligencji do wspierania lub wzmacniania cyberbezpieczeństwa organizacji. Bezpieczeństwo AI (zwane również „bezpieczeństwem dla AI”) odnosi się do potrzeby organizacji każdej wielkości, aby chronić swoje stosy AI i zabezpieczać swoje systemy, sieci i aplikacje AI.

Te ostatnie obejmują ochronę systemów AI przed atakami przeciwników, zapobieganie zatruwaniu lub kradzieży modeli AI, zapewnianie integralności danych potoków uczenia maszynowego, zabezpieczanie infrastruktury AI i danych szkoleniowych oraz upewnianie się, że narzędzia AI są opracowywane w sposób zgodny ze wszystkimi przepisami prawa, zasadami firmy i regulacjami branżowymi.

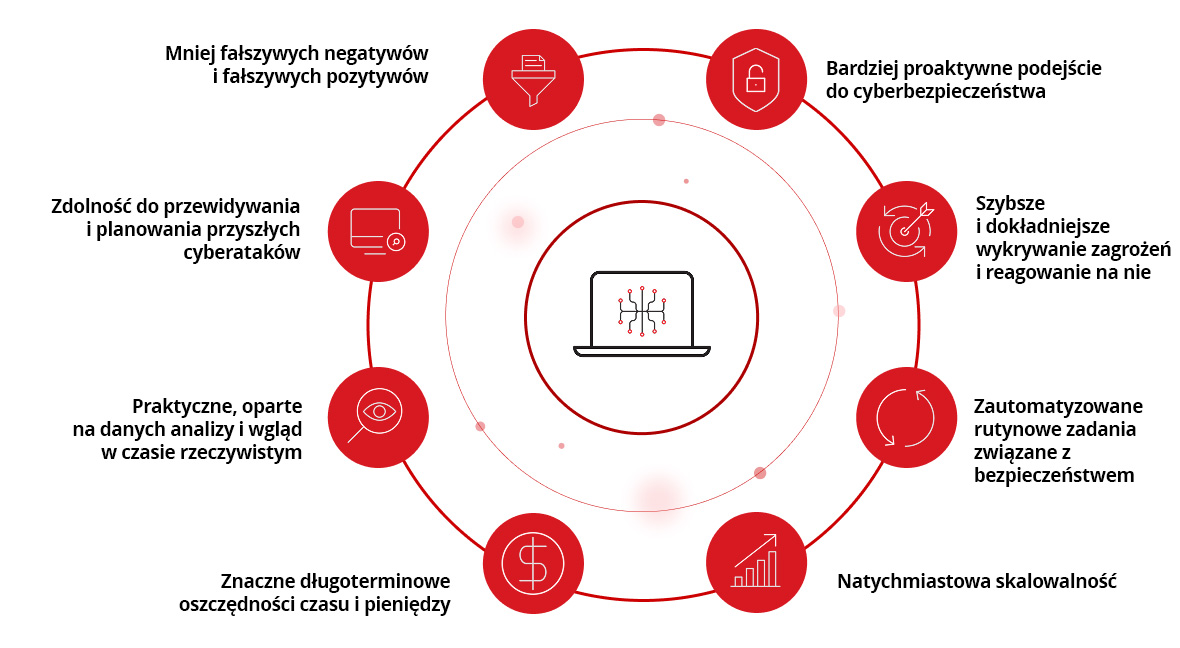

Jakie są korzyści z cyberbezpieczeństwa AI?

Cyberbezpieczeństwo AI oferuje szereg korzyści i przewag nad tradycyjnymi środkami cyberbezpieczeństwa. Oto one:

- Bardziej proaktywne podejście do cyberbezpieczeństwa — narzędzia cyberbezpieczeństwa oparte na sztucznej inteligencji mogą wykrywać, przewidywać i zapobiegać cyberatakom przed ich wystąpieniem, zamiast czekać, aż nastąpi atak.

- Szybsze i dokładniejsze wykrywanie zagrożeń i reagowanie na nie — modele sztucznej inteligencji mogą monitorować, przeszukiwać i analizować ogromne ilości danych w celu wykrywania nietypowych wzorców aktywności, identyfikowania anomalii i reagowania na pierwsze oznaki potencjalnych zagrożeń lub ataków w czasie rzeczywistym.

- Zautomatyzowane rutynowe zadania związane z bezpieczeństwem — dzięki automatyzacji analiz dzienników, skanowania luk w zabezpieczeniach i innych wcześniej ręcznych funkcji bezpieczeństwa, narzędzia AI mogą uwolnić zespoły ds. bezpieczeństwa, aby mogły skupić swój czas, wysiłki i zasoby na bardziej zaawansowanych lub strategicznych zadaniach.

- Mniej fałszywych negatywów i fałszywych pozytywów większa dokładność cyberbezpieczeństwa AI pomaga zapobiegać przeciążeniu centrów operacji bezpieczeństwa (SOC) nieistotnymi lub fałszywymi raportami.

- Zdolność do przewidywania i planowania przyszłych cyberataków — identyfikując i ucząc się na podstawie wcześniejszych ataków, technologie AI mogą przewidywać i przewidywać nowe zagrożenia, podejmować kroki zapobiegawcze w celu zmniejszenia zagrożeń bezpieczeństwa i luk w zabezpieczeniach, zanim zostaną one wykorzystane, oraz pomagać organizacjom wyprzedzać najnowsze taktyki, techniki i procedury (TTP) stosowane przez cyberprzestępców.

- Praktyczne, oparte na danych analizy i wgląd w czasie rzeczywistym — narzędzia sztucznej inteligencji zapewniają wgląd w czasie rzeczywistym w ruch sieciowy i zachowania pracowników dzięki szczegółowym analizom i raportom aktywności wykorzystującym dane pochodzące z różnych źródeł wewnętrznych i zewnętrznych, w tym ruchu sieciowego i ruchu użytkowników, dzienników bezpieczeństwa i aktywności oraz najnowszychinformacji o zagrożeniach branżowych.

- Natychmiastowa skalowalność — modele sztucznej inteligencji można łatwo i niedrogo skalować, aby dotrzymać kroku ewoluującej infrastrukturze IT oraz zmianom w częstotliwości, ilości i wyrafinowaniu cyberataków.

- Znaczne długoterminowe oszczędności czasu i pieniędzy — zmniejszając liczbę naruszeń bezpieczeństwa i ataków, cyberbezpieczeństwo AI może pomóc organizacjom chronić ich dane, chronić ich reputację i znacznie obniżyć koszty naprawy i odzyskiwania danych po cyberatakach.

Jakie są zagrożenia i wyzwania związane z cyberbezpieczeństwem AI?

Organizacje muszą pamiętać o kilku zagrożeniach i wyzwaniach podczas integracji środków cyberbezpieczeństwa AI.

Po pierwsze, istnieje możliwość, że technologia cyberbezpieczeństwa AI zostanie wykorzystana przez samych cyberprzestępców, których ma powstrzymać. For example, cybercriminals can inject malicious content into AI data or manipulate AI algorithms to compromise security defenses. Mogą również wykorzystywać sztuczną inteligencję do próby uniknięcia wykrycia lub znalezienia i wykorzystania luk w systemach bezpieczeństwa organizacji.

Cyberprzestępcy mogą również wykorzystywać własne narzędzia sztucznej inteligencji do tworzenia potężniejszych, bardziej wyrafinowanych i ukierunkowanych cyberataków. Obejmuje to wykorzystanie sztucznej inteligencji do tworzenia fałszywych zdjęć i filmów, nakłaniania pracowników do ujawniania poufnych lub zastrzeżonych informacji lub włamywania się do haseł organizacji i kontroli dostępu.

Wykorzystanie sztucznej inteligencji w cyberbezpieczeństwie budzi również obawy o prywatność danych. Obejmuje to takie kwestie, jak potrzeba uzyskania zgody i zapewnienia przejrzystości podczas gromadzenia lub wykorzystywania danych osobowych, możliwość naruszenia, niewłaściwego wykorzystania lub kradzieży danych wrażliwych lub poufnych oraz wymóg przestrzegania przez organizacje odpowiednich przepisów ustawowych i wykonawczych dotyczących prywatności użytkowników, takich jak ogólne rozporządzenie o ochronie danych (RODO).

Ponadto modele AI są zazwyczaj szkolone na danych pochodzących z istniejących źródeł treści. Wszelkie uprzedzenia, dyskryminacja, luki, niesprawiedliwość lub nieścisłości w oryginalnych danych mogą prowadzić do tego, że modele te będą naśladować te same błędy lub utrudniać ich zdolność do podejmowania dokładnych prognoz i decyzji. Organizacje muszą upewnić się, że ich modele sztucznej inteligencji korzystają wyłącznie z najwyższej jakości i najbardziej zaufanych dostępnych źródeł danych szkoleniowych.

Przykłady wykorzystania sztucznej inteligencji w cyberbezpieczeństwie

Sztuczna inteligencja jest już wykorzystywana na różne sposoby, aby pomóc organizacjom w poprawie ich cyberbezpieczeństwa. Niektóre z najbardziej innowacyjnych przykładów narzędzi i aplikacji cyberbezpieczeństwa AI obejmują:

- Systemy wykrywania złośliwego oprogramowania oparte na sztucznej inteligencji, które wykorzystują algorytmy uczenia maszynowego do wykrywania, identyfikowania i blokowania wyrafinowanych zagrożeń złośliwym oprogramowaniem, które mogą zostać przeoczone przez tradycyjne rozwiązania antywirusowe.

- Oparte na sztucznej inteligencji zapory sieciowe nowej generacji (NGFW), które wykorzystują najnowsze informacje o zagrożeniach, aby chronić organizacje zarówno przed istniejącymi, jak i nowymi cyberzagrożeniami.

- Oparta na sztucznej inteligencji kontrola poczty e-mail i dostępu, która zapobiega atakom phishingowym poprzez analizę treści wiadomości e-mail, danych nadawcy i metadanych wiadomości e-mail w celu identyfikacji i blokowania oszustw, taktyk i technik phishingowych.

- Narzędzia do analizy behawioralnej oparte na sztucznej inteligencji, które mogą monitorować i analizować zachowanie użytkowników i ruch sieciowy w celu wykrywania nieprawidłowych lub nieautoryzowanych działań, identyfikowania potencjalnych zagrożeń wewnętrznych lub naruszonych kont oraz eliminowania zagrożeń bezpieczeństwa.

- Rozwiązania AI w zakresie bezpieczeństwa w chmurze,, które umożliwiają organizacjom ochronę poufnych lub wrażliwych danych przechowywanych w chmurze, przestrzeganie przepisów dotyczących bezpieczeństwa w chmurze oraz ochronę zasobów opartych na chmurze przed cyberatakami, naruszeniami lub kradzieżą.

- Systemy bezpieczeństwa punktów końcowych z ulepszoną sztuczną inteligencją które pomagają organizacjom chronić ich punkty końcowe oraz chronić ich systemy i sieci przed złośliwym oprogramowaniem, programami phishingowymi, oprogramowaniem ransomware i innymi ukierunkowanymi atakami.

- Rozwiązania z zakresu bezpieczeństwa Internetu rzeczy (IoT) wykorzystujące sztuczną inteligencję do ochrony zarówno pojedynczych urządzeń IoT, jak i całych sieci IoT przed cyberzagrożeniami.

- Platformy AI do zarządzania informacjami i zdarzeniami bezpieczeństwa (SIEM) wykrywania i reagowania w sieci (NDR) oraz rozszerzonego wykrywania i reagowania (XDR) służą do automatycznego identyfikowania luk w infrastrukturze cyberbezpieczeństwa organizacji oraz proaktywnego wykrywania i zapobiegania cyberatakom, zanim spowodują one jakiekolwiek szkody.

Akt o AI UE i Implikacje dla Cyberbezpieczeństwa

Akt o AI UE wprowadza kompleksowe ramy prawne dla sztucznej inteligencji w całej Unii Europejskiej, z bezpośrednimi implikacjami dla strategii i operacji cyberbezpieczeństwa. W miarę jak systemy AI stają się bardziej zintegrowane z wykrywaniem zagrożeń, automatyzacją reakcji i modelowaniem ryzyka, Akt wymaga ściślejszego zarządzania, przejrzystości i odpowiedzialności.

Kluczowe Wpływy:

- Klasyfikacja Ryzyka: Systemy AI używane w cyberbezpieczeństwie mogą być klasyfikowane jako wysokiego ryzyka, wymagające ocen zgodności i dokumentacji.

- Zarządzanie Danymi: Zwiększone wymagania dotyczące jakości danych szkoleniowych i łagodzenia biasu wpływają na platformy wywiadu zagrożeń oparte na AI.

- Przejrzystość i Wyjaśnialność: Narzędzia cyberbezpieczeństwa wykorzystujące AI muszą dostarczać jasnej dokumentacji na temat procesów decyzyjnych, zwłaszcza w zautomatyzowanej reakcji na zagrożenia.

- Nadzór Ludzki: Akt kładzie nacisk na mechanizmy z udziałem człowieka, co może przekształcić sposób, w jaki zespoły SOC wchodzą w interakcje z systemami zasilanymi przez AI.

Jaka jest przyszłość cyberbezpieczeństwa związanego z AI?

W miarę jak cyberbezpieczeństwo AI staje się coraz bardziej zaawansowane i coraz powszechniejsze, postępy w technologiach, takich jak machine learning, sieci neuronowe, generatywna sztuczna inteligencja, agentowa sztuczna inteligencja, analityka predykcyjna oparta na sztucznej inteligencji, eksploracja danych oraz zespoły red team i cyfrowe bliźniaki mogą zmienić sposób, w jaki organizacje chronią swoje dane i zasoby.

Centra operacji bezpieczeństwa (SOC) będą prawdopodobnie musiały ewoluować, aby stać się w znacznie większym stopniu oparte na sztucznej inteligencji i w sposób bardziej konsekwentny polegać na modelach bezpieczeństwa opartych na sztucznej inteligencji, narzędziach wykrywania zagrożeń i reagowania opartych na sztucznej inteligencji oraz decyzjach podejmowanych w oparciu o sztuczną Narzędzia i technologie AI służące do zapewnienia cyberbezpieczeństwa będą prawdopodobnie coraz bardziej zintegrowane z innymi podejściami, strategiami i technologiami w zakresie bezpieczeństwa.

Wraz z ciągłym rozwojem dziedziny cyberbezpieczeństwa sztucznej inteligencji organizacje powinny śledzić te i inne trendy, aby zapewnić jak najskuteczniejsze, kompleksowe i aktualne środki bezpieczeństwa sztucznej inteligencji.

Gdzie mogę uzyskać pomoc w zakresie cyberbezpieczeństwa AI?

Trend Vision One™ AI Security wykorzystuje najnowsze narzędzia i technologie sztucznej inteligencji, aby pomóc organizacjom w przyjęciu w pełni proaktywnego podejścia do bezpieczeństwa AI, które powstrzymuje cyberataki i naruszenia danych, zanim do nich dojdzie.

Oparta na Trend Cybertron — pierwszej w branży prawdziwie proaktywnej sztucznej inteligencji w dziedzinie cyberbezpieczeństwa — organizacje mogą czerpać korzyści z 35 lat doświadczenia w dziedzinie cyberbezpieczeństwa i 20 lat inwestycji w rozwój sztucznej inteligencji na potrzeby bezpieczeństwa. Trend Cybertron wykorzystuje rozbudowane modele uczenia się dużych zbiorów danych językowych (LLM) oraz sprawdzone zbiory danych sztucznej inteligencji, aby znacznie poprawić wydajność i skuteczność zabezpieczeń cybernetycznych.

Platforma cyberbezpieczeństwa dla przedsiębiorstw Trend Vision One™ oferuje również zaawansowane narzędzia oparte na sztucznej inteligencji, które są zaprojektowane tak, aby nieustannie ewoluować i dostosowywać się w oparciu o rzeczywiste cyberataki i informacje o zagrożeniach. To zaangażowanie w ciągłe doskonalenie i innowacje pozwala organizacjom być na bieżąco z najnowszymi i pojawiającymi się zagrożeniami cybernetycznymi oraz wyprzedzać o krok złych aktorów.

Często zadawane pytania (FAQ)

Czym jest sztuczna inteligencja w cyberbezpieczeństwie?

Sztuczna inteligencja w cyberbezpieczeństwie odnosi się do wykorzystania narzędzi i technologii AI w celu ochrony organizacji lub firmy przed atakami hakerskimi, naruszeniami bezpieczeństwa danych i cyberatakami.

W jaki sposób sztuczna inteligencja jest wykorzystywana w cyberbezpieczeństwie?

Dostawcy cyberbezpieczeństwa wykorzystują sztuczną inteligencję do analizowania zagrożeń cybernetycznych, identyfikowania luk lub luk w zabezpieczeniach organizacji i szybszego reagowania na zagrożenia.

Jakie są główne korzyści z zastosowania sztucznej inteligencji w cyberbezpieczeństwie?

Narzędzia AI oferują szybsze, dokładniejsze, bardziej kompleksowe i bardziej proaktywne podejście do cyberbezpieczeństwa niż zespoły ludzkie mogą osiągnąć samodzielnie.

Czy sztuczna inteligencja zastąpi cyberbezpieczeństwo?

Chociaż może to prowadzić do utraty niektórych miejsc pracy, sztuczna inteligencja będzie raczej wykorzystywana jako narzędzie przez specjalistów ds. cyberbezpieczeństwa, a nie jako ich zamiennik.

Co jest lepsze dla przyszłości, sztucznej inteligencji lub cyberbezpieczeństwa?

Sztuczna inteligencja i cyberbezpieczeństwo będą prawdopodobnie współpracować ze sobą w przyszłości, aby poprawić zabezpieczenia i chronić organizacje przed cyberzagrożeniami.

Czy sztuczna inteligencja stanowi zagrożenie dla cyberbezpieczeństwa?

Narzędzia sztucznej inteligencji mogą wzmocnić obronę przed cyberatakami, ale mogą być również wykorzystywane przez przestępców do włamywania się do systemów informatycznych lub atakowania ich.

Czy cyberbezpieczeństwo umiera?

Nie, cyberbezpieczeństwo nie umiera. W miarę rozwoju zagrożeń bezpieczeństwa i coraz bardziej wyrafinowanych cyberataków cyberbezpieczeństwo stale się rozwija.

Jak skuteczna jest sztuczna inteligencja w cyberbezpieczeństwie?

Narzędzia sztucznej inteligencji mogą być niezwykle skutecznym sposobem na usprawnienie ochrony przed cyberatakami, usprawnienie funkcji wykrywania zagrożeń i reagowania oraz ochronę przed cyberatakami.

Czy sztuczna inteligencja jest przydatna w cyberbezpieczeństwie?

Sztuczna inteligencja odgrywa kluczową i rosnącą rolę w pomaganiu organizacjom w ulepszaniu, wzmacnianiu i automatyzacji ich zabezpieczeń cybernetycznych.

Czy cyberbezpieczeństwo przetrwa sztuczną inteligencję?

Przewiduje się, że cyberbezpieczeństwo przetrwa sztuczną inteligencję, po części dzięki wykorzystaniu narzędzi sztucznej inteligencji do identyfikowania, przewidywania i reagowania na nowe zagrożenia cybernetyczne, kiedy i kiedy się pojawią.

Jaki jest wskaźnik sukcesu wykorzystywania sztucznej inteligencji do wykrywania cyberataków?

Sztuczna inteligencja może znacznie poprawić wskaźniki sukcesu w wykrywaniu cyberataków. Niektórzy eksperci szacują, że skuteczność cyberbezpieczeństwa opartego na sztucznej inteligencji może wynosić nawet 85–99%.

Jak duża jest sztuczna inteligencja na rynku cyberbezpieczeństwa?

Szacuje się, że w 2023 r. światowy rynek cyberbezpieczeństwa opartego na sztucznej inteligencji osiągnie wartość bliską 22,4 mld USD.

Czy sztuczna inteligencja może powstrzymać wszystkie zagrożenia phishingowe?

Żadna pojedyncza technologia nie może powstrzymać wszystkich zagrożeń phishingowych. Jednak narzędzia oparte na sztucznej inteligencji mogą znacznie poprawić dokładność i wydajność działań antyphishingowych.

Która sztuczna inteligencja jest najlepsza w dziedzinie cyberbezpieczeństwa?

Niektóre z najlepszych narzędzi AI do cyberbezpieczeństwa obejmują systemy wykrywania złośliwego oprogramowania oparte na sztucznej inteligencji, zabezpieczenia chmury oparte na sztucznej inteligencji, zapory ogniowe nowej generacji (NGFW) oparte na sztucznej inteligencji oraz zabezpieczenia punktów końcowych oparte na sztucznej inteligencji.

Jakie rodzaje sztucznej inteligencji są wykorzystywane w cyberbezpieczeństwie?

Narzędzia AI do cyberbezpieczeństwa obejmują oparte na sztucznej inteligencji zabezpieczenia przed złośliwym oprogramowaniem i phishingiem, wykrywanie zagrożeń za pomocą sztucznej inteligencji oraz kontrolę autoryzacji i dostępu za pomocą sztucznej inteligencji.

Co oznacza skrót AI w kontekście cyberbezpieczeństwa?

AI oznacza „sztuczną inteligencję”. W dziedzinie cyberbezpieczeństwa narzędzia AI pomagają chronić organizacje przed cyberatakami i cyberprzestępcami.

Czym jest odpowiedzialna sztuczna inteligencja w dziedzinie cyberbezpieczeństwa?

Odpowiedzialna sztuczna inteligencja koncentruje się na opracowywaniu i stosowaniu narzędzi cyberbezpieczeństwa opartych na sztucznej inteligencji w sposób sprawiedliwy, etyczny, przejrzysty, bezpieczny i zgodny z prawami człowieka.

W jaki sposób generatywna sztuczna inteligencja może być wykorzystywana w cyberbezpieczeństwie?

Generatywna sztuczna inteligencja (GenAI) może być wykorzystywana do szybkiego i skutecznego badania cyberataków i innych zagrożeń, reagowania na nie oraz łagodzenia ich skutków.

Jaka jest rola sztucznej inteligencji w cyberbezpieczeństwie?

Sztuczna inteligencja może odgrywać kluczową i rosnącą rolę w poprawie wydajności, dokładności i skuteczności cyberbezpieczeństwa.

Jak AI kształtuje cyberbezpieczeństwo?

Wraz ze wzrostem częstotliwości i stopnia zaawansowania cyberataków technologie sztucznej inteligencji pomogą uczynić zabezpieczenia cybernetyczne bardziej niezawodnymi, szybszymi i skuteczniejszymi.

Powiązane artykuły

10 najlepszych środków ograniczających ryzyko dla LLM i aplikacji Gen AI w 2025 r.

Zarządzanie nowymi zagrożeniami dla bezpieczeństwa publicznego

Jak daleko mogą nas zaprowadzić międzynarodowe standardy?

Jak napisać generatywną politykę cyberbezpieczeństwa AI?

Złośliwe ataki z wykorzystaniem sztucznej inteligencji wśród największych zagrożeń

Rosnące zagrożenie związane z Deepfake tożsamości