Prawdziwe zagrożenia, prawdziwe TTP, prawdziwa odporność

Replikujemy te same taktyki, techniki i procedury (TTP) stosowane przez cyberprzestępców w przypadkach reagowania na incydenty. Zamiast ogólnych scenariuszy, masz do czynienia z autentycznymi zachowaniami przeciwników wymierzonymi w organizacje, a nawet w Twoje aplikacje AI i LLM. To najbardziej trafny i skuteczny sposób oceny swojej odporności psychicznej.

Spersonalizowane ataki, sprawdzona ochrona

Nie tylko symulujemy ogólne zagrożenia, ale także odtwarzamy ataki dostosowane do indywidualnych potrzeb. Pokazanie, w jaki sposób ataki przedostają się przez systemy zabezpieczeń, pozwala wykryć ukryte luki w wykrywaniu. Wynik: precyzyjne testy umożliwiające szybsze dostosowanie zasad, szybszą reakcję i poprawę stanu bezpieczeństwa.

Większa niż kiedykolwiek zgodność z testami dostosowanymi do ryzyka

Ramy regulacyjne, takie jak DORA, NIS2 i NIST, wymagają realistycznych testów opartych na zagrożeniach. Nasze usługi w zakresie współpracy między zespołami red i purple są zgodne z tymi standardami i zapewniają oceny oparte na ryzyku, które wykraczają poza zgodność z przepisami. Dzięki dogłębnej znajomości środowiska i narzędzi pomagamy spełnić wymogi prawne, jednocześnie budując silniejszą, bardziej proaktywną postawę bezpieczeństwa gotową na ewoluujące zagrożenia.

Zespół Red

Red Teaming to kompleksowe działanie oparte na zagrożeniach, które naśladuje prawdziwych atakujących. Od inżynierii społecznej po wykorzystywanie odsłoniętych powierzchni ataku — testujemy zabezpieczenia przy użyciu tych samych technik, co potencjalni przeciwnicy, aby dotrzeć do najcenniejszych zasobów bez wykrycia. Testy Red Team mogą zmniejszyć liczbę incydentów związanych z bezpieczeństwem nawet o 25% i obniżyć związane z nimi koszty nawet o 35%, jednocześnie poprawiając stan bezpieczeństwa. *

Outside-in realism

Pracujemy tak jak prawdziwi atakujący, od zewnątrz. Niezależnie od tego, czy chodzi o phishing, narażoną infrastrukturę czy skradzione dane uwierzytelniające, oznacza to odtwarzanie rzeczywistych wektorów ataku w celu przetestowania zabezpieczeń obwodowych bez skrótów i wcześniej ustalonego dostępu.

Pełny łańcuch

Nasz proces obejmuje cały cykl ataku, od początkowego naruszenia bezpieczeństwa, poprzez ruch boczny, eskalację uprawnień, przejęcie domeny, aż po eksfiltrację danych, dokładnie tak, jak pokazują to rzeczywiste przypadki reagowania na incydenty.

Eksponowanie luk poprzez ukryte testy

Zaangażowanie jest ukryte z założenia: tylko zespół White Team jest informowany. Zapewnia to autentyczność podczas testowania zdolności wykrywania, eskalacji i reagowania w rzeczywistych warunkach.

Jak to działa

Zaczynamy od dostosowanego do potrzeb określenia zakresu, aby zdefiniować cele, modele zagrożeń i zasady działania. Następnie wdrażane są wielofazowe symulacje przeciwników. Podczas operacji pozostajemy w kontakcie z zespołem White Team za pośrednictwem kanału komunikacyjnego poza pasmem, aby na bieżąco informować ich o sytuacji. Po zakończeniu współpracy otrzymasz szczegółowy raport opisujący nasze metody, TTP oraz priorytetowe, praktyczne zalecenia.

Planowanie

Symulacja ataku

Codzienna współpraca

Raportowanie i rekomendacje

Zaspół Purple

Idealny dla organizacji gotowych do współpracy, Purple Teaming łączy działania ofensywne i defensywne w celu poprawy wykrywania i reagowania. Analityk współpracuje z zespołem Blue Team, kierując wykrywaniem w czasie rzeczywistym w Trend Vision One i zapewniając ciągłą wymianę informacji między zespołami, aby stworzyć praktyczne doświadczenie współpracy w scenariuszu zakładającego naruszenie bezpieczeństwa.

Praktyczne szkolenie

Twój zespół SOC współpracuje z naszymi ekspertami ds. ofensywy w praktycznym, sprzyjającym współpracy środowisku. Ponieważ naśladujemy zachowania atakujących, Twoi obrońcy uzyskują w czasie rzeczywistym wgląd w pojawiające się zagrożenia i sposoby ich powstrzymania.

Szybka poprawa stanu bezpieczeństwa

W ciągu zaledwie pięciu dni zauważysz poprawę metod wykrywania i reagowania swojego zespołu dzięki symulowanym scenariuszom naruszeń bezpieczeństwa opartym na zagrożeniach, z którymi prawdopodobnie będziesz mieć do czynienia.

Integracja z Trend Vision One

Integrujemy się z platformą Trend Vision One i istniejącym stosem zabezpieczeń. Dzięki temu możemy wspólnie opracowywać metody wykrywania, dostosowywać logikę alertów i wizualizować ruchy atakujących, aby uzyskać maksymalny zasięg wykrywania.

Kluczowe kroki serwisowe:

Planowanie

Rozmowa wstępna w celu omówienia terminów uruchomienia, struktury zespołu, zakresu i instrukcji dotyczących współpracy, zazwyczaj odbywająca się 14 dni przed rozpoczęciem współpracy.

Współpraca

Codzienne rozmowy między naszym zespołem Purple Team a zespołem Blue Team w celu wymiany wiedzy i współpracy.

Uczenie się

Twój zespół zdobędzie umiejętności w zakresie możliwości Trend Vision One, reagowania na incydenty i wykrywania zagrożeń.

Spostrzeżenia

Po rozpoczęciu testów ujawnimy problemy, błędy, nieprawidłowe konfiguracje i „otwarte drzwi”, aby podzielić się nimi z zespołem ds. bezpieczeństwa.

Zespół Red dla Gen AI i LLM

Specjalny zespół Trend poświęcony GenAI i LLM sprawdza bezpieczeństwo Twoich aplikacji AI i dostosowuje oceny do 10 największych zagrożeń OWASP, żeby pomóc Ci zmniejszyć realne zagrożenia.

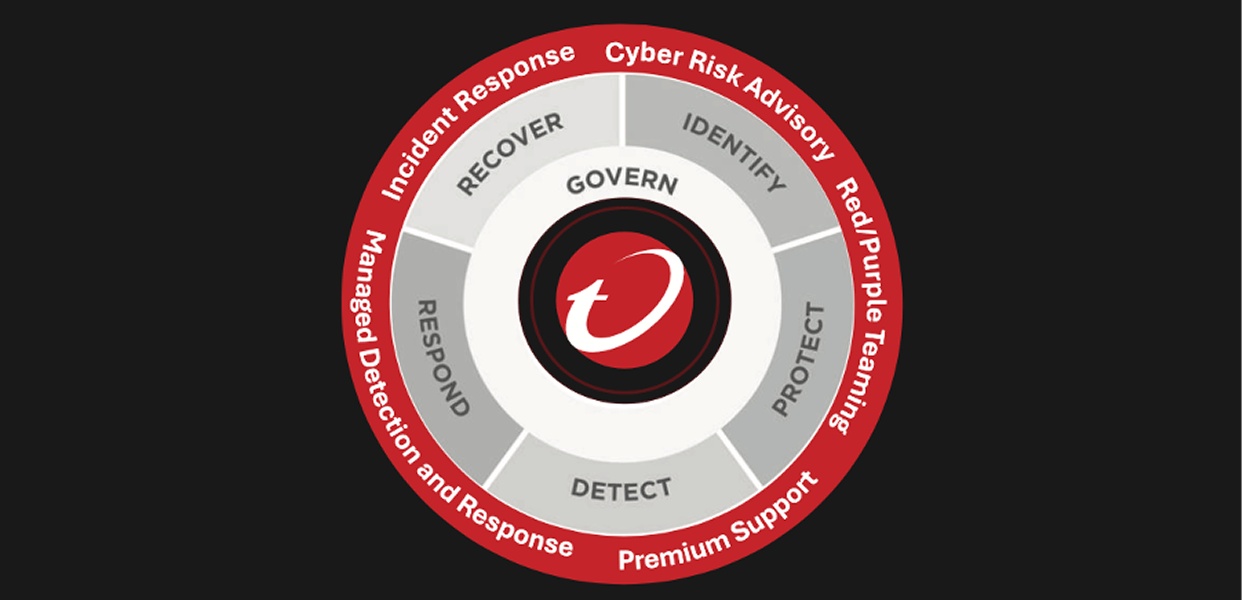

Trend wyróżnia się na tle innych

Większość usług bezpieczeństwa zatrzymuje się podczas testów penetracyjnych. Trend idzie dalej, łącząc dziesięciolecia doświadczenia w zakresie zagrożeń, informacje z pierwszej linii oraz rzeczywiste techniki stosowane przez atakujących. Od testów typu red teaming i adversarial AI oraz LLM po pełne zaangażowanie zespołu purple team, Trend odkrywa luki w zakresie ludzi, procesów i technologii, aby dostarczyć praktyczne informacje, które wzmacniają, weryfikują i usprawniają działania związane z bezpieczeństwem.

Głos klienta

„Wiedza techniczna i profesjonalizm zespołu Trend Red Team są nieocenione dla naszej organizacji. Ich skrupulatne podejście do symulacji rzeczywistych cyberataków dostarczyło nam praktycznych informacji, które pomogły nam poprawić naszą odporność na zagrożenia bezpieczeństwa.”

Mikkel Madsen, kierownik ds. bezpieczeństwa IT na lotnisku w Kopenhadze

Poznaj inne usługi Trend Vision One

*Źródło: Forrester Research, „Jak w pełni wykorzystać Red Teaming”, 3 maja 2024 r.

Gotowy na zmianę swojej strategii bezpieczeństwa cybernetycznego?

Nawiążmy kontakt.

*Źródło: Forrester Research, „Jak w pełni wykorzystać Red Teaming”, 3 maja 2024 r.