Cloud

KI ist sowohl Waffe als auch Angriffsziel

Die Instrumentalisierung sowie Ausnutzung von KI-Systemen wird zu einem prägenden Merkmal der Cyberbedrohungen. Zum einen passen Angreifer KI-Tools zur Verbesserung traditioneller Aktivitäten an, zum anderen sind agentenbasierte KI-Systeme Angriffsziel.

Wichtigste Erkenntnisse

- Cyberkriminelle nutzen sowohl speziell entwickelte als auch legitime KI-Plattformen, um ihre Aktivitäten voranzutreiben, darunter Deepfake-basierter Betrug, KI-generierte Malware und die Ausnutzung von agentenbasierten Systemen.

- Eine beträchtliche Anzahl von KI-Servern (wie Ollama, Chrome) ist dem Internet ausgesetzt, läuft mit veralteter Software und verfügt nicht über angemessene Sicherheitskontrollen. Dadurch werden sensible Daten offengelegt und potenziell unbefugte Zugriffe durch Angreifer ermöglicht.

- Systemische Bedrohungen der Lieferkette wie kompromittierte Modelle, manipulierte Tokenizer und unsichere Abhängigkeiten können zu Betriebsstörungen führen, die robuste Kontrollen der Lieferkettenintegrität und eine kontinuierliche Überwachung erfordern, um sie angemessen zu beheben.

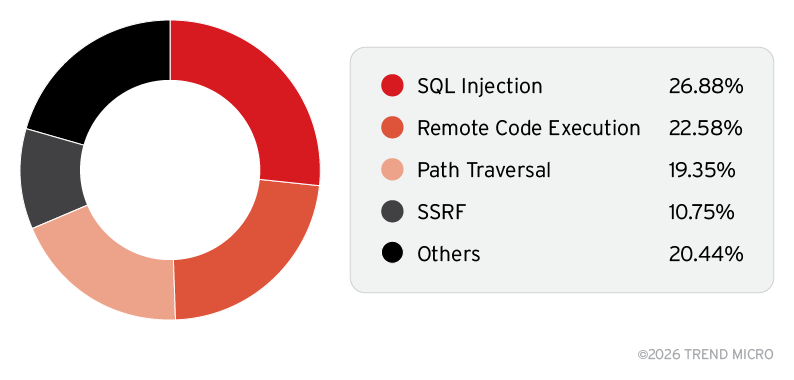

Eine Analyse von TrendAI™ Research zeigt einen Anstieg der KI-bezogenen Schwachstellen von über 6000 identifizierten Einzelfällen seit 2018. 2025 gab es einen Rekordanstieg. Böswillige Akteure nutzen weiterhin Schwachstellen in der KI-Infrastruktur, den Anwendungsschichten und den Komponenten der Lieferkette aus, wobei sich hochkritische und kritische Schwachstellen auf neue Bereiche wie MCP-Server (Model Context Protocol) und agentenbasierte KI konzentrieren.

Mit der Weiterentwicklung und zunehmenden Verfügbarkeit von KI-Technologien haben böswillige Akteure keine Zeit verloren, diese Fähigkeiten für ihre eigenen Zwecke zu instrumentalisieren. Sie nutzen die neue Technologie auf zwei unterschiedliche, aber gleichermaßen besorgniserregende Arten: zur Verbesserung traditioneller krimineller Aktivitäten und für den Missbrauch und die Manipulation legitimer KI-Systeme mit kriminellem Ziel.

Kriminelle Innovationen bei der Instrumentalisierung von KI

Der kriminelle Missbrauch von KI hat sich rasch zu einem strukturierten, skalierbaren Ökosystem entwickelt. Bedrohungsakteure passen KI-Tools nicht mehr nur an, sondern integrieren KI systematisch in ihre Aktivitäten.

Illegale LLM-Marktplätze

Der Markt für kriminell ausgerichtete LLMs konsolidiert sich. Während wirklich unabhängige, lokal entwickelte kriminelle LLMs nach wie vor relativ selten sind, dominieren „Jailbreak-as-a-Service“-Angebote die Untergrundwirtschaft. Wir fanden im November 2025 einen besonders aufschlussreichen Fall auf: ein kriminelles LLM, das als selbst gehostete Lösung vermarktet wurde, sich aber bei näherer Betrachtung als nichts anderes als eine ausgeklügelte Jailbreak-Hülle entpuppte, die mehrere legitime Backend-Dienste umfasste. Dieses Betrugsmuster – Kriminelle verkaufen neu verpackten Zugriff auf kompromittierte Mainstream-KI-Systeme – ist zum Industriestandard auf Untergrundmärkten geworden.

KI-gestützte Malware

Mittlerweile gibt es Beispiele für tatsächlich KI-generierte Malware, die im Rahmen von APT28 entwickelt wurde und KI über die API von Hugging Face erfolgreich ausnutzte, um ihre Payload zur Laufzeit zu generieren.

Deepfakes

Deepfakes entwickeln sich weiterhin in besorgniserregende Richtungen und werden zunehmend für Bewerbungsbetrug eingesetzt (nordkoreanische Agenten etwa mit überzeugenden falschen Identitäten). Nach ihrer Einstellung leiteten sie ihre Einkünfte an das nordkoreanische Regime weiter und verschafften sich möglicherweise Zugang zu sensiblen Unternehmenssystemen und geistigem Eigentum.

Legitime KI-Tools wenden sich gegen ihre Entwickler

Vielleicht noch besorgniserregender als speziell für kriminelle Zwecke entwickelte KI ist der zunehmende Trend, legitime KI-Plattformen für böswillige Zwecke zu missbrauchen. Ein Beispiel dafür ist der Fall, wie Kriminelle KI-gestützte Entwicklungsplattformen missbraucht haben, um schnell überzeugende gefälschte Captcha-Seiten zu erstellen.

Kriminelle agentenbasierte KI

Das Aufkommen von agentenbasierter KI, also Systemen, die in der Lage sind, autonome Entscheidungen zu treffen und mehrstufige Operationen durchzuführen, stellt die nächste Ebene in der KI-gestützten Kriminalität dar. Anthropic berichtete im November 2025 über einen der ersten bestätigten Fälle von KI-gesteuerter Cyberspionage. Wir haben diese Entwicklung und deren Potenzial ausführlich analysiert.

Die praktischen Auswirkungen dieser neuen Bedrohung haben wir anhand eines eigenen experimentellen Nachbau eines Scam Factory-Workflows vorgeführt. Er hat gezeigt, wie KI-Agenten so orchestriert werden können, dass sie End-to-End-Betrugsoperationen durchführen, von der Generierung von Deepfake-Personas über falsche Identitäten und gefälschte Produkte bis hin zu betrügerischen Werbekampagnen. Die Effizienzsteigerungen waren atemberaubend: Was früher Teams von menschlichen Bedienern erforderte, könnte nun mit minimaler Aufsicht automatisiert werden.

KI-Agenten als Waffe

Man muss zwischen KI-generierten Bedrohungen (wie Deepfakes) und solchen mit KI als Waffe unterscheiden. Letztere stellen einen Paradigmenwechsel von durch Menschen gesteuerten Angriffen zu autonomen Operationen dar.

Derzeit entstehen autonome KI-Bedrohungen, bei denen der Agent als primärer Akteur fungiert. Diese können selbständig die Erkundung durchführen, Abhängigkeiten in der Lieferkette analysieren und Schwachstellen mit einer Geschwindigkeit und in einem Umfang identifizieren, die die menschlichen Fähigkeiten übersteigen. Im Gegensatz zu statischen Skripten können autonome Agenten logisch denken und sich anpassen. Wenn ein Exploit-Versuch fehlschlägt, kann der Agent mithilfe adaptiver Logik den Fehler analysieren, die Payload neu gestalten und den Angriff innerhalb von Millisekunden nochmals versuchen.

Aufkommende Bedrohungsvektoren

Seit Ende 2024 verfolgen wir den Missbrauch exponierter KI-Infrastrukturen. Zwei der am häufigsten exponierten Komponenten sind der Ollama-Inferenzserver und Chroma-Vektorspeicher-Implementierungen.

Ollama ist ein sehr beliebtes Inferenz-Framework für das Hosting lokaler KI-Modelle. Viele Open-Weights-and-Bias-Modelle sind über Ollama verfügbar, und es bietet eine praktische Befehlszeile, eine Webschnittstelle und eine HTTP-API. Standardinstallationen sind nur für den lokalen Host zugänglich, aber mit der richtigen Konfiguration kann über das Netzwerk als Webdienst darauf zugegriffen werden. Ollama verfügt über keine integrierte Authentifizierung, was bedeutet, dass es in einer Produktionsumgebung hinter einem anderen Webserver versteckt werden sollte, der die Authentifizierung übernimmt, und dass der Ollama-Server selbst nicht zugänglich sein sollte. Leider übersehen viele Entwickler diese Anforderung. Von den von uns mit Shodan gescannten 313.000 exponierten Servern hosteten 230.000 Ollama. Die größte installierte Basis ist in den USA (4.144) zu finden, gefolgt von Deutschland (1.839).

Chroma ist eine beliebte Vektordatenbank für Text, die hauptsächlich in RAG-Anwendungen (Retrieval Augmented Generation) verwendet wird. Sie speichert Texte (oder Textabschnitte) und speichert Text-Embeddings als Vektoren, sodass eine Anwendung Texte basierend auf dem Embedding-Vektor der Abfrage suchen und abrufen kann. Anschließend gibt sie die Texte zur Verarbeitung zurück, in der Regel durch ein LLM. Unsere Recherche ergab, dass wie auch bei Ollama die Software nicht upgedated wird, oder wenn ja, nur selten. Auch hier zeigt sich mithilfe von Shodan, dass die meisten exponierten Installationen in den USA (242) vorhanden sind, gefolgt von Deutschland (121).

Alle Einzelheiten zu den beiden enthält der Originalbeitrag.

Das Problem mit exponierter KI-Infrastruktur wird so schnell nicht verschwinden sondern immer vielfältiger und komplexer werden. Wenn Unternehmen KI schnell in alle Bereiche ihrer Geschäftstätigkeit integrieren wollen, müssen sie darauf achten, dass die Einführung nicht schneller geht als die grundlegende Sicherheitsvorbereitung.

MCP-Schwachstellen in der Praxis

Die rasche Ausbreitung von Model Context Protocol (MCP)-Implementierungen hat zu erheblichen Sicherheitsherausforderungen geführt, da Unternehmen versuchen, agentenbasierte KI-Funktionen in ihre Abläufe zu integrieren, ohne dass diese ausreichend abgesichert oder überwacht werden. Unsere Untersuchungen zeigen einen Anstieg von exponierten MCP-Server, wobei viele veraltete Protokolle verwenden und wichtige Sicherheitskontrollen fehlen. Eine der kritischen Gefährdungen besteht im Datenbankzugriff und in der Speicherexfiltrierung. Alle Einzelheiten dazu finden Sie auch im Originalbeitrag.

Ein weiteres aufkommendes Problem ist die Rolle von KI-generiertem Code bei der Entwicklung von MCP-Servern. Neben einem weltweiten Anstieg der KI-Code-Generierung seit Januar 2025 stellte TrendAI™ Research fest, dass 8 % der Aktivitäten in MCP-Server-Repositorys auf KI-Bots zurückzuführen sind, und mindestens 20 % der Open-Source-MCP-Server-Repositorys enthielten KI-generierten Code.

Unsere Daten zeigten auch, dass 4 % bis 20 % der 19.000 analysierten Open-Source-MCP-Repositorys ausnutzbare Schwachstellen enthielten, und eine weitere manuelle Analyse ergab, dass 42,6 % der klassifizierten Schwachstellen eindeutige Anzeichen für KI-generierten Code aufwiesen.

Die beobachteten Schwachstellenmuster deuten darauf hin, dass KI-Codierungsassistenten, wenn sie ohne angemessene menschliche Aufsicht und Sicherheitsüberprüfung eingesetzt werden, aktiv ausnutzbare Schwachstellen in MCP-Repositorys einführen.

Komplexe Anwendungen erfordern Expertenwissen und sollten nicht vollständig an allgemeine LLMs delegiert werden. KI-Codierungsassistenten sind hervorragend darin, syntaktisch korrekten Code zu generieren und gängige Muster zu implementieren, aber sie verstehen häufig nicht die Sicherheitskontexte, Bedrohungsmodelle und die subtilen Interaktionen zwischen Komponenten, die Schwachstellen verursachen.

Versteckte Kosten und Sicherheitsrisiken bei LLM-Implementierungen

Tokenizer, die Komponenten, die Text für LLMs in Token umwandeln, stellen eine kritische aber oft übersehene Angriffsfläche in KI-Implementierungen dar. Wenn sich das Verhalten von Tokenizern ändert, sei es durch versehentliche Konfigurationsabweichungen oder absichtliche Manipulationen durch Angreifer, entstehen für Unternehmen eine Reihe von finanziellen, betrieblichen und sicherheitstechnischen Konsequenzen, die erst sichtbar werden, wenn die Kosten in die Höhe schnellen oder Systeme ausfallen. Kleine, kontrollierte Änderungen an Tokenizer-Dateien können die Token-Anzahl verdoppeln oder verdreifachen, ohne die Modellgewichte zu beeinflussen, was zu überhöhten Cloud-Rechnungen, Leistungseinbußen, CPU-Überlastung und ausnutzbaren Sicherheitslücken in agentenbasierten Systemen führt.

„Tokenisierungsabweichung”

Diese Abweichung (Drift) wirkt wie ein verstecktes Risiko in der Lieferkette. Böswillige Akteure laden dann Modelle mit modifizierten Tokenizer-Artefakten in öffentliche Repositorys hoch, die funktionstüchtig scheinen, aber den Text in exponentiell mehr Token fragmentieren. Werden diese Modelle heruntergeladen, gibt es keine unmittelbaren Warnsignale – das Modell generiert weiterhin kohärente Antworten –, die Kosten steigen jedoch, die Latenz verschlechtert sich um 8 % bis 40 % und das Kontextfenster verkleinert sich, wodurch der nutzbare Prompt-Speicherplatz um die Hälfte reduziert werden kann. Noch kritischer ist, dass geänderte Tokenizer-Normalisierungsregeln die Modellausgaben manipulieren können, um unbeabsichtigte Aktionen in nachgelagerten Agentensystemen auszulösen, wodurch harmlose Benutzereingaben wie „Ja“ in ausführbare Befehle umgewandelt werden, die Router als gültige Tool-Aufrufe interpretieren.

Die experimentelle Analyse anhand von fünf Modellen (GPT-2, DistilGPT-2, Facebook OPT-125M, EleutherAI GPT-Neo-125M und TinyGPT-2) ergab eine systematische Verschlechterung durch Tokenizer-Modifikationen. Unser Forschungsteam änderte nur die Merge-Strategie des Tokenizers, ließ die Modellgewichte völlig unverändert und maß die kaskadierenden Effekte in Bezug auf Kosten, Leistung und Fairness.

Die Token-Inflation erreichte alarmierende Ausmaße. Identischer Text erforderte plötzlich vile mehr Tokens pro Zeichen, doppelt so viel Rechenleistung, kostete doppelt so viel in der API-Abrechnung und verbrauchte doppelt so viel Kontextfensterplatz.

Die Leistungsminderung verschärfte das Problem noch. Die CPU-Auslastung pro Anfrage stieg proportional an, da sowohl die Tokenisierung als auch die Modellinferenz mit der erhöhten Token-Anzahl skalierten. In Produktionsumgebungen führte dies zu einer Fluktuation bei der automatischen Skalierung, einer erhöhten Anzahl von Pods, Zeitüberschreitungen und einer Verschlechterung der Servicequalität für Multi-Tenant-Workloads, ohne dass sich das Modellverhalten sichtbar veränderte.

Sprachbasierte Diskriminierung. Tests in Chinesisch, Englisch und Hindi ergaben, dass nicht-englische Sprachen unter einer überproportionalen Token-Inflation litten. Dies führt zu einer grundlegend unfairen Serviceökonomie, bei der Nutzer in verschiedenen Regionen für gleichwertige Funktionen sehr unterschiedliche Beträge zahlen und unterschiedliche Leistungsniveaus erleben.

Die detaillierten Einzelheiten zu den Tests lesen Sie im Originalbeitrag.

Sicherheitsrisiken in Agentenarchitekturen

Über die Wirtschaftlichkeit hinaus führt die Tokenizer-Abweichung zu ausnutzbaren Schwachstellen in agentenbasierten KI-Systemen, in denen Modelle mit Tools, Datenbanken und externen Diensten interagieren. Unsere Forschung zeigt, dass Änderungen an der Normalisierungskomponente – die Unicode kanonisiert, Leerzeichen verarbeitet, diakritische Zeichen entfernt und Steuerzeichen vor der Tokenisierung zuordnet – sowohl Eingaben als auch Ausgaben auf eine Weise manipulieren können, die Sicherheitskontrollen umgeht. Das Angriffsszenario verläuft über eine Kompromittierung der Lieferkette. Lesen Sie dazu auch die Fallstudie von TrendAI™ Research.

Im nächsten Blog zum KI-Ökosystem befassen wir uns mit gerade entstehenden Bedrohungen, wie etwa die Kommunikation zwischen den Agenten und das Phänomen des KI Bias.