Cloud

Bruchstellen im KI-Ökosystem durch Schwachstellen

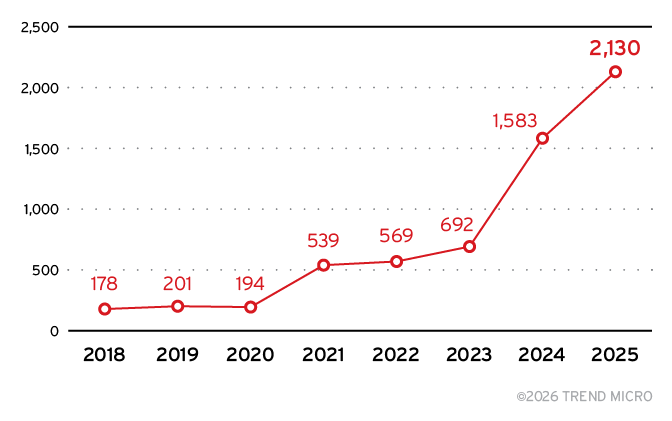

Die Analyse der KI-bezogenen Schwachstellen von TrendAI Research zeigt nicht nur einen rapiden Anstieg der Anzahl von kritischen Schwächen, sondern auch eine Ausweitung auf jede Ebene des KI-Stacks. Wir haben auch untersucht, wo die größten Risiken liegen.

Wichtige Erkenntnisse

- Gesamtzahl der KI-CVE von 2018 bis 2025: 6086 einzigartige Schwachstellen in acht KI-Unterkategorien

- KI-CVE 2025: 2130, ein Anstieg von 34,6 % gegenüber dem Vorjahr

- Anteil der KI an allen CVEs 2025: 4,42 %, die höchste jemals verzeichnete Jahresrate

- AI-CVE mit hoher/kritischer Schwere von 2018 bis 2025: 1.593, 26,2 % aller AI-CVE (CVSS-Score: 7,0+)

- AI-CVE mit hohem/kritischem Schweregrad 2025: 641 (517 Schwachstellen mit hohem Schweregrad und 124 Schwachstellen mit kritischem Schweregrad)

- Gesamtzahl der CVEs in der Datenbank: 330.239 (48.164 allein 2025)

Eine umfassende Analyse von TrendAI™ Research zeigt einen Anstieg der KI-bezogenen Schwachstellen von über 6000 identifizierten Einzelfällen seit 2018. 2025 nun gab es einen Rekordanstieg. Böswillige Akteure nutzen weiterhin Schwachstellen in der KI-Infrastruktur, den Anwendungsschichten und den Komponenten der Lieferkette aus, wobei sich hochkritische und kritische Schwachstellen auf neue Bereiche wie MCP-Server (Model Context Protocol) und agentenbasierte KI konzentrieren.

Zusammengenommen legen diese anhaltenden und konvergierenden Probleme die Schwachstellen der heutigen KI-orientierten Welt offen und unterstreichen die Notwendigkeit einer grundlegenden Veränderung in der Herangehensweise von Unternehmen an das Thema Sicherheit.

Die Beschleunigung 2025 (+0,55 Prozentpunkte) unterscheidet sich grundlegend von den Vorjahren. Diese Zunahme erstreckt sich über die Kategorien Large Language Model (LLM)-Tools, MCP-Server und traditionelles maschinelles Lernen (ML)/GPU –nicht von einer einzigen Anbieterprüfung getrieben.

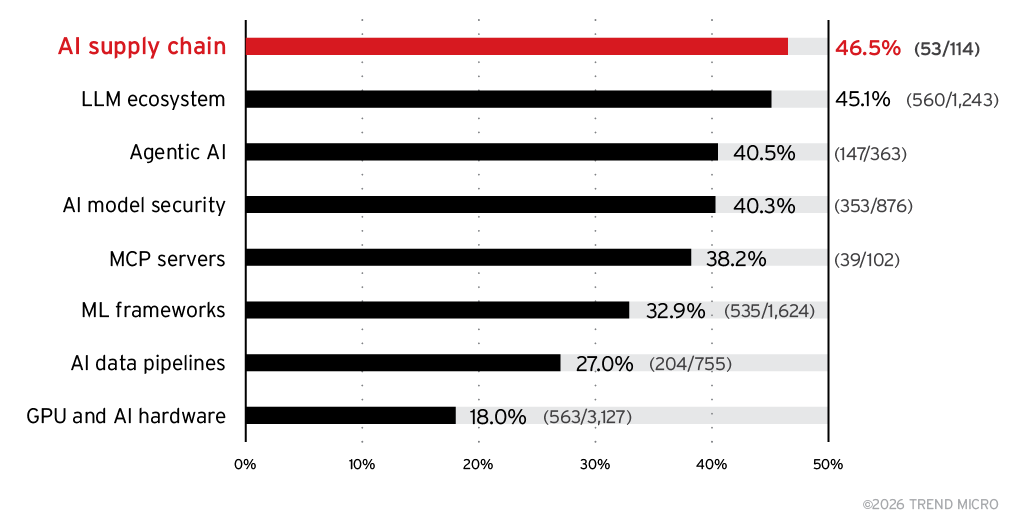

Nicht alle KI-Sicherheitslücken sind gleich

KI-Sicherheitslücken lassen sich in acht verschiedene Unterkategorien einteilen, die sich nicht gegenseitig ausschließen; eine einzelne CVE kann mehreren Unterkategorien zugeordnet werden.

- GPU- und KI-Hardware (3.127 CVEs, 51,4 %): Umfasst Nvidia-Treiber, CUDA-Bibliotheken, vGPU-Software und DGX-Plattformen. In erster Linie Probleme mit Speicherbeschädigungen, die eine Privilegienerweiterung und das Ausbrechen aus Containern ermöglichen.

- ML-Frameworks (1.624 CVEs, 26,7 %): Umfasst TensorFlow, PyTorch und MLflow. Das Hauptrisiko besteht in der Kompromittierung der Lieferkette durch bösartige Modelldateien, die eingebetteten Code ausführen.

- LLM-Tools und -Anwendungen (1.243 CVEs, 20,4 %): Spiegelt das explosive Wachstum nach ChatGPT wider. Langflow, vLLM, Dify, AnythingLLM wurden ohne ausgereifte Sicherheitsvorkehrungen eingesetzt. Code-Injection, SSRF und Path Traversal dominieren.

- Sicherheit von KI-Modellen (876 CVEs, 14,4 %): Umfasst Modelle, die Infrastruktur, Inferenz-Engines und Validierungssysteme bedienen. Ermöglicht Modelldiebstahl, feindliche Manipulation und unbefugten Zugriff.

- KI-Datenpipelines (755 CVEs, 12,4 %): Umfasst Datenaufnahme, Vorverarbeitung und Feature Engineering. Risiken sind Datenvergiftung, Exfiltration von Trainingsdaten und Beschädigung des ML-Lebenszyklus.

- Agentische KI (363 CVEs, 6,0 %): Umfasst Schwachstellen in autonomen KI-Systemen. Mängel in Schutzvorrichtungen und Ausführungsgrenzen schaffen neue Angriffsvektoren, wenn Agenten mit externen Systemen interagieren.

- KI-Lieferkette (114 CVEs, 1,9 %): Umfasst Paketmanager, Modellregister und Abhängigkeitsmanagement. Ermöglicht Angriffe auf die Lieferkette durch kompromittierte Modelle und bösartige Pakete.

- MCP-Server (102 CVEs, 1,7 %): Eine neue Unterkategorie, die 95 der 102 im Jahr 2025 entdeckten CVEs ausmacht. MCP schafft aufgrund seiner Konzeption Risiken durch Befehlsinjektionen.

Verteilung nach Schweregrad: Wo das tatsächliche Risiko liegt

Die Verteilung nach dem Schweregrad der KI-bezogenen Schwachstellen ergibt, dass fast die Hälfte aller bewerteten KI-CVE in den Bereich „hoch“ oder „kritisch“ fällt. Von den insgesamt 6.086 erfassten KI-Schwachstellen wurden 3.257 mit CVSS-Werten bewertet, wobei 11,1 % als kritisch (CVSS-Wert: 9,0+) und 37,9 % als hoch (CVSS-Wert: 7,0–8,9) eingestuft wurden. Zusammengenommen umfassen CVEs mit hohem und kritischem Schweregrad 1.593 Fälle, was 48,9 % der bewerteten Schwachstellen und 26,2 % aller KI-CVEs entspricht.

Neue KI-Komponenten bergen aufgrund ihrer raschen Einführung, komplexen Integrationen und uneinheitlichen Sicherheitsmaßnahmen ein unverhältnismäßig höheres Risiko. Die KI-Schwachstellenlandschaft in drei verschiedenen Phasen entwickelt (siehe Originalbeitrag).

Unsere wichtige Erkenntnis: Die Verlagerung von Schwachstellen in der Infrastruktur hin zu Schwachstellen auf Anwendungsebene lassen darauf schließen, dass Angreifer die Einführung von KI in der Produktion verfolgen.

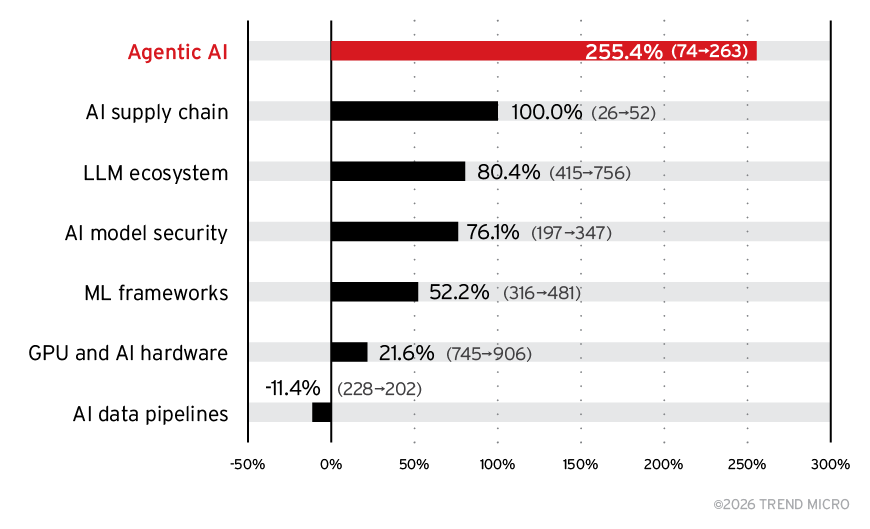

Die Zunahme der KI-Sicherheitslücken von 2024 bis 2025 gegenüber dem Vorjahr zeigt eine deutliche Beschleunigung, die eher auf strukturelle als auf zufällige Faktoren zurückzuführen ist. Agentische KI verzeichnete mit einem Anstieg von 74 auf 263 CVEs (+255,4 %) den größten Sprung. Im Gegensatz dazu gingen KI-Datenpipelines um 11,4 % zurück, und MCP-Server tauchten mit 95 CVEs als neue Angriffsfläche auf, nachdem sie 2024 noch nicht vertreten waren. Insgesamt spiegeln diese Verschiebungen eine sich rasch vergrößernde Angriffsfläche für KI wider, und zwar in allen wichtigen Unterkategorien. GPU- und KI-Hardware sowie ML-Frameworks haben sich während des gesamten Zeitraums stetig ausgeweitet, während das LLM-Ökosystem von 419 auf 756 CVEs im Jahr 2025 gestiegen ist.

Arten von Schwachstellen: CWE-Trends im gesamten KI-Stack

Die Untersuchung von Common Weakness Enumerations (CWEs) -- standardisierte Identifikatoren zur Klassifizierung der zugrunde liegenden Schwachstelle, die eine Software-Sicherheitslücke ausnutzbar macht – in KI-Systemen hilft dabei zu erkennen, welche Arten von systemischen Schwächen in verschiedenen Teilen des KI-Stacks am häufigsten vorkommen. Die Daten zeigen, dass jede wichtige KI-Unterkategorie ein unterschiedliches CWE-Profil aufweist, das durch ihre Architektur und ihr Betriebsmodell geprägt ist:

- GPU- und KI-Hardware: benötigen ein speichersicheres Patching.

- ML-Frameworks: Überprüfung der Modellherkunft erforderlich.

- LLM-Ökosystem: Eingabevalidierung entscheidend.

- MCP-Server: Strenge Zulassungsliste erforderlich.

Diese kategoriespezifischen Muster stimmen mit den 10 häufigsten AI-Schwachstellen überein, wobei XSS, Code-Injektion, Deserialisierung nicht vertrauenswürdiger Daten und OS-Befehls-Injection die Rangliste anführen. Einzelheiten auch dazu liefert der Originalbeitrag.

TrendAI™ Zero Day Initiative™ (ZDI) Bug-Bounty-Informationen

Die TrendAI™ Zero Day Initiative™ (ZDI) liefert ein wichtiges Frühwarnsystem, um reale Schwachstellen in KI-Systemen zu identifizieren, bevor sie in großem Umfang ausgenutzt werden können. Die 35 Meldungen zu KI-bezogenen Schwachstellen im Rahmen des Programms liefern einen fokussierten, hochgradig zuverlässigen Datensatz, der den umfassenderen CVE-Korpus ergänzt, weil er Schwachstellen erfasst, die durch aktive offensive Forschung entdeckt wurden.

Die neuesten ZDI-Ergebnisse bestätigen ein klares Muster: KI-Infrastrukturen und unterstützende Komponenten werden zu hochwertigen Zielen: Nvidia ist mit 15 Fällen der am häufigsten betroffene Anbieter und macht 43 % aller KI-bezogenen ZDI-Fälle aus, und Tencent ist in acht Fällen (23 %) betroffen. Die Vielfalt der Anbieter lässt auf eine schnell wachsende und global verteilte Angriffsfläche für KI schließen.

Es fällt auch auf, dass die Verteilung des Schweregrads der KI-Entdeckungen von ZDI deutlich über dem Branchen-Baseline-Wert liegt. Von den 35 über eingereichten Fällen erhielten acht (23 %) eine kritische Bewertung (CVSS-Score: 9,0+), was mehr als doppelt so viel ist wie die kritische Rate im breiteren KI-CVE-Korpus (nur 11,1 %). Fazit: Fehler, die durch koordinierte offensive Forschung gefunden werden, sind mit größerer Wahrscheinlichkeit sofort ausnutzbar und wirkungsvoll und stehen daher im Mittelpunkt des Interesses von Angreifern.

Zum ersten Mal umfasste der Pwn2Own Berlin eine eigene Kategorie für KI-Infrastruktur, die unter anderem auf den Nvidia Triton Inference Server abzielte. Diese Veränderung rückte KI-Systeme offiziell in den Fokus des Wettbewerbs, der bisher Browsern, Hypervisoren, Automobilsystemen und industriellen Steuerungen vorbehalten war.

Fazit zu den Schwachstellen

Das sich entwickelnde KI-Ökosystem ist nicht mehr durch isolierte Schwachstellen gekennzeichnet, sondern durch eine sich rasch ausweitende und zunehmend ungleichmäßige Schwachstellenlandschaft. Unsere Analyse zeigt, dass sich die Risiken auf bestimmte Technologien konzentrieren. Von Schwachstellen auf Hardwareebene und Risiken in der Lieferkette bis hin zum Aufkommen völlig neuer Angriffsflächen wie MCP-Servern nehmen die KI-bezogenen Schwachstellen nicht nur an Zahl zu, sondern häufen sich auch so, dass sie systemische, kaskadierende Risiken über den gesamten Stack hinweg verursachen. Die folgenden Punkte zeigen, worauf Verteidiger ihre Aufmerksamkeit richten müssen:

- Die Unterkategorie GPU- und KI-Hardware dominiert die Angriffsfläche.

- Cross-Site-Scripting liegt an der Spitze, dicht gefolgt von Code-Injection.

- Die Kategorie „KI-Lieferkette” weist die höchste Schweregradkonzentration auf.

- Schwerwiegende Schwachstellen nehmen zu.

- MCP ist die neue Grenze.

- 26,2 % der bewerteten KI-CVEs sind schwerwiegend.

- Chinesische KI-Plattformen sind in westlichen Schwachstellendatenbanken möglicherweise unterrepräsentiert.

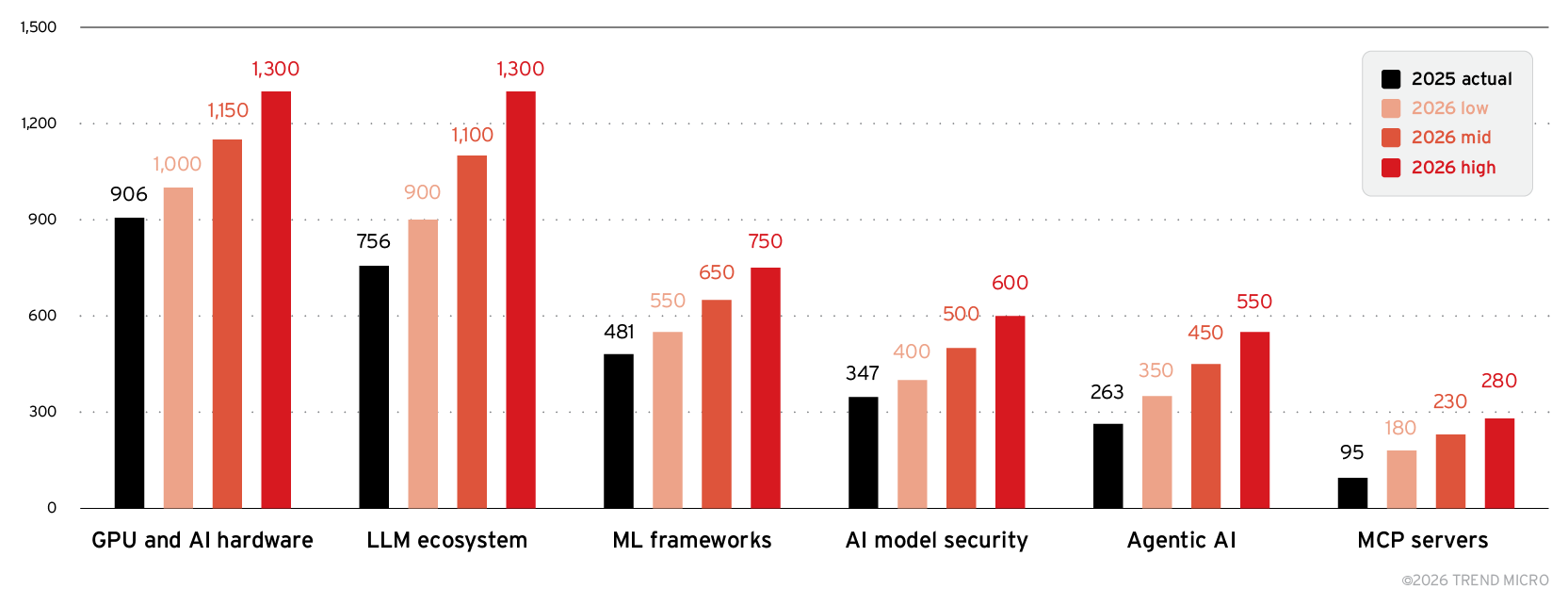

Prognosen zu KI-Sicherheitslücken 2026

Die Beschleunigung der AI-bezogenen Schwachstellen wird sich 2026 noch weiter verstärken, mit einer Prognose von 2.800 bis 3.600 KI-CVEs – ein dramatischer Anstieg von 31 % bis 69 % gegenüber 2025.

Die Prognose im Bild zeigt auch eine zunehmende Risikoverteilung über den gesamten Stack hinweg, wobei neue Kategorien wie MCP-Server und agentenbasierte KI das schnellste Wachstum gegenüber dem Vorjahr erwarten lassen.

Diese Prognose unterstreicht eine entscheidende Tatsache: Mit der zunehmenden Reife der KI-Fähigkeiten nehmen auch die Komplexität und das Ausmaß der darauf abzielenden Bedrohungen zu. Statische, Compliance-orientierte Maßnahmen reichen nicht mehr aus. Sicherheitsteams müssen sich zu adaptiven, mehrschichtigen Strategien weiterentwickeln, die in der Lage sind, neue Risiken zu antizipieren und zu mindern. Dieser Bericht beschreibt diese Risiken im Detail und bietet Leitlinien zur Stärkung der Widerstandsfähigkeit in einem zunehmend komplexen und vernetzten KI-Ökosystem.

Alle Details (einschließlich der Werte) zur Analyse können Sie im Originalbeitrag nachlesen, ebenso wie Daten zur Methodologie und Datenquellen.