Cloud

Kontrolle und Schutz von KI-Skills

Bedrohungen und Risiken von KI-Skills sind für die meisten Sicherheitstools blinde Flecken. Sie müssen die Semantik von KI-Skill-Inhalten verstehen, um damit verbundene Risiken erkennen und bekämpfen zu können -- neues Kill-Chain-Modell und Maßnahmen.

KI-Skills, also ausführbare Wissensartefakte, kombinieren die für Menschen lesbaren Anweisungen mit LLM-interpretierbarer Logik. Sie stellen eine neue Angriffsfläche dar, die besondere Aufmerksamkeit im Bereich der Sicherheit erfordert. Je mehr Unternehmen ihr operatives Fachwissen in ausführbare Wissensartefakte umwandeln, desto größer wird der Wert dieser Ressourcen für Angreifer. Wenn sie es schaffen, sich Zugang zu SOC-Skills zu verschaffen, können sie die Logik der Alarmtriage, Korrelationsregeln, Verfahren zur Reaktion auf Vorfälle und Berichtsmetriken erlernen. Die Risiken und Potenziale der KI-Skills haben wir im Beitrag „KI-Skills als neue Angriffsfläche“ dargelegt.

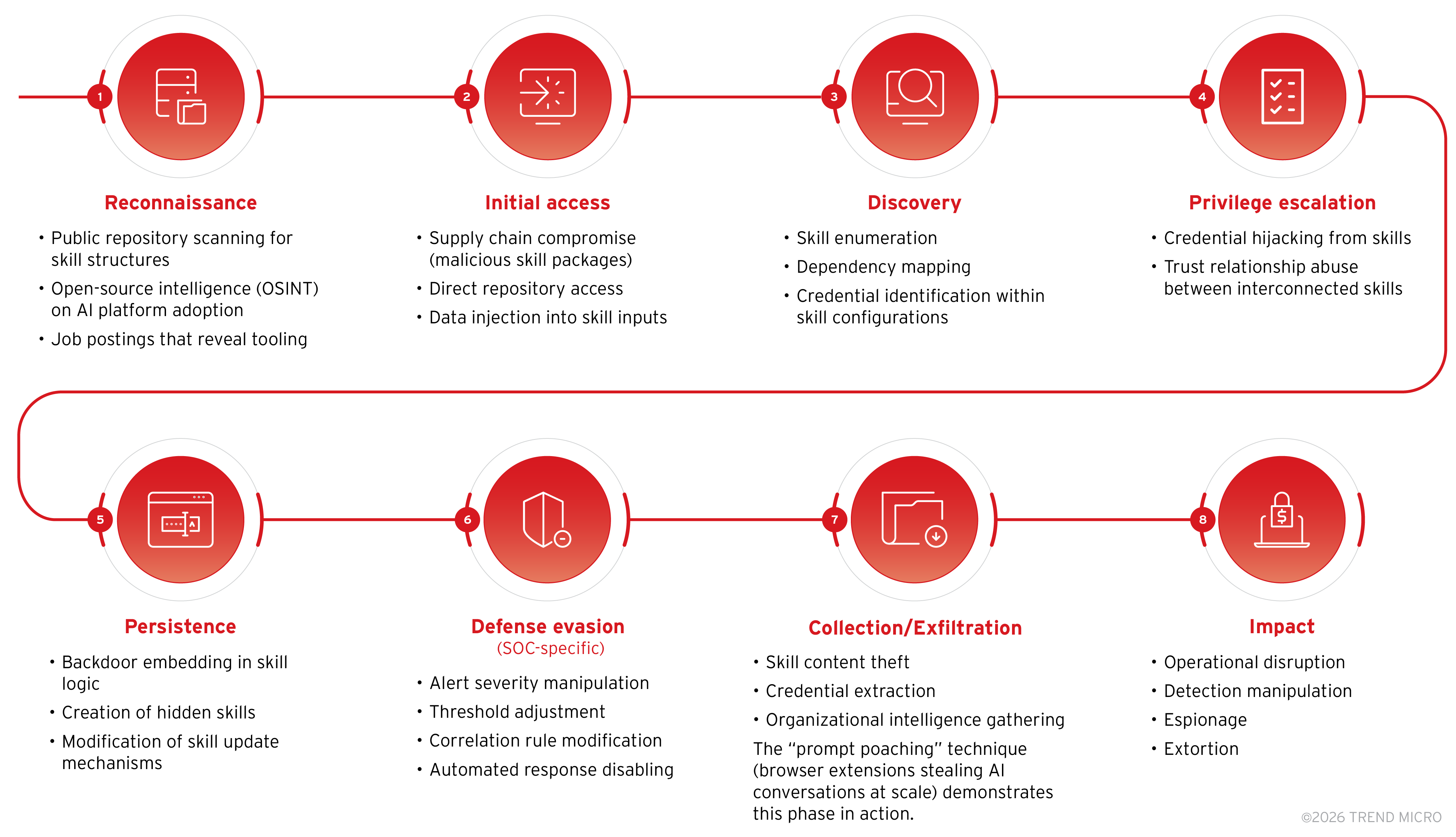

Herkömmliche Kill-Chain-Modelle, die für Bedrohungen wie Network Intrusion, Malware oder die Kompromittierung von Anmeldedaten entwickelt wurden, decken die besonderen Merkmale von Angriffen auf KI-Skills nicht vollständig ab.

Um diese Lücke zu schließen, schlagen wir ein achtphasiges Kill-Chain-Modell vor, das speziell auf die Kompromittierung von KI-Skills zugeschnitten ist und den gesamten Lebenszyklus widerspiegelt, in dem Angreifer Skills entdecken, ausnutzen und einsetzen können, um sowohl taktische als auch strategische Ziele zu erreichen.

Detection and Response Framework

Als Ergänzung zur achtstufigen Kill-Chain gibt es auch wichtige Indikatoren und Maßnahmen zur Eindämmung von Angriffen auf KI-Skills.

Erkennungsmöglichkeiten

Unternehmen sollten mehrere sich ergänzende Signale überwachen, die jeweils auf eine andere Phase oder Technik im Kompromittierungs-Lebenszyklus hinweisen. Zusammen bilden diese Signale ein umfassendes Frühwarnsystem für KI-gesteuerte Bedrohungen.

Erkennungskategorie |

Indikatoren |

Überwachung der Integrität von Skills |

|

Anomalien bei der Ausführung |

|

Zugriffsmuster für Anmeldedaten |

|

Anomalien im Datenfluss |

|

Manipulation der SOC-Logik |

|

Tabelle 1. Indikatoren zur Erkennung von Kompromittierungen der KI-Skills

Empfohlene Erkennungsarchitektur

Die in Tabelle 2 dargestellte mehrschichtige Erkennungsarchitektur ist auf unsere achtphasige Kill Chain abgestimmt.

Ebene |

Datenquelle |

Erkennungsfokus |

Repository |

|

|

Plattform |

|

|

Netzwerk |

|

|

Anmeldedaten |

|

|

SOC-Ausgabe |

|

|

Tabelle 2. Mehrschichtige Erkennungsarchitektur, abgestimmt auf die achtphasige Kill Chain

Den Phasen zugeordnete Abwehrmaßnahmen

Um die Leitlinien dieses Modells weiter zu operationalisieren, lassen sich konkrete Abwehrstrategien direkt den einzelnen Phasen der vorgeschlagenen Kill Chain zuordnen:

Phase |

Primäre Kontrolle |

Erkennungsmöglichkeit |

Aufklärung |

|

|

Erster Zugriff |

|

|

Entdeckung/Eskalation |

|

|

Persistenz |

|

|

Umgehung von Abwehrmaßnahmen |

|

|

Exfiltration/Auswirkung |

|

|

Tabelle 3. Maßnahmen zur Risikominderung, die den acht Phasen der Kill Chain zugeordnet sind

Sicherheitsgrundsätze zum Schutz von KI-Skills

Über die beschriebenen technischen Abhilfemaßnahmen hinaus sollten Unternehmen etablierte Sicherheits-Best-Practices in Erwägung ziehen und diese auf die Integration und Verwaltung von KI-Skills anwenden:

- Behandeln Sie Skills als sensibles geistiges Eigentum. Wenden Sie während des gesamten Lebenszyklus Risikobewertungs- und Risikominderungsverfahren an. Implementieren Sie eine angemessene Zugriffskontrolle durch geeignete Klassifizierung und Kennzeichnung, Versionierung und Change-Management.

- Trennen Sie Anweisungen von nicht vertrauenswürdigen Daten. Viele Skills basieren auf vom Benutzer bereitgestellten Daten, und das schafft Möglichkeiten zur Ausnutzung. Halten Sie eine klare Trennung zwischen Skills-Logik, -Daten und nicht vertrauenswürdigen externen Daten ein.

- Beschränken Sie die Ausführungsrechte. Wenden Sie bei der Entwicklung von Skills das Prinzip der geringsten Privilegien an. Schränken Sie den Ausführungskontext auf die minimal erforderlichen Berechtigungen ein, um eine laterale Bewegung während einer Kompromittierung zu verhindern.

- Validieren Sie anhand von Angriffsszenarien. Machen Sie sich mit der Angriffsfläche des Unternehmens vertraut. Testen Sie vor der Bereitstellung, wie böswillige Benutzer die Funktionslogik der Skills ausnutzen könnten.

- Implementieren Sie ein umfassendes Monitoring. Überwachung, Protokollierung und Audits sind für den sicheren Betrieb jedes Geschäftsprozesses von entscheidender Bedeutung, insbesondere in KI-gestützten Umgebungen, in denen traditionelle Sicherheitsgrenzen verschwimmen.

Fazit

Speziell für SOCs gefährdet eine Kompromittierung der KI-Skills die Grundlagen der Verteidigungsmaßnahmen. Angreifer, die die KI-Skills von SOCs verstehen, können lernen, wie sie Warnmeldungen unterdrücken, Korrelationsregeln umgehen, automatisierte Reaktionen deaktivieren und Berichte manipulieren können, wodurch sie die Verteidiger effektiv blind machen.

Unternehmen sollten daher unverzüglich Maßnahmen ergreifen: Dazu gehören die Bestandsaufnahme der vorhandenen Kompetenzen, Klassifizierung nach Sensibilität und Zugriffsanforderungen, Festlegung normaler Ausführungsmuster, Isolierung von Kompetenzen mit hohen Berechtigungen und kontinuierliche Überwachung auf Anomalien.

Über die Autoren

Das Forward-Looking Threat Research Team von TrendAI™ Research hat sich auf die Erforschung von Technologien für die nächsten ein bis drei Jahre spezialisiert hat, wobei der Schwerpunkt auf drei verschiedenen Aspekten liegt: der technologischen Entwicklung, ihren sozialen Auswirkungen und kriminellen Anwendungen.