Cloud

NVIDIA Riva-Lücken: Risiken für Services

Fehlkonfigurationen in NVIDIA Riva-Installationen mit zwei Schwachstellen erzeugen neue Risiken eines nicht autorisierten Zugangs und Missbrauch oder Diebstahl von KI-Services. Wir beschreiben die Probleme und haben Best Practices zum Schutz davor.

Zusammenfassung:

- Mehrere Unternehmen, die Riva in Cloud-Umgebungen einsetzen, haben exponierte NVIDIA Riva API-Endpunkte. Wir haben zwei Schwachstellen (CVE-2025-23242 und CVE-2025-23243) identifiziert, die zu dieser Gefährdung beitragen.

- Falsch konfigurierte Riva-Installationen ermöglichen unautorisierten Zugriff, so dass Angreifer GPU-Ressourcen und API-Schlüssel ohne Einschränkungen missbrauchen können. Exponierte APIs erhöhen zudem das Risiko von Datenlecks, Denial-of-Service (DoS)-Angriffen und Systemunterbrechungen.

- Unternehmen, die KI-gestützte Dienste mit proprietären Modellen betreiben, könnten dem Risiko des Diebstahls geistigen Eigentums ausgesetzt sein, insbesondere wenn ihre Modelle oder Inferenzdienste durch falsch konfigurierte APIs exponiert werden.

- Unternehmen sollten ihre Implementierungen überprüfen, insbesondere solche, die standardmäßige oder falsch konfigurierte Einstellungen in Cloud-Umgebungen verwenden.

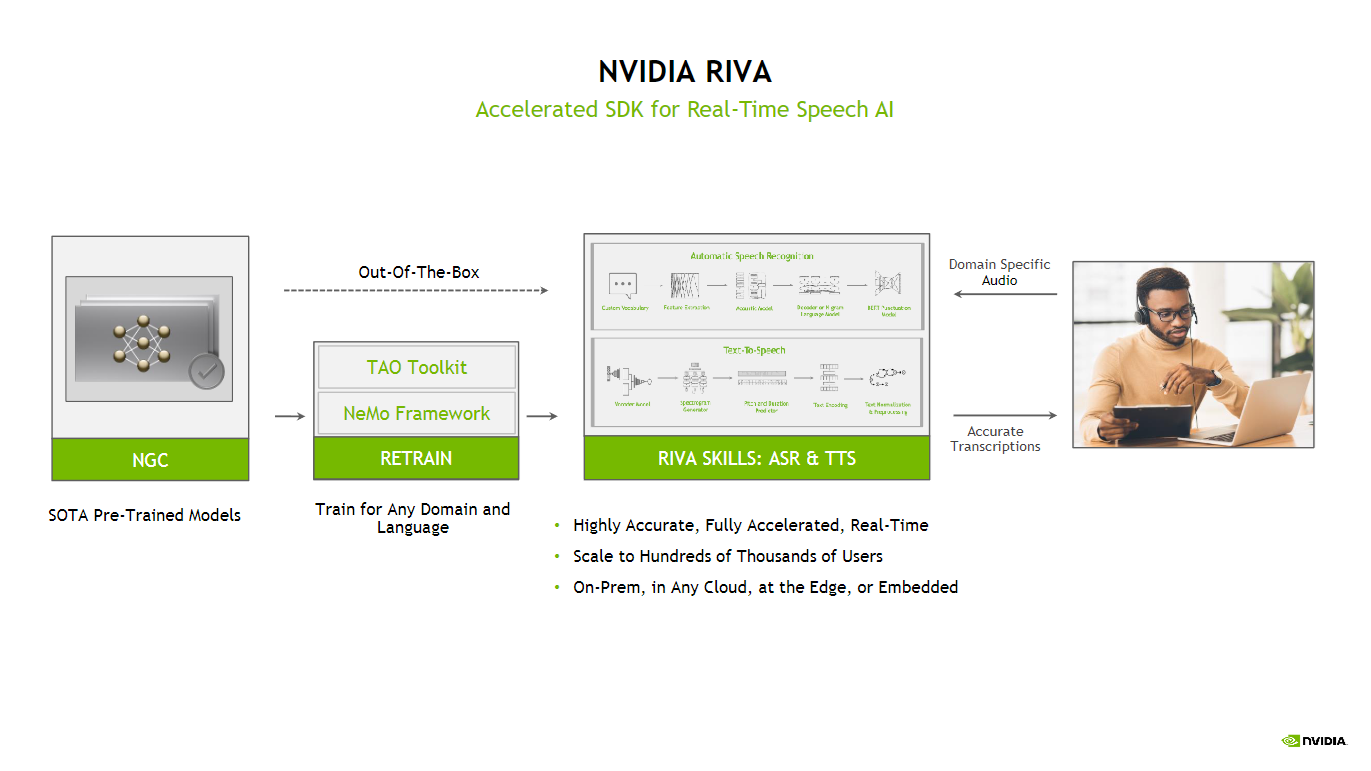

Die Grafik-Chip-Familie NVIDIA Riva stellt einen Durchbruch in der KI-Spracherkennung, -übersetzung und -synthese dar, der es Unternehmen ermöglicht, hochleistungsfähige Modelle in verschiedene KI-Anwendungen wie Transkription, Sprachassistenten und Konversation zu integrieren.

Die Implementierung bringt jedoch neue und einzigartige Sicherheitsherausforderungen mit sich, denn der überhastete Einsatz modernster Spracherkennungsfunktionen kann Unternehmen Sicherheitsrisiken aussetzen. Die komplexe Bereitstellungsarchitektur und die komplizierten Schichten von KI-Modellen und APIs bieten eine große Angriffsfläche, die eine sorgfältige Prüfung erfordert.

Wir haben ein bedenkliches Sample von exponierten NVIDIA Riva API Endpunkten in Cloud-Umgebungen mehrerer Unternehmen entdeckt. Diese Instanzen sind ein Beispiel für Sicherheitslücken, da sie ohne Authentifizierungsschutz arbeiten und für jeden potenziellen Angreifer zugänglich sind.

Diese Probleme würden es jedem ermöglichen, kostenlos auf Riva-Dienste zuzugreifen, z.B. auf teure Hardware-Ressourcen und kostenpflichtige API-Schlüssel. Eine weitere Konsequenz ist die Offenlegung von Informationen über die zugrunde liegenden Dienste, was sie anfällig für Denial-of-Service (DoS) und Speicherangriffe gegen den Triton Inference Server macht, wenn eine fortschrittliche Konfiguration angewendet wird.

Wir haben zwei Schwachstellen (CVE-2025-23242 und CVE-2025-23243) entdeckt, die erheblich zu der Exponierung beitragen. Dem verantwortungsvollen Veröffentlichungsprozess gemäß und in Zusammenarbeit mit der Trend Zero Day Initiative™ (ZDI) wurden die Lücken geschlossen und unter ZDI-25-145 und ZDI-25-144 publik gemacht.

Um diese Schwachstellen zu verstehen, sollte mit dem NVIDIA Riva Quick Start Guide begonnen und ein NGC Kommandozeilenprogramm heruntergeladen werden. Das Initialisierungsskript lädt die erforderlichen Container-Images und KI-Modelle aus der NVIDIA Artifact Registry herunter.

Bild 1. Die NVIDIA Riva Pipeline (Quelle: NVIDIA)

Sobald die Initialisierung abgeschlossen ist, kann man den Riva-Dienst mit dem Befehl „bash riva_start.sh“ starten. Danach wartet der Riva-Server auf gRPC-Verbindungen über Port 50051. Die zugrunde liegende Implementierung kann aufgrund der Verwendung von Bibliotheken von Drittanbietern verborgen bleiben. Sie dient als praktisches Komplettpaket und sofort einsatzbereite Lösung für komplexe Software. Mehrere exponierte Ports vom Container zum Host sind geöffnet und lauschen auf 0.0.0.0 (alle IP-Adressen). Diese Netzwerkeinstellung ist ohne Firewall-Einstellungen für alle zugänglich.

Das Riva gRPC-API-Protokoll wird mit aktivierter gRPC-Reflexion ausgeliefert, sodass jeder den Typ des Dienstes identifizieren und das binäre Protokoll rekonstruieren kann. Dies ist an sich kein Problem, doch wenn es offen zugänglich ist, vereinfacht es die Identifizierung des Dienstes.

Es stellt sich die Frage, ob diese gRPC-Endpunkte gesichert werden können. Selbst wenn alle Zertifikatparameter in der Datei „config.sh“ aus dem NVIDIA QuickStart-Paket angegeben sind, erzwingt der gRPC-Server jedoch nur eine TLS/SSL-Verbindung und verschlüsselt den Datenverkehr zwischen dem Client und dem Server. Das bedeutet, dass man überprüfen kann, ob der Server tatsächlich der ist, für den er sich ausgibt. Allerdings überprüft niemand den Client, und jeder kann den Dienst nutzen! Dieses Verhalten kann ein falsches Gefühl der Sicherheit vermitteln, während die Dienste für jedermann zugänglich sind.

Der Riva-Server kommuniziert intern mit dem Triton Inference Server. Er übersetzt API-Anfragen lediglich in eine Sprache, die der Triton Inference Server versteht. Diese Ports geben aufgrund der Container-Konfiguration die Binärdatei des Triton Inference Servers frei. Dadurch sind die REST- und gRPC-Triton-Inference-Server-APIs für alle verfügbar. Selbst wenn der gRPC-Endpunkt des Riva-Servers erfolgreich gesichert ist, könnte er durch die Übersetzung der Anfragen an die Triton-Inference-Server-Endpunkte vollständig umgangen werden. Insbesondere einige der Endpunkte stellen ein erhebliches Sicherheitsrisiko dar, wenn der Triton Inference Server mit erweiterten Einstellungen konfiguriert ist, da sie inhärente Schwachstellen und zuvor offen gelegte Sicherheitslücken aufdecken könnten. In Erweiterung unserer früheren Untersuchungen haben wir 54 eindeutige IP-Adressen mit offengelegten NVIDIA Riva-Diensten gefunden, die alle zu mehreren Cloud-Dienstanbietern gehören.

Best Practices und Empfehlungen

Wir empfehlen allen Administratoren von Riva-Diensten, ihre Konfiguration zu überprüfen und sicherzustellen, dass sie die neueste Version des Riva-Frameworks verwenden. Zusätzlich zu NVIDIAs Best Practices sollten Sie die folgenden Sicherheitsmaßnahmen in Betracht ziehen:

- Implementieren Sie ein sicheres API-Gateway und geben Sie nur die vorgesehenen gRPC- oder REST-API-Endpunkte frei. Dies verhindert unbefugten Zugriff und schützt die Backend-Dienste.

- Wenden Sie eine Netzwerksegmentierung an, indem Sie den Zugriff auf den Riva Server und den Triton Inference Server auf vertrauenswürdige Netzwerke beschränken. Dies hilft, die Angriffsfläche zu minimieren und verhindert unbefugten Zugriff aus dem Internet.

- Setzen Sie auf starke Authentifizierungsmechanismen und eine rollenbasierte Zugriffskontrolle, um sicherzustellen, dass nur autorisierte Benutzer und Dienste mit Riva APIs interagieren können. Ziehen Sie Zero-Trust-Ansätze in Betracht, wie z.B. identitätsbasierten Zugriff, um sicherzustellen, dass nur authentifizierte und autorisierte Benutzer und Geräte mit Riva-Diensten interagieren können.

- Überprüfen und modifizieren Sie die Container-Einstellungen, um unnötige Dienste zu deaktivieren, ungenutzte Ports zu entfernen und die privilegierte Ausführung einzuschränken. Dies verhindert, dass Angreifer exponierte Dienste oder Fehlkonfigurationen ausnutzen können.

- Aktivieren Sie die Protokollierung und Überwachung von Riva und Triton Inference Server, um ungewöhnliche Zugriffsmuster, verdächtige Aktivitäten oder möglichen Missbrauch zu erkennen.

- Ziehen Sie eine Drosselung von API-Anfragen in Betracht, insbesondere wenn gRPC- oder REST-Endpunkte externen Netzwerken ausgesetzt oder in Umgebungen integriert sind, in denen Bedrohungsakteure Brute-Force- oder DoS-Angriffe versuchen könnten.

- Halten Sie das Riva Framework, den Triton Inference Server und die Abhängigkeiten auf dem neuesten Stand, um bekannte Schwachstellen zu entschärfen und vor neu entdeckten Exploits zu schützen.