Social Media

Kriminelle nutzen gestohlene Identitäten und Deepfakes

Das zunehmende Auftreten von Deepfake-Angriffen verändert die Bedrohungslandschaft erheblich. Die dafür erforderlichen Tools und Dienste sind zugänglich und verleihen Angriffen wie die BEC und die Umgehung von Identitätsprüfungen eine neue Dimension.

Bereits 2020 hatten wir zusammen mit Europol und dem United Nations Interregional Crime and Justice Research Institute (UNICRI) die böswillige Nutzung künstlicher Intelligenz beschrieben und den Einsatz und Missbrauch von Deepfake-Technologien durch Cyberkriminelle vorhergesagt. Leider hat es nicht lang gedauert, bis die Vorhersage eintraf - derzeit beobachten wir bereits Angriffe.

Die häufiger werdenden Deepfake-Angriffe verändern die Bedrohungslandschaft für Unternehmen, Finanzinstitute, Prominente, Politiker und sogar für normale Bürger erheblich. Der Einsatz von Deepfakes verleiht Angriffen wie BEC, die Kompromittierung von Geschäfts-Mails, und der Umgehung der Identitätsüberprüfung eine neue Dimension.

Es gibt mehrere Voraussetzungen und Gründe für den Erfolg dieser Angriffe:

- Alle technischen Grundlagen sind vorhanden. Der Quellcode für die Deepfake-Erzeugung ist öffentlich und steht jedem zur Verfügung, der ihn nutzen möchte.

- Die Zahl der öffentlich zugänglichen Bilder reicht böswilligen Akteure aus, um mit Hilfe von Deepfake-Technologien Millionen falscher Identitäten zu erstellen.

- Kriminelle Gruppen sind Vorreiter in der Nutzung solcher Technologien und diskutieren regelmäßig über deren Einsatz, um die Effektivität bestehender Geldwäsche- und Monetarisierungssysteme zu verbessern.

- Es lässt sich ein Trend ausmachen, Deepfakes in neueren Angriffsszenarien einzusetzen, z.B. bei Social-Engineering-Angriffen, für die sie eine wichtige technologische Grundlage darstellen.

Gestohlene Identitäten bei Deepfake-Werbebetrug

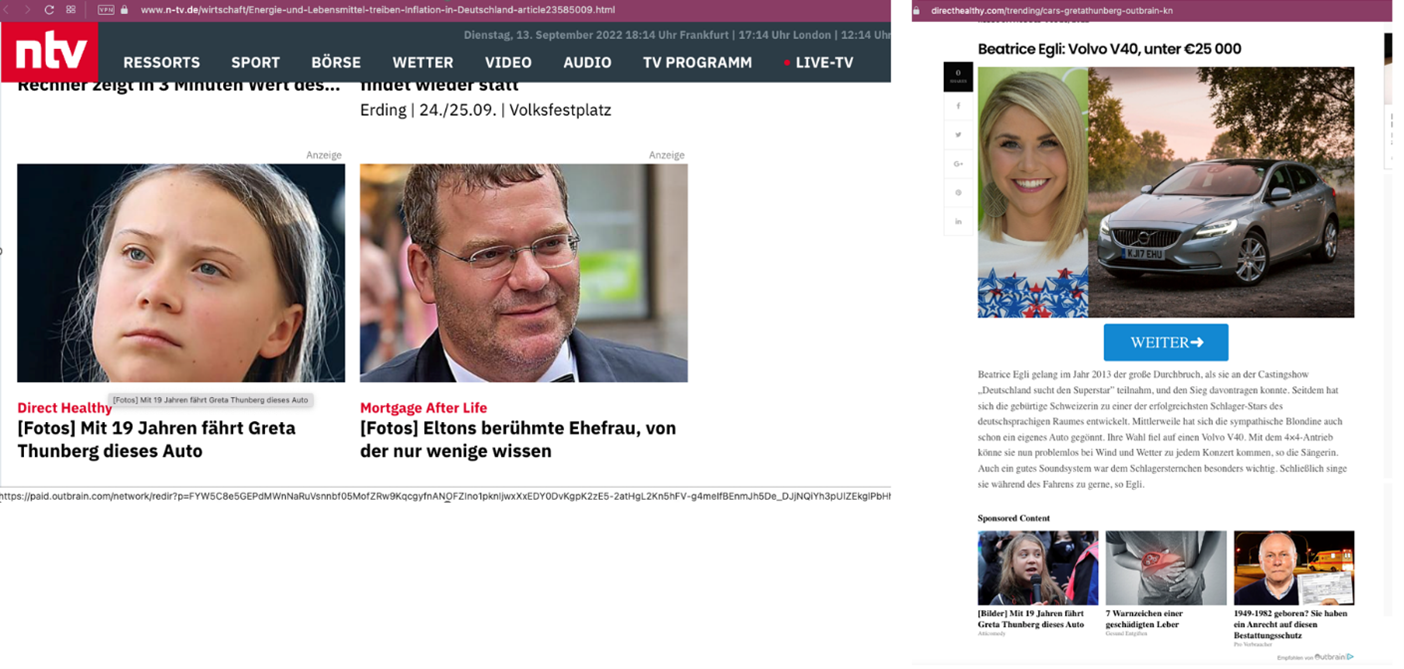

Es ist mittlerweile üblich, Fotos berühmter Persönlichkeiten in zweifelhaften Kampagnen zur Suchmaschinenoptimierung (SEO) auf Nachrichten- und Social-Media-Seiten zu verwenden. In der Regel stehen die Werbungen in irgendeiner Weise mit dem Fachgebiet des ausgewählten Prominenten in Verbindung und sind speziell darauf ausgerichtet, Nutzer zu ködern und sie dazu zu bringen, Links unter den Bildern anzuklicken.

Das Beispiel zeigt einen Screenshot einer Werbung mit bekannten Persönlichkeiten, die wahrscheinlich nichts von ihrem „Einsatz“ wissen. Wenn ein Nutzer diese Anzeigen auswählt, erscheint eine Seite mit einer Automobilwerbung (wie auf der rechten Seite).

Skrupellose Werbekonzerne nutzen diese Art von Medieninhalten schon seit Jahren für verschiedene Monetarisierungsmodelle. In letzter Zeit gab es hier jedoch interessante Entwicklungen und einen Wandel bei der Technologie, die diese Kampagnen ermöglicht. Einige Digitale-Medien- und SEO-Monetarisierungsgruppen nutzen öffentlich geteilte Medieninhalte, um Deepfake-Modelle berühmter Personen zu erstellen und die gefälschten Inhalte für verschiedene Werbekampagnen einzusetzen.

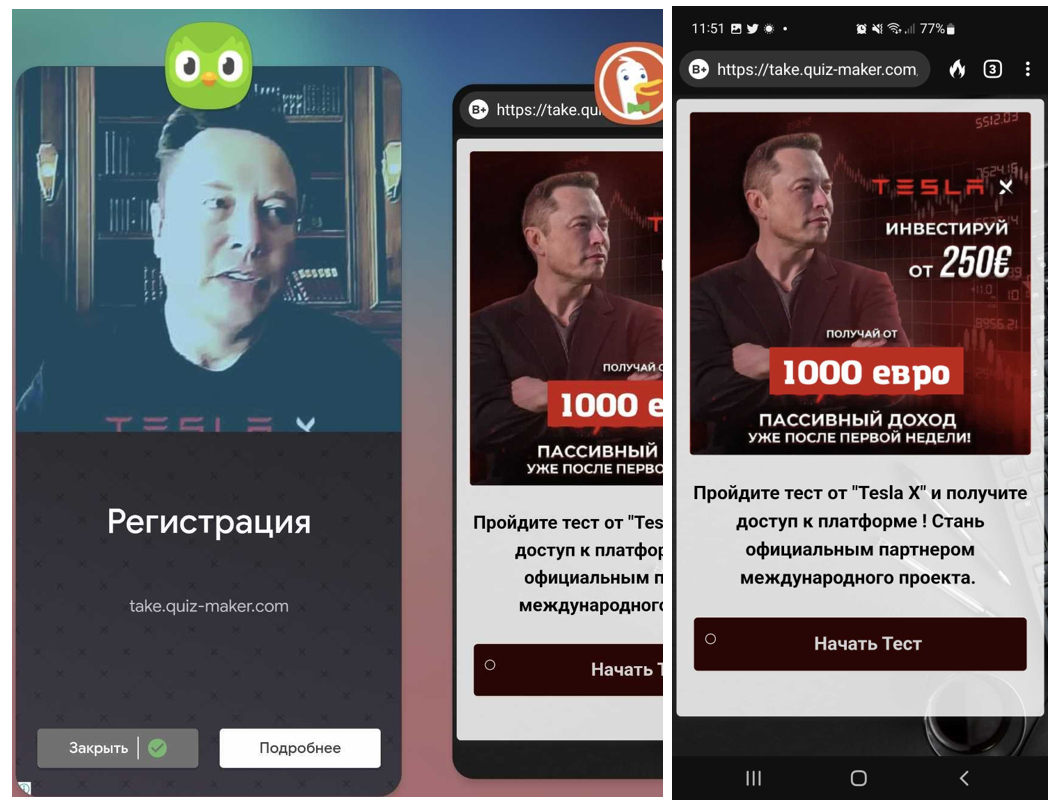

Wir fanden auch Werbung in legitimen und beliebten mobilen Anwendungen, die nicht nur statische Bilder, sondern auch Deepfake-Videos von Elon Musk verwendeten, um für „finanzielle Investitionsmöglichkeiten“ zu werben.

Die nächste Eskalationsstufe für Deepfakes ist die Fähigkeit, Videogespräche zu führen und sich dabei als bekannte Personen auszugeben.

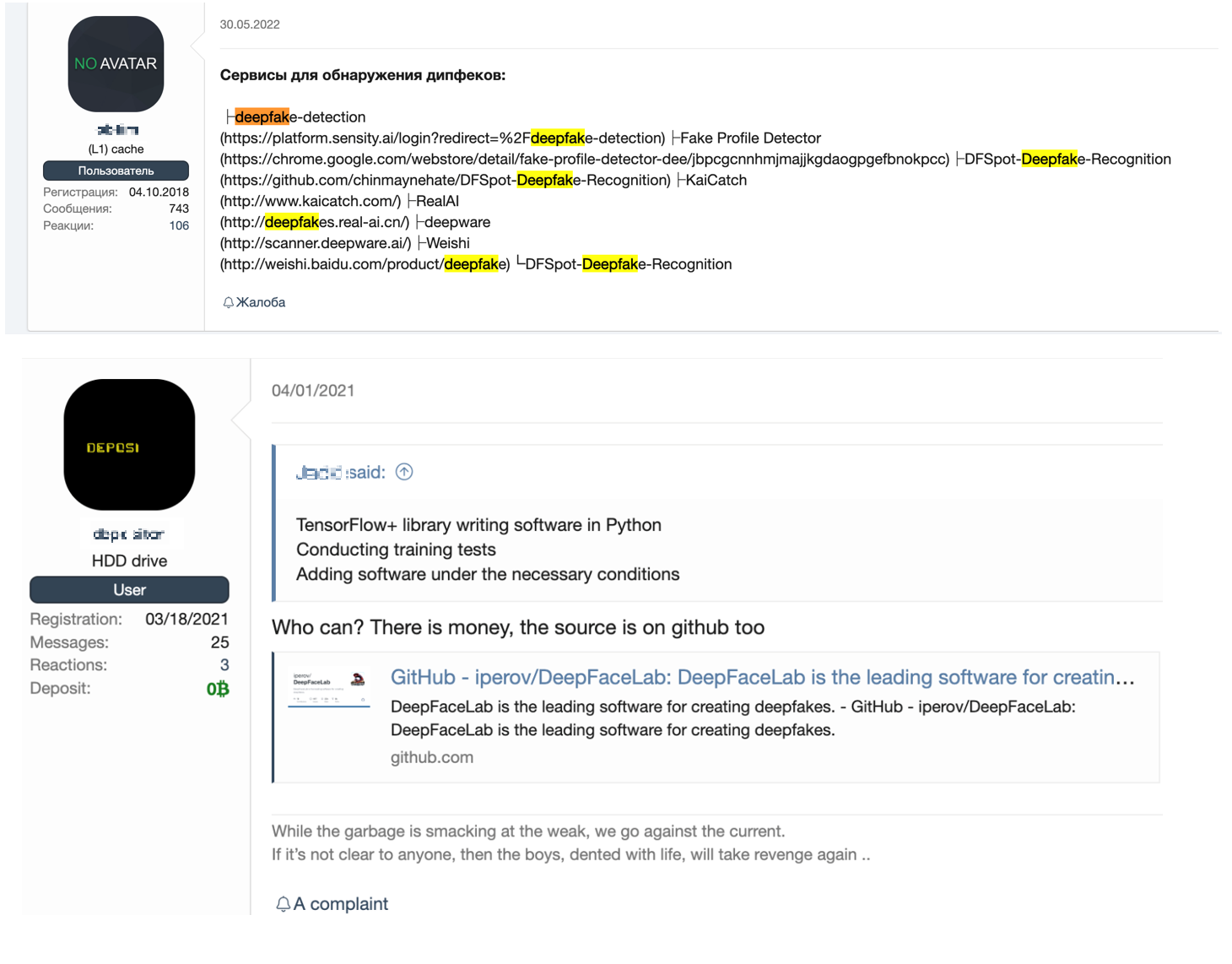

Das Thema Deepfake-Services ist in Untergrundforen sehr beliebt. In diesen Diskussionsgruppen sehen wir, dass viele Nutzer Online-Banking und die Überprüfung digitaler Finanzen im Visier haben. Es ist wahrscheinlich, dass Kriminelle, die an diesen Diensten interessiert sind, bereits über Kopien von Ausweisdokumenten der Opfer verfügen. Sie benötigen aber auch einen Video-Stream der Opfer, um Konten zu stehlen oder zu erstellen, die sie später für bösartige Aktivitäten wie Geldwäsche oder illegale Finanztransaktionen nutzen können.

Deepfakes im Untergrund

Die kriminellen Angriffe im Untergrund, bei denen Verifizierungswerkzeuge und -techniken eingesetzt werden, haben eine bemerkenswerte Entwicklung durchlaufen. So gibt es beispielsweise schon seit geraumer Zeit Dienste zur Überprüfung von Konten. Mit der Entwicklung des elektronischen Geschäftsverkehrs, bei dem moderne Technologien und Online-Chat-Systeme zur Identitätsüberprüfung eingesetzt werden, haben die Kriminellen jedoch auch ihre Techniken weiterentwickelt und neue Methoden zur Umgehung dieser Überprüfungssysteme entwickelt.

Bereits vor mehr als einem Jahr entdeckten wir in Untergrundforen Suchanfragen nach „Deepfake-Spezialisten“ für Kryptobörsen und persönliche Konten. Auch sind einige Tools für die Deepfake-Produktion schon seit einiger Zeit online verfügbar, zum Beispiel auf GitHub. Diese Tools für Deepfake und deren Erkennung stoßen in Untergrundforen auf Aufmerksamkeit.

Kürzlich machte der Fall des Deepfakes eines Kommunikationsmanagers der Kryptowährungsbörse Binance Schlagzeilen. Die Fälschung wurde verwendet, um Vertreter von Kryptowährungsprojekten in Zoom-Anrufen zu täuschen.

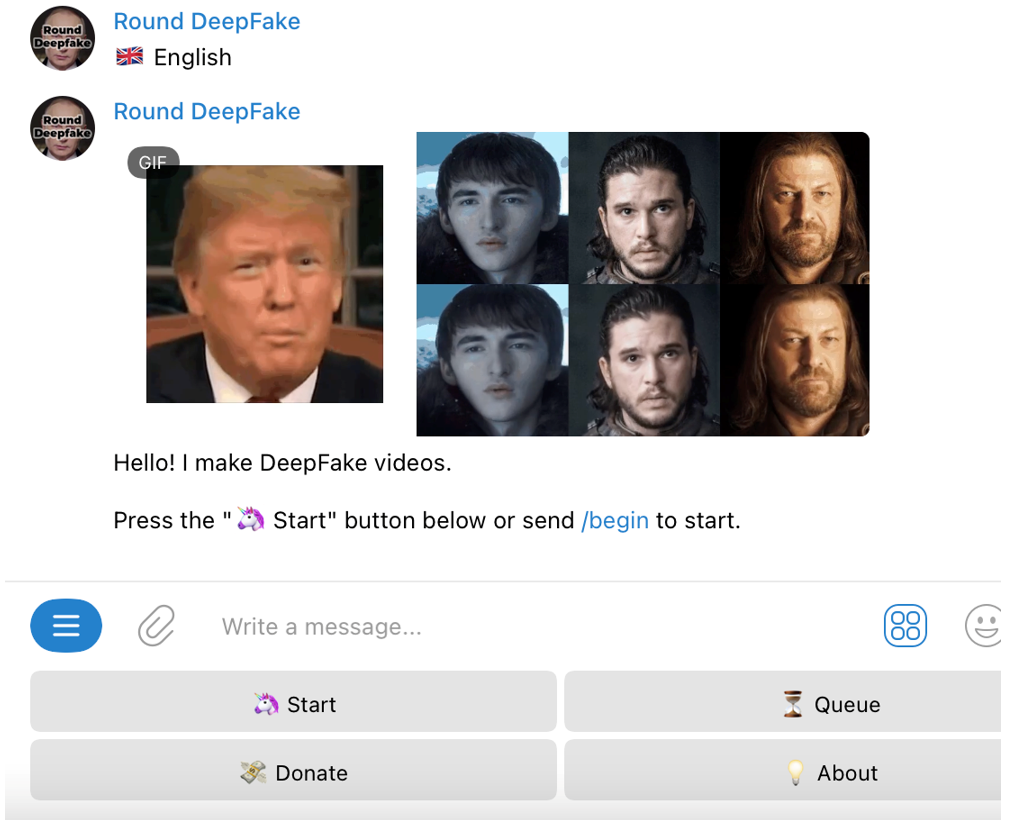

Es gibt es auch leicht zu bedienende Bots, die das Erstellen von Deepfake-Videos noch einfacher machen. Ein Beispiel ist der Telegram-Bot RoundDFbot.

Diese Deepfake-Videos werden bereits genutzt, um Personen des öffentlichen Lebens in Schwierigkeiten zu bringen. Hochrangige Regierungsbeamte, bekannte Persönlichkeiten aus der Wirtschaft und andere Prominente, von denen viele hochauflösende Fotos und Videos online sind, lassen sich am leichtesten erreichen, und Social-Engineering-Betrug mit deren Gesichtern und Stimmen ist bereits weit verbreitet.

Deepfakes in bestehenden Angriffen, Betrügereien und Monetarisierungssystemen

Deepfakes können von Kriminellen für bösartige Aktivitäten genutzt werden, und wir beobachten bereits die erste Welle dieser Angriffe:

- Messenger Scams. Sich als Finanzmanager auszugeben und wegen einer Geldüberweisung anzurufen, ist schon seit Jahren eine beliebte Betrugsmasche, und jetzt können Kriminelle Deepfakes in Videoanrufen verwenden, um sich beispielsweise als eine bestimmte Person auszugeben und dessen Freunde und Familie zu kontaktieren, um eine Geldüberweisung zu erbitten oder um das Aufladen des Guthabens zu verlangen.

- BEC. Diese Angriffe waren auch ohne Deepfakes schon recht erfolgreich. Jetzt können Angreifer gefälschte Videos in Anrufen verwenden, sich als Führungskräfte oder Geschäftspartner ausgeben und Geldüberweisungen anfordern.

- Konten eröffnen. Kriminelle können Deepfakes verwenden, um Identitätsüberprüfungsdienste zu umgehen und im Namen anderer Personen mit Kopien gestohlener Identitätsdokumente Konten bei Banken und Finanzinstituten, möglicherweise sogar bei staatlichen Stellen, zu eröffnen. Diese Kriminellen verwenden die Identität eines Opfers und umgehen den Verifizierungsprozess, häufig per Videoanruf. Solche Konten können später für Geldwäsche und andere bösartige Aktivitäten genutzt werden.

- Gekaperte Konten. Kriminelle können Konten, die eine Identifizierung erfordern, per Videoanruf übernehmen. Sie können ein Finanzkonto kapern und einfach Geld abheben oder überweisen. Einige Finanzinstitute verlangen eine Online-Videoüberprüfung, um bestimmte Funktionen in Online-Banking-Anwendungen zu aktivieren. Solche Verifizierungen könnten natürlich auch ein Ziel von Deepfake-Angriffen sein.

- Erpressung. Mithilfe von Deepfake-Videos können böswillige Akteure Erpressungen und andere, damit zusammenhängende Angriffe noch wirkungsvoller gestalten. Sie sind auch in der Lage, gefälschte Beweise unterzuschieben, die mit Deepfake-Technologien erstellt wurden.

- Desinformationskampagnen. Deepfake-Videos schaffen auch effektivere Desinformationskampagnen und dienen dann der Manipulation der öffentlichen Meinung. Bestimmte Angriffe, wie z. B. Pump-and-Dump-Schemata, beruhen auf Nachrichten von bekannten Personen. Jetzt werden diese Nachrichten mit Hilfe der Deepfake-Technologie erstellt. Diese Machenschaften haben sicherlich finanzielle, politische und sogar rufschädigende Auswirkungen.

- Betrug beim technischen Support. Deepfake-Akteure können gefälschte Identitäten verwenden, um ahnungslose Benutzer dazu zu bringen, Zahlungsdaten weiterzugeben, oder um sich Zugang zu IT-Ressourcen zu verschaffen.

- Social-Engineering-Angriffe. Böswillige Akteure nutzen Deepfakes, um Freunde, Familien oder Kollegen einer Person zu manipulieren. Social-Engineering-Angriffe, wie die, für die Kevin Mitnick berühmt war, können so eine neue Richtung nehmen.

- Hijacking von Internet-of-Things (IoT)-Geräten. Geräte, die mit Sprach- oder Gesichtserkennung arbeiten, wie Amazons Alexa und viele Smartphone-Marken, werden auf der Zielliste von Deepfake-Kriminellen stehen.

- Fazit und Sicherheitsempfehlungen

Wir sehen bereits die erste Welle krimineller und bösartiger Aktivitäten mit Deepfakes, und es werden wahrscheinlich immer mehr. Die Voraussetzungen dafür sind vorhanden:

- In den sozialen Medien werden genügend Inhalte veröffentlicht, um Deepfake-Modelle für Millionen von Menschen zu erstellen. Die Menschen überall und in jeder sozialen Gruppe sind über ihre sozialen Medien der ganzen Welt zugänglich.

- Alle technologischen Grundlagen sind vorhanden. Die Durchführung von Angriffen erfordert keine großen Investitionen, und Angriffe können nicht nur von Nationalstaaten und Unternehmen, sondern auch von Einzelpersonen und kleinen kriminellen Gruppen gestartet werden.

- Schauspieler können sich bereits als Politiker, leitende Angestellte und Prominente ausgeben und deren Identität stehlen. Dies könnte die Erfolgsquote bestimmter Angriffe, wie z. B. finanzielle Betrügereien, kurzlebige Desinformationskampagnen, Manipulation der öffentlichen Meinung und Erpressung, erheblich steigern.

- Die Identitäten gewöhnlicher Bürger lassen sich aus öffentlich zugänglichen Medien stehlen oder neu erstellen. Cyberkriminelle können die falschen Opfer bestehlen oder ihre Identitäten für bösartige Aktivitäten nutzen.

- Die Veränderung von Deepfake-Modellen könnte dazu führen, dass massenhaft Identitäten von Personen auftauchen, die nie existiert haben. Diese Identitäten werden für verschiedene Betrugsversuche verwendet. Anzeichen für solche Erscheinungen wurden bereits beobachtet.

Wir haben einige Empfehlungen für Nutzer sowie Unternehmen, die biometrische Muster zur Validierung und Authentifizierung verwenden. Einige dieser Validierungsmethoden lassen sich auch automatisiert und in großem Umfang einsetzen.

- Bei der Authentifizierung von sensiblen oder kritischen Konten sollte ein mehrstufiger Authentifizierungsansatz Standard sein.

- Unternehmen sollten einen Benutzer mit drei grundlegenden Faktoren authentifizieren: etwas, das der Benutzer hat, etwas, das der Benutzer weiß, und etwas, das der Benutzer ist. Stellen Sie sicher, dass die „etwas“-Elemente klug ausgewählt werden.

- Die Sensibilisierung der Mitarbeiter anhand einschlägiger Beispiele und des KYC-Prinzips (Know-Your-Customer) ist für Finanzunternehmen unerlässlich. Die Deepfake-Technologie ist nicht perfekt, und es gibt bestimmte Warnsignale, auf die die Mitarbeiter achten sollten.

- Nutzer sozialer Medien sollten die Veröffentlichung hochwertiger persönlicher Bilder auf ein Minimum beschränken.

- Für die Überprüfung sensibler Konten (z. B. Bank- oder Unternehmensprofile) sollten die Nutzer vorrangig biometrische Muster verwenden, die weniger öffentlich zugänglich sind, wie z. B. Iris und Fingerabdrücke.

- Um das Problem in größerem Maßstab anzugehen, sind erhebliche politische Änderungen erforderlich. Diese Maßnahmen sollten die Verwendung aktueller und früher offengelegter biometrischer Daten betreffen. Sie müssen auch den aktuellen Stand der cyberkriminellen Aktivitäten berücksichtigen.

Die Sicherheitsauswirkungen der Deepfake-Technologie und der Angriffe, die sie nutzen, sind real und schädlich. Wie wir gezeigt haben, sind nicht nur Unternehmen und leitende Angestellte potenzielle Opfer dieser Angriffe, sondern auch einfache Bürger. Angesichts der breiten Verfügbarkeit der erforderlichen Tools und Dienste sind diese Techniken auch für technisch weniger versierte Angreifer und Gruppen zugänglich, was bedeutet, dass böswillige Handlungen in großem Umfang ausgeführt werden könnten.