Künstliche Intelligenz (KI)

Was OpenClaw über agentenbasierte Assistenten verrät

Besser bekannt als Moltbot bringt OpenClaw eine neue Ebene in die agentenbasierte KI: leistungsstark, hochgradig autonom und überraschend einfach zu bedienen. Wie stellen sich seine Fähigkeiten und Risiken im Vergleich zu seinen Vorgängern dar?

Wichtige Erkenntnisse

- OpenClaw ist ein leistungsstarkes und hochgradig autonomes KI-Tool, dessen Design – einschließlich persistenter Speicher, weitreichender Berechtigungen und benutzergesteuerter Konfiguration – die Risiken der agentenbasierten KI verstärkt.

- OpenClaw führt keine neuen Risikokategorien ein, sondern verstärkt vielmehr bereits bestehende.

- Die rasche Verbreitung von OpenClaw hat bereits Konsequenzen, etwa der Verlust sensibler Daten aufgrund von Fehlkonfigurationen.

- Zero-Trust-Prinzipien und kontinuierliche Überwachung sind unerlässlich.

Der Name OpenClaw ist noch relativ neu, was zum Teil daran liegt, dass es mehrere Änderungen gegeben hat. Bekannter ist der digitale Assistent als Moltbot. Das Tool bringt wirklich bahnbrechende Neuigkeiten. Der DA erinnert sich an vergangene Interaktionen, speichert Daten auf dem Gerät des Benutzers und passt sich individuellen Vorlieben an. Gleichzeitig gibt es Vorbehalte gegen seine Entwicklung, da bereits in Berichten vor seinem Potenzial gewarnt wird.

Wir haben nun die Fähigkeiten von OpenClaw im Vergleich zu anderen agentenbasierten Assistenten genauer unter die Lupe genommen. Dabei bewerten wir auch die Risiken, die diese Fähigkeiten mit sich bringen, von unbeabsichtigten Aktionen über Datendiebstahl bis hin zur Offenlegung nicht verifizierter Fähigkeiten.

Eines ist schnell klar: Diese Risiken sind dem Paradigma der agentenbasierten KI inhärent und nicht spezifisch für OpenClaw selbst. Was OpenClaw jedoch besonders macht, ist die uneingeschränkte Konfigurierbarkeit, die es Benutzern ermöglicht, beliebige Berechtigungen ohne erzwungene Sicherheitsüberprüfungen zu erteilen. Diese Flexibilität erhöht die bestehenden Risiken erheblich, und daher sollten nur die Benutzer das Tool einsetzen, die wissen, wie sie es sicher und verantwortungsbewusst verwenden können, ohne ihr eigenes digitales Ökosystem oder das ihrer Organisation zu gefährden.

Ein Agent für Nutzer, die echte Autonomie verlangen

OpenClaw ist kein typischer KI-Assistent, sondern einer, der auf Ziele und Aktionen ausgerichtet ist und mehrstufige Aufgaben mit minimaler Überwachung ausführen kann. Er versteht Aufgaben wie „organisiere meine E-Mail-Posteingang“, „dieses Meeting zusammenfassen und mich morgen daran erinnern“ oder „einen Flug buchen, der zu meinem Terminkalender passt“ und teilt sie dann in umsetzbare Schritte auf.

Der Nutzer wählt ein beliebiges großes Sprachmodell (LLM) (einschließlich ChatGPT, Claude oder Gemini), mit dem der Assistent jedes Ziel interpretiert. Anschließend entscheidet er, wie die Aufgaben umgesetzt werden sollen, wählt die dafür geeigneten Tools, von Browser-Automatisierung und Shell-Befehlen bis hin zu Dateimanipulation und Skill-Aufruf. OpenClaw wartet zwar auf Anweisungen zu den zu verfolgenden Zielen, behält jedoch ein hohes Maß an Autonomie bei. Die Benutzer sind nicht mehr darauf beschränkt, einfach nur Befehle zu erteilen, sondern definieren Ziele und vertrauen darauf, dass der Assistent komplexe Aufgabenabläufe mit minimaler Überwachung ausführt.

Anwender können OpenClaw als Instanz auf dem eigenen Rechner laufen lassen und über Messaging-Apps wie WhatsApp, Telegram und Slack mit ihr interagieren. Der Assistent liefert dann Updates zum Fortschritt oder Status jedes Auftrags, entweder per Text oder Sprache. Er trackt die Konversation, um Aufgaben intelligent auszuführen. So sammeln sich im Laufe der Zeit diese kontextbezogenen Erkenntnisse in einem persistenten Speicher an, sodass sich die KI an die Vorlieben und Gewohnheiten des Benutzers anpassen und Ziele über mehrere Sitzungen hinweg verfolgen kann, anstatt nach jedem Chat zurückgesetzt zu werden.

Die Fähigkeiten von OpenClaw gehen weit über persönliche Produktivität hinaus. Programmierer können die Fehlersuche automatisieren und DevOps-Workflows optimieren, während Benutzer eine Vielzahl anderer Aufgaben ausführen, wie z. B. die Überwachung von Gesundheitsdaten, die Steuerung von Smart-Home-Geräten und sogar die Koordination von Käufen bei Autohändlern.

Besonders auffällig ist die Art und Weise, wie Benutzer damit umgehen: Sie vertrauen OpenClaw nicht nur Routineaufgaben an, sondern auch risikoreiche Handlungen, einschließlich finanzieller Entscheidungen. Um auf diesem hohen Niveau arbeiten zu können, benötigt die KI Zugriff auf Ressourcen im gesamten digitalen Ökosystem des Benutzers, darunter Dienste wie Datenspeicherung und Banking-Apps.

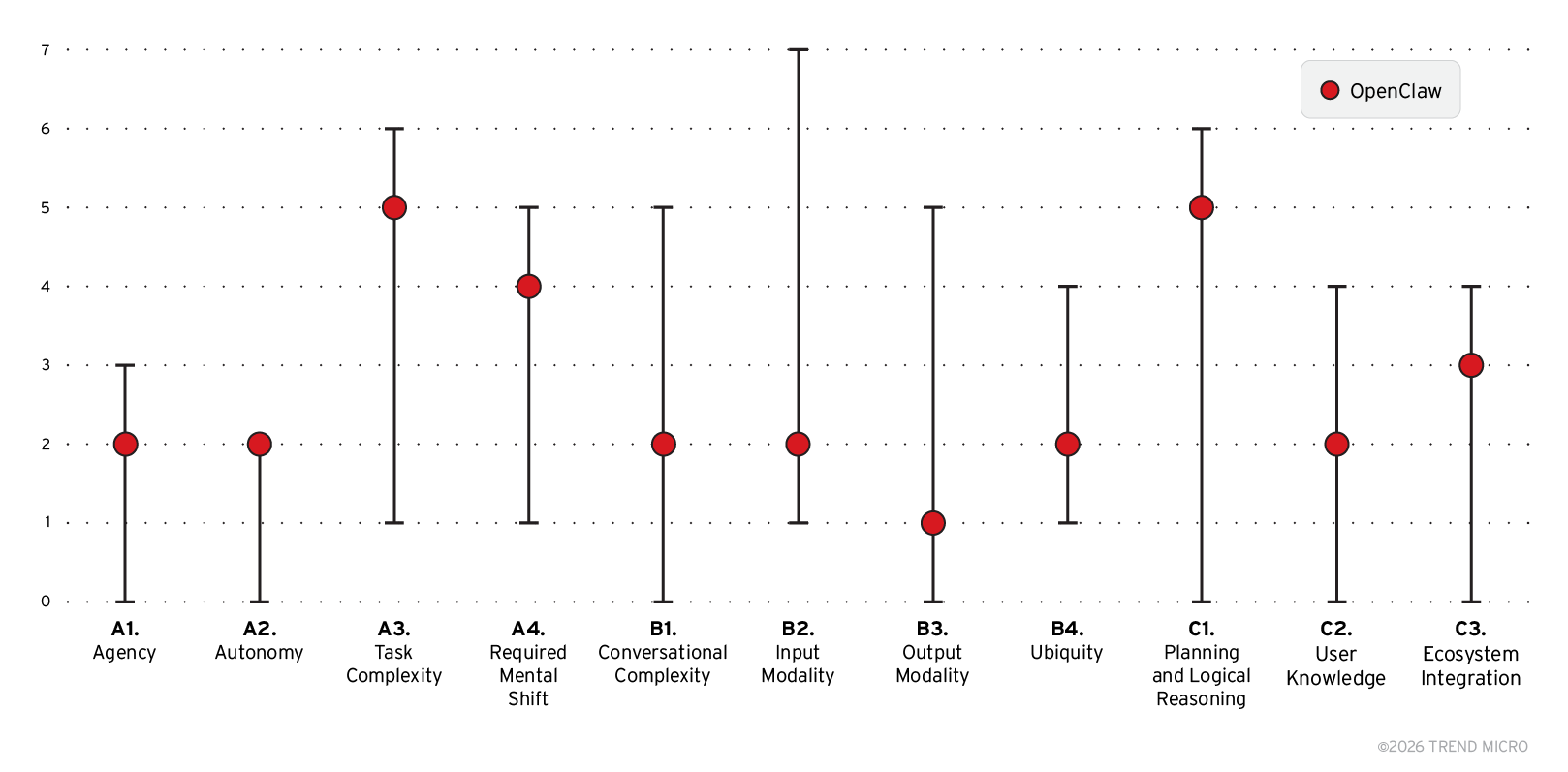

Um ein klares Bild der Fähigkeiten zu vermitteln, haben wir OpenClaw anhand des TrendAI™ Digital Assistant Framework untersucht und einen Überblick über die Funktionen und Entwicklungsstufen gegeben. Das Diagramm in Bild 1 (zum Vergrößern bitte anklicken) ordnet OpenClaw diesem Tool zu und hebt dessen Hauptmerkmale und Entwicklungsstufen hervor.

Was unterscheidet OpenClaw von anderen Lösungen?

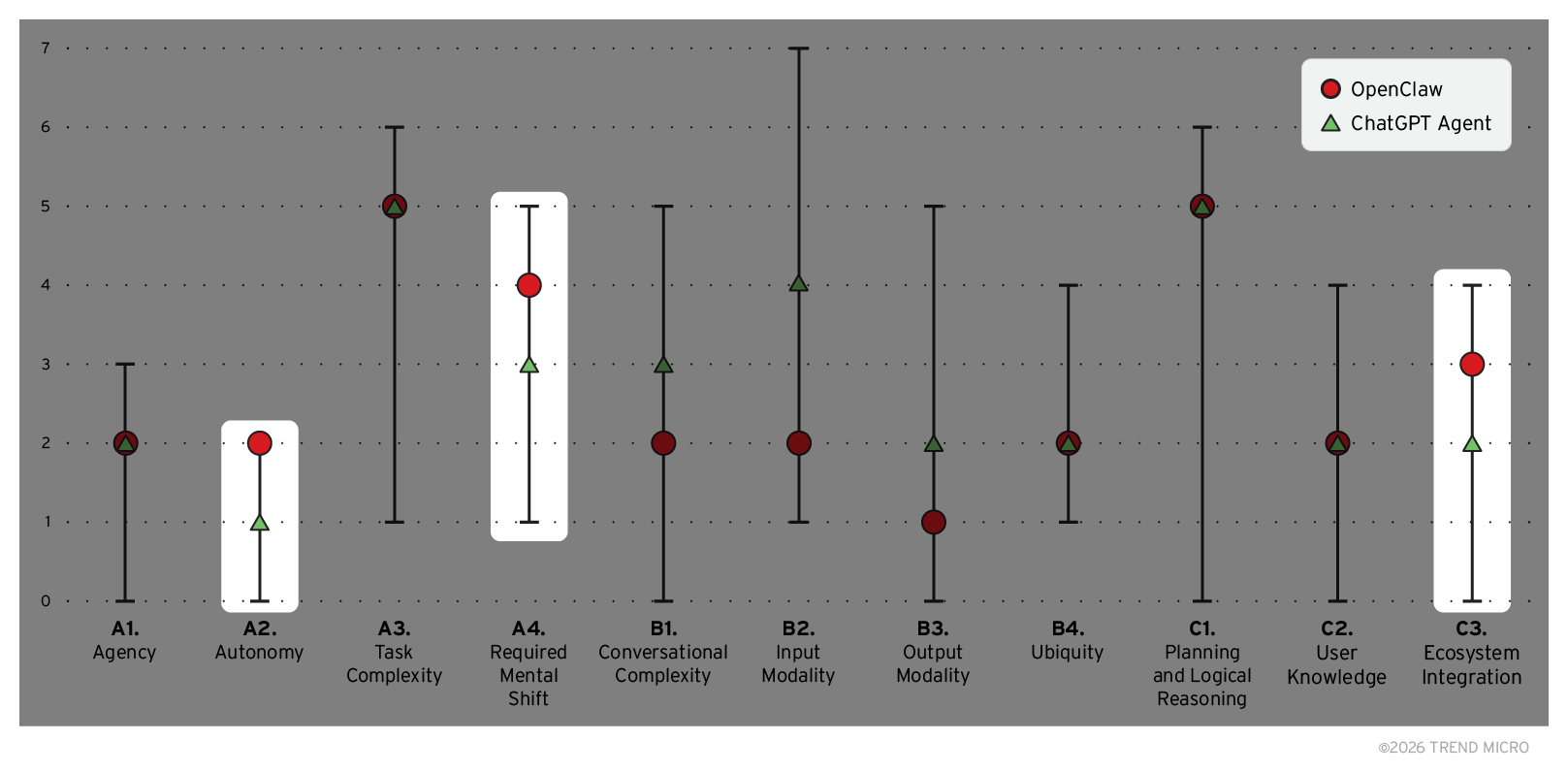

OpenClaw hat mehr Aufmerksamkeit bekommen als seine Vorgänger, darunter ChatGPT. Wir haben die beiden anhand unseres Frameworks verglichen.

OpenClaw unterscheidet sich in den meisten Kategorien nicht wesentlich von ChatGPT. In mehreren Bereichen sind die beiden digitalen Assistenten praktisch gleichauf. Beispielsweise können beide autonom entscheiden, wie ein bestimmtes Ziel verfolgt werden soll (Agency, A1), und sind über mobile Plattformen zugänglich (Ubiquity, B4).

Beide weisen dasselbe Niveau an User Knowledge (C2) auf, gehen aber damit unterschiedlich um. OpenClaw verfügt über einen persistenten Speicher, während ChatGPT Agent in der Regel in einem sitzungsbegrenzten Kontext arbeitet. In einigen Kategorien schneidet OpenClaw sogar schlechter ab als der Agent von OpenAI, insbesondere in Bezug auf die Komplexität der Konversation und die unterstützten Medien (Bereiche, in denen ChatGPT Agent von überlegenen Multimedia Ein- und Ausgabemöglichkeiten profitiert).

Aus Sicht der Risiken sind die Ähnlichkeiten zwischen den beiden Agenten erheblich.

Planung und logisches Reasoning (C1) – Prompt Injection

Da OpenClaw über unbekannte Domänen hinweg planen und argumentieren kann (C1), ist der Assistent anfällig für Prompt Injection und andere subtile Techniken zur Manipulation des Verhaltens. Dieses Risiko gilt für alle Agenten, deren Schlussfolgerungen und Koordination von einem LLM gesteuert werden.

Ökosystemintegration (C3) – Datenexfiltrierung und Zugriff auf externe Systeme

Die Fähigkeit, mit anderen Agenten zu kommunizieren, ist eine herausragende Eigenschaft von OpenClaw, die kürzlich zur Entstehung von Moltbook geführt hat, einem sozialen Netzwerk, das speziell für KI-Agenten entwickelt wurde. Diese Form der Interaktion zwischen Agenten ist der Hauptgrund dafür, dass OpenClaw bezüglich der Ökosystemintegration (C3) etwas besser abschneidet als ChatGPT. Abgesehen davon jedoch benötigen beide Assistenten einen umfassenden Zugriff auf Ressourcen im gesamten digitalen Ökosystem des Benutzers, um E-Mails zu versenden, Kalender zu ändern, Dateien zu löschen oder Befehle auszuführen.

Diese Fähigkeit birgt auch ein gemeinsames Risiko: Bei einer Kompromittierung könnten die Agenten sensible Informationen preisgeben, die sie zuvor über ihren Benutzer gesammelt haben. Bei OpenClaw ist dieses Risiko besonders ausgeprägt. Sein persistenter Speicher behält langfristig Kontexte, Benutzereinstellungen und Interaktionshistorien bei, die in Kombination mit seiner Fähigkeit zur Kommunikation mit anderen Agenten dazu führen könnten, dass diese Informationen an andere Agenten weitergegeben werden – einschließlich böswilliger Agenten. Da beide Assistenten zudem direkte Verbindungen zu mehreren Diensten unterhalten, könnte sich eine einzige Manipulation sogar auf externe Systeme ausbreiten.

Dieses erweiterte Ökosystem erhöht auch die Anfälligkeit für Angriffe auf die Lieferkette. Agenten könnten sich auf externe Fähigkeiten oder Tools verlassen, die unzureichend geprüft wurden. Ist aber eine dieser Abhängigkeiten bösartig oder kompromittiert, kann die ausgelagerte Komponente einem Angreifer ermöglichen, unbemerkt Einfluss auf das Verhalten des Agenten zu nehmen, Daten zu exfiltrieren oder Aktionen mit den Berechtigungen des Agenten durchzuführen.

Es gibt auch bereits Berichte darüber, dass im OpenClaw Hub bösartige Skills veröffentlicht wurden, ein Trend, der durch Aktivitäten in der kriminellen Unterwelt bestätigt wird.

Autonomie (A2) und mentale Umstellung (A4) – Manipulation von Agenten

Es gibt einige Funktionen, bei denen OpenClaw besser abschneidet als ChatGPT. Leider verstärken diese Unterschiede, obwohl sie scheinbar geringfügig sind, das Risiko. Während der ChatGPT Agent beispielsweise technisch gesehen in hohem Maße autonom arbeiten kann, erfordert es in der Regel eine ausdrückliche Bestätigung durch den Benutzer, bevor der Agent kritische Aktionen mit realen Konsequenzen ausführt.

OpenClaw hingegen schreibt keinen obligatorischen Human-in-the-Loop-Mechanismus vor. Sobald Ziele und Berechtigungen festgelegt sind, kann der Assistent völlig autonom (A2) arbeiten, ohne dass einzelne Aktionen genehmigt werden müssen. Ohne Überwachung könnte der Assistent aber seine vorgesehenen Einsatzgrenzen überschreiten, und Fehler oder Manipulationen könnten unbemerkt bleiben, bis tatsächlicher Schaden entsteht.

Die Risiken einer unbeaufsichtigten Einführung

Durch die Integration in alltägliche Messaging-Apps ist OpenClaw sofort zugänglich, sein persistenter Speicher ermöglicht eine umfassende Personalisierung und seine lokale Datenverarbeitung vermittelt ein starkes Gefühl von Sicherheit und Kontrolle.

Von der Sicherheit her ändern diese Funktionen jedoch nichts am Risikoprofil im Vergleich zu anderen agentenbasierten Systemen, wie etwa unbeabsichtigte Aktionen, Datenexfiltrierung, Manipulation durch Agenten und die Gefährdung durch ungeprüfte Komponenten

OpenClaw ist ein komplexes Tool, welches Nutzer stark an ihre Bedürfnisse anpassen können. Diese Flexibilität gibt den Nutzern mehr Möglichkeiten, die Sicherheitsvorkehrungen zu umgehen, die große Anbieter wie OpenAI normalerweise zur Risikominimierung implementieren. Sie könnten die Authentifizierung falsch konfigurieren, vollen Systemzugriff gewähren, Konten und externen Diensten weitreichende Berechtigungen zuweisen oder ungeprüfte Skills installieren. Diese Entscheidungen verstärken die inhärenten Gefahren der agentenbasierten KI. I

Selbst wenn diese OpenClaw-Instanzen fehlerfrei konfiguriert und alle bekannten Schwachstellen behoben wären, blieben die grundlegenden Risiken bestehen, obwohl die Schwelle für eine Ausnutzung höher wäre.

Hier kommen Asset Management und Zero-Trust-Prinzipien ins Spiel: Keiner Komponente, keinem Modell und keiner Fähigkeit sollte implizit vertraut werden, auch nicht innerhalb eines Systems, das unter der Kontrolle des Benutzers steht.

Zero Trust beseitigt zwar nicht das Risiko durch Agenten, begrenzt jedoch die Auswirkungen, wenn etwas schiefgeht. Das bedeutet, die Berechtigungen des Agenten streng auf das Notwendige zu beschränken, die Überwachung von Aktionen mit hoher Auswirkung durchzusetzen und jeden Agenten, jedes Modell, jede Fähigkeit und jedes Tool rigoros zu überprüfen. Außerdem sind manche Aufgaben einfach zu riskant, um sie zu delegieren.

Fazit

Ein aktueller Bericht zeigt, dass jedes fünfte Unternehmen OpenClaw ohne Zustimmung der IT-Abteilung einsetzt. Der Kernkonflikt ist klar: Je leistungsfähiger und anpassungsfähiger der Agent ist, desto größer sind die potenziellen Auswirkungen von Fehlern, Manipulationen und Missbrauch, wobei eine unbeaufsichtigte Einführung dieses Risiko noch verstärkt.

Open Source-Agenten wie OpenClaw erfordern eine höhere Grundkompetenz der Benutzer im Bereich Sicherheit als verwaltete Plattformen. Sie sind für Personen und Organisationen gedacht, die die Funktionsweise des Assistenten vollständig verstehen und wissen, was es bedeutet, ihn sicher und verantwortungsbewusst zu nutzen.

Die von uns empfohlenen Zero-Trust-Prinzipien lassen sich beispielsweise mithilfe der Zero Trust-Plattform Trend AI Vision One umsetzen, die Unternehmen dabei unterstützt, die Auswirkungen von Vorfällen zu begrenzen. Weitere Einzelheiten dazu liefert der Originalbeitrag.

Über die Autoren

Das Forward-Looking Threat Research Team von TrendAI™ Research hat sich auf die Erforschung von Technologien für die nächsten ein bis drei Jahre spezialisiert, wobei der Schwerpunkt auf drei verschiedenen Aspekten liegt: der technologischen Entwicklung, ihren sozialen Auswirkungen und kriminellen Anwendungen.