Originalartikel von Trend Micro

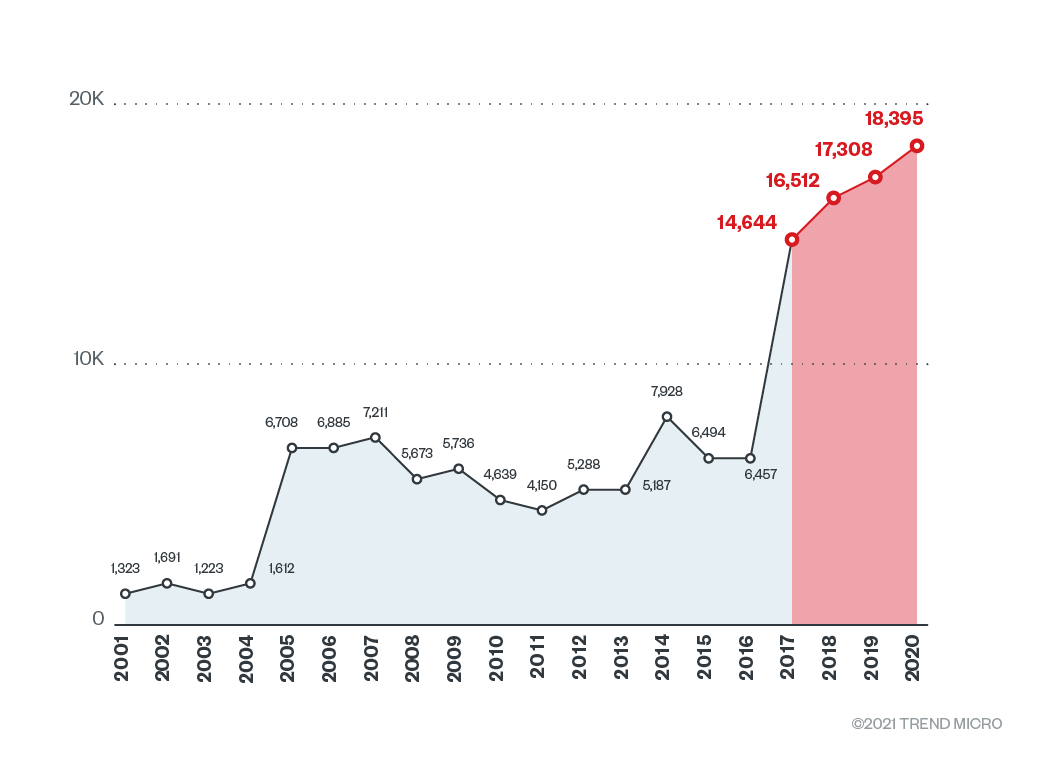

Mit dem steigenden Wert von Daten und den ständig neuen Möglichkeiten, sie zu verwenden, nimmt auch die Zahl der gezielten Angriffe und Bedrohungen zu, die Schwachstellen in Systemen ausnutzen. Anbieter und Hersteller versuchen darauf zu reagieren - zur Freude und zum Leidwesen der IT-Teams. Denn das Patching und das Tracking von Updates stellt für Admins und IT-Teams wegen Überlastung eine große Herausforderung dar. Im Idealfall aktualisieren Unternehmen ihre Policies alle paar Jahre, zusammen mit den Sicherheitsstrategien und -zielen, auf denen ihre umsetzbaren Leistungen basieren. Mittlerweile holen kleine und mittlere Unternehmen (KMUs) auf und bringen Berichten zufolge angeblich bessere Leistungen beim regelmäßigen Patchen und Verwalten der Systeme als ihre größeren Pendants in der Lieferkette. Dennoch sollte mehr getan werden, um eine Patch-Management-Policy zu implementieren und zu aktualisieren, gerade auch im Hinblick der technologischen und Cybersicherheitsentwicklungen.

Einen Rückblick des Patch-Managements der vergangenen Jahre bietet der Originalbeitrag.

Im Allgemeinen ist das Patching von Endgeräten im Vergleich zu früheren Methoden einfacher, automatisierter und straffer geworden. Das Patching von Servern jedoch ist eine ganz andere Sache. Die Vorbehalte gegen sofort notwendige Maßnahmen für Server beziehen sich vor allem auf die Kosten für Ausfallzeiten: Das Aufspielen der Patches kann zur Unterbrechung der Kontinuität bestehender Funktionalität führen, denn die Patches selbst könnten Fehler enthalten, neue Schwachstellen bei der Installation einführen und die aufgedeckte Lücke nicht schließen. Darüber hinaus fügen die Hersteller den Patches „Extras“ bei, die sich als potenziell unsicher erweisen und einen Neustart der Systeme erforderlich machen könnten. Insbesondere bei industriellen Steuerungssystemen (ICS) werden Neustarts für das Patchen als Gefahr gesehen, da sie sich auf öffentliche integrierte Systeme auswirken.

Das Patchen in der Cloud ist weniger problematisch geworden, da Cloud-Service-Provider (CSPs) diesen Service für ihre Abonnenten bequem gestalten. Viele Unternehmen haben die traditionellen Patching-Probleme gelöst, indem sie diese Patching-as-a-Service-Option in Anspruch nehmen und damit Service-Provider für die Implementierung der monatlichen Updates verantwortlich machen. Mittlerweile sind auch die Eingaben und Veröffentlichungen von Schwachstellen durch Forscher und die Antworten der Anbieter bezüglich der Korrekturen kontinuierlich besser geworden. Auf der anderen Seite haben aber auch Cyberkriminelle die profitabelsten Wege gefunden, Lücken, Fehlkonfigurationen und Container-Fehler zu missbrauchen.

Herausforderungen und Best Practices

Beobachter der Szene stellen fest, dass es eine wachsende Branche gibt, die Unternehmen beim automatisierten Aufbringen von Patches unterstützt. Das ist auch nötig, denn zu den häufig genannten Herausforderungen bei der regelmäßigen Implementierung von Patch-Management-Verfahren gehören die folgenden:

- Ressourcen. Nicht alle Hersteller veröffentlichen die Fixes an demselben Tag wie Microsoft (Patch Tuesday). Infolgedessen verlieren Systemadministratoren den Überblick über die verschiedenen Release-Zyklen, die für alle eingesetzten Systeme benötigt werden.

Darüber hinaus ist der Mangel an qualifizierten Cybersecurity-Fachkräften bekannt und stellt eine Herausforderung für die Aufrechterhaltung einer angemessenen Cybersecurity dar. Zwar wissen IT-Teams und Administratoren, dass Patchen grundlegend wichtig für den Umgang mit Schwachstellen ist, doch fehlt es auch an Ausbildung für die Identifizierung, Analyse und Implementierung für das Schwachstellenmanagement.

Best Practices. Ein Standard für die Benachrichtigung von Branchenpraktikern und IT-Teams über alle Release-Zyklen sollte etabliert werden. Nicht alle Anbieter können ihre Releases automatisieren, aber oft sind die Informationen auf ihren jeweiligen News- oder Blog-Seiten verfügbar, oder gelegentlich gibt es E-Mail-Listen, Updates und RSS-Feeds, die in bestimmte Postfächer integriert werden können.

Patch- und Schwachstellenmanagement sollte als Teil einer umfassenderen Sicherheitsstrategie betrachtet werden, insbesondere für die DevOps- und Betriebssicherheit. Eine organisierte Inventarisierung ist eines der wichtigsten Verfahren für das Asset Management. Nur wenn alle am Betrieb beteiligten Unternehmensressourcen erfasst sind, können diese für eine genaue Analyse überwacht werden. Verkehrs- und Verhaltensmuster, Betriebssystemversionen, Netzwerkadressen, Anmeldedaten und Compliance-Prüfungen sind nur einige der Komponenten, die zu einer genauen Überwachung, Datenanalyse und Erkennung von Anomalien beitragen können. Wenn man bedenkt, dass die meisten Patches innerhalb von Stunden nach ihrer Veröffentlichung zur Verfügung stehen, kann eine sofortige Implementierung durch Automatisierung das Risikofenster erheblich verkleinern, entweder mit virtuellen Patches oder permanenten Updates.

- False Positives und fehlgeleitete Prioritäten aufgrund fragmentierter und isolierter Lösungen. Eine Lösung, die sich auf nur eine Umgebung konzentriert (z.B. Mail-Erkennung), könnte fälschlicherweise eine Schwachstelle anzeigen, die von einer anderen Lösung abgedeckt wird (z.B. einer Cloud-Serverlösung), oder umgekehrt. Silo-Lösungen führen dann dazu, dass Analysten und Sicherheitsteams falsche Positivmeldungen verfolgen oder sich um Schwachstellen mit geringem Risiko kümmern, während sie kritische Lücken offen lassen.

Best Practices. Die Betrachtung der Lösungen und Probleme aus einer zentralen Perspektive ermöglicht eine bessere Fokussierung und klarere Einsichten - nicht nur während eines Vorfalls, sondern auch bei der Suche nach den potenziellen Bedrohungspunkten. Der Einsatz von Technologien wie Security Information and Event Management (SIEM), künstliche Intelligenz (KI), Datenanalyse und Threat Intelligence ermöglicht es Security Operation Centern (SOC) und IT-Teams, Erkennungen in verschiedenen Umgebungen zu korrelieren, um einen größeren Kontext bei Untersuchungen und Reaktionen zu erhalten. Diese Transparenz ermöglicht eine zentralisierte, proaktive und defragmentierte Überwachung, Verfolgung, Analyse, Identifizierung und Erkennung von Schwachstellen, wodurch Fehlalarme reduziert und integrierte Reaktionen beschleunigt.

- Neue und vergessene Lücken durch den Einzug von Cloud-Lösungen. Beim Umzug in die Cloud verlieren Unternehmen häufig den Überblick über Details zu ihrer Sicherheitsstruktur. Darum sollten sie bei der Migration in die Cloud einige Fragen stellen: Sind die Apps sicher konzipiert? Wurden die Apps auf Schwachstellen überprüft? Wurden die Container richtig angepasst und konfiguriert? Sind Authentifizierungs- und Autorisierungs-Token korrekt implementiert?

Best Practices. Ob in der Cloud oder On-premise, das gründliche Testen von Anwendungen und Cloud-Containern bleibt von größter Bedeutung. Es muss eine Checkliste für die Governance- und Strukturrichtlinien sowohl von Containern als auch von Apps während ihrer grundlegenden Builds vorhanden sein, um die spätere Sicherheit und funktionale Effizienz der Entwicklungen zu gewährleisten. Entwickler müssen sicherstellen, dass Basis-Images frei von Schwachstellen sind und vollständig gescannt sind, bevor sie in die Produktion überführt werden. Sie müssen auch festlegen, dass es eindeutig erlaubt ist, auf Basis-Images aufzubauen, und müssen sicherstellen, dass die Pakete, Binärdateien und Bibliotheken von Anfang an abgesichert sind. Zudem ist eine gründliche Prüfung der jeweiligen bekannten, hochriskanten und verbreiteten Schwachstellen von zentraler Bedeutung. Ebenso wichtig sind regelmäßige Scans von Containern bis zu Schlüsseln, von Compliance zu Malware-Varianten und von Drittanbieter-Software bis hin zu Teams.

- Arbeiten im Homeoffice und Lücken im Schwachstellenmanagement. Die Schwierigkeiten, die Admins beim Patchen der System vor Ort haben, sind noch größer, wenn sowohl Nutzer als auch die zu patchenden Systeme geografisch verteilt sind. Bei einigen Systemen müssen die Administratoren physisch mit den zu aktualisierenden Maschinen interagieren, und ein unsicherer Zeitplan und eine unsichere Implementierung setzen Organisationen einem höheren Risiko aus. Vor allem bei älteren ICS-Systemen ist es fast unvorstellbar, Fixes aus der Ferne blind zu implementieren, da das empfindliche Gleichgewicht und die Integrationen stark von der Durchführbarkeit des Patchings abhängen.

Best Practices. Von der Gesamtzahl der aufgedeckten Sicherheitslücken werden nur wenige in großem Umfang ausgenutzt und noch weniger werden für Einbrüche verwendet.

Obwohl diese Zahlen nicht auf die leichte Schulter zu nehmen sind, können Unternehmensadministratoren und Benutzer von der Priorisierung und Identifizierung der Sicherheitslücken profitieren, die sofort gepatcht werden müssen. Zu den notwendigen Maßnahmen gehören gute Informationsquellen für Schwachstellen, System- und Softwareinventare, Schwachstellenbewertungen, Scan- und Verifizierungstools, Maßnahmen zur Patch-Bereitstellung (z. B. agentenbasierte vs. agentenlose Bereitstellung) sowie Pläne zur kontinuierlichen Verbesserung der Risikominderung.

Wo die Implementierung von Patches eine physische Interaktion vor Ort erfordert, benötigen Administratoren eine Entscheidungshilfe dazu, welche Lücken aus einer Vielzahl von Offenlegungen priorisiert werden sollen. Dabei unterstützt die Möglichkeit, Lücken, die in bestimmten Umgebungen gefunden wurden, zu identifizieren und sich auf deren Behebung zu konzentrieren – etwa mit virtuellen Patches. Insbesondere für ICSs wird diese Priorisierung wesentlich, wenn Systemadministratoren und IT-Teams abwägen, ob sie Systeme patchen oder bestimmte Verfahren und Modelle befolgen.

Bild 2. Anpassen der Patching-Prioritäten an die in der Unternehmensumgebung gefundenen Bedrohungen (Quelle Gartner)

Virtuelles Patching

Virtuelles Patching ist ein nicht zu vernachlässigender Aspekt des Patch-Managements. Diese temporären Patches verschaffen dem Unternehmen Zeit für permanente Lösungen und helfen ihm, unnötige Ausfallzeiten zu vermeiden, um Patches in seinem eigenen Tempo zu implementieren. Insbesondere bei Auftreten von Zero-Day-Schwachstellen schützen diese virtuellen Patches Systeme und Netzwerke als zusätzliche Sicherheitsschicht.

Für Legacy-Systeme bieten diese Patches eine zusätzliche Schutzschicht, wenn das Schließen von deren Sicherheitslücken nicht mehr unterstützt wird, und bieten Flexibilität bei der Festlegung bestimmter Punkte, die Patches erfordern. Gute virtuelle Patching-Lösungen sind mehrschichtig, um unterschiedliche Umgebungen – physisch, virtuell oder in der Cloud – zu berücksichtigen und einen kontinuierlichen geschäftskritischen Datenverkehr, Kommunikation und Betrieb zu gewährleisten.

Fazit

Unternehmen müssen sich der internen und externen Faktoren bewusst sein, die für unbefugte Einbrüche und Verstöße missbraucht werden können. Updates und Patches, Patch-Management-Verfahren und Patching-Maßnahmen müssen sich daher gleichzeitig, wenn nicht sogar proaktiv, genauso schnell weiterentwickeln, wie es der Markt, Service und Produktangebot und -nachfrage tun.