Кибербезопасность на базе ИИ — это проактивный подход, который использует искусственный интеллект (ИИ) для устранения «слепых зон» безопасности, упреждающего прогнозирования и предотвращения атак, а также повышения эффективности SecOps во всем цифровом пространстве организации.

Содержание

Искусственный интеллект (ИИ) — это широкий термин для описания машин или компьютеров, которые используют алгоритмы машинного обучения, нейронные сети и другие передовые технологии для моделирования работы человеческого мозга. Эти машины имитируют когнитивные способности человека, чтобы планировать, рассуждать, решать проблемы, выполнять сложные задачи и учиться на своем опыте.

Идея использования ИИ в кибербезопасности появилась еще в конце 1980-х годов. С момента внедрения кибербезопасность на базе ИИ существенно изменила методы выявления и предотвращения киберугроз. Инструменты и технологии на базе ИИ используются для следующих задач:

- Выявление, прогнозирование и защита от взлома, утечки данных и кибератак.

- Выявление и устранение пробелов и уязвимостей в системе кибербезопасности.

- Автоматизация инструментов и решений для обнаружения и реагирования на угрозы.

- Расширение охвата и эффективности аналитики угроз.

- Улучшение и поддержка управления киберугрозами.

Ключевые компоненты кибербезопасности на базе ИИ

Большинство решений кибербезопасности на базе ИИ сочетают различные инструменты, технологии и приложения для обеспечения максимальной защиты.

Алгоритмы машинного обучения могут использоваться для анализа данных, обнаружения закономерностей, изучения прошлого опыта и прогнозирования будущих угроз.

ИИ-модели используют алгоритмы глубокого обучения и нейронные сети для мониторинга, оценки и анализа огромных объемов данных — они работают намного быстрее, чем специалисты-люди, вооруженные традиционными инструментами кибербезопасности.

Генеративный ИИ и инструменты обработки естественного языка могут использоваться для расследования и реагирования на потенциальные угрозы, предоставления рекомендаций по различным стратегиям реагирования на инциденты и создания упрощенных отчетов о результатах.

Автоматизированные ИИ-агенты могут взять на себя многие рутинные или трудоемкие задачи, ранее выполняемые специалистами по безопасности, чтобы люди могли сосредоточиться на более важных задачах, и организации быстрее и эффективнее реагировали на киберугрозы.

Традиционная кибербезопасность и применение ИИ

Традиционные меры кибербезопасности следуют четкому набору заранее определенных правил, политик и плейбуков для выявления известных угроз и реагирования на них. Система кибербезопасности на базе ИИ, напротив, постоянно учится, развивается и адаптирует методы работы. Это позволяет ей не отставать от новых угроз, реагировать на новые векторы атак по мере их появления и опережать злоумышленников.

Возможность учиться на прошлом опыте и прогнозировать ранее неизвестные результаты позволяет инструментам кибербезопасности на базе ИИ выявлять потенциальные киберугрозы в реальном времени и реагировать на кибератаки быстрее, точнее и эффективнее по сравнению с традиционными мерами безопасности. Кроме того, организации могут использовать проактивный подход к защите ИТ-инфраструктуры, предотвращая большинство кибератак до их возникновения.

Традиционная кибербезопасность

Кибербезопасность на базе ИИ

Готовые правила, политики и плейбуки

Постоянное обучение, развитие и адаптация

Борьба с атаками нулевого дня и неизвестными угрозами

Обнаружение новых и развивающихся угроз

Долго и ресурсоемко

Быстрое реагирование и снижение нагрузки на аналитиков

Безопасность на базе ИИ и безопасность для ИИ

Эти понятия часто используются вместе, но относятся к разным частям процесса безопасности.

Безопасность на базе ИИ заключается в использовании ИИ-инструментов и технологий для поддержки и укрепления системы кибербезопасности организации. Безопасность для ИИ означает необходимость для организаций любого размера защищать свои ИИ-стеки, а также ИИ-системы, сети и приложения.

Последнее включает защиту ИИ-систем от атак, предотвращение отравления или кражи ИИ-моделей, обеспечение целостности данных в конвейерах машинного обучения, защиту инфраструктуры ИИ и обучающих данных, а также обеспечение того, чтобы ИИ-инструменты разрабатывались в соответствии со всеми законами, политиками компании и отраслевыми требованиями.

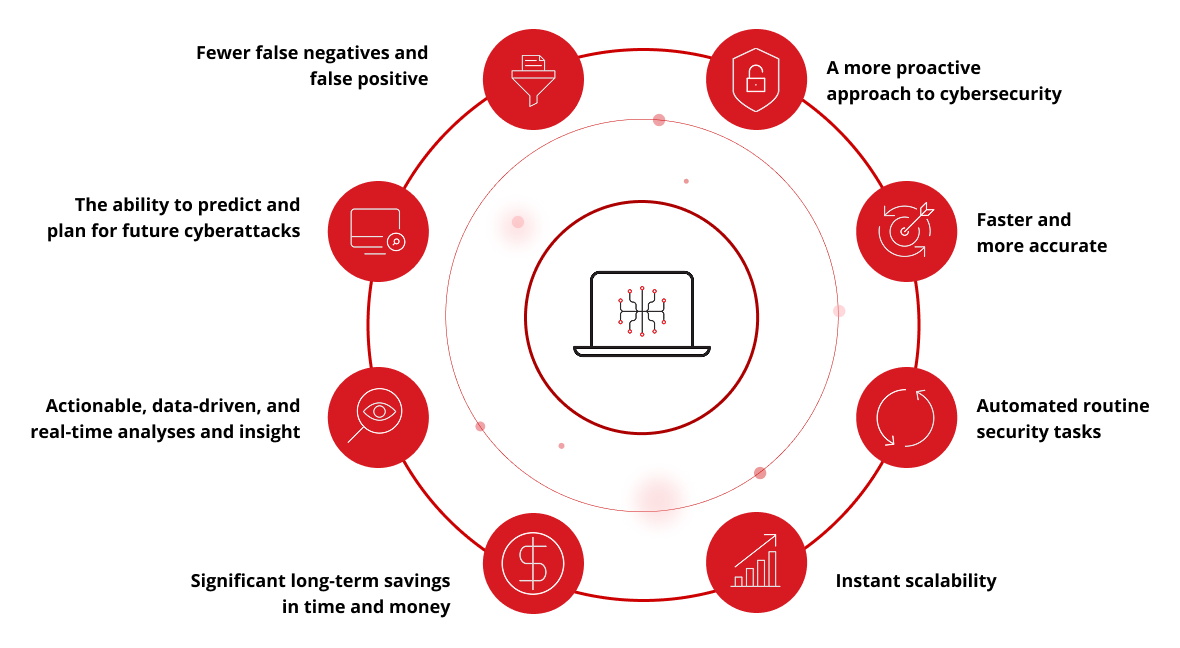

Какие преимущества дает кибербезопасность на базе ИИ?

Кибербезопасность на базе ИИ имеет ряд преимуществ по сравнению с традиционными мерами кибербезопасности. Например:

- Проактивный подход к кибербезопасности — инструменты кибербезопасности на базе ИИ обнаруживают, предвидят и предотвращают кибератаки до того, как они произойдут, а не после.

- Более быстрое и точное обнаружение угроз и реагирование. ИИ-модели могут отслеживать, фильтровать и анализировать огромные объемы данных для выявления аномалий и необычных шаблонов поведения и реагирования на первые признаки потенциальных рисков или атак в режиме реального времени.

- Автоматизированные рутинные задачи по безопасности. Автоматизируя анализ логов, сканирование на предмет уязвимостей и другие задачи безопасности, ранее выполняемые вручную, ИИ-инструменты позволяют разгрузить специалистов по безопасности, чтобы они направили время и усилия на более важные или стратегические задачи.

- Меньше ложноотрицательных и ложноположительных результатов. Более высокая точность кибербезопасности на базе ИИ помогает сократить количество неактуальных оповещений, поступающих в центры SOC.

- Возможность прогнозировать будущие кибератаки и планировать реагирование на них. Выявляя прошлые атаки и извлекая из них уроки, ИИ-технологии прогнозируют и предвидят новые угрозы, предпринимают упреждающие меры для снижения рисков и уязвимостей до того, как ими воспользуются злоумышленники, и помогают организациям предвосхищать новейшие тактики, техники и процедуры (TTP), используемые киберпреступниками.

- Практический анализ на основе данных в реальном времени. ИИ-инструменты предоставляют актуальные инсайты о сетевом трафике и поведении сотрудников с помощью детальной аналитики и отчетов об активности с использованием данных, полученных из различных внутренних и внешних источников, включая сетевой и пользовательский трафик, журналы безопасности и активности, а также новейшие отраслевые данные об угрозах.

- Мгновенная масштабируемость. ИИ-модели поддерживают легкое и недорогое масштабирование при расширении ИТ-инфраструктуры и изменении частоты, количества и сложности кибератак.

- Существенная экономия времени и денег в долгосрочной перспективе. Благодаря сокращению количества нарушений безопасности и атак система кибербезопасности на базе ИИ помогает организациям защитить данные и репутацию, а также значительно снизить затраты на восстановление после кибератак.

С какими рисками и проблемами связана кибербезопасность на базе ИИ?

Организации должны учитывать несколько рисков и проблем при интеграции решений по кибербезопасности на базе ИИ.

Технология кибербезопасности на базе ИИ может быть использована теми самыми киберпреступниками, с которыми она борется. Например, киберпреступники могут внедрять вредоносный контент в данные ИИ или манипулировать алгоритмами, чтобы поставить под угрозу безопасность. Они также могут с помощью ИИ пытаться избежать обнаружения или находить и использовать уязвимости в системах безопасности организации.

Киберпреступники также могут использовать собственные ИИ-инструменты для создания более мощных, сложных и целенаправленных кибератак. Например, они могут создавать дипфейки — поддельные реалистичные фотографии и видео, используемые с целью заставить сотрудников раскрыть конфиденциальную или служебную информацию или получить доступ к системе паролей и контроля доступа.

Использование ИИ в кибербезопасности также вызывает опасения по поводу конфиденциальности данных. Сюда входят такие вопросы, как необходимость получения согласия и обеспечения прозрачности при сборе или использовании персональных данных, вероятность компрометации, ненадлежащего использования или кражи чувствительных и конфиденциальных данных, а также требование к организациям соблюдать соответствующие законы и нормативные акты, касающиеся конфиденциальности пользователей, такие как Общий регламент по защите данных (GDPR).

Кроме того, ИИ-модели обычно обучаются на основе данных, полученных из существующего контента. Предвзятые, дискриминационные, несправедливые и недостоверные фразы в исходных данных могут привести к тому, что эти модели будут копировать те же ошибки, делать неточные прогнозы и принимать неверные решения. Организации должны убедиться, что их ИИ-модели обучаются на самых качественных и надежных источниках данных.

Примеры использования ИИ в кибербезопасности

ИИ уже применяется различными способами для укрепления системы кибербезопасности. Вот некоторые из самых инновационных примеров использования ИИ-инструментов и приложений в кибербезопасности:

- Системы обнаружения вредоносных программ на базе ИИ, использующие алгоритмы машинного обучения для обнаружения, идентификации и блокировки сложных вредоносных программ, которые традиционные решения могут пропустить.

- Межсетевые экраны нового поколения (NGFW) на базе ИИ, которые используют новейшие данные об угрозах для защиты организаций от существующих и новых киберугроз.

- Средства управления электронной почтой и доступом на базе ИИ, которые предотвращают фишинговые атаки путем анализа содержимого писем, данных отправителей и метаданных электронной почты для выявления и блокировки фишинговых схем, тактик и техник.

- Инструменты поведенческой аналитики на базе ИИ, которые отслеживают и анализируют поведение пользователей и сетевой трафик для обнаружения ненормальных или несанкционированных действий, выявления потенциальных инсайдерских угроз или скомпрометированных учетных записей и устранения рисков для безопасности.

- Решения для облачной безопасности на базе ИИ, которые позволяют организациям защищать конфиденциальные или чувствительные данные, хранящиеся в облаке, соблюдать нормативные требования в отношении облачной безопасности и защищать свои облачные активы от кибератак, взломов или краж.

- Системы безопасности конечных точек на базе ИИ помогают организациям защищать конечные точки, системы и сети от вредоносных программ, фишинговых схем, программ-вымогателей и других целевых атак.

- Решения для безопасности Интернета вещей (IoT) на базе ИИ для защиты от киберугроз отдельных устройств и полноценных сетей IoT.

- Управление информацией о безопасности и событиями безопасности (SIEM), сетевое обнаружение и реагирование (NDR) и платформы расширенного обнаружения и реагирования (XDR) для автоматического выявления уязвимостей в инфраструктуре кибербезопасности организации и проактивного обнаружения и предотвращения кибератак до того, как они нанесут ущерб.

Как будет развиваться кибербезопасность на базе ИИ?

По мере совершенствования и распространения инструментов кибербезопасности на базе ИИ такие технологии, как машинное обучение, нейронные сети, генеративный ИИ, агентский ИИ, прогнозная аналитика, интеллектуальный анализ данных, а также «красные команды» и цифровые двойники, будут заметно влиять на способы защиты данных и активов.

Центрам SOC придется развиваться и переориентироваться на ИИ, чтобы эффективно использовать ИИ-модели безопасности и ИИ-инструменты обнаружения и реагирования на угрозы, а также принимать решения на основе прогнозов и аналитики от ИИ. Инструменты и технологии кибербезопасности на базе ИИ также, вероятно, будут постепенно интегрироваться с другими подходами, стратегиями и технологиями безопасности.

По мере развития сферы кибербезопасности на базе ИИ организации должны следить за этими и другими трендами, чтобы поддерживать максимальную надежность, целостность и актуальность своих мер безопасности с использованием ИИ.

Где можно получить помощь по кибербезопасности на базе ИИ?

Trend Vision One™ AI Security использует новейшие инструменты и технологии ИИ, чтобы помочь организациям внедрить полностью проактивный подход к безопасности на базе ИИ, который предотвращает кибератаки и утечки данных до их возникновения.

Платформа использует Trend Cybertron — первый в отрасли ИИ для по-настоящему проактивной кибербезопасности, созданный на основе 35-летнего опыта в области кибербезопасности и 20-летних инвестиций в разработку ИИ для безопасности. Trend Cybertron использует обширные большие языковые модели (LLM) и проверенные наборы данных для обучения ИИ, чтобы значительно повысить эффективность защиты от киберугроз.

Корпоративная платформа кибербезопасности Trend Vision One™ также содержит передовые инструменты агентского ИИ, которые предназначены для постоянного развития и адаптации на основе реальных кибератак и аналитики угроз. Стремление к непрерывному совершенствованию и инновациям позволяет организациям следить за новыми и возникающими киберугрозами и оставаться на шаг впереди злоумышленников.

Часто задаваемые вопросы

Что такое ИИ в кибербезопасности?

Применение ИИ в кибербезопасности подразумевает использование инструментов и технологий ИИ для защиты организаций от взлома, кражи данных и кибератак.

Как ИИ используется в кибербезопасности?

Поставщики кибербезопасности используют ИИ для анализа киберрисков, выявления пробелов или уязвимостей в защите организации и быстрого реагирования на угрозы.

Каково основное преимущество использования ИИ для кибербезопасности?

ИИ-инструменты обеспечивают более быстрый, точный, комплексный и проактивный подход к кибербезопасности.

Заменит ли ИИ кибербезопасность?

Хотя их применение может привести к потере рабочих мест, скорее всего, ИИ будет использоваться в качестве инструмента для специалистов по кибербезопасности, а не вместо них.

Что лучше для будущего: ИИ или кибербезопасности?

ИИ будет шире использоваться в кибербезопасности, помогая улучшать защиту и защищать организации от киберугроз.

Является ли ИИ угрозой кибербезопасности?

ИИ может укрепить вашу защиту от киберугроз, но злоумышленники могут использовать его для взлома или атаки на ИТ-системы.

Теряет ли кибербезопасность актуальность?

Нет, кибербезопасность не теряет актуальности. По мере того как риски безопасности развиваются, а кибератаки становятся все более изощренными, кибербезопасность растет и развивается вместе с ними.

Насколько эффективен ИИ в кибербезопасности?

ИИ-инструменты могут стать чрезвычайно эффективным способом улучшения защиты от кибератак, расширения возможностей обнаружения угроз и реагирования на них, а также защиты от кибератак.

Полезен ли ИИ в кибербезопасности?

ИИ играет все более важную роль, помогая организациям оптимизировать процессы, расширять возможности и автоматизировать кибербезопасность.

Продолжит ли кибербезопасность существование при распространении ИИ?

Кибербезопасность продолжит существовать при распространении ИИ, отчасти потому, что она использует ИИ-инструменты для выявления, прогнозирования и реагирования на новые киберугрозы по мере их появления.

Каков процент успеха при использовании ИИ для обнаружения кибератак?

ИИ может значительно улучшить показатели обнаружения кибератак. По оценкам некоторых экспертов, вероятность успеха кибербезопасности на базе ИИ может достигать 85–99%.

Насколько значим ИИ на рынке кибербезопасности?

В 2023 году мировой рынок кибербезопасности на основе искусственного интеллекта составил около 22,4 млрд долларов США.

Может ли ИИ остановить все фишинговые угрозы?

Ни одна технология не может остановить все фишинговые угрозы. Однако инструменты на базе ИИ могут значительно повысить точность и эффективность антифишинговых мер.

Какой ИИ лучше всего подходит для кибербезопасности?

Среди лучших инструментов кибербезопасности на базе ИИ — системы обнаружения вредоносных программ, облачная безопасность, межсетевые экраны нового поколения (NGFW) и безопасность конечных точек.

Какие типы ИИ используются в кибербезопасности?

Инструменты кибербезопасности на базе ИИ включают защиту от вредоносных программ и фишинга, обнаружение угроз, авторизацию и контроль доступа.

Что означает ИИ в кибербезопасности?

ИИ означает «искусственный интеллект». В области кибербезопасности ИИ-инструменты помогают защищать организации от кибератак и киберпреступников.

Что такое ответственный ИИ в кибербезопасности?

Ответственный ИИ фокусируется на разработке и использовании инструментов кибербезопасности в соответствии с принципами справедливости, этики, прозрачности, безопасности и уважения прав человека.

Как можно использовать ИИ в кибербезопасности?

Генеративный ИИ может использоваться для быстрого и эффективного расследования, реагирования и смягчения последствий кибератак и других угроз.

Какова роль ИИ в кибербезопасности?

ИИ может играть важную роль в повышении эффективности и точности мер кибербезопасности.

Как ИИ формирует кибербезопасность?

По мере того как кибератаки становятся все более частыми и изощренными, ИИ-технологии помогают сделать защиту от кибератак более надежной, быстрой и мощной.

Статьи по теме

10 основных рисков и мер по их снижению для LLM и генеративного ИИ в 2025 году

Управление возникающими рисками для общественной безопасности

Как далеко заведут нас международные стандарты?

Как написать политику кибербезопасности для генеративного ИИ

Атаки с использованием ИИ — один из самых серьезных рисков

Распространение угроз, связанных с дипфейками