La seguridad de IA se refiere tanto a las herramientas, tecnologías y medidas de seguridad que las organizaciones usan para proteger su stack de IA, así como el uso de la IA para aumentar las capacidades de los sistemas de ciberseguridad, mejorando la detección de vulnerabilidades, la correlación y las acciones de respuesta, cambiando de un enfoque reactivo para la postura de seguridad a uno proactivo.

Índice

El término ”inteligencia artificial” (AI) fue acuñado en los años 50 para describir máquinas y computadoras que imitan la estructura y función del cerebro humano para llevar a cabo tareas complicadas, resolver problemas complejos, predecir resultados y aprender de la experiencia.

La seguridad de IA (también llamada seguridad con inteligencia artificial o “seguridad para IA”) es una rama de la ciberseguridad que abarca todos los procesos, prácticas y medidas que usan las organizaciones para proteger sus stacks de IA y proteger sus sistemas, información y aplicaciones de inteligencia artificial ante amenazas potenciales. Esto incluye el uso de herramientas y tecnologías impulsadas por IA para:

- Proteger cada aspecto de la red de IA de una organización, desde los endpoints hasta los modelos de IA

- Proteger los modelos, sistemas y aplicaciones de IA ante una gran variedad de amenazas, criminales y ataques

- Identificar y mitigar cualquier brecha o vulnerabilidad en las defensas antes de que pueda ser explotada

- Proteger la infraestructura e información de entrenamiento de IA para prevenir la corrupción, envenenamiento o robo de datos de los modelos de IA

- Asegurar la calidad y la integridad de los modelos de lenguaje de gran tamaño (LLMs), motores de IA generativa (GenAI) y pipelines de deep learning y machine learning (ML)

- Abordar potenciales problemas éticos alrededor sesgos, transparencia, privacidad de datos y rendición de cuentas

- Asegurar que todos los usos, datos y desarrollos de IA cumplen con leyes relevantes, políticas empresariales y regulaciones de la industria

Seguridad de IA vs ciberseguridad de IA

Aunque ambos términos suenan prácticamente iguales, hay una diferencia clave entre ellos.

Seguridad de IA se trata de proteger a la misma IA: proteger el stack de IA de una organización y sus sistemas, componentes, redes y aplicaciones.

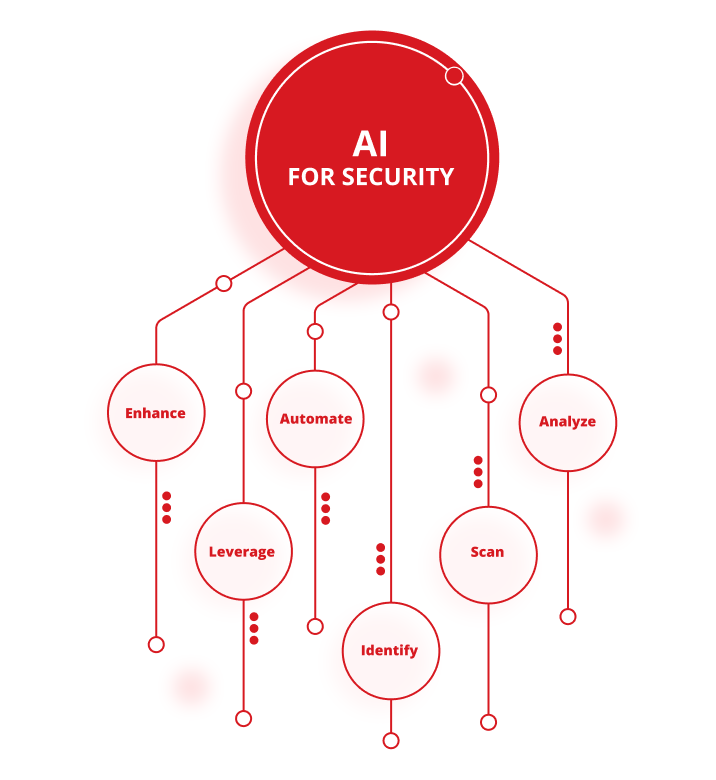

Ciberseguridad de IA (también llamado “IA para la seguridad”) busca usar herramientas y tecnologías de IA para proteger la infraestructura de TI contra cibercriminales y otras amenazas. Esto incluye usar la IA para:

- Analizar grandes volúmenes de información para detectar patrones, identificar anomalías y detectar posibles riesgos de seguridad

- Escanear y eliminar brechas y vulnerabilidades en las defensas de una organización

- Identificar y defender contra brechas de datos y otros ciberataques en tiempo real

- Automatizar las herramientas de detección y respuesta ante amenazas para reducir la carga de trabajo de los equipos de seguridad y mejorar la velocidad y la precisión de las defensas

- Aprovechar al máximo la última inteligencia de amenazas para mantenerse un paso adelante de los actores maliciosos y de los nuevos vectores de ataque

- Mejorar las estrategias y capacidades de gestión de amenazas de una organización

La importancia de proteger los sistemas de IA

Aunque la idea de la inteligencia artificial ha existido por décadas, los avances recientes en esta tecnología han transformado industrias completas, desde el transporte hasta la ciberseguridad. Desafortunadamente, la adopción masiva de la IA ha permitido que también la aprovechen los actores maliciosos, resultando en un incremento importante en el número de ciberataques, además de un aumento en su complejidad y su alcance.

Como resultado, las organizaciones deben asegurarse de que están haciendo todo lo que pueden para mantener la integridad, la confidencialidad y la disponibilidad de su información de IA, proteger sus herramientas y aplicaciones contra riesgos y ataques emergentes, y proteger sus modelos, sistemas y algoritmos de IA ante una gran variedad de amenazas.

No proteger los sistemas de IA de las amenazas podría vulnerar a la organización ante ataques, poner sus clientes y socios de negocio en riesgo y terminar costando millones de dólares en gastos de remediación, pagos de ransomware y pérdida de ventas y productividad.

¿Cuáles son los riesgos de seguridad para la IA?

El potencial que tiene la inteligencia artificial para revolucionar el campo de la ciberseguridad es muy prometedor. Pero existe un número creciente de desafíos y riesgos de seguridad para IA que las organizaciones necesitan considerar al momento de implementar una estrategia efectiva de seguridad de IA. Estas incluyen:

- Riesgo de una superficie de ataque más amplia: integrar modelos de IA propietarios y de terceros a la infraestructura de una organización puede expandir dramáticamente su superficie de ataque, incrementar el número de puntos débiles que los actores maliciosos podrían explotar, y vulnerar los sistemas de IA ante ciberataques.

- Riesgo de ataques a los algoritmos o datos de IA: los actores maliciosos podrían obtener acceso no autorizado a las herramientas y datos de IA, manipular la información o los algoritmos para insertar brechas o sesgos, y poner en riesgo la capacidad de los modelos de IA para realizar predicciones precisas o defender ante futuros ataques; además de manipular, dar mal uso o robar modelos o algoritmos.

- Riesgo de envenenamiento, corrupción o manipulación de datos: los cibercriminales podrían corromper los pipelines de machine learning (ML) o “envenenar” los modelos de IA al deliberadamente cambiar los datos de entrada o al insertar sus propios datos para comprometer las herramientas y los sistemas.

- Riesgos para los modelos de entrenamiento de IA: los cibercriminales podrían robar, manipular o hacer ingeniería inversa de los modelos propietarios de IA. También podrían corromper, infiltrar o modificar la información usada para desarrollar y entrenar los modelos de IA para comprometer su precisión, efectividad e integridad.

- Riesgo de sesgo, discriminación, falta de privacidad o de transparencia: el error humano y los ciberataques podrían incrementar el sesgo en los modelos de IA y potencialmente comprometer los principios de transparencia, justicia y rendición de cuentas.

- Riesgo de no cumplir con regulaciones industriales y gubernamentales: no cumplir con medidas de protección de información sensible, personal o confidencial podría resultar en multas por parte de reguladores gubernamentales o industriales, incluyendo, por ejemplo, General Data Protection Regulation (GDPR).

- Riesgo de ataques a terceros: los atacantes podrían atacar los sistemas de IA en cualquier punto de la cadena de suministro de una organización para aprovechar las debilidades de las redes, componentes, frameworks y bibliotecas de software de partners y terceros, y entonces usar esas vulnerabilidades para atacar otros modelos de IA en cualquier otro punto de la cadena.

- Riego de deriva y decadencia de los modelos de IA: con el tiempo, todos los modelos de IA son vulnerables ante la decadencia. Los actores maliciosos podrían explotar modelos en estos estados para alterar su comportamiento o comprometer su precisión y confiabilidad.

- Riesgo de robo de credenciales de chatbots: los cibercriminales podrían robar las credenciales de proveedores como ChatGPT y usarlas para obtener acceso ilegal a herramientas y sistemas propietarios de IA.

- Riesgo de fotos, videos y audios deepfake: los actores maliciosos podrían usar imágenes y videos deepfake generados con IA para cometer fraude, extorsión o engañar a los usuarios a brindar acceso a sistemas críticos, revelar información confidencial o robar información valiosa.

- Riesgo de ataques directos o indirectos de inyección de prompts: estos ataques pueden usar código malicioso para que los modelos de lenguaje de gran tamaño (LLMs) u otras herramientas de IA revelen información sensible, brinden acceso no autorizado o borren documentos clave.

- Riesgo de abuso de las “alucinaciones” de la IA: los cibercriminales podrían aprovechar las alucinaciones comunes de la IA para deliberadamente comprometer la información de la cual dependen los modelos y las decisiones que toman.

- Riesgos a activos e infraestructura en la nube: los cibercriminales pueden hackear los modelos de IA basados en la nube y robar información u otros activos.

Si las organizaciones no se aseguran de que sus medidas de seguridad de IA son lo suficientemente robustas e integrales, y que se encuentran actualizadas, los cibercriminales podrían explotar estos y otros riesgos para atacar los modelos de IA, robar información sensible y potencialmente causar daños financieros importantes, sin mencionar el daño resultante a la reputación de la organización.

¿Cuáles son los beneficios de la seguridad para la IA?

Las organizaciones que implementan medidas de seguridad de IA para proteger sus stacks de IA obtienen varias ventajas. Estas incluyen capacidades mejoradas para:

- Proteger la información de IA ante compromiso, corrupción, manipulación o robo

- Proteger los modelos de IA ante hackeos o ciberataques al correr herramientas de detección y respuesta, hunting y escaneo de vulnerabilidades en tiempo real

- Proteger las infraestructuras de IA al eliminar proactivamente las brechas o las vulnerabilidades en las defensas, gestionar y mitigar los riesgos y proteger los activos de IA

- Proteger a los usuarios de IA y las aplicaciones locales de código malicioso, accesos ilegales o no autorizados, fraudes y phishing, y ataques de malware y ransomware

- Control de accesos para los servicios públicos y privados de IA incluyendo aplicaciones de modelos de lenguaje de gran tamaño (LLM)

- Defender contra ataques zero-day dirigidos hacia vulnerabilidades desconocidas de software o hardware que permiten que los cibercriminales roben información, instalen malware u virus, o que obtengan acceso a la infraestructura de TI de la organización.

Mejores prácticas para la seguridad para la IA

Las soluciones de seguridad de IA más efectivas siguen un número de mejores prácticas y estándares industriales para proteger las herramientas y recursos de IA, y mejorar la postura de seguridad. Estas incluyen:

- Desarrollar una estrategia integral de seguridad de IA que combine modelado de amenazas avanzadas y actividades de threat hunting con capacidades de evaluación de riesgo impulsadas con IA, controles integrales de seguridad de IA, y planes y procedimientos de respuesta a incidentes para proteger los sistemas y la información de IA de la organización.

- Asegurar la calidad, integridad y confiabilidad de los datos de entrenamiento de la IA para abordar temas alrededor de la transparencia y los sesgos, para asegurar que los modelos de IA son lo más precisos y efectivos posible.

- Implementar frameworks de seguridad de IA con estándares de la industria para establecer un conjunto claro de estándares y guías para proteger los sistemas de IA, eliminar brechas o vulnerabilidades y mantener el cumplimiento con las regulaciones relevantes. Esto incluye integrar los frameworks de seguridad como el Artificial Intelligence Risk Management Framework de NIST (National Institute of Standards and Technology), la matriz Adversarial Threat Landscape for Artificial-Intelligence Systems (ATLAS) de MITRE, Sensible Regulatory Framework for AI Security, la lista de OWASP (Open Worldwide Application Security Project) de Top 10 Best Practices for Large Language Model (LLM) Applications, el Secure AI Framework (SAIF) de Google, y los estándares para los sistemas de gestión de seguridad de la información (ISMS) de ISO/IEC 27001.

- Integrar la seguridad de IA con medidas existentes de seguridad para crear protección de punta a punta ante las ciberamenazas para todas las aplicaciones, herramientas, sistemas y redes de IA y TI.

- Programar capacitación para empleados para que estén al tanto de las últimas amenazas y medidas de seguridad, y crear una cultura corporativa basada en la mejora continua.

- Monitorear, evaluar y actualizar continuamente los modelos de IA para escanear y mitigar las vulnerabilidades en las herramientas y sistemas de IA, identificar amenazas emergentes cuando surjan, y constantemente refinar los modelos y aplicaciones de IA para mejorar su precisión, desempeño y confiabilidad.

Ejemplos de las aplicaciones de la IA en la ciberseguridad

Conforme las herramientas de inteligencia artificial se vuelven más avanzadas, el número de usos y aplicaciones potenciales para la IA en la ciberseguridad también incrementa.

Entre otros beneficios, las aplicaciones de la IA en la ciberseguridad podrían mejorar significativamente el alcance y la efectividad de las defensas de una organización al automatizar sus actividades de detección y respuesta a incidentes , escaneando para detectar vulnerabilidades y tomando otras medidas proactivas de forma regular, y usando la última inteligencia de amenazas y analíticos de seguridad para predecir y proteger a las organizaciones ante ciberamenazas emergentes.

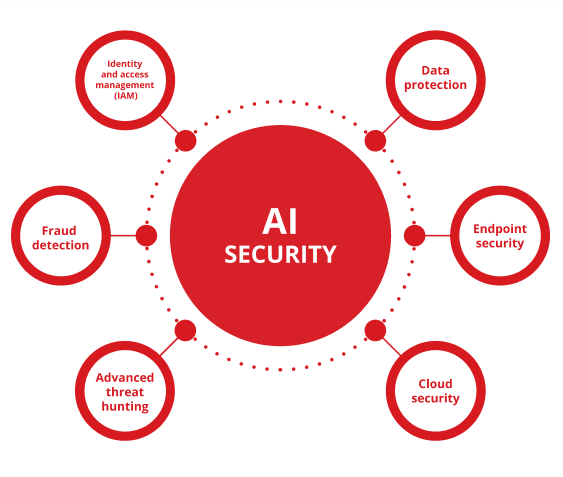

Algunas de las aplicaciones más efectivas y adoptadas de la IA para la ciberseguridad incluyen su uso en la protección de datos, seguridad para endpoints, seguridad en la nube, hunting avanzado, detección de fraudes y gestión de identidades y accesos (IAM).

- Protección de datos

Las organizaciones pueden usar la IA para clasificar y encriptar su información confidencial o sensible, monitorear el acceso a los sistemas para detectar brechas más rápido, proteger la información de IA ante pérdida o corrupción, y proteger su stack de IA ante accesos o usos no autorizados. Sin embargo, los puntos ciegos respecto a la información sensible en los ambientes de IA podrían dar lugar a brechas de datos y a problemas de cumplimiento, haciendo que sea más importante identificar y mitigar proactivamente esas vulnerabilidades.

- Endpoint security

Las soluciones habilitadas con IA de detección y respuesta en endpoints (EDR) pueden ayudar a proteger laptops, desktops, servidores, dispositivos móviles y otros endpoints en la red en tiempo real al detectar y bloquear malware, ransomware y otros ciberataques de forma proactiva.

- Seguridad para la nube

Las tecnologías de seguridad en la nube potenciadas con IA pueden monitorear y controlar constantemente el acceso a los ambientes en la nube, identificar cualquier anomalía o actividad sospechosa, alertar a los equipos de seguridad acerca de cualquier amenaza y proteger la información y aplicaciones basadas en la nube ante accesos no autorizados y brechas de datos.

- Threat hunting avanzado

Las herramientas avanzadas de threat hunting pueden fácil y rápidamente analizar los logs, patrones de tráfico en la web y las actividades de los usuarios para buscar ataques, detectar a los cibercriminales antes de que puedan causar año, y proteger los sistemas de IA contra amenazas avanzadas persistentes (APTs) y otros ciberataques.

- Detección de fraudes

Las organizaciones en los sectores bancario y financiero pueden usar algoritmos de machine learning (ML), redes neuronales y otras tecnologías avanzadas de IA para detectar actividades fraudulentas, bloquear acceso no autorizado a cuentas bancarias y prevenir el robo de identidad en las transacciones financieras.

- Gestión de identidades y accesos (IAM)

Las soluciones de gestión de identidades y accesos (IAM) potenciadas por IA pueden ayudar a las organizaciones a monitorear y proteger cada paso de sus procesos de autentificación, autorización y acceso, para asegurar que siguen las políticas y playbooks empresariales de IA, mantener el cumplimiento con las regulaciones de la industria, prevenir accesos no autorizados a información sensible y mantener a los hackers fuera de los sistemas.

¿Dónde puedo obtener ayuda con la seguridad de IA?

Trend Vision One™ es una plataforma de ciberseguridad todo en uno impulsada por IA.

Trend Vision One cuenta con un poderoso conjunto de herramientas y tecnologías de IA líderes en la industria que son capaces de detectar, predecir y prevenir las ciberamenazas de forma mucho más rápida y efectiva que los equipos humanos tradicionales de seguridad. Lograr una seguridad efectiva para los stacks de IA requiere de proteger cada capa, desde los datos hasta la infraestructura y los usuarios, asegurando la visibilidad de los despliegues de shadow AI, implementando controles estrictos de acceso para el cumplimiento y establecer guías para prevenir malos usos y envenenamiento de modelos. Estas capacidades permiten que las organizaciones protejan su stack completo de IA y su información, aplicaciones y sistemas ante la gran mayoría de los ciberataques actuales.

Trend Vision One también incluye las capacidades incomparables impulsadas con IA de Trend Cybertron: la primera IA de ciberseguridad verdaderamente proactiva del mundo. Aprovechando la colección de modelos de lenguaje de gran tamaño (LLMs), conjuntos de datos, agentes de IA avanzados y más de 20 años de inversión en el campo de la seguridad de IA, Trend Cybertron puede analizar patrones e información histórica para predecir ataques específicos a cada cliente, permitir que las organizaciones logren tiempos de remediación 99% más rápidos que la respuesta tradicional a incidentes, y transformar las operaciones de seguridad de una organización de reactivas a proactivas prácticamente de un día para otro.

Trend Cybertron también fue diseñado para evolucionar y adaptarse continuamente para mantener el paso de los cambios en las necesidades de una organización, y mantenerse al tanto de las últimas tácticas, técnicas y procedimientos (TTPs) que están usando los cibercriminales. Esto permite que las organizaciones aseguren que tanto sus defensas de ciberseguridad y de seguridad para IA siempre sean robustas, completas y que estén actualizadas.

Michael Habibi es un líder de ciberseguridad con más de 12 años de experiencia, especializándose en desarrollo de producto y en innovación estratégica. Como Vicepresidente de Gestión de Productos en Trend Micro, Michael impulsa la alineación de la estrategia de seguridad para endpoints con el panorama de amenazas del mundo real.

Preguntas Frecuentes

¿Qué es la seguridad de IA?

La seguridad para IA (o “seguridad de IA”) consiste en usar distintas herramientas, prácticas y tecnologías para proteger el stack de IA de una organización.

¿Cuál es el significado de la IA en la seguridad?

IA se refiere a “inteligencia artificial”. La IA puede usarse en la seguridad para mejorar las defensas de ciberseguridad de una organización y proteger sus stacks de IA.

¿Cómo puede usarse la IA en la seguridad?

La IA puede usarse para proteger redes, modelos, sistemas, endpoints y aplicaciones de IA ante ciberataques, corrupción de datos y otras amenazas.

¿Qué es la IA en la ciberseguridad?

La IA en la ciberseguridad se refiere al uso de herramientas y tecnologías de IA para ayudar a proteger las organizaciones ante los ciberataques.

¿Es la IA un riesgo de seguridad?

Como cualquier tecnología, la IA puede usarse para mejorar las medidas de seguridad o para lanzar ciberataques más poderosos.

¿Es la IA una buena opción de carrera?

La seguridad de IA es un campo en crecimiento que ofrece oportunidades laborales desafiantes pero bien pagadas.

¿Cuánto ganan los expertos en IA?

Dependiendo de su experiencia y ubicación, los oficiales de seguridad de IA pueden ganar cualquier cosa entre el equivalente de $60,000 y $120,000 dólares al año.

¿Cómo puedo ingresar en el campo de la seguridad de IA?

Algunos buenos puntos de partida para una carrera en seguridad de IA son cursos de capacitación en línea, títulos en ciencias de la computación o ciberseguridad, y certificaciones de seguridad de IA.

¿Cuál es la diferencia entre la ciberseguridad y la seguridad de IA?

La ciberseguridad se refiere a las herramientas y sistemas que protegen a las organizaciones ante ciberataques. La seguridad de IA busca proteger el stack de IA de una organización.

¿Puede la IA hacer ciberseguridad?

Bajo supervisión humana, las tecnologías de IA pueden mejorar dramáticamente la velocidad, precisión y efectividad de casi cada aspecto de la ciberseguridad.

¿Cuál es la diferencia entre la ciberseguridad tradicional y con IA?

Aunque sus objetivos y métodos son los mismos, la ciberseguridad con IA puede brindar una protección más rápida, precisa y proactiva que la ciberseguridad tradicional.

¿Es necesario saber programar para entrar al campo de la ciberseguridad?

Aunque la programación puede ser una habilidad muy valiosa para los trabajos en ciberseguridad, existen varias posiciones en el campo que no requieren de ninguna experiencia o expertise en código.

¿Por qué es la IA una amenaza de seguridad?

Los actores maliciosos podrían usar la IA para hackear los sistemas de TI, robar información confidencial, corromper los stacks de IA o lanzar ciberataques sofisticados.

¿Cuál sería un ejemplo de una brecha de datos de IA?

Se han utilizado deepfakes de IA para simular las voces o imágenes en video de personas reales, convenciendo a los empleados de las organizaciones de compartir información confidencial.

¿Son seguras las aplicaciones de seguridad de IA?

Al final, la seguridad de una aplicación de seguridad depende de qué tan confiable es su desarrollador, no de su precio. Evite marcas pequeñas, desconocidas o que no han sido probadas independientemente, y evite aplicaciones de fuentes desconocidas.

¿Cuáles son los riesgos de seguridad con la IA?

Algunos riegos asociados con la seguridad de IA incluyen la expansión de la superficie de ataque, envenenamiento y corrupción de datos, y riesgos para la información, algoritmos y modelos de entrenamiento de la IA.

¿Cómo sé si mi sistema de IA tiene un riesgo alto?

Las organizaciones pueden reducir los riesgos que corren los sistemas de IA analizando sus defensas actuales, siguiendo mejores prácticas de la industria e implementando estrategias integrales de ciberseguridad y de seguridad para IA.

¿Puedo confiar en los detectores de IA?

Aunque los detectores de IA pueden ser herramientas efectivas, también pueden cometer errores. Por lo tanto, sus resultados solamente deben usarse como una señal preliminar para determinar si se necesita investigar con más profundidad, y esto depende del juicio humano.

¿Cómo puedo ser más cuidadoso con la IA?

Un enfoque cuidadoso para la IA requiere distintas acciones de parte de usuarios y creadores. Ya sea que sea usuario o desarrollador, la regla fundamental es tratar a la IA como una herramienta poderosa pero imperfecta; no como un experto infalible o como un amigo de confianza.

¿Cómo puedo proteger la IA?

Una postura integral de seguridad para el stack de IA no deja brechas, y aplica medidas de protección en cada uno de los componentes, desde los usuarios y la información que generan, hasta los modelos, microservicios y la infraestructura subyacente.

Artículos Relacionados