La mise en œuvre des technologies d’IA introduit de nouvelles vulnérabilités qui n’existaient pas dans les environnements informatiques traditionnels. Il s’agit notamment de cyberattaques malveillantes initiées par des cybercriminels et de vulnérabilités de plateformes ou liées au comportement d’utilisateurs.

Table des matières

Vulnérabilités pour la sécurité liées à l’IA

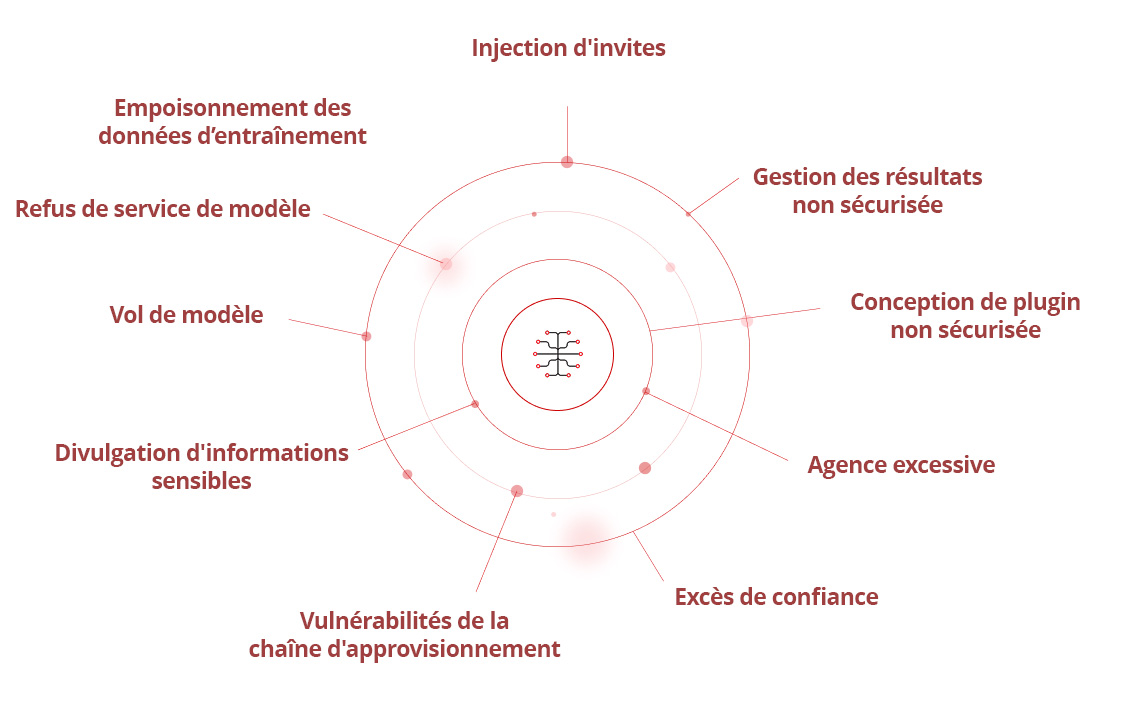

L’OWASP (Open Worldwide Application Security Project) a identifié une série de vulnérabilités relatives à l’intelligence artificielle (IA) fondée sur des modèles de langage (LLM) et l’IA Générative. Il s'agit notamment des vulnérabilités suivantes :

- Injection d'invites (prompts)

- Gestion non sécurisée des réponses de l’IA

- Empoisonnement des données d’entraînement

- Déni de service du modèle

- Vulnérabilités de la chaîne d'approvisionnement

- Divulgation d'informations sensibles

- Conception de plugins non sécurisés

- Excessive agency

- Excès de confiance

- Vol de modèle

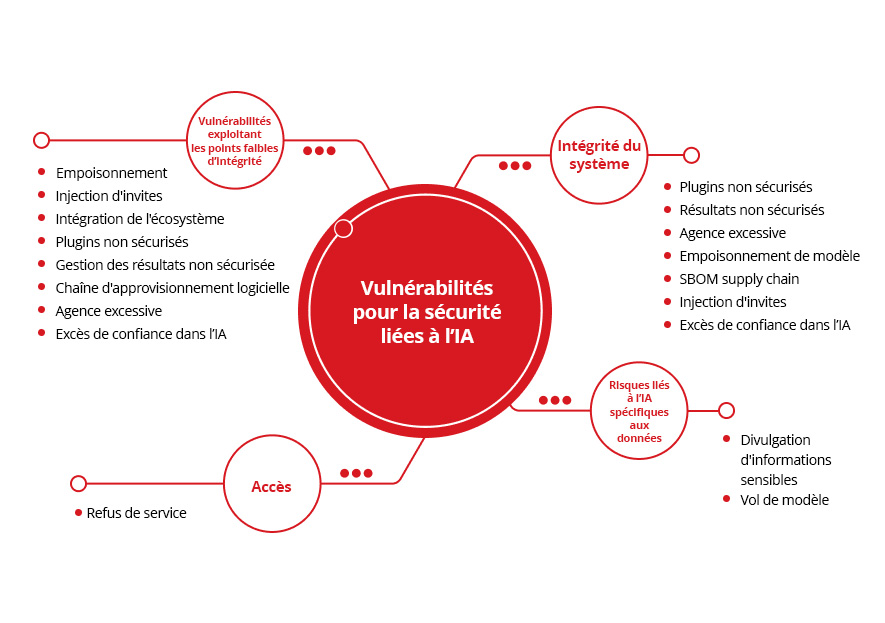

Ces vulnérabilités peuvent être regroupées et simplifiées dans les catégories essentielles suivantes :

Risques liés à l’IA spécifiques aux

données

Intégrité du système

Accès

Vulnérabilités exploitant les points faibles d’intégrité

Divulgation d'informations sensibles

Vol de modèle

Plugins non sécurisés

Gestion non sécurisée des réponses générées

Excessive Agency

Empoisonnement de modèle

SBOM de la chaîne d'approvisionnement

Injection d'invites

Excès de confiance dans l’IA

- Dénis de service

Empoisonnement de modèle

Injection de prompts

Intégration dans l'écosystème

Plugins non sécurisés

Gestion non sécurisée des réponses

Chaîne d'approvisionnement logicielle

Excessive Agency

Excès de confiance dans l’IA

L'IA repose fortement sur les données disponibles et les entrées des utilisateurs ; elle est donc de plus en plus ciblée par des acteurs malveillants qui cherchent à contourner les défenses numériques et à siphonner des informations sensibles. Dans une récente enquête Gartner®, les cinq risques émergents les plus cités au Q1 2024 ont été révélés. Les deux premiers risques liés à l’IA sont les attaques malveillantes optimisées par l’IA et la désinformation assistée par l’IA. Comme le note Gartner, l’amélioration de l’IA peut « faciliter le phishing et l'ingénierie sociale, ce qui renforce les capacités d’intrusion, la crédibilité et les dommages liés aux attaques. »

IA malveillante

Le terme d’IA malveillante désigne les cas où l’IA ne répond pas à l’objectif de l’utilisateur. Cette différence peut être accidentelle, par exemple en cas de défaillance des protections appropriées. Elle peut également être intentionnelle : dans ce cas, les acteurs malveillants peuvent chercher à corrompre le système d’IA d'une cible ou son utilisation, ou ils peuvent tenter d’installer des modèles d’IA malveillants dans un environnement.

Automatisation de la fraude

L'automatisation de la fraude désigne la création de contenu synthétique de texte, d'audio et/ou de vidéo qui exploite un processus métier via le phishing, l’usurpation d’identité par email (BEC) ou des vidéos et audios deepfakes. L'automatisation des fraudes grâce à l’IA permet à ces fraudes de gagner en volume.

Gouvernance des données

Les systèmes d’IA reposent sur les données. Les données utilisées dans les systèmes d’IA, et les données en direct qu’elles affectent, doivent donc respecter toutes les réglementations en matière de confidentialité et d’utilisation équitable. Il est donc nécessaire de mettre en place une gouvernance des données proactive et efficace pour minimiser les risques.

Risques pour la sécurité liés aux grands modèles de langage

Les LLM sont confrontés à des vulnérabilités critiques, notamment une injection rapide qui manipule le comportement du modèle, la divulgation d’informations sensibles qui expose des données confidentielles et une gestion inappropriée des informations en sortie qui active des attaques sur les systèmes en aval. Les autres risques majeurs comprennent les vulnérabilités de la chaîne d’approvisionnement causées par des dépendances tierces, une vulnérabilité de type excessive agency qui accorde des autorisations inutiles, un empoisonnement des données qui compromet l’intégrité du modèle et des fuites de données du système exposant des instructions confidentielles. De plus, l’intégration aléatoire des vecteurs, la génération de désinformation et les attaques de consommation sans limites des ressources du LLM menacent la sécurité, la fiabilité et la disponibilité des LLM.

Risques de sécurité liés à l’IA générative et impliquant des invites utilisateur

L’IA générative (GenAI) utilise les données passées et présentes disponibles pour aider les utilisateurs. Pour les outils qui nécessitent des invites, il est donc préférable de réfléchir de manière attentive et proactive à ce que vous allez saisir dans le champ d’invite. Certains outils permettent aux utilisateurs de se désabonner de la collecte de données ; par exemple, dans ChatGPT, une option permet de désactiver l’historique de discussion. Selon les politiques de gouvernance et d’utilisation de l’IA appliquées par l’organisme de réglementation du secteur en question, des mesures et/ou des comportements préventifs de ce type peuvent être exigés afin d'assurer la conformité.

L'ajout d’informations financières, de spécificités confidentielles sur les logiciels à venir, les informations d’identification personnelles comme les adresses personnelles et les coordonnées, et/ou les autres données sensibles signifient que les informations sont librement accessibles pour l’application d’IA. Ces données risquent d’être manipulées, partagées avec d'autres personnes dans les recommandations de l’outil en réponse à des requêtes similaires, et/ou volées par des acteurs malveillants si les mesures de protection de l’IA sont contournées. Ce risque est particulièrement vrai lors de l’utilisation d’outils d’IA générative pour l’idéation ou la compilation rapide de grandes quantités de données, en particulier si les mesures de sécurité et de chiffrement en place sont insuffisantes.

Risques pour la sécurité liés à ChatGPT

ChatGPT, une forme d’IA générative qui offre des réponses textuelles aux invites des utilisateurs, peut être manipulé par les acteurs malveillants pour déguiser et/ou améliorer leurs contenus de phishing. La plateforme elle-même peut aussi être ciblée pour permettre aux acteurs malveillants d'accéder aux données utilisateur, et potentiellement d’en faire un usage détourné. Il peut s'agir de créer des ébauches d’emails de phishing en utilisant des échantillons rédactionnel de l'organisation ou de la personne ciblée, et de corriger les fautes d’orthographe et de grammaire pour paraître plus convaincant. Il existe également un risque de vol et/ou de violations des données utilisateur via l’injection d’invites ou le jailbreaking.

Des risques pour la sécurité découlent également d’une utilisation qui n’implique pas directement des acteurs malveillants. Par exemple, les informations que ChatGPT reçoit de votre part peuvent être utilisées pour former les LLM. Il existe également un risque de chiffrement insuffisant des données, comme l'a démontré l’application ChatGPT MacOS qui se lançait initialement avec des conversations d'utilisateur stockées sous forme de texte brut.

Risques pour la sécurité avec OpenAI

L’API OpenAI en elle-même risque d’être ciblée par les cybercriminels. Bien qu’elle soit conforme à la norme SOC 2 et fasse l'objet de test de pénétration réguliers, le risque n'est jamais entièrement éradiqué, car les cybermenaces évoluent constamment. Un article récent de Soft Kraft explore en détail les risques de sécurité des données OpenAI, révélant ceux qui intéressent particulièrement les utilisateurs d'entreprise :

- Les données de conversation de ChatGPT peuvent être utilisées à des fins de ré-entraînement de modèles

- Les données envoyées via l’API peuvent être exposées en interne et en externe

- Il peut être difficile d'assurer la conformité au RGPD (Règlement général sur la protection des données)

- L’utilisation de sous-traitants tiers complexifie la gestion de l’emplacement et des données

Risques pour la sécurité liés à l’IA Microsoft Copilot

Avec la prise en charge des applications Microsoft 365, l’IA Microsoft Copilot est facilement disponible pour les utilisateurs. En outre, côté matériel, les derniers PC de marque Copilot+ sont livrés avec des touches Copilot physiques pour encourager une saisie utilisateur encore plus rapide. Ces mesures d'accès simplifiées peuvent introduire des risques de sécurité si des informations sensibles sont fournies à Copilot, tout comme à d'autres outils d’IA générative. Si les autorisations ne sont pas correctement définies, ou si les paramètres de confidentialité appropriés ne sont pas activés pour les documents générés par l’IA, vous pourrez également faire face à des fuites et/ou piratages de données confidentielles. Il en va de même pour la gestion des accès utilisateur. Enfin, les attaques sur la plateforme elle-même peuvent permettre aux acteurs malveillants de modifier la manière dont ils accèdent à vos données et les partagent.

Qui peut nous aider à gérer nos risques de sécurité liés à l’IA ?

L'innovation continue en matière d’IA nécessite une sécurité proactive et soutenue par 35 ans de veille sur les menaces, 20 ans de développement pionnier dans l’IA et une protection inégalée contre les vulnérabilités, c'est-à-dire Trend Vision One™ AI Security.

Grâce à notre solution AI Security, nous protégeons vos instances métier critiques, y compris l’ensemble de votre stack d’IA, tout en améliorant votre posture globale de sécurité. Optimisée par Trend Cybertron, notre sécurité IA prédit les chemins d’attaque et détecte les anomalies tout en se défendant contre les deepfakes et les attaques générées par IA pour éliminer les zones d’ombre dans la sécurité et transformer la sécurité IA en un catalyseur d’innovation.

Foire aux questions (FAQ)

Quels sont les risques de sécurité liés à l’IA ?

Risques IA incluent violations de données, attaques adverses, manipulation de modèles, atteintes à la vie privée et cybercriminalité.

Qui est le véritable père de l’IA ?

John McCarthy est considéré comme le père de l’IA pour avoir créé le terme et initié la recherche.

Quelles sont les 4 catégories de risque de l’AI Act ?

L’AI Act définit quatre catégories : risque inacceptable, risque élevé, risque limité et risque minimal pour systèmes IA.

Quelle est la règle des 30 % pour l’IA ?

Elle limite l’automatisation IA à 30 % des tâches, garantissant supervision humaine et responsabilité dans les décisions.

Comment l’IA impacte-t-elle la sécurité ?

L’IA améliore la cybersécurité mais introduit des vulnérabilités comme deepfakes, attaques automatisées et exploitation des données.

Mon système IA est-il à haut risque ?

Votre système IA est à haut risque s’il touche sécurité, droits fondamentaux, infrastructures critiques ou données sensibles.

Articles associés

Top 10 2025 des risques et des réductions pour les LLM et les applications d’IA de génération

Gestion des risques émergents pour la sécurité publique

Jusqu'où les normes internationales peuvent-elles nous emmener ?

Comment rédiger une politique de cybersécurité IA générative

Attaques malveillantes améliorées par l’IA parmi les principaux risques

Menace croissante des identités factices