重點摘要

• OpenClaw 是一款功能強大且高度自主的 AI 工具。

其設計特性——包括持續性記憶(persistent memory)、廣泛的系統權限,以及由使用者自行控制的設定機制——進一步放大了代理式 AI 所帶來的風險。

• 這些風險源自代理式 AI 本身的架構特性。

非預期行為、資料外洩,以及與未經審核元件互動所產生的暴露風險,都是所有代理式 AI 系統共同面臨的挑戰。OpenClaw 並未創造全新的風險類型,而是加劇並放大既有風險。

• 其快速普及已顯現真實世界的衝擊。

OpenClaw 的爆發式成長已導致實際事件發生,例如因設定錯誤而造成的敏感資料外洩。其受歡迎程度顯示,原本停留在理論層面的風險,能在極短時間內成為現實,而補救與治理措施往往落後於 AI 的採用速度。

• 零信任原則與持續監控至關重要。

即便是在使用者可自行控制的環境中,也不應對任何元件、技能或系統預設信任。

簡介

OpenClaw 這個名字您或許不能馬上認得,一部分的原因是它已經歷了多次改名,從 Clawdbot 改成 Moltbot,最後又改成 OpenClaw。但有一件事是肯定的:這套新的數位助理感覺上真的是劃時代突破,它能記住過去的互動、將資料保留在使用者裝置上,而且會適應個人偏好,它大幅躍進的能力,讓人想起 ChatGPT 當初發表時的感覺。然而它的發展並非毫無隱憂,因為新聞媒體一直在發出警告表示它可能成為資安的噩夢。

為了不讓使用者在熱潮與資安疑慮之間左右為難,我們決定深入 OpenClaw 一探究竟,首先看看它的能力與其他代理式 AI 助理比較起來如何。接著,我們將看看 OpenClaw 有何獨到之處,並將它的能力對應到我們的 TrendAI™ Digital Assistant Framework 數位助理框架。最後,我們將評估這些能力所帶來的風險:從非預期的動作、資料竊取,到暴露於未經審核的技能。

有一點從一開始就很明確:這些風險是代理式 AI 典範所固有的,並非 OpenClaw 才有。然而 OpenClaw 獨到之處在於它毫無限制的可設定性,使用者可以賦予它任意權限卻毫無任何強制性資安檢查。這樣的彈性大大提高了既有的風險,使得 OpenClaw 並不適合一般普通使用者,而是適合那些已經知道如何安全、負責任地部署這套工具,而且不會影響其自己或企業的數位生態系的使用者。

OpenClaw:一個針對真正需要自主性的使用者設計的 AI 代理

OpenClaw 並非一般的 AI 助理,這是一套圍繞在目標和動作而打造的 AI 代理,能在最少的監督下執行多重步驟的工作。它能理解一些像整理我的收件匣、總結此次的會議內容,並且明天提醒我,或是幫我預訂一班符合我行程的班機這樣的目標,並條列出每個行動步驟。

它能藉由使用者指定的大型語言模型 (LLM) 來解讀每一項目標,包括 ChatGPT、Claude 或 Gemini。然後,它會決定如何部署適當的工具來達成這些目標,從瀏覽器自動化、指令列命令,到檔案操作與呼叫技能等等。在等候指示要執行哪個目標時,OpenClaw 會維持著高度自主性。使用者不再只能下指令,而是可以定義好目標,然後相信 AI 助理可以在最少監督下執行一系列複雜的工作。

使用者可在自己的電腦上部署一個 OpenClaw 執行個體,並透過 WhatsApp、Telegram 和 Slack 等即時通訊軟體來跟執行個體互動。接下來,OpenClaw 會隨時更新每項工作的進度或狀態,不論是透過文字或語音。藉由追蹤對話內容,OpenClaw 就能聰明地執行工作。隨著時間的推移,這些情境洞見會累積到一個永久性記憶中,讓 AI 代理可以適應使用者的偏好和習慣,並執行橫跨不同聊天階段的目標,而不是每次聊天之後就重設。

OpenClaw 的能力遠遠超越個人生產力,它讓程式設計師能將除錯自動化並簡化 DevOps 工作流程,同時還讓使用者執行各種其他工作,例如:監控健康資料、控制智慧家庭裝置,甚至與汽車經銷商洽談買車流程。它最與眾不同的一點是使用者如何運用它:使用者不僅會交辦一些日常工作,更會將一些重大決策託付給 OpenClaw,包括財務決策。要做到這麼精密的工作,OpenClaw 就需要存取使用者整個數位生態系中的資源,包括資料儲存和銀行應用程式等服務。

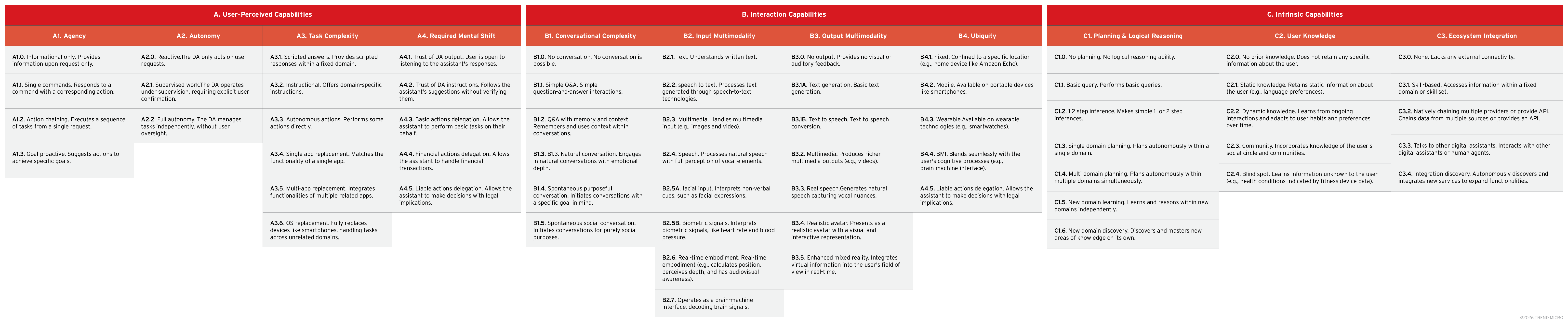

為了清楚描繪 OpenClaw 的能力,這裡借用了我們在 2024 年 12 月發表的 TrendAI™ Digital Assistant Framework 數位助理框架來檢視 OpenClaw,分析其能力如何對應至數位助理複雜的資安面向,如圖 1 所示。

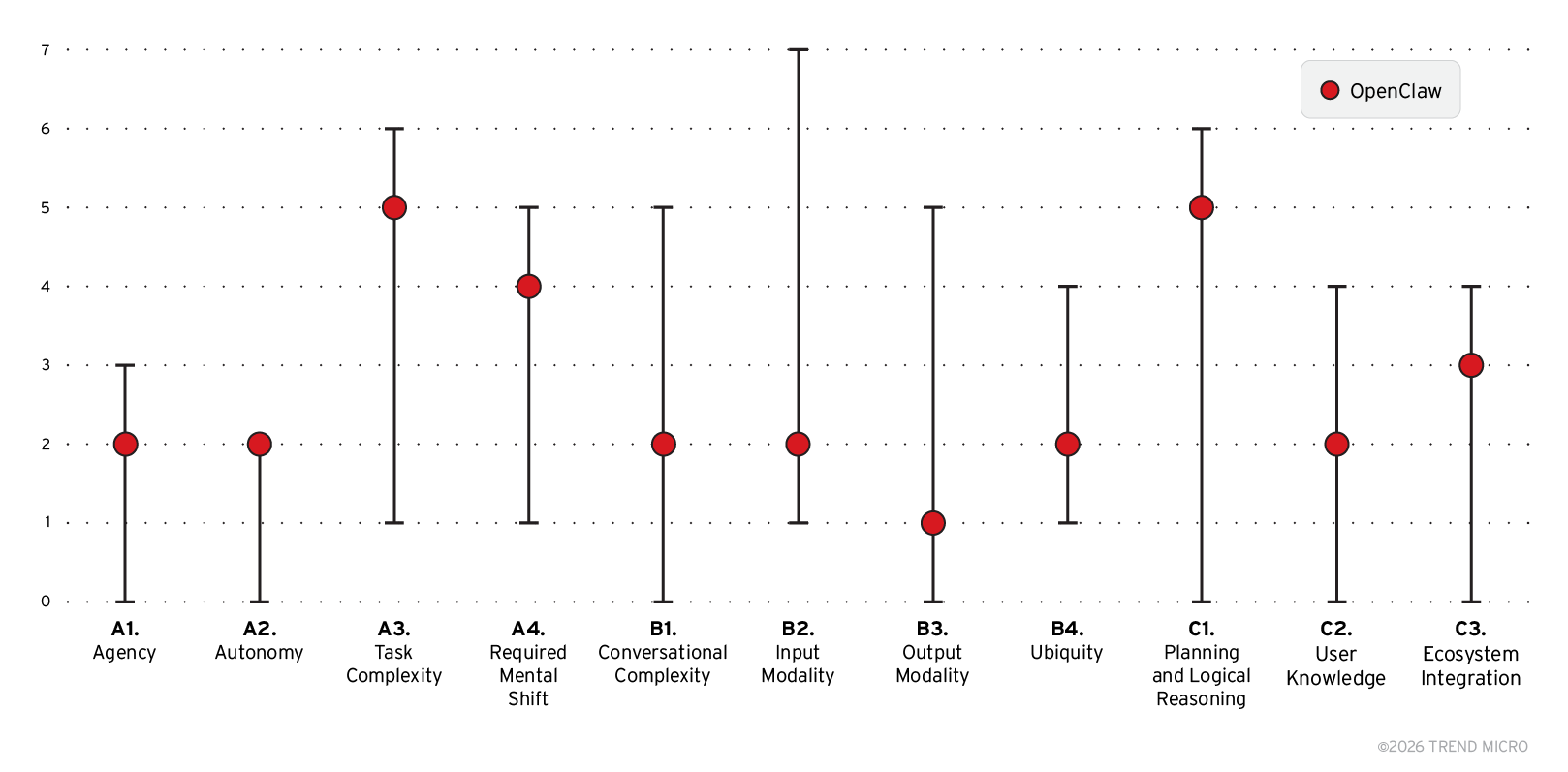

圖 2 顯示 OpenClaw 如何對應至這套框架,並點出它的重要特點與進展程度。

能力與風險:OpenClaw 有何不同?

OpenClaw 並非市場上第一次推出的主流代理式數位助理,然而它所激起的警戒卻更勝它的前輩,例如 ChatGPT Agent。為了解箇中原因,我們引用我們的框架來同時檢視這兩套 AI 助理。(我們在之前的文章中曾詳細介紹過 OpenAI 的 Agent)。

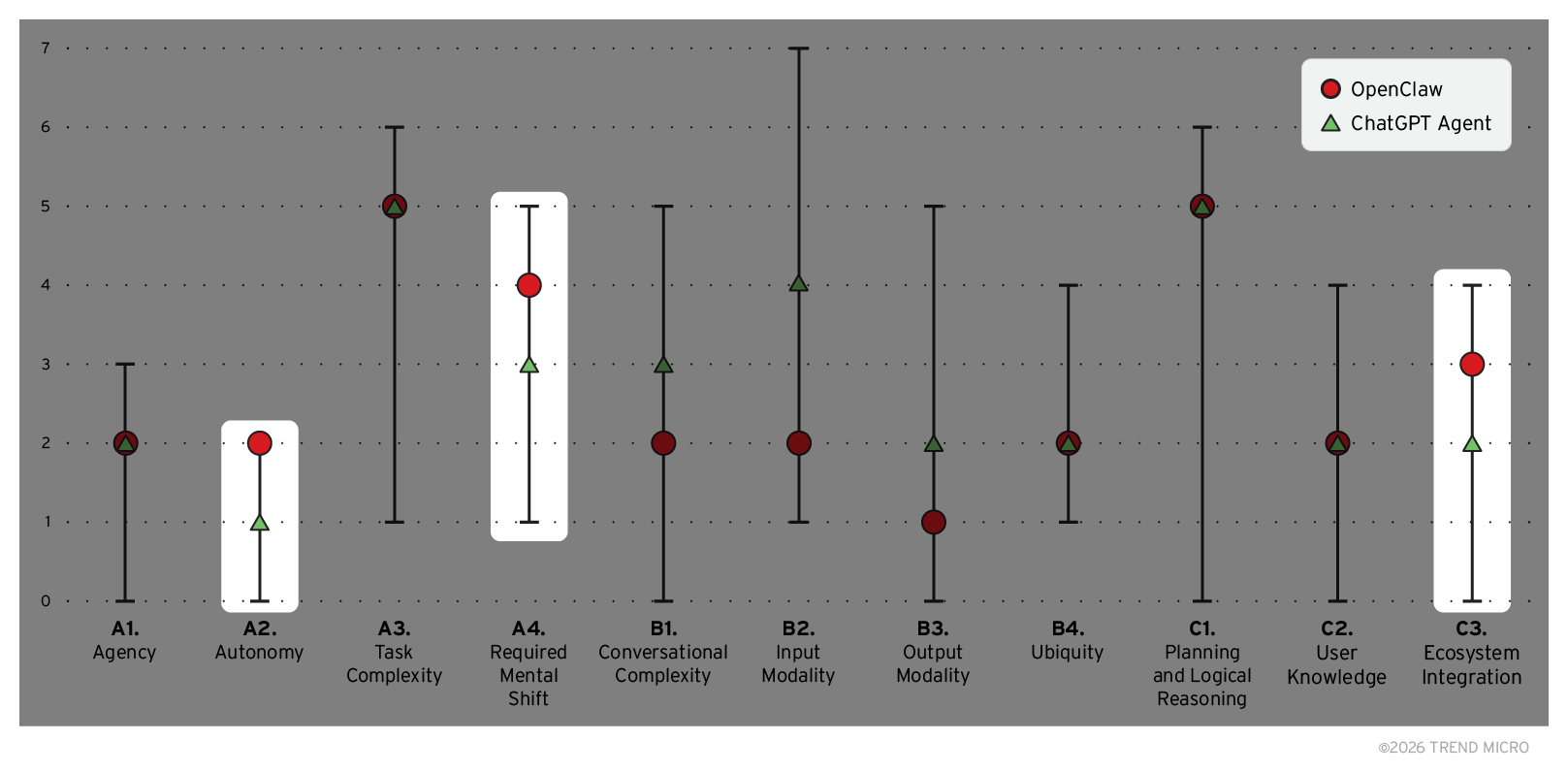

圖 3 顯示這兩套 AI 助理的比較圖,圖上標示出來的是 OpenClaw 分數高於 ChatGPT Agent 的能力。這份比較將成為我們的討論基礎,方便我們探索它們的差異,以及更廣泛的代理式 AI 典範所帶來的資安風險。

如圖 3 所示,OpenClaw 與 ChatGPT Agent 在大多數項目上並無太大差異。在好幾項能力上,這兩個數位助理基本上不分軒輊,例如,兩者都能自主決定如何追求特定目標 (代理能力、A1),並且可透過行動平台存取 (普及能力、B4)。

儘管 OpenClaw 和 ChatGPT Agent 都具備相同程度的使用者知識 (C2),但處理的手法卻不盡相同:OpenClaw 會維持永久記憶,而 ChatGPT Agent 的情境資訊只保留到每次對話結束。在某些項目當中,OpenClaw 的分數甚至低於 OpenAI 的 AI 代理,尤其是涉及複雜對話與可支援的媒體時 (ChatGPT Agent 受益於絕佳的多種媒體輸入和輸出能力)。

從風險的角度來看,這兩個 AI 代理之間的相似度很高,這意味著 OpenClaw 也可能面臨許多我們先前在 ChatGPT Agent 上已經發現並討論過的風險。

規劃與邏輯推理 (C1) – 提示注入

由於 OpenClaw 可跨越不熟悉的領域執行規劃和推理 (C1),因此容易遭到提示注入以及其他可影響 AI 代理行為的細微操弄。請注意,這項風險並非 OpenClaw 所獨有,而是任何仰賴 LLM 來驅動推理和協調的 AI 代理都會遇到的問題。駭客可能將惡意提示內嵌在某個網頁、或隱藏在一份文件內,不論是看得見的文字或是在 metadata 中,使得 AI 代理替駭客執行了非預期或有害的動作。

生態系整合 (C3) – 資料外傳與外部系統存取

能與其他 AI 代理溝通的能力,是 OpenClaw 的一項決定性能力,正是因為這項能力,才催生了一個專為 AI 代理設計的社群網路:Moltbook。這種「代理對代理」的互動形式,是 OpenClaw 在生態系整合 (C3) 項目上的分數略高於 ChatGPT Agent 的關鍵因素。然而,除了這項差異之外,兩個代理式 AI 助理都需要廣泛存取使用者的數位生態系資源,才能發送電子郵件、修改行事曆、刪除檔案,或執行指令。

這項能力對於動作導向的行為非常重要,但也因此帶來了一項共通的風險:萬一遭駭客入侵,兩者都可能讓他們先前知道的使用者敏感資訊外洩。對 OpenClaw 來說,這項風險尤為明顯。其永久性記憶會保留長期的對話情境、使用者偏好,以及互動歷史記錄,憑著這點,再加上它與其他代理溝通的能力,就可能讓這些資訊被分享給其他的代理,包括惡意的代理。不僅如此,由於這兩個 AI 助理都能直接連接多項服務,所以,一次的操弄甚至可能波及外部系統。

此外,這個更大的生態系暴露於供應鏈攻擊的風險也會升高。AI 代理可能用到一些未經充分審查的外部技能或工具,正如我們先前的研究所討論的。如果這些相依元件當中有任何一個心懷惡意或遭到入侵,那麼委外的元件就會讓駭客暗中影響 AI 代理的行為、將資料外傳,或者以 AI 代理的權限來執行動作。

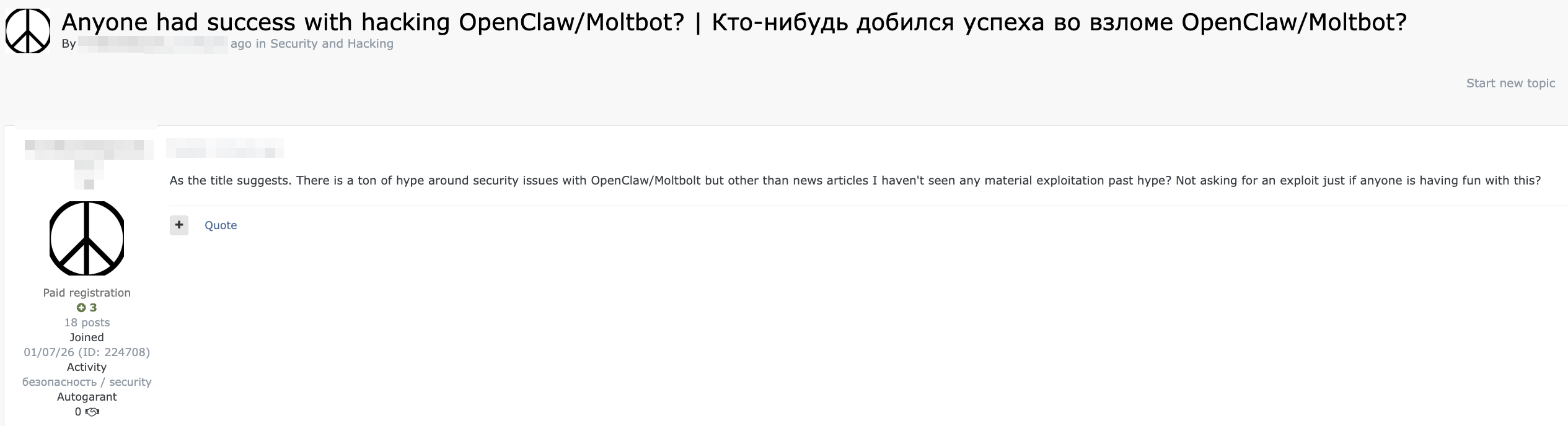

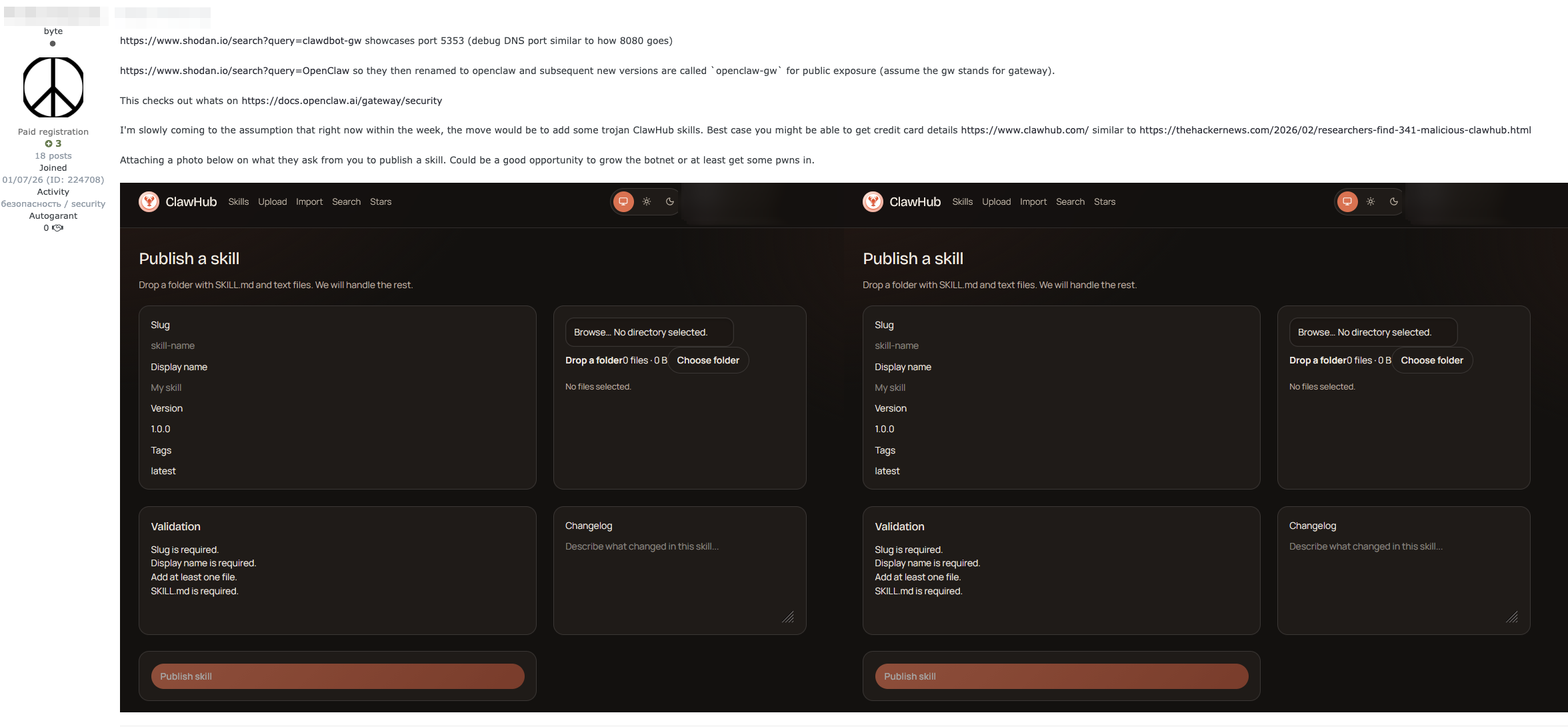

這早已不是假設性問題:根據報告指出,已經有人將惡意的技能發布到 OpenClaw 的官方擴充元件與技能中心 (ClawHub),而在網路犯罪地下市場上也看到了這樣一股趨勢。根據近期的調查顯示,Exploit.in 論壇上的駭客正在積極討論如何部署 OpenClaw 技能來支援殭屍網路營運之類的活動,如圖 4 所示。

就我們的框架來看,OpenClaw 某些能力的分數比 ChatGPT 還高。不幸的是,這些看似微小的差異卻會放大風險。例如,雖然 ChatGPT Agent 在技術上可以高度自主運作,但通常在執行可能造成真實後果的關鍵動作之前,必須先取得使用者的明確同意。某些敏感的工作 (例如發送電子郵件) 需要使用者主動核准,而且一些高風險的作業 (包括銀行轉帳) 都會被完全封鎖。

然而 OpenClaw 卻採取了另一種作法,它並沒有強制「讓人類介入」的機制,一旦設定好目標與權限之後,AI 助理就能完全自主作業 (A2),無須個別動作都需要核准。然而,缺乏強制的監督將提高風險:少了監督,AI 助理可能會超出其原本預定的作業範圍,而且萬一發生錯誤或遭人操弄,在造成真正損害之前可能都無法被察覺。此外,由於 OpenClaw 使用者可能允許 AI 助理執行金融交易 (A4),因此其潛在後果可能會特別嚴重,因為一但遭駭客入侵,就可能波及連接的支付應用程式。

缺乏監督的導入對企業環境的風險

從使用者的角度來看,OpenClaw 感覺上將帶來革命性改變。它與日常即時通訊軟體的整合讓它變得非常親和,其永久性記憶則可實現深度的個人化,而它在本機處理資料的作法則提供了強大的安全感與掌控能力,這一切都為使用者帶來了前所未有的數位助理體驗。

但從資安的角度來看,這些特點與其他代理式系統相比,並不會從根本上改變其風險態勢。TrendAI™ Digital Assistant Framework 所點出的風險,包括:非預期的動作、資料外傳、代理遭到操弄,以及暴露於未經審查的元件,這些都是代理式 AI 典範本身所固有的風險,不論 AI 助理如何實作。所以,為何 OpenClaw 吸引了這麼多關注,以及為何有這麼令人擔憂的新聞?

答案就在於它的爆紅與可客製化的特性。OpenClaw 是一個複雜的工具,使用者可依照自己的需求來高度客製化。這樣的彈性賦予了使用者力量,但同樣也讓這些使用者可以避開主流廠商 (如 OpenAI) 通常用來降低風險的安全機制。使用者可能犯了認證設定上的錯誤、授予 AI 助理完整的系統存取權限、讓帳號和外部服務擁有廣泛的存取權限,或者安裝未經審查的技能。

這些都不會創造新的風險,但會放大代理式 AI 固有的危險,讓一個完全自主的系統擁有存取使用者整個數位生態系的權限。這些風險,再加上使用者正如火如荼地導入 OpenClaw 這類代理式系統,使得資安矯正、事件回應以及合規作業等措施都很難跟上。

各種研究和真實事件都清楚證明了這一點,OpenClaw 執行個體的組態設定錯誤與未經審查的技能,已造成了數百萬筆資料遭到外洩,其中包括:API 權杖 (token)、電子郵件地址、私人訊息,以及第三方服務的登入憑證。這些案例證明了使用者的決定如何大幅增加資料遭到外傳以及整個連網系統出現非預期動作的可能性和衝擊。

即使這些 OpenClaw 執行個體的設定都完美無瑕,而且所有已知的漏洞都已獲得矯正,但其根本的風險依然存在,只不過遭到攻擊的門檻較高而已。自主性、廣泛的權限,以及非確定性決策,都是代理式系統的核心特色,而且光靠修補或組態設定並無法完全將它們消除。

這就是資產管理與零信任原則不可或缺之處:任何元件、模型或技能都不應該被無條件信任,即使是在使用者所掌控的系統內。零信任不會消除 AI 代理的風險,但卻能在發生問題時降低其衝擊。這意味著要將 AI 代理的權限嚴格限制在絕對必要的範圍內、強制監督高衝擊性動作,並且對任何 AI 代理、模型、技能或工具都要嚴格審查。此外也必須接受一個艱難的現實:有些工作或許根本不應該委託給 AI 代理,因為風險太高。這就引發了下列問題:我們是否真的放心讓代理式系統處理金融交易之類的關鍵領域?

結論

本文探討了 OpenClaw 的獨到之處、它與其他代理式助理的比較 (借助 TrendAI™ Digital Assistant Framework 數位助理框架),以及它的能力所帶來的風險。此外,我們也示說明了這些風險 (如:提示注入、資料外傳,以及暴露於未經審查的元件) 並非 OpenClaw 所特有,而是代理式 AI 典範本身所固有。使用者所做的決定,例如授予 AI 助理廣泛的權限或整合外部技能,只是放大了這些風險。

OpenClaw 的快速普及是一記醒鐘,它的突然爆紅,只是讓我們了解代理式 AI 的真實風險來得有多急,並突顯出單靠資安矯正手段在 AI 時代有多麼不足。缺乏監督的部署、廣泛的權限,以及高度的自主性,都可能將理論上的風險變成實際的威脅,而且這並不侷限於個人使用者,同時也涵蓋了整個企業。

根據一份近期的報告顯示,每五家企業就有一家在未獲得 IT 核准的情況下部署了 OpenClaw,突顯出這是一項系統性隱憂,而非獨立的個案。其核心的衝突很明顯:AI 代理的能力越強、越容易客製化,其發生錯誤、操弄、濫用的潛在衝擊就越大,而缺乏監督的導入將放大這些風險。

像 OpenClaw 這樣的開放原始碼代理式 AI 工具,其使用者所需的基本資安能力遠比受管理平台還要更高。這些工具是專為完全了解 AI 助理內部運作的個人和機構而設計,此外還必須了解怎樣才能安全、負責任地加以運用。

伴隨著代理式 AI 而來的是能力和風險之間的取捨,真正的挑戰是對兩者都有清楚的認識,並且有意識地選擇該讓代理式系統做些什麼。

TrendAI™ 能提供什麼協助?

如前面提到,我們所提出的風險並非任何單一工具能夠消除,它們是代理式 AI 典範本身所固有。不過,我們建議可透過 TrendAI Vision One™ 來將零信任原則落實在營運當中,協助企業在事件發生時降低衝擊。

OpenClaw 和類似的 AI 助理很容易遭到網頁、文件或 metadata 當中隱藏的惡意提示所攻擊。TrendAI Vision One™ AI Application Security 能即時檢查 AI 流量,在駭客嘗試注入提示之前預先發掘並加以攔截,不讓這些提示操弄 AI 代理的行為。對於正在自己打造代理式系統的企業,TrendAI Vision One™ AI Scanner 元件可當成一套自動化紅隊演練工具來使用,在部署之前主動測試是否有提示注入漏洞。

OpenClaw 之所以好用,就是因為它具備永久性記憶,但這也讓它成為被覬覦的目標:長期的對話情境、使用者偏好,以及互動歷程記錄,全都可能因為一次駭客入侵而全部外洩。AI Application Security 可將資料外洩防護同時套用到提示和回應上,在資料離開使用者環境之前預先過濾敏感資訊。這項過濾甚至會套用到「代理對代理」通訊管道上流通的資訊。

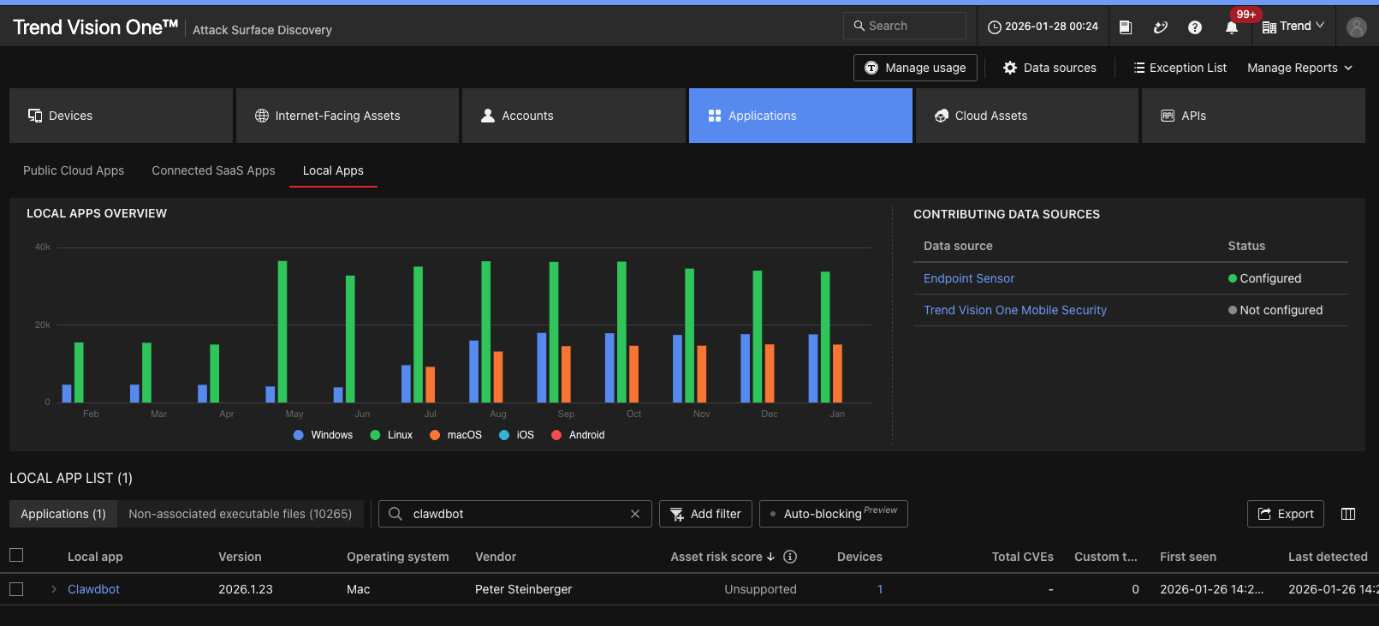

由於許多企業都是在未經 IT 核准的情況下部署 OpenClaw,因此企業的第一項挑戰就是要知道自己有哪些 AI 正在運作。TrendAI Vision One™ Cyber Risk Exposure Management (CREM) 能透過攻擊面發掘 (Attack Surface Discovery) 功能來持續發掘並掌握整個企業的 AI 資產,包括未經核准就在端點上執行的 OpenClaw 執行個體,如圖 5 所示。

然而,光有可視性還不夠:CREM 還能交叉關聯漏洞、組態設定錯誤,以及異常行為來評估風險並判斷風險的優先次序,讓資安團隊採取明智的行動,而非整天追著警報跑,將控管措施套用在最能發揮作用的地方。

權限必須受到嚴格限制,然而當使用者可以在毫無安全機制的情況下給予 AI 助理任意的存取權限時,這項工作將變得困難。TrendAI Vision One™ Zero Trust Secure Access (ZTSA) 超越了僵化的權限導向或規則導向控管:它會不斷評估身分、端點及 AI 服務的風險態勢,根據即時的情況動態允許或封鎖存取。

最重要的是,當 OpenClaw 或類似的 AI 代理經由 ZTSA 閘道代替使用者存取公共 AI 服務時,企業就能重新掌控原本將發生在資安邊界之外的互動。

這些功能不會讓代理式 AI 變成零風險,沒有什麼可以做到這點,但它們卻能提供一套技術基礎讓企業採取有意識而明智的作法,實現負責任的部署。

關於作者

TrendAI™ Research 的前瞻威脅研究團隊 (Forward-Looking Threat Research Team) 專門蒐尋未來一至三年內可能出現的技術,並聚焦三大不同面向:技術演進、社會衝擊,以及犯罪應用。因此,該團隊自 2020 年起便密切關注 AI 及其可能的濫用行為,並與歐洲刑警組織 (Europol) 及聯合國跨區域犯罪暨司法研究院 (UNICRI) 合作撰寫了一篇有關這項主題的研究。