代理式 AI 正迅速重新定義軟體系統的運作方式,有別於回應一道道的使用者提示,AI 代理現在能自行規劃工作、呼叫工具、修改其執行路徑,並且長時間維持運作。這樣的轉變,雖然開啟了強大的全新應用情境,但也為企業帶來了新的資安和治理挑戰。代理式 AI 正從一場實驗搖身一變成為營運系統,企業第一次被迫面對大規模自主性的問題。對資安長 (CISO) 和 AI 平台領導人來說,這衍生了一項新的治理難題。

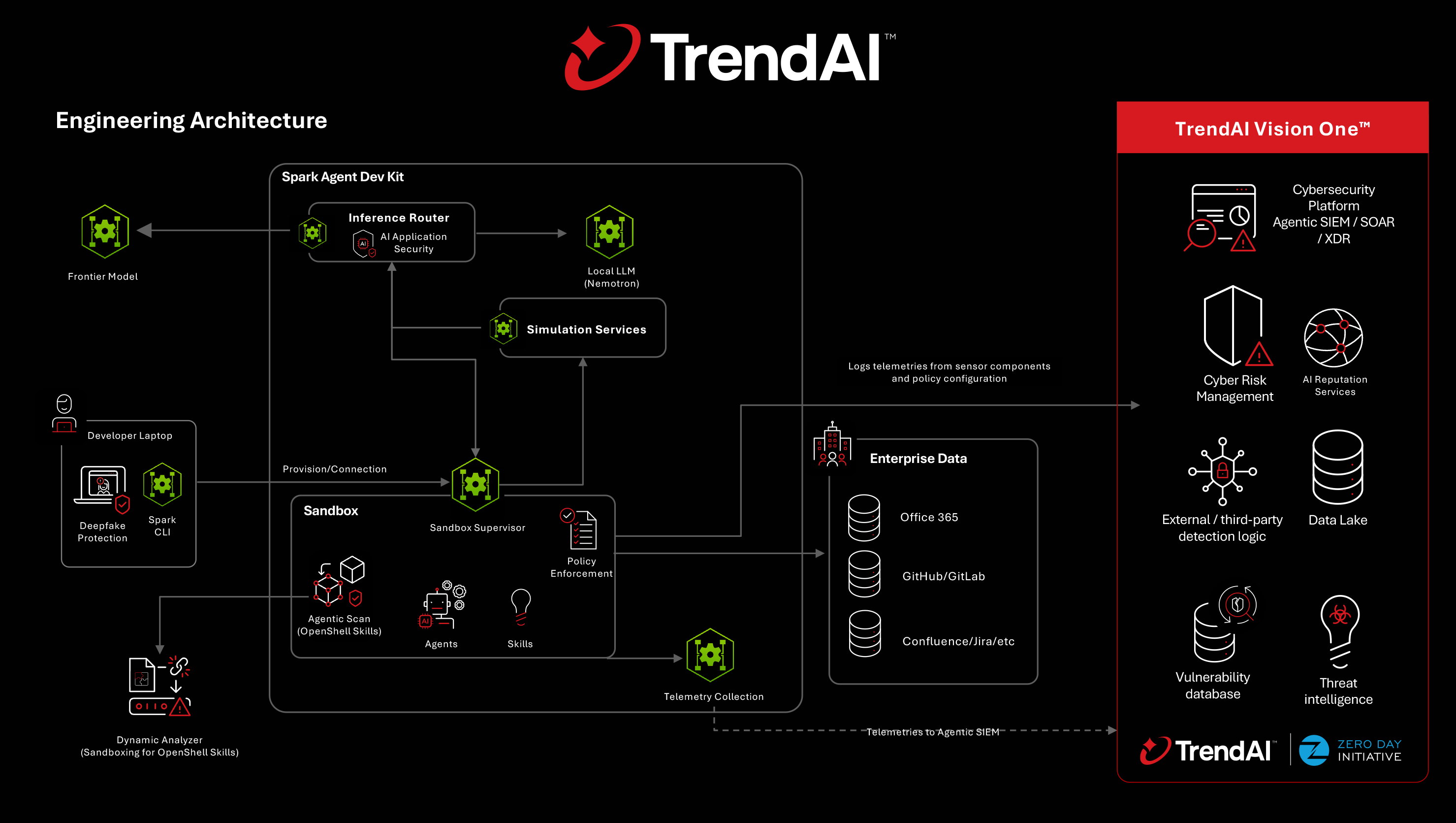

NVIDIA OpenShell 是一個開放原始碼執行時期環境,能更安全地透過規劃、記憶和工具執行來建構及部署自我進化的自主式 AI 代理。TrendAI 正與 NVIDIA 合作,透過與 OpenShell 整合,將治理、風險可視性以及執行時期強制能力直接融入 AI 代理的生命週期當中。

透過雙方的合作,我們將共同解決企業 AI 領導人今日最迫切的一項問題:您如何安全地大規模部署自主式 AI 代理而不犧牲控管、合規或信任?

為何代理式 AI 會改變資安模型

傳統的 AI 資安模型是建立在無狀態互動的基礎上:輸入提示、輸出回應。代理式 AI 打破了這樣的假設。

新的一波自我進化 AI 代理能夠:

- 在保有自我記憶和身分的情況下維持長時間運作。

- 保留本機與共用記憶。

- 動態選擇及呼叫工具或技能。

- 執行程式碼來支援新的功能。

- 將推論路由至各種本機和外部模型來執行。

這樣的自主性使得攻擊面發生徹底改變,風險不再只存在於推論時期,而是分散在各種技能、工具、記憶、執行環境,以及代理的決策邏輯,靜態控管已經不足以應付。

企業需要「即時」掌握可視性:代理能做些什麼、實際上在做些什麼,以及這些行為如何符合政策。

OpenShell:代理式 AI 的基石

NVIDIA OpenShell 執行時期導入了一些基礎元素,例如:

- 沙盒模擬執行環境。

- 本機記憶與檔案系統隔離。

- 工具和技能呼叫邊界。

- 在維持資料隱私的情況下,執行本機與外部推論模型路由。

與其建立單一資安解決方案,OpenShell 採取了開放原始碼的設計,讓生態系合作夥伴針對企業應用情境來延伸及強化其資安態勢。

這就是 TrendAI 能夠發揮之處。

將資安融入 AI 代理的整體生命週期

TrendAI 將數十年的行為分析、沙盒模擬分析、威脅情資以及政策強制等基礎知識融入代理式 AI 當中。對 OpenShell 來說,這些專業技術是透過一套多層式架構來確保 AI 代理在執行之前、執行時期,以及動作發生之後的安全。

1. AI 代理一旦開始自主運作之後,通常就脫離了治理

企業的系統管理員可使用 TrendAI Vision One™ 來集中定義 AI 治理與合規政策。這些政策會直接傳送到 OpenShell 執行時期內部,確保 AI 代理的行為符合企業對資安、合規及資料處理的要求。如此就能將治理從理論性政策文件,變成可強制的執行時期控管。

2. 利用 Agentic Scan (代理掃描) 來掌握技能與工具的風險

AI 代理功能的安全性與它們可存取的技能和工具息息相關。Agentic Scan 能持續盤點及分析:

- AI 代理技能。

- 模型情境通訊協定 (MCP) 整合。

- AI 代理環境內可用的工具定義。

已宣告的技能行為會與觀察到的行為做比較,藉此發掘詐欺、不安全或不合規的功能,以免變成營運風險。

例如,AI 代理可能試圖呼叫未經核准的 MCP 服務,或存取超出其宣告範圍的工具,進而產生靜態審查無法看到的隱藏曝險。

3. 動態行為分析

有些威脅在程式碼執行之前不會浮現。

TrendAI 會套用動態分析,在隔離環境中執行技能和工具來觀察其執行時期的真實行為,進而發掘:

- 隱藏的惡意動作。

- 未經授權的系統存取。

- 異常的網路或檔案活動。

這樣做的結果就是,能獲得靜態檢查無法提供的高準度風險情資。

4. 執行時期政策強制 在 AI 代理試圖行動的當下在線 (inline) 強制執行資安控管。

根據治理政策、信譽情資以及行為分析來防止 OpenShell 代理執行以下動作:

- 執行不受信任的技能。

- 呼叫被禁止的工具。

- 執行不合規的動作。

這套強制機制不會干擾已核准的工作流程,因此既能保有創新,又能維持管控。

5. AI 專屬的威脅防護

代理式系統帶來了新型態的 AI 原生攻擊,包括:

- 提示注入。

- 間接提示操弄。

- 敏感資料外洩。

TrendAI Vision One AI Application Security™ 擴充功能可檢查提示、回應及模型的互動,對本機和外部推論路徑強制落實政策。

6. 持續監控與可稽核性

長時間運作的 AI 代理需要持續的監督。

來自 AI 代理執行、工具使用以及沙盒模擬環境的監測資料會整合至 TrendAI 的代理式 SIEM 當中,進而提供:

- 即時的異常偵測。

- 執行後續鑑識分析。

- 合規與稽核報表。

如此一來,企業就能擁有所需的可視性,以負責任的方式操作自主式系統。

7. 靜態信任模型無法應付 AI 代理生態系與威脅的不斷變化。

TrendAI 的全球威脅情資會持續評估以下項目:

- 技能。

- MCP 服務。

- 相關的入侵指標。

這些情資將直接變成治理與強制決策的參考依據,讓資安態勢隨著威脅的演變而調整。

搭配 NVIDIA Agent Toolkit

OpenShell 並非單獨存在,而是 NVIDIA 整個代理式生態系以及 NVIDIA Agent Toolkit 軟體 的一環,包括 NVIDIA AI-Q 和 NVIDIA NeMo Agent Toolkit,可支援代理協調、可觀察性,以及大規模的重複使用。

TrendAI 的資安整合能延伸至這些框架,跟隨著 AI 代理從開發人員環境移轉至企業與 AI 工廠部署環境,提供一致的治理與風險管理。

從實驗到營運

NVIDIA 與 TrendAI 的合作描繪了企業應如何大規模部署代理式 AI,將實驗性自主能力轉變成企業級系統。

結合以下兩者:

- NVIDIA 軟體 (包括 OpenShell 執行時期),提供自我進化的自主式 AI 代理。

- TrendAI 的治理、行為分析與強制貫徹能力。

企業將擁有一種務實、可擴充的路徑來部署自主式 AI 代理,而且不需犧牲控管、信任或問責。

代理式 AI 不一定只能在創新與資安兩者之間做取捨,有了 OpenShell 和 TrendAI,它將成為一種可治理、可觀察、可強制落實政策的平台,隨時為企業做好準備。